Halu-J: Critique-Based Hallucination Judge

作者: Binjie Wang, Steffi Chern, Ethan Chern, Pengfei Liu

分类: cs.CL, cs.AI

发布日期: 2024-07-17

🔗 代码/项目: GITHUB

💡 一句话要点

提出Halu-J,一种基于批判的多证据幻觉检测模型,提升LLM生成内容的事实性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉检测 检索增强 批判生成 多证据推理 事实性验证 自然语言处理

📋 核心要点

- 现有基于检索增强的幻觉检测方法缺乏详细解释,且易受检索系统缺陷的影响,导致检测效果不佳。

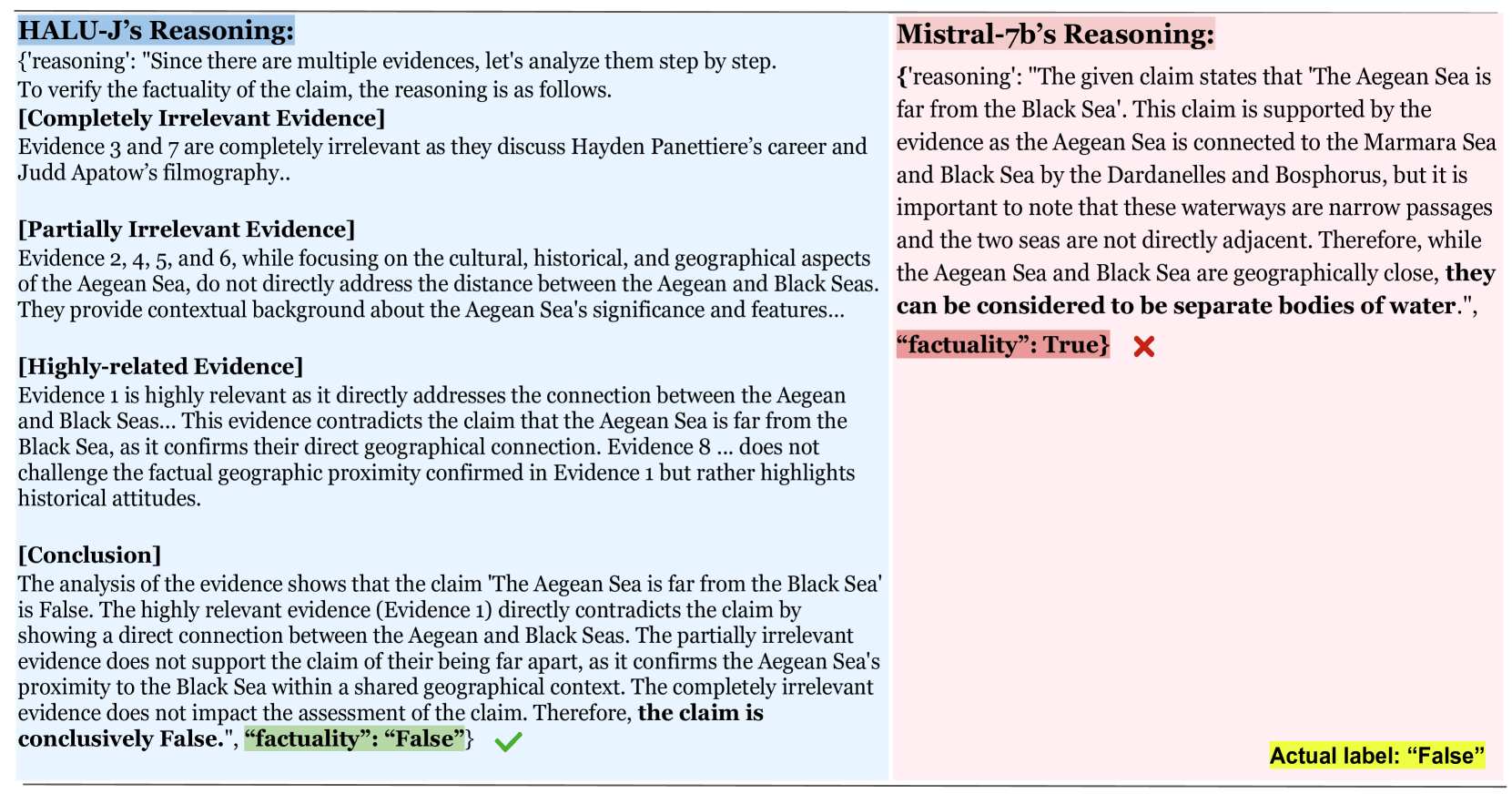

- Halu-J通过选择相关证据并提供详细批判来增强幻觉检测,从而更准确地判断LLM生成内容的事实性。

- 实验表明,Halu-J在多证据幻觉检测方面超越GPT-4o,并在批判生成和证据选择上达到与其相当的水平。

📝 摘要(中文)

大型语言模型(LLMs)经常生成不符合事实的内容,即幻觉。现有的基于检索增强的幻觉检测方法通常将其视为分类任务,根据与检索到的证据的一致性来评估幻觉。然而,这种方法通常缺乏对这些评估的详细解释,并且不评估这些解释的可靠性。此外,检索系统的缺陷可能导致检索到不相关或部分相关的证据,从而损害检测过程。而且,现实世界的幻觉检测需要分析多个证据,而当前的系统通常统一对待所有证据,而不考虑其与内容的相关性。为了应对这些挑战,我们引入了Halu-J,一个具有70亿参数的基于批判的幻觉判断模型。Halu-J通过选择相关的证据并提供详细的批判来增强幻觉检测。我们的实验表明,Halu-J在多证据幻觉检测方面优于GPT-4o,并在批判生成和证据选择方面与其能力相匹配。我们还引入了ME-FEVER,一个新的数据集,专为多证据幻觉检测而设计。我们的代码和数据集可在https://github.com/GAIR-NLP/factool 找到。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)生成幻觉内容的问题,即生成不符合事实的内容。现有方法,特别是基于检索增强的方法,存在以下痛点:缺乏对检测结果的详细解释,无法评估解释的可靠性;检索系统可能返回不相关或部分相关的证据,影响检测准确性;对多个证据的处理方式过于简单,未考虑证据与内容的相关性。

核心思路:论文的核心思路是构建一个基于批判的幻觉判断模型Halu-J,该模型能够选择相关的证据,并针对LLM生成的内容提供详细的批判性分析。通过这种方式,Halu-J不仅能够判断是否存在幻觉,还能解释判断的原因,并提高对多证据幻觉检测的准确性。

技术框架:Halu-J的整体架构包含以下几个主要模块:1) 证据检索模块:用于从外部知识库检索与LLM生成内容相关的证据。2) 证据选择模块:用于从检索到的证据中选择最相关的证据,提高后续判断的准确性。3) 批判生成模块:用于生成针对LLM生成内容的批判性分析,解释判断是否存在幻觉的原因。4) 幻觉判断模块:基于选择的证据和生成的批判,判断LLM生成的内容是否存在幻觉。

关键创新:Halu-J的关键创新在于其基于批判的幻觉检测方法。与现有方法相比,Halu-J不仅能够判断是否存在幻觉,还能提供详细的解释,并考虑证据与内容的相关性。此外,Halu-J还引入了证据选择模块,进一步提高了检测的准确性。

关键设计:Halu-J模型包含70亿参数,具体参数设置未知。论文重点在于模型架构和流程,而非具体的网络结构或损失函数设计。关键设计在于证据选择模块和批判生成模块,具体实现细节未知,但目标是选择最相关的证据并生成高质量的批判性分析。

🖼️ 关键图片

📊 实验亮点

Halu-J在多证据幻觉检测方面优于GPT-4o,并在批判生成和证据选择方面与其能力相匹配。此外,论文还提出了一个新的数据集ME-FEVER,专门用于多证据幻觉检测,为该领域的研究提供了新的资源。具体的性能数据和提升幅度在摘要中未详细说明,需要查阅论文原文。

🎯 应用场景

Halu-J可应用于各种需要确保LLM生成内容真实性的场景,例如:新闻生成、问答系统、内容创作辅助工具等。通过提高LLM生成内容的事实性,可以增强用户对LLM的信任,并减少错误信息的传播。未来,该技术可进一步应用于更广泛的领域,例如:医疗诊断、金融分析等。

📄 摘要(原文)

Large language models (LLMs) frequently generate non-factual content, known as hallucinations. Existing retrieval-augmented-based hallucination detection approaches typically address this by framing it as a classification task, evaluating hallucinations based on their consistency with retrieved evidence. However, this approach usually lacks detailed explanations for these evaluations and does not assess the reliability of these explanations. Furthermore, deficiencies in retrieval systems can lead to irrelevant or partially relevant evidence retrieval, impairing the detection process. Moreover, while real-world hallucination detection requires analyzing multiple pieces of evidence, current systems usually treat all evidence uniformly without considering its relevance to the content. To address these challenges, we introduce Halu-J, a critique-based hallucination judge with 7 billion parameters. Halu-J enhances hallucination detection by selecting pertinent evidence and providing detailed critiques. Our experiments indicate that Halu-J outperforms GPT-4o in multiple-evidence hallucination detection and matches its capability in critique generation and evidence selection. We also introduce ME-FEVER, a new dataset designed for multiple-evidence hallucination detection. Our code and dataset can be found in https://github.com/GAIR-NLP/factool .