Krutrim LLM: A Novel Tokenization Strategy for Multilingual Indic Languages with Petabyte-Scale Data Processing

作者: Rahul Kumar, Shubham Kakde, Divyansh Rajput, Daud Ibrahim, Rishabh Nahata, Pidathala Sowjanya, Deepak Kumarr, Gautam Bhargava, Chandra Khatri

分类: cs.CL

发布日期: 2024-07-17 (更新: 2025-04-01)

💡 一句话要点

Krutrim LLM:面向多语种印度语的PB级数据处理与新型分词策略

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 印度语LLM 多语种模型 数据预处理 分词器训练 tokenization

📋 核心要点

- 现有印度语LLM面临数据质量和分词效率的挑战,影响模型性能。

- 论文提出定制的数据预处理流程和新型多语种分词器训练策略,提升数据质量和分词效率。

- 实验表明,定制的印度语分词器在token-to-word比率上优于OpenAI Tiktoken分词器。

📝 摘要(中文)

本文提出了一种用于开发多语种印度语大型语言模型的数据准备新方法。我们细致地采集了包括Common Crawl、印度语书籍、新闻文章和维基百科在内的开源和专有数据源,确保了多样且丰富的语言表示。针对每种印度语,我们设计了定制的预处理流程,以有效消除冗余和低质量的文本内容。此外,我们对Common Crawl数据进行了去重处理,以解决爬取的网页中70%存在的冗余问题。本研究侧重于开发高质量数据,优化针对具有3B和7B参数的印度语大型语言模型的多语种数据集的分词,从而在印度语中实现卓越的性能。我们引入了一种新型的多语种分词器训练策略,证明了我们定制训练的印度语分词器优于最先进的OpenAI Tiktoken分词器,为印度语实现了卓越的token-to-word比率。

🔬 方法详解

问题定义:现有印度语LLM训练面临数据冗余、质量不高以及现有分词器对印度语支持不足的问题。Common Crawl等数据源存在大量重复和低质量内容,影响模型训练效果。同时,通用分词器如Tiktoken在处理印度语时,token-to-word比率较低,效率不高。

核心思路:论文的核心思路是通过定制化的数据预处理流程和专门为印度语设计的分词器来解决上述问题。数据预处理旨在提升数据质量,去除冗余和低质量文本。定制分词器旨在优化印度语的tokenization,提高token-to-word比率,从而提升模型训练和推理效率。

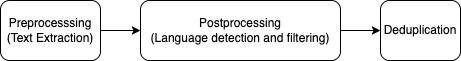

技术框架:整体框架包括数据采集、数据预处理、分词器训练和模型训练四个主要阶段。数据采集阶段收集各种来源的印度语文本数据。数据预处理阶段针对每种印度语设计定制的pipeline,进行数据清洗和去重。分词器训练阶段使用预处理后的数据训练定制的印度语分词器。模型训练阶段使用训练好的分词器和高质量的数据训练3B和7B参数的LLM。

关键创新:论文的关键创新在于提出了针对印度语的定制化数据预处理流程和新型多语种分词器训练策略。数据预处理流程能够有效去除冗余和低质量文本,提升数据质量。新型分词器训练策略能够训练出更适合印度语的分词器,提高token-to-word比率。

关键设计:数据预处理流程包括冗余消除、低质量文本过滤等步骤,具体实现细节未知。分词器训练策略的具体算法和参数设置未知。论文强调了token-to-word比率作为分词器性能的关键指标,并以此为优化目标。

🖼️ 关键图片

📊 实验亮点

论文实验结果表明,定制训练的印度语分词器在token-to-word比率上优于OpenAI Tiktoken分词器。这意味着在处理印度语文本时,定制分词器能够用更少的token表示相同的内容,从而提高模型训练和推理的效率。具体的性能提升幅度未知。

🎯 应用场景

该研究成果可应用于开发更高效、更准确的印度语LLM,提升印度语自然语言处理任务的性能,例如机器翻译、文本摘要、问答系统等。高质量的印度语LLM有助于促进印度语数字内容的发展和普及,并为印度语用户提供更好的AI服务。

📄 摘要(原文)

We present a novel approach to data preparation for developing multilingual Indic large language model. Our meticulous data acquisition spans open-source and proprietary sources, including Common Crawl, Indic books, news articles, and Wikipedia, ensuring a diverse and rich linguistic representation. For each Indic language, we design a custom preprocessing pipeline to effectively eliminate redundant and low-quality text content. Additionally, we perform deduplication on Common Crawl data to address the redundancy present in 70% of the crawled web pages. This study focuses on developing high-quality data, optimizing tokenization for our multilingual dataset for Indic large language models with 3B and 7B parameters, engineered for superior performance in Indic languages. We introduce a novel multilingual tokenizer training strategy, demonstrating our custom-trained Indic tokenizer outperforms the state-of-the-art OpenAI Tiktoken tokenizer, achieving a superior token-to-word ratio for Indic languages.