CCoE: A Compact and Efficient LLM Framework with Multi-Expert Collaboration for Resource-Limited Settings

作者: Shaomang Huang, Jianfeng Pan, Min Peng, Hanzhong Zheng

分类: cs.CL, cs.AI

发布日期: 2024-07-16 (更新: 2025-02-17)

💡 一句话要点

CCoE:一种紧凑高效的LLM框架,通过多专家协作解决资源受限场景问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 多专家系统 资源受限 模型压缩 领域自适应

📋 核心要点

- 现有LLM在多领域应用中面临资源效率和性能平衡的挑战,限制了其广泛应用。

- CCoE通过模块化设计,将领域专家集成到共享骨干网络中,实现高效的多专家协作。

- 实验表明,CCoE在多个领域达到与领域特定LLM相当的性能,并显著降低了内存占用和提高了推理效率。

📝 摘要(中文)

大型语言模型(LLMs)通过在海量数据集上的训练,在各个领域都取得了卓越的性能。然而,扩展LLMs以支持多个下游领域应用仍然是一个重大挑战,尤其是在资源受限的情况下。现有方法通常难以平衡多个领域的性能与资源效率,限制了其更广泛的适用性。为了解决这个问题,我们提出了CCoE架构,这是一个模块化框架,可将特定领域的专家无缝集成到统一的LLM中。通过在共享骨干分区上利用独立训练的专家子网络,CCoE在显著降低多专家部署的资源需求的同时,实现了最先进的性能。此外,CCoE中的基于规则的门控和专家规划实现了灵活的任务分配,促进了专家协作以处理复杂的推理任务。CCoE不仅降低了推理成本,而且为跨各种应用集成领域专业知识提供了一种灵活且可扩展的解决方案。在五个领域进行的实验表明,CCoE实现了与当前特定领域LLM相当的性能。此外,与现有的多领域模型集成方法相比,CCoE减少了61.3%的内存使用量,同时比参数高效的多专家集成方法提高了0.76倍的推理效率。

🔬 方法详解

问题定义:现有的大型语言模型在扩展到多个领域应用时,面临着资源消耗过高的问题。特别是在资源受限的环境下,如何平衡模型在不同领域的性能,同时降低部署和推理的成本,是一个亟待解决的问题。现有的多领域模型集成方法通常需要大量的计算资源和存储空间,限制了其在实际应用中的可行性。

核心思路:CCoE的核心思路是采用模块化的专家网络结构,将不同领域的知识封装在独立的专家子网络中,并共享一个通用的骨干网络。通过这种方式,可以有效地减少模型参数量,降低计算复杂度,并提高资源利用率。此外,CCoE还引入了基于规则的门控机制和专家规划策略,以实现灵活的任务分配和专家协作,从而更好地处理复杂的推理任务。

技术框架:CCoE的整体架构包括一个共享的骨干网络和多个领域特定的专家子网络。当接收到输入时,首先通过基于规则的门控机制,选择合适的专家子网络来处理该输入。然后,选定的专家子网络与共享骨干网络协同工作,完成推理任务。对于复杂的推理任务,CCoE还支持专家规划,即根据任务的特点,动态地选择多个专家子网络进行协作,以获得更好的性能。

关键创新:CCoE最重要的技术创新点在于其模块化的专家网络结构和基于规则的门控机制。与传统的单体模型相比,CCoE可以更有效地利用领域知识,并降低模型参数量。与现有的多专家模型相比,CCoE的门控机制更加灵活,可以根据任务的特点动态地选择合适的专家子网络,从而提高模型的性能。

关键设计:CCoE的关键设计包括专家子网络的结构、门控机制的规则和专家规划的策略。专家子网络可以采用各种不同的网络结构,例如Transformer、CNN等,具体选择取决于领域的特点。门控机制的规则可以基于任务的关键词、领域标签等信息进行设计。专家规划的策略可以采用强化学习、搜索算法等方法进行优化。

🖼️ 关键图片

📊 实验亮点

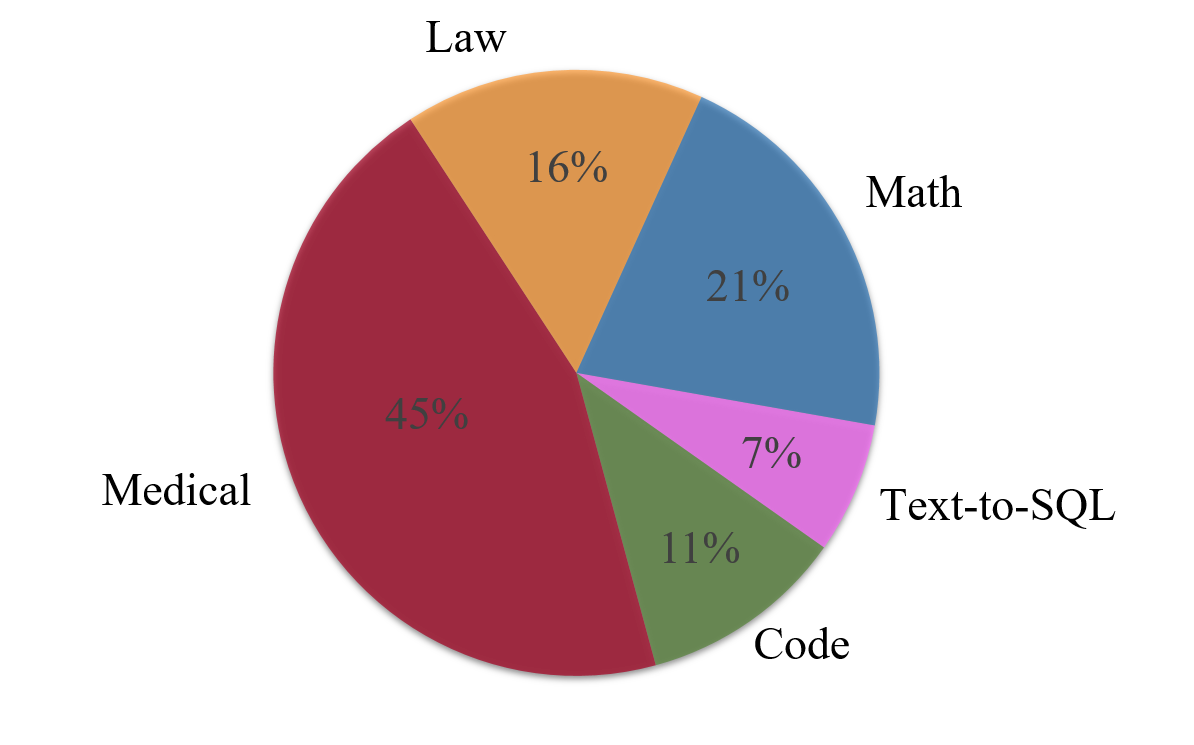

实验结果表明,CCoE在五个领域取得了与领域特定LLM相当的性能。与现有的多领域模型集成方法相比,CCoE减少了61.3%的内存使用量,同时比参数高效的多专家集成方法提高了0.76倍的推理效率。这些结果表明,CCoE是一种高效且可扩展的多领域LLM框架。

🎯 应用场景

CCoE框架适用于各种资源受限的场景,例如移动设备、嵌入式系统和边缘计算环境。它可以被用于构建多领域智能助手、个性化推荐系统和智能客服等应用。通过集成不同领域的专家知识,CCoE可以提供更准确、更高效的服务,并降低部署和维护成本。未来,CCoE有望在医疗、金融、教育等领域发挥重要作用。

📄 摘要(原文)

Large Language Models (LLMs) have achieved exceptional performance across diverse domains through training on massive datasets. However, scaling LLMs to support multiple downstream domain applications remains a significant challenge, especially under resource constraints. Existing approaches often struggle to balance performance across multiple domains with resource efficiency, limiting their broader applicability. To address this, we introduce the CCoE architecture, a modular framework that seamlessly integrates domain-specific experts into a unified LLM. By leveraging independently trained expert subnetworks on a shared backbone partition, CCoE achieves state-of-the-art performance while significantly reducing the resource requirements for multi-expert deployments. Furthermore, rule-based gating and expert planning in CCoE enable flexible task allocation, promoting expert collaboration to handle complex reasoning tasks. CCoE not only reduces inference costs but also provides a flexible and scalable solution for integrating domain expertise across diverse applications. Experiments on five domains demonstrate that CCoE achieves comparable performance to current domain-specific LLMs. Moreover, compared to existing multi-domain model ensemble methods, CCoE reduces memory usage by 61.3%, while improving inference efficiency by 0.76x over parameter-efficient multi-expert integration approaches.