States Hidden in Hidden States: LLMs Emerge Discrete State Representations Implicitly

作者: Junhao Chen, Shengding Hu, Zhiyuan Liu, Maosong Sun

分类: cs.CL

发布日期: 2024-07-16

💡 一句话要点

揭示LLM隐式离散状态表征:无需CoT涌现复杂计算能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 涌现能力 隐式离散状态表征 符号计算 隐藏状态分析

📋 核心要点

- 现有方法依赖思维链(CoT)解决复杂计算问题,效率较低,且未能充分挖掘LLM的内在计算潜力。

- 该论文提出LLM内部涌现隐式离散状态表征(IDSR),模型通过IDSR直接进行符号计算,无需显式的逐步推理。

- 实验验证了IDSR的存在,并从不同角度分析了IDSR的形成过程,揭示了LLM进行复杂计算的内在机制。

📝 摘要(中文)

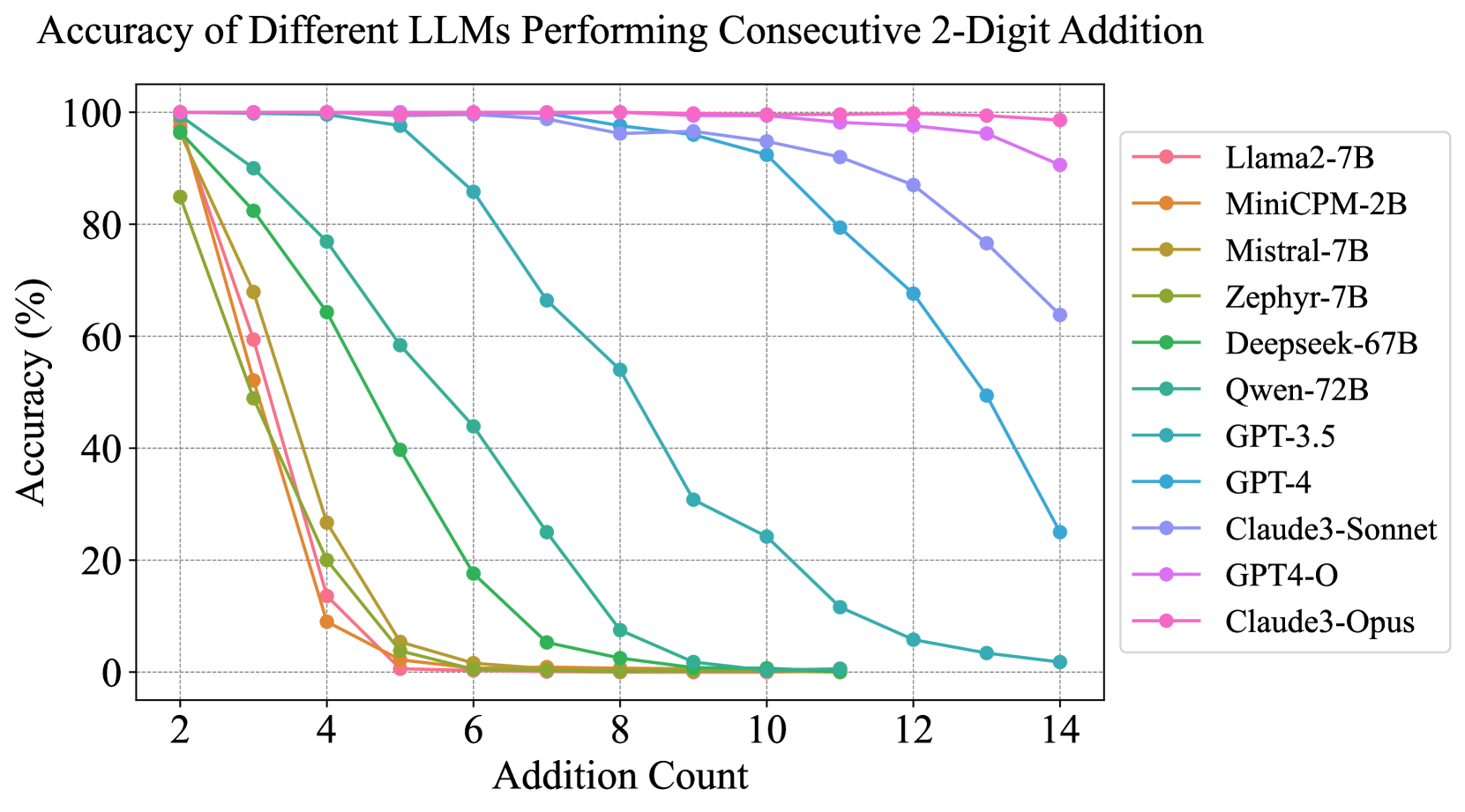

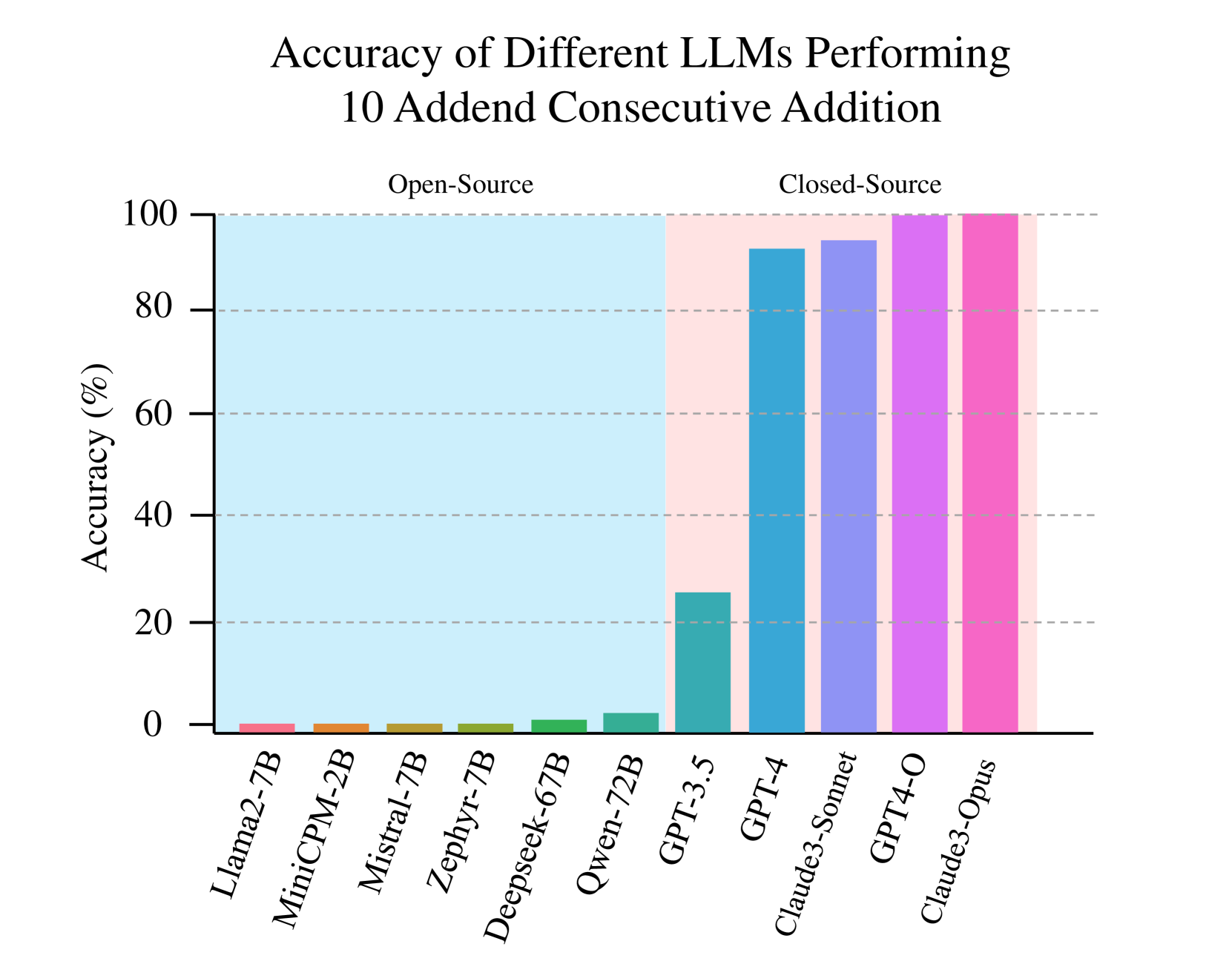

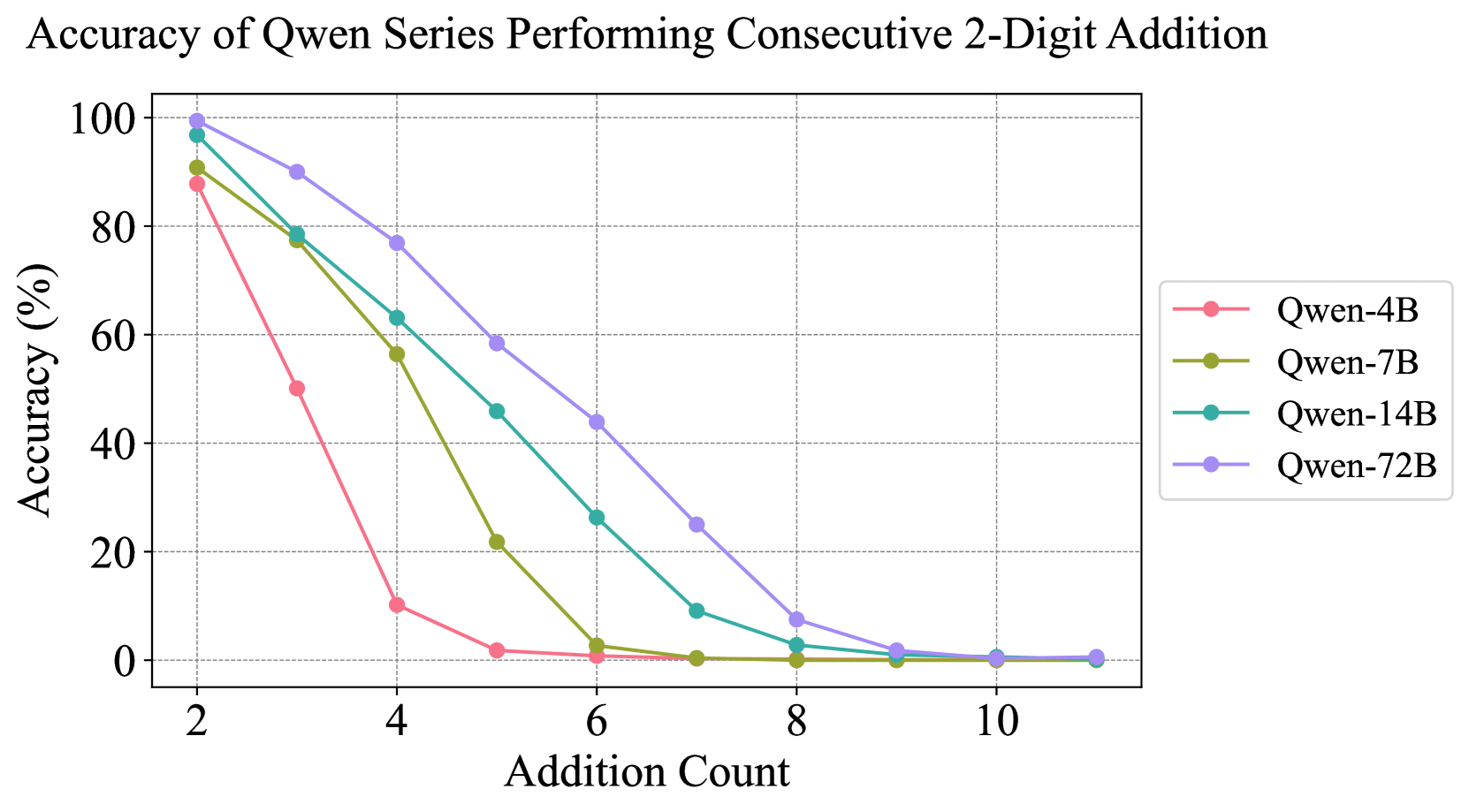

大型语言模型(LLM)展现出各种涌现能力。本文揭示了一种新的涌现能力:模型具备执行扩展序列计算的内在能力,而无需依赖思维链(CoT)式的逐步解决方案。令人惊讶的是,最先进的模型可以直接输出长度高达15个加数的两位数加法的结果。我们假设模型在其隐藏状态中涌现出隐式离散状态表征(IDSR),并在内部执行符号计算。为了验证这一假设,我们设计了一系列实验来研究隐藏状态。具体来说,我们首先确认IDSR的存在。然后,我们从层、数字和序列的角度提供了关于IDSR形成的有趣观察。最后,我们确认模型确实使用IDSR来生成最终答案。然而,我们也发现,在当前开源模型中,这些状态表征远非无损,导致最终性能不准确。我们的工作对LLM的符号计算能力和底层机制进行了新的探索。

🔬 方法详解

问题定义:现有的大型语言模型在执行复杂计算任务时,通常依赖于思维链(Chain-of-Thought, CoT)方法,即逐步生成中间步骤来推导出最终答案。这种方法虽然有效,但效率较低,并且可能无法充分利用模型自身的计算能力。因此,该论文旨在探索LLM是否具备在没有显式CoT的情况下,直接执行复杂计算的能力,并深入理解其内在机制。

核心思路:该论文的核心思路是假设LLM在其隐藏状态中涌现出隐式离散状态表征(Implicit Discrete State Representations, IDSRs),这些IDSRs能够编码计算过程中的中间状态,从而使模型能够在内部执行符号计算,而无需显式地生成中间步骤。通过分析隐藏状态,可以揭示LLM进行复杂计算的内在机制。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 设计实验任务,即多位数加法,以评估LLM的计算能力。2) 提取LLM在执行计算任务时的隐藏状态。3) 分析隐藏状态,验证IDSR的存在,并研究其形成过程。4) 设计实验来验证模型是否利用IDSR来生成最终答案。

关键创新:该论文最重要的技术创新点在于发现了LLM中涌现的隐式离散状态表征(IDSRs)。与传统的CoT方法不同,IDSRs允许模型在内部进行符号计算,而无需显式地生成中间步骤。这种内在的计算能力为LLM的优化和应用提供了新的思路。

关键设计:该研究的关键设计包括:1) 选择了多位数加法作为实验任务,因为这种任务需要进行序列化的计算,可以更好地观察IDSR的形成过程。2) 设计了多种实验来分析隐藏状态,包括从层、数字和序列的角度研究IDSR的形成。3) 使用探针(probe)技术来验证模型是否利用IDSR来生成最终答案。此外,论文还分析了IDSR的损失情况,并探讨了其对模型性能的影响。

🖼️ 关键图片

📊 实验亮点

研究发现,先进的LLM可以直接输出长度高达15个加数的两位数加法的结果,无需依赖CoT。实验验证了IDSR的存在,并揭示了IDSR的形成过程。然而,研究也发现当前开源模型中的IDSR并非无损,导致计算结果存在误差。

🎯 应用场景

该研究成果可应用于提升LLM的计算效率和准确性,尤其是在需要复杂计算的场景,如科学计算、金融分析等。通过理解和优化IDSR,可以开发出更高效、更强大的LLM,并推动人工智能在各个领域的应用。

📄 摘要(原文)

Large Language Models (LLMs) exhibit various emergent abilities. Among these abilities, some might reveal the internal working mechanisms of models. In this paper, we uncover a novel emergent capability in models: the intrinsic ability to perform extended sequences of calculations without relying on chain-of-thought step-by-step solutions. Remarkably, the most advanced models can directly output the results of two-digit number additions with lengths extending up to 15 addends. We hypothesize that the model emerges Implicit Discrete State Representations (IDSRs) within its hidden states and performs symbolic calculations internally. To test this hypothesis, we design a sequence of experiments that look into the hidden states. Specifically, we first confirm that IDSRs exist. Then, we provide interesting observations about the formation of IDSRs from layer, digit, and sequence perspectives. Finally, we confirm that models indeed use IDSRs to produce the final answers. However, we also discover that these state representations are far from lossless in current open-sourced models, leading to inaccuracies in their final performance. Our work presents a novel exploration of LLMs' symbolic calculation abilities and the underlying mechanisms.