Empowering Persian LLMs for Instruction Following: A Novel Dataset and Training Approach

作者: Hojjat Mokhtarabadi, Ziba Zamani, Abbas Maazallahi, Mohammad Hossein Manshaei

分类: cs.CL, cs.AI

发布日期: 2024-07-15 (更新: 2025-01-14)

💡 一句话要点

提出FarsInstruct波斯语指令数据集和Co-CoLA训练框架,提升波斯语LLM的指令遵循能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 波斯语LLM 指令遵循 数据集构建 低资源语言 LoRA微调 多任务学习 数据增强

📋 核心要点

- 现有指令微调LLM在低资源语言(如波斯语)的指令遵循能力不足,限制了其应用。

- 提出FarsInstruct数据集和Co-CoLA框架,旨在提升波斯语LLM在多任务场景下的指令遵循能力。

- 实验表明,FarsInstruct数据集和Co-CoLA框架的结合,有效提升了LLM在波斯语环境下的性能。

📝 摘要(中文)

指令微调的大型语言模型在遵循人类指令方面表现出卓越的能力。然而,它们在许多低资源语言中的能力仍然明显不足。为了解决这个问题,我们首先推出了FarsInstruct,这是一个全面的指令数据集,旨在增强大型语言模型在波斯语(一种重要但全球代表性不足的语言)中的指令遵循能力。FarsInstruct包含各种任务类型和数据集,每个数据集都包含从简单到复杂的手动编写指令以及来自公共提示池的翻译,确保了丰富的语言和文化表示。此外,我们还引入了Co-CoLA框架,旨在增强LoRA微调模型的多任务适应性。通过广泛的实验分析,我们的研究表明,FarsInstruct数据集与Co-CoLA框架的训练相结合,可以提高大型语言模型在波斯语环境中的性能。截至目前,FarsInstruct包含21个不同数据集的197个模板,我们计划不断更新它,从而增强其适用性。

🔬 方法详解

问题定义:论文旨在解决波斯语大型语言模型(LLM)在指令遵循能力上的不足。现有方法在低资源语言上的表现不佳,缺乏高质量的波斯语指令数据集,并且难以有效利用LoRA等参数高效微调方法进行多任务学习。

核心思路:论文的核心思路是构建一个高质量、多样化的波斯语指令数据集(FarsInstruct),并设计一个能够有效提升LoRA微调模型多任务适应性的训练框架(Co-CoLA)。通过数据和算法的双重优化,提升波斯语LLM的指令遵循能力。

技术框架:整体框架包含两个主要部分:1) FarsInstruct数据集的构建,包括手动编写指令和翻译公共提示池的指令,覆盖多种任务类型和数据集;2) Co-CoLA训练框架,用于LoRA微调模型的训练,旨在提升模型的多任务适应性。具体流程是:首先使用FarsInstruct数据集对LLM进行LoRA微调,然后使用Co-CoLA框架进一步优化微调后的模型。

关键创新:论文的关键创新在于:1) 构建了大规模的波斯语指令数据集FarsInstruct,填补了波斯语LLM训练数据的空白;2) 提出了Co-CoLA训练框架,能够有效提升LoRA微调模型在多任务场景下的泛化能力。Co-CoLA框架的具体实现细节未知。

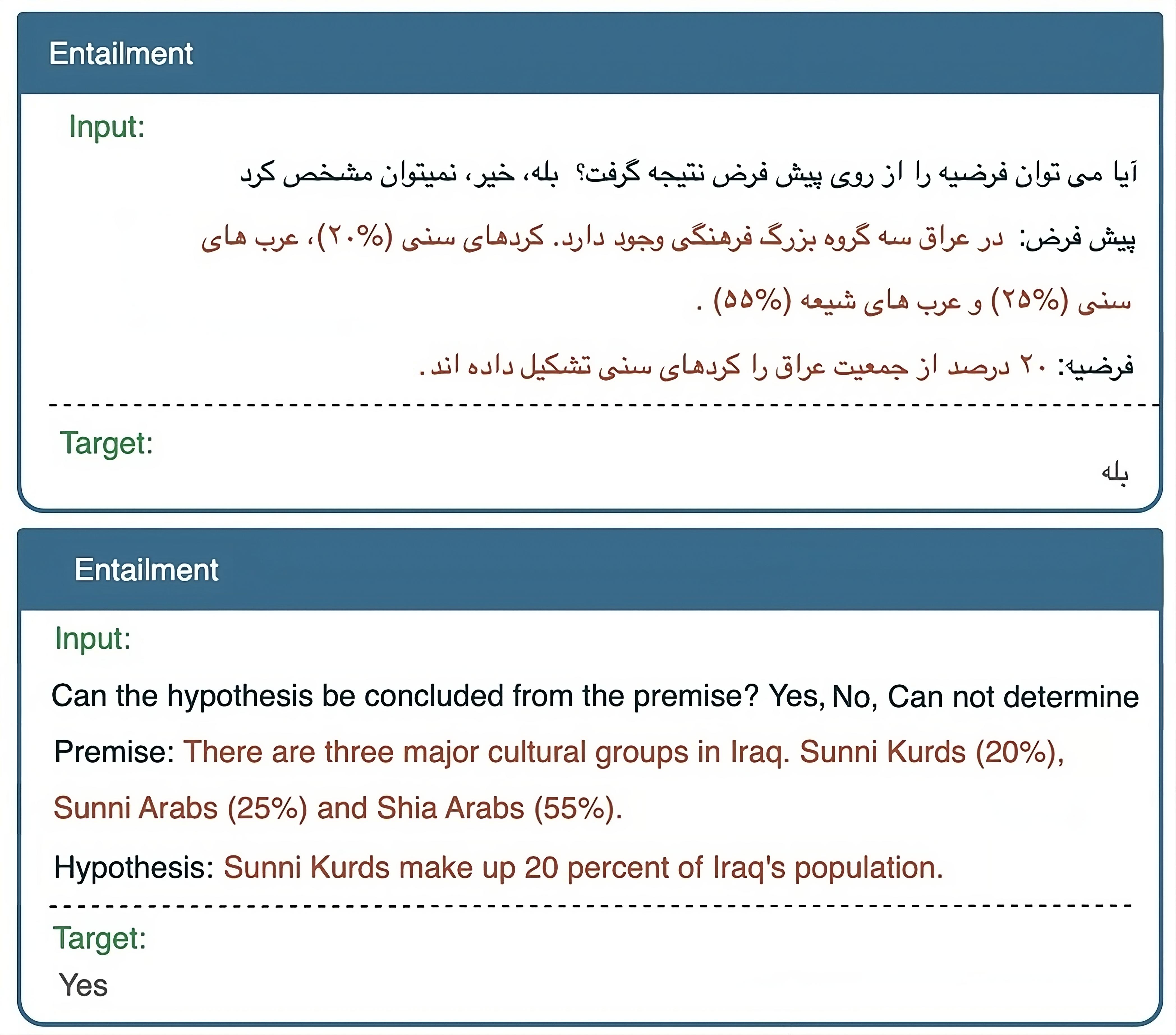

关键设计:FarsInstruct数据集包含197个模板,覆盖21个不同的数据集。数据集的构建过程包括人工编写和翻译,力求保证指令的多样性和质量。Co-CoLA框架的具体参数设置、损失函数和网络结构等技术细节未知,但其核心目标是提升LoRA微调模型的多任务适应性。

🖼️ 关键图片

📊 实验亮点

论文构建了包含197个模板的FarsInstruct数据集,并提出了Co-CoLA训练框架。实验结果表明,使用FarsInstruct数据集和Co-CoLA框架进行训练,能够有效提升波斯语LLM的指令遵循能力。具体的性能数据和提升幅度在摘要中未明确给出,需要查阅原文。

🎯 应用场景

该研究成果可应用于波斯语自然语言处理的各个领域,例如智能客服、机器翻译、文本摘要、问答系统等。通过提升波斯语LLM的指令遵循能力,可以更好地满足波斯语用户的需求,促进波斯语信息技术的发展。未来,该研究可以推广到其他低资源语言,提升全球范围内LLM的应用水平。

📄 摘要(原文)

Instruction-tuned large language models have demonstrated remarkable capabilities in following human instructions across various domains. However, their proficiency remains notably deficient in many low-resource languages. To address this challenge, we begin by introducing FarsInstruct a comprehensive instruction dataset designed to enhance the instruction following ability of large language models specifically for the Persian language a significant yet underrepresented language globally. FarsInstruct encompasses a wide range of task types and datasets, each containing a mix of straightforward to complex manual written instructions, as well as translations from the Public Pool of Prompts, ensuring a rich linguistic and cultural representation. Furthermore, we introduce Co-CoLA, a framework designed to enhance the multi-task adaptability of LoRA-tuned models. Through extensive experimental analyses, our study showcases the effectiveness of the FarsInstruct dataset coupled with training by the Co-CoLA framework, in improving the performance of large language models within the Persian context. As of the current writing, FarsInstruct comprises 197 templates across 21 distinct datasets, and we intend to update it consistently, thus augmenting its applicability.