Think-on-Graph 2.0: Deep and Faithful Large Language Model Reasoning with Knowledge-guided Retrieval Augmented Generation

作者: Shengjie Ma, Chengjin Xu, Xuhui Jiang, Muzhi Li, Huaren Qu, Cehao Yang, Jiaxin Mao, Jian Guo

分类: cs.CL, cs.AI

发布日期: 2024-07-15 (更新: 2025-02-10)

🔗 代码/项目: GITHUB

💡 一句话要点

提出Think-on-Graph 2.0,通过知识图谱引导的检索增强生成实现深度LLM推理。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 知识图谱 大型语言模型 深度推理 上下文检索 图检索 知识密集型任务

📋 核心要点

- 现有RAG方法在复杂推理任务中,难以保证检索信息的深度和完整性,导致LLM推理能力受限。

- ToG-2通过紧耦合的上下文检索和图检索,迭代地从非结构化文档和结构化知识图谱中检索信息,实现深度推理。

- 实验表明,ToG-2在多个知识密集型数据集上取得了SOTA性能,并能提升小模型的推理能力。

📝 摘要(中文)

检索增强生成(RAG)通过利用知识检索来克服知识缺陷,从而改进了大型语言模型(LLM)。然而,当前的RAG方法通常无法确保检索信息的深度和完整性,这对于复杂的推理任务是必要的。本文介绍Think-on-Graph 2.0 (ToG-2),这是一种混合RAG框架,它以紧耦合的方式迭代地从非结构化和结构化知识源检索信息。具体来说,ToG-2利用知识图谱(KG)通过实体连接文档,从而促进深度和知识引导的上下文检索。同时,它利用文档作为实体上下文来实现精确和高效的图检索。ToG-2在图检索和上下文检索之间交替搜索与问题相关的深入线索,使LLM能够生成答案。大量实验表明,ToG-2在7个知识密集型数据集中有6个上实现了最先进的(SOTA)性能,并且可以将较小模型(例如,LLAMA-2-13B)的性能提升到GPT-3.5的直接推理水平。

🔬 方法详解

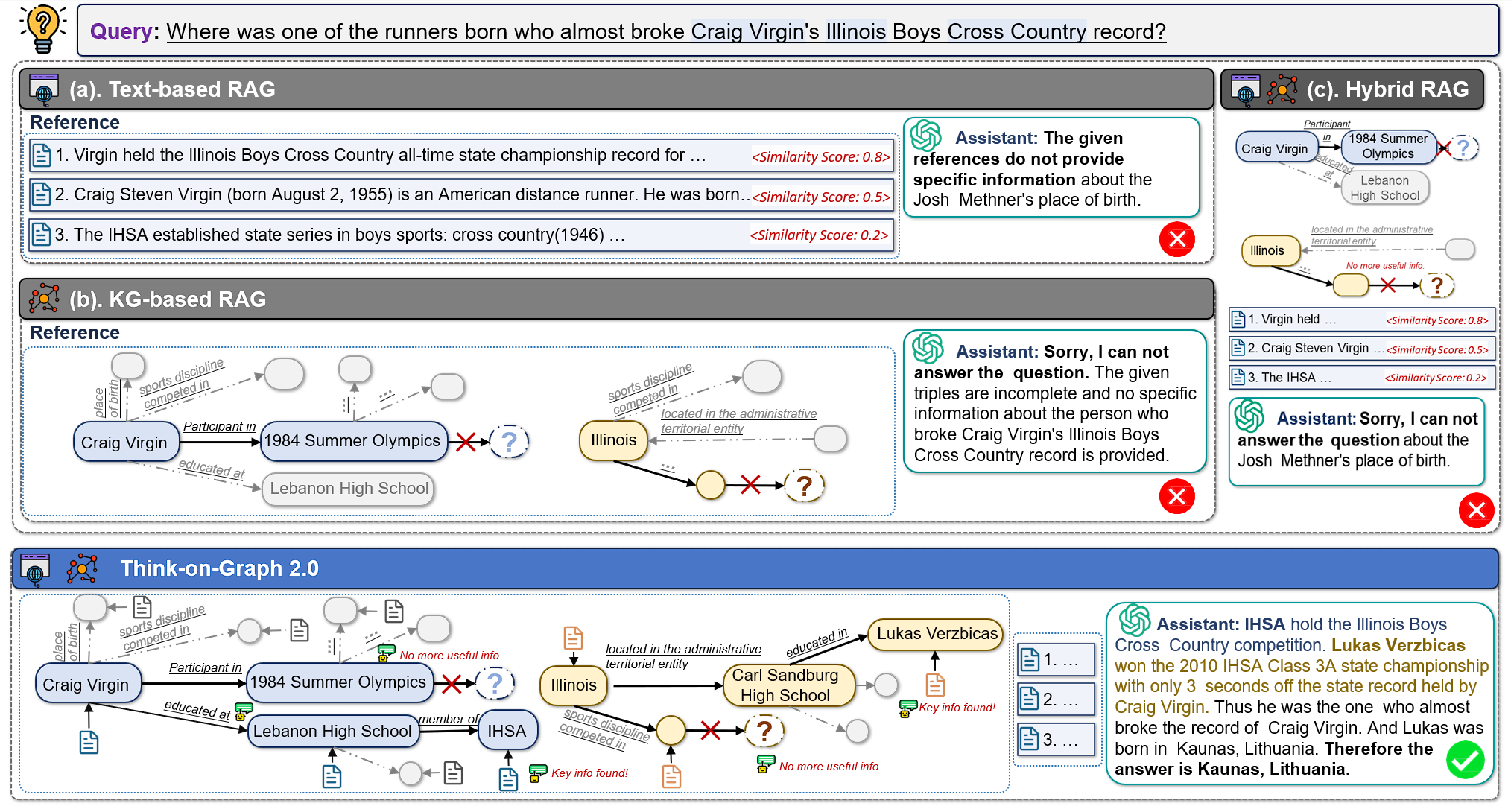

问题定义:现有RAG方法在处理复杂推理任务时,检索到的信息深度和完整性不足,无法充分支持LLM进行高质量的推理。痛点在于难以有效地利用结构化知识和非结构化知识之间的关联,导致检索效率和推理准确性受限。

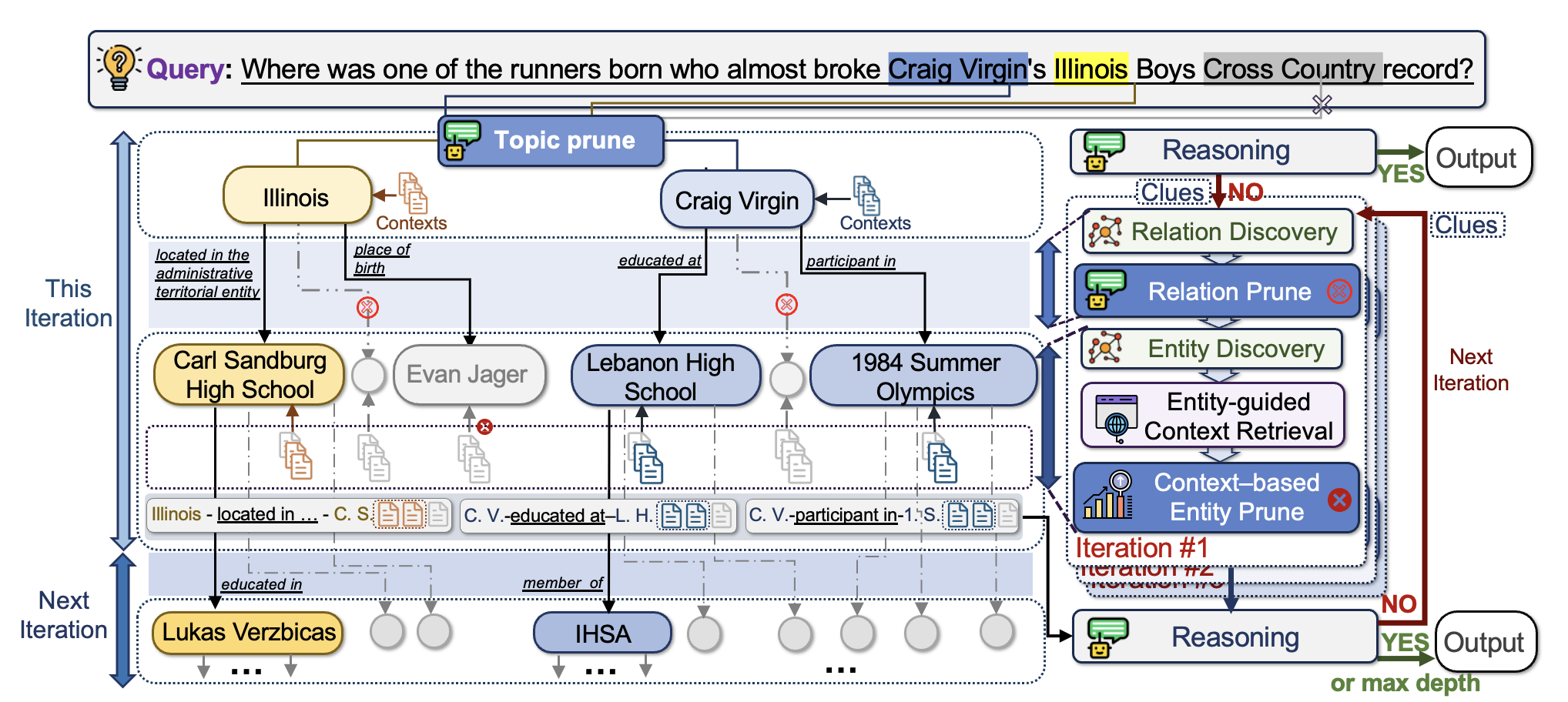

核心思路:ToG-2的核心思路是紧耦合上下文检索和图检索,通过知识图谱连接文档,实现知识引导的深度上下文检索。同时,利用文档作为实体上下文,实现精确的图检索。这种双向迭代检索的方式,能够更全面、深入地挖掘与问题相关的知识。

技术框架:ToG-2的整体框架是一个迭代的检索增强生成流程。主要包含以下模块:1) 问题输入;2) 初始检索(可以是上下文检索或图检索);3) 交替迭代的上下文检索和图检索;4) LLM推理生成答案。上下文检索模块负责从非结构化文档中检索相关信息,图检索模块负责从知识图谱中检索相关实体和关系。

关键创新:ToG-2的关键创新在于其紧耦合的上下文检索和图检索机制。传统RAG方法通常是独立地进行文档检索,而ToG-2通过知识图谱将文档连接起来,实现了知识引导的上下文检索,从而能够更深入地挖掘相关信息。同时,利用文档上下文进行图检索,提高了图检索的准确性和效率。

关键设计:ToG-2是一个训练自由的框架,可以与各种LLM即插即用。关键设计包括:1) 使用预训练的实体链接模型将文档中的实体链接到知识图谱;2) 设计合适的检索策略,平衡上下文检索和图检索的迭代次数;3) 使用合适的提示工程,引导LLM利用检索到的知识进行推理。

🖼️ 关键图片

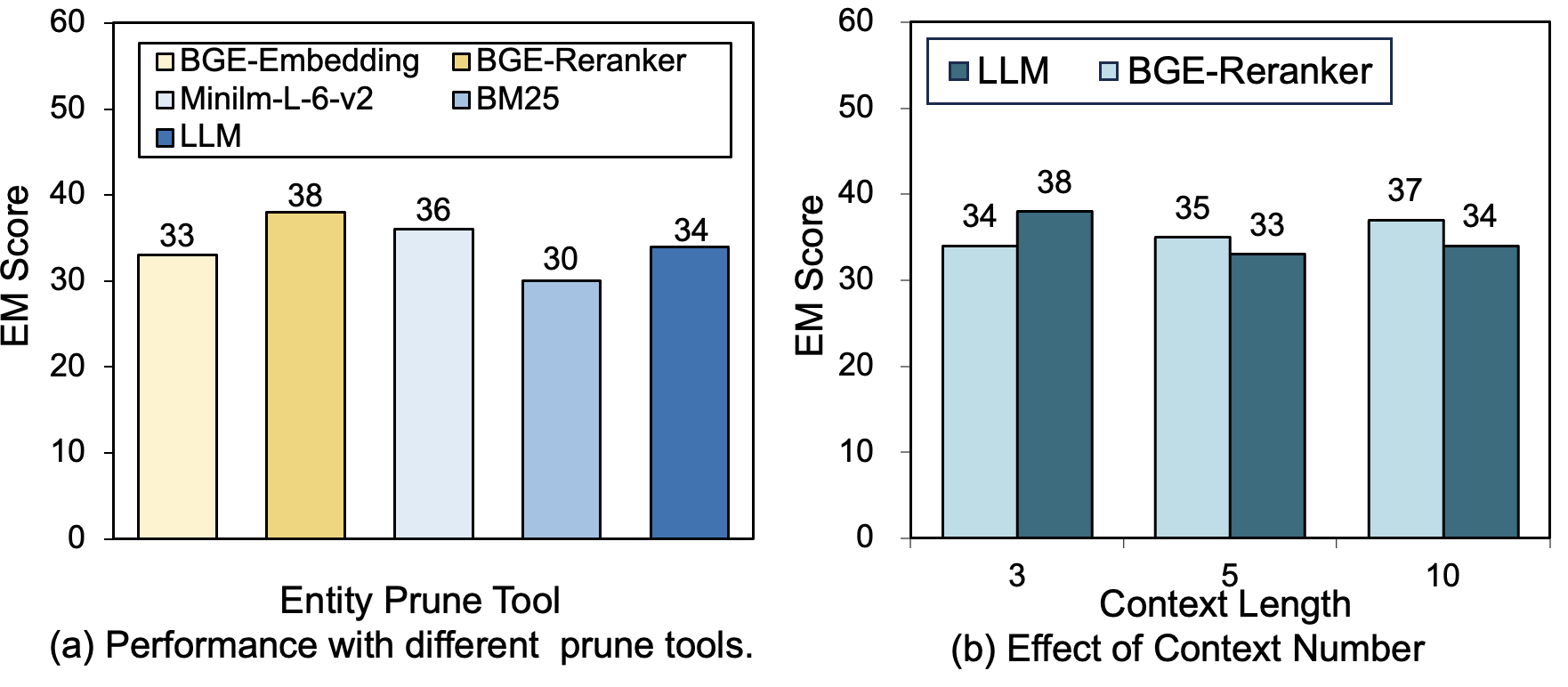

📊 实验亮点

ToG-2在7个知识密集型数据集中的6个上取得了SOTA性能,证明了其有效性。例如,在某些数据集上,ToG-2使用GPT-3.5取得了显著优于其他RAG方法的性能。更重要的是,ToG-2可以将较小模型(如LLAMA-2-13B)的性能提升到GPT-3.5的直接推理水平,这表明其具有很强的泛化能力和实用价值。

🎯 应用场景

ToG-2可应用于需要深度推理和知识支持的各种场景,例如问答系统、智能客服、知识图谱构建、医疗诊断、金融分析等。该研究有助于提升LLM在知识密集型任务中的性能,并为构建更智能、更可靠的AI系统提供技术支持。

📄 摘要(原文)

Retrieval-augmented generation (RAG) has improved large language models (LLMs) by using knowledge retrieval to overcome knowledge deficiencies. However, current RAG methods often fall short of ensuring the depth and completeness of retrieved information, which is necessary for complex reasoning tasks. In this work, we introduce Think-on-Graph 2.0 (ToG-2), a hybrid RAG framework that iteratively retrieves information from both unstructured and structured knowledge sources in a tight-coupling manner. Specifically, ToG-2 leverages knowledge graphs (KGs) to link documents via entities, facilitating deep and knowledge-guided context retrieval. Simultaneously, it utilizes documents as entity contexts to achieve precise and efficient graph retrieval. ToG-2 alternates between graph retrieval and context retrieval to search for in-depth clues relevant to the question, enabling LLMs to generate answers. We conduct a series of well-designed experiments to highlight the following advantages of ToG-2: 1) ToG-2 tightly couples the processes of context retrieval and graph retrieval, deepening context retrieval via the KG while enabling reliable graph retrieval based on contexts; 2) it achieves deep and faithful reasoning in LLMs through an iterative knowledge retrieval process of collaboration between contexts and the KG; and 3) ToG-2 is training-free and plug-and-play compatible with various LLMs. Extensive experiments demonstrate that ToG-2 achieves overall state-of-the-art (SOTA) performance on 6 out of 7 knowledge-intensive datasets with GPT-3.5, and can elevate the performance of smaller models (e.g., LLAMA-2-13B) to the level of GPT-3.5's direct reasoning. The source code is available on https://github.com/IDEA-FinAI/ToG-2.