Causality extraction from medical text using Large Language Models (LLMs)

作者: Seethalakshmi Gopalakrishnan, Luciana Garbayo, Wlodek Zadrozny

分类: cs.CL, cs.AI, cs.IR

发布日期: 2024-07-13

💡 一句话要点

利用大型语言模型从医学文本中提取因果关系,首次应用于妊娠糖尿病临床实践指南。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 因果关系提取 医学文本挖掘 大型语言模型 临床实践指南 妊娠糖尿病 BioBERT 自然语言处理

📋 核心要点

- 现有方法难以有效从医学文本中提取因果关系,尤其是在临床实践指南中,缺乏针对性解决方案。

- 本研究探索使用BERT变体和大型语言模型,从妊娠糖尿病临床实践指南中提取因果关系。

- 实验结果表明,BioBERT模型表现最佳,F1值达到0.72,优于其他模型,包括GPT-4和LLAMA2。

📝 摘要(中文)

本研究探索了自然语言模型(包括大型语言模型)从医学文本(特别是临床实践指南,CPGs)中提取因果关系的潜力。文章展示了从妊娠糖尿病临床实践指南中提取因果关系的结果,这是该领域的首次尝试。我们报告了一系列使用BERT变体(BioBERT、DistilBERT和BERT)以及大型语言模型(LLM)(即GPT-4和LLAMA2)进行的实验。实验表明,BioBERT的性能优于其他模型,包括大型语言模型,平均F1分数为0.72。GPT-4和LLAMA2的结果显示出相似的性能,但一致性较差。我们还发布了代码以及一个带注释的妊娠糖尿病临床实践指南中的因果关系陈述语料库。

🔬 方法详解

问题定义:论文旨在解决从医学文本,特别是妊娠糖尿病临床实践指南(CPGs)中自动提取因果关系的问题。现有方法在处理此类专业文本时,准确率和效率较低,缺乏针对医学领域的优化,难以满足临床决策支持的需求。

核心思路:论文的核心思路是利用预训练语言模型的强大语义理解能力,特别是针对生物医学领域优化的模型(如BioBERT),来识别和提取文本中的因果关系。通过微调这些模型,使其适应因果关系提取的任务,从而提高准确率和效率。同时,探索大型语言模型(LLMs)在这一任务中的潜力。

技术框架:整体框架包括以下几个阶段:1) 数据准备:构建并标注妊娠糖尿病临床实践指南中的因果关系语料库。2) 模型选择与微调:选择BERT、BioBERT、DistilBERT、GPT-4和LLAMA2等模型,并使用标注的语料库进行微调。3) 因果关系提取:使用微调后的模型从文本中提取因果关系。4) 性能评估:使用F1-score等指标评估模型的性能。

关键创新:该研究的主要创新点在于:1) 首次将因果关系提取应用于妊娠糖尿病临床实践指南。2) 比较了多种预训练语言模型(包括BERT变体和LLMs)在医学文本因果关系提取任务中的性能。3) 发布了一个带注释的妊娠糖尿病临床实践指南中的因果关系陈述语料库,为后续研究提供了数据基础。与现有方法的本质区别在于,该研究侧重于利用预训练语言模型的知识迁移能力,避免了从头开始训练模型,从而提高了效率和准确率。

关键设计:论文的关键设计包括:1) 针对医学文本的预训练模型选择(BioBERT)。2) 使用F1-score作为评估指标。3) 构建并发布了带注释的因果关系语料库。具体参数设置和损失函数等细节在论文中未详细描述,属于模型微调的标准流程。

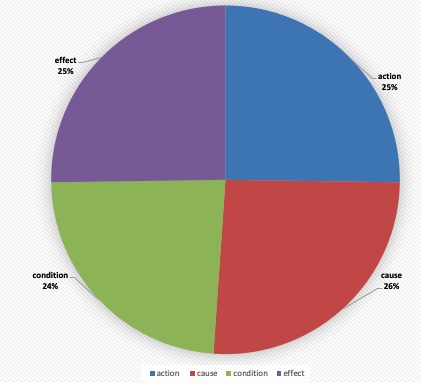

🖼️ 关键图片

📊 实验亮点

实验结果表明,BioBERT模型在因果关系提取任务中表现最佳,平均F1分数为0.72,优于其他模型,包括GPT-4和LLAMA2。这表明针对生物医学领域优化的预训练语言模型在处理医学文本时具有优势。此外,研究还发布了带注释的语料库,为后续研究提供了宝贵资源。

🎯 应用场景

该研究成果可应用于临床决策支持系统,帮助医生快速准确地从临床指南中提取关键信息,辅助诊断和治疗。此外,该技术还可用于构建医学知识图谱,促进医学研究和知识发现。未来,该方法有望推广到其他医学领域,提高医疗效率和质量。

📄 摘要(原文)

This study explores the potential of natural language models, including large language models, to extract causal relations from medical texts, specifically from Clinical Practice Guidelines (CPGs). The outcomes causality extraction from Clinical Practice Guidelines for gestational diabetes are presented, marking a first in the field. We report on a set of experiments using variants of BERT (BioBERT, DistilBERT, and BERT) and using Large Language Models (LLMs), namely GPT-4 and LLAMA2. Our experiments show that BioBERT performed better than other models, including the Large Language Models, with an average F1-score of 0.72. GPT-4 and LLAMA2 results show similar performance but less consistency. We also release the code and an annotated a corpus of causal statements within the Clinical Practice Guidelines for gestational diabetes.