Large Models of What? Mistaking Engineering Achievements for Human Linguistic Agency

作者: Abeba Birhane, Marek McGann

分类: cs.CL, cs.CY

发布日期: 2024-07-11

备注: To appear in the Journal of Language Sciences

💡 一句话要点

批判性分析:大型语言模型并非人类语言能力的完整复现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 具身认知 语言哲学 算法言语 人工智能伦理

📋 核心要点

- 现有大型语言模型(LLM)常被认为具备类人语言能力,但这种观点忽略了语言的本质和复杂性。

- 论文从具身认知的角度出发,强调语言的具身性、参与性和不稳定性,这些是LLM所不具备的。

- 通过分析“算法言语”现象,揭示了LLM在模拟真实人类语言活动方面的局限性。

📝 摘要(中文)

本文批判性地指出,关于大型语言模型(LLM)语言能力的关键性、通常带有耸人听闻和误导性的论断,是基于至少两个未经证实的假设:语言完整性假设和数据完整性假设。语言完整性假设认为存在一种独特的、完整的“自然语言”,其本质特征可以被LLM有效且全面地建模。数据完整性假设则依赖于这样一种信念,即一种语言可以被量化并完全被数据捕获。认知科学中的具身认知方法明确表明,语言不是一种独特的、完整的事物,而是一种行动的手段或方式。语言活动(Languaging)不能被完整或全面地建模。从具身认知的角度,我们确定了具身语言的三个关键特征:具身性、参与性和不稳定性,这些特征在LLM中缺失,并且在原则上可能与当前的架构不兼容。我们认为,这些缺失意味着LLM现在不是,并且以其目前的形式也不能像人类那样成为语言主体。我们通过“算法言语”(algospeak)现象特别说明了这一点,这是一种最近描述的在高风险、受严格控制的在线环境中出现的人类语言活动模式。基于这些观点,我们得出结论,关于LLM主体性和能力的耸人听闻和误导性论断源于对人类语言和LLM的深刻误解。

🔬 方法详解

问题定义:现有研究往往将大型语言模型(LLM)视为能够完整模拟人类语言能力的工具,并基于此进行各种应用和预测。然而,这种观点忽略了人类语言的复杂性和动态性,以及语言与人类经验、社会互动之间的紧密联系。现有方法未能充分考虑语言的具身性、参与性和不稳定性等关键特征。

核心思路:论文的核心思路是批判性地审视LLM的语言能力,并指出其与人类语言的本质区别。论文借鉴具身认知理论,强调语言是人类行动的一种方式,而非一种可以被完全建模的静态对象。通过分析LLM的架构和训练方式,揭示其在具身性、参与性和不稳定性方面的不足。

技术框架:论文没有提出新的技术框架,而是采用了一种概念分析和案例研究的方法。首先,论文阐述了语言完整性假设和数据完整性假设的缺陷。然后,论文从具身认知的角度,提出了具身语言的三个关键特征。最后,论文通过分析“算法言语”现象,说明了LLM在模拟真实人类语言活动方面的局限性。整体上,该论文属于一种思辨性的研究,旨在引发对LLM语言能力的更深入思考。

关键创新:论文的关键创新在于其批判性的视角和对具身认知理论的应用。论文挑战了关于LLM语言能力的普遍观点,并提出了一个更符合人类语言本质的解释框架。通过强调语言的具身性、参与性和不稳定性,论文为理解LLM的局限性提供了新的视角。

关键设计:论文没有涉及具体的技术设计。其主要贡献在于概念分析和理论框架的构建。论文通过对“算法言语”现象的分析,说明了LLM在处理复杂、动态的语言环境方面的不足。这种分析方法可以应用于其他类似的案例研究,以更全面地评估LLM的语言能力。

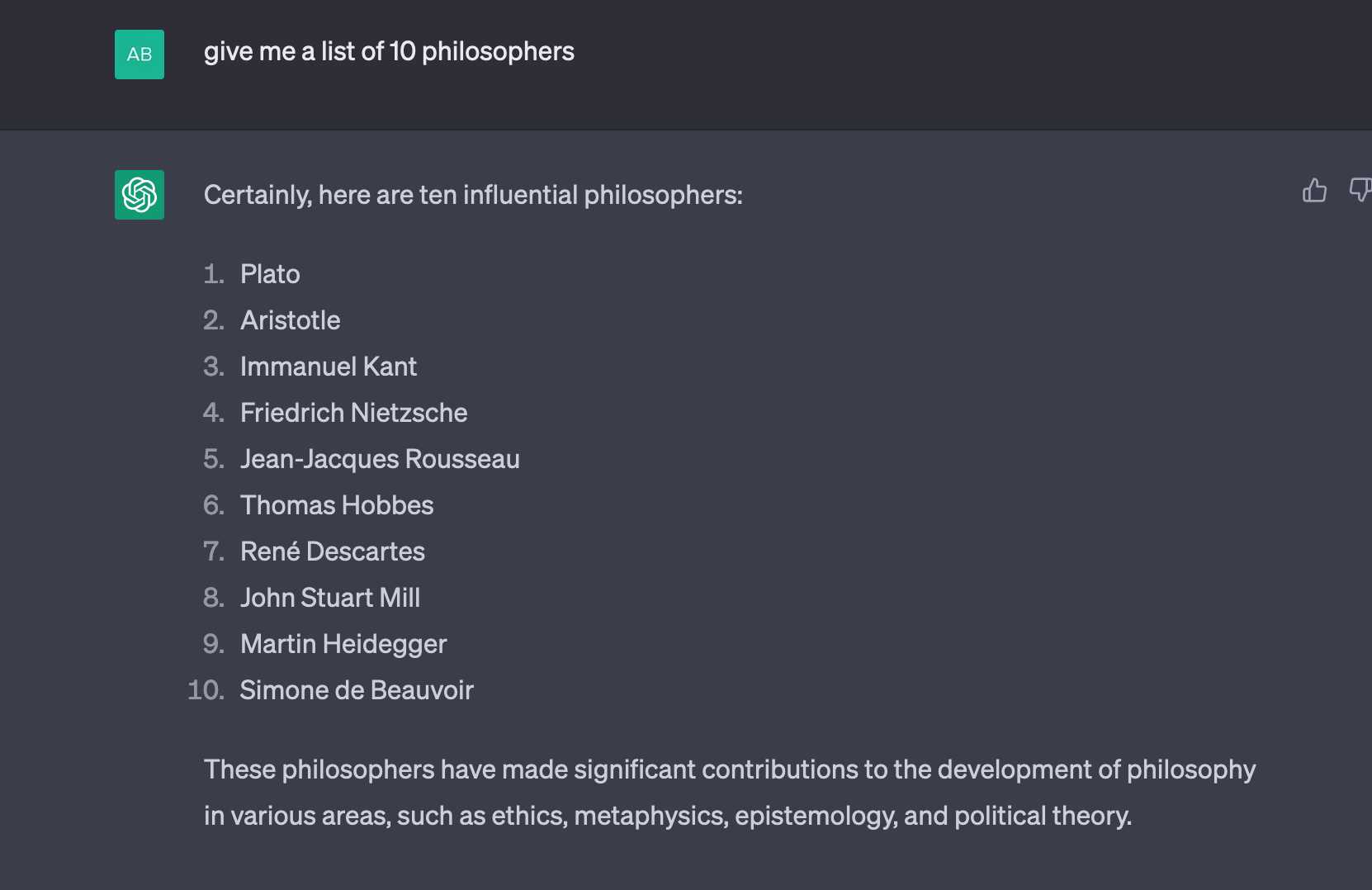

🖼️ 关键图片

📊 实验亮点

论文通过分析“算法言语”这一高风险在线环境中的人类语言活动,揭示了LLM在理解和生成真实人类语言方面的局限性。这一案例研究有力地支持了论文的核心论点,即LLM无法完全模拟人类的语言能力。

🎯 应用场景

该研究成果可应用于指导人们更理性地看待大型语言模型的能力,避免过度依赖或误用。同时,该研究也为未来人工智能研究提供了新的方向,即更加注重语言的具身性、参与性和不稳定性,从而开发出更符合人类需求的智能系统。此外,该研究对于理解人机交互、社交媒体分析等领域也具有一定的参考价值。

📄 摘要(原文)

In this paper we argue that key, often sensational and misleading, claims regarding linguistic capabilities of Large Language Models (LLMs) are based on at least two unfounded assumptions; the assumption of language completeness and the assumption of data completeness. Language completeness assumes that a distinct and complete thing such as

a natural language' exists, the essential characteristics of which can be effectively and comprehensively modelled by an LLM. The assumption of data completeness relies on the belief that a language can be quantified and wholly captured by data. Work within the enactive approach to cognitive science makes clear that, rather than a distinct and complete thing, language is a means or way of acting. Languaging is not the kind of thing that can admit of a complete or comprehensive modelling. From an enactive perspective we identify three key characteristics of enacted language; embodiment, participation, and precariousness, that are absent in LLMs, and likely incompatible in principle with current architectures. We argue that these absences imply that LLMs are not now and cannot in their present form be linguistic agents the way humans are. We illustrate the point in particular through the phenomenon ofalgospeak', a recently described pattern of high stakes human language activity in heavily controlled online environments. On the basis of these points, we conclude that sensational and misleading claims about LLM agency and capabilities emerge from a deep misconception of both what human language is and what LLMs are.