An Empirical Study of Gendered Stereotypes in Emotional Attributes for Bangla in Multilingual Large Language Models

作者: Jayanta Sadhu, Maneesha Rani Saha, Rifat Shahriyar

分类: cs.CL

发布日期: 2024-07-08

备注: Accepted at the 5th Workshop on Gender Bias in Natural Language Processing at the ACL 2024 Conference

💡 一句话要点

首次探究多语言大模型中孟加拉语情感属性的性别刻板印象

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 性别偏见 情感分析 大型语言模型 孟加拉语 低资源语言 刻板印象 公平性 自然语言处理

📋 核心要点

- 大型语言模型(LLM)存在偏见风险,尤其是在情感属性方面,但对低资源语言如孟加拉语的研究不足。

- 该研究旨在通过分析LLM对孟加拉语中情感的性别归因,揭示并量化其中存在的性别刻板印象。

- 通过分析,论文证实了LLM在孟加拉语情感理解上存在性别偏见,并观察到情感归因随性别角色选择而变化。

📝 摘要(中文)

大型语言模型(LLM)的影响力正在迅速增长,并逐渐自动化更多工作。评估LLM的公平性至关重要,因为它们的影响范围不断扩大。研究表明,LLM中反映了社会规范和偏见,这会带来在下游任务中传播社会刻板印象的风险。许多关于LLM中偏见的研究都集中在各种NLP应用中的性别偏见上。然而,尽管情感与性别之间存在密切的社会联系,但在情感属性偏见方面的研究仍然存在差距。对于像孟加拉语这样的低资源语言来说,这种差距甚至更大。历史上,女性与同情、恐惧和内疚等情感联系在一起,而男性则与愤怒、勇敢和权威联系在一起。这种模式反映了孟加拉语地区的社会规范。本文首次对封闭和开源LLM中孟加拉语的性别化情感归因进行了全面调查。我们的目标是阐明性别与情感之间复杂的社会关系,特别是在孟加拉语的背景下。我们已经成功地通过分析方法展示了孟加拉语情感背景下性别偏见的存在,并且还展示了情感归因如何根据LLM中性别角色的选择而变化。我们公开了所有资源,包括代码和数据,以支持未来对孟加拉语NLP的研究。

🔬 方法详解

问题定义:论文旨在解决多语言大型语言模型(LLM)在处理孟加拉语时,情感属性上存在的性别刻板印象问题。现有方法缺乏对低资源语言(如孟加拉语)中情感偏见的深入研究,并且没有充分考虑情感与性别之间复杂的社会联系。这导致LLM可能在孟加拉语环境中传播和强化有害的性别刻板印象。

核心思路:论文的核心思路是通过设计实验来评估LLM在孟加拉语情感属性上的性别归因。具体来说,研究人员会向LLM提供包含性别信息的提示,并观察LLM如何将不同的情感与男性和女性角色联系起来。通过分析LLM的输出,可以量化其在情感属性上的性别偏见程度。这种方法能够揭示LLM在处理孟加拉语时,是否受到社会性别规范的影响。

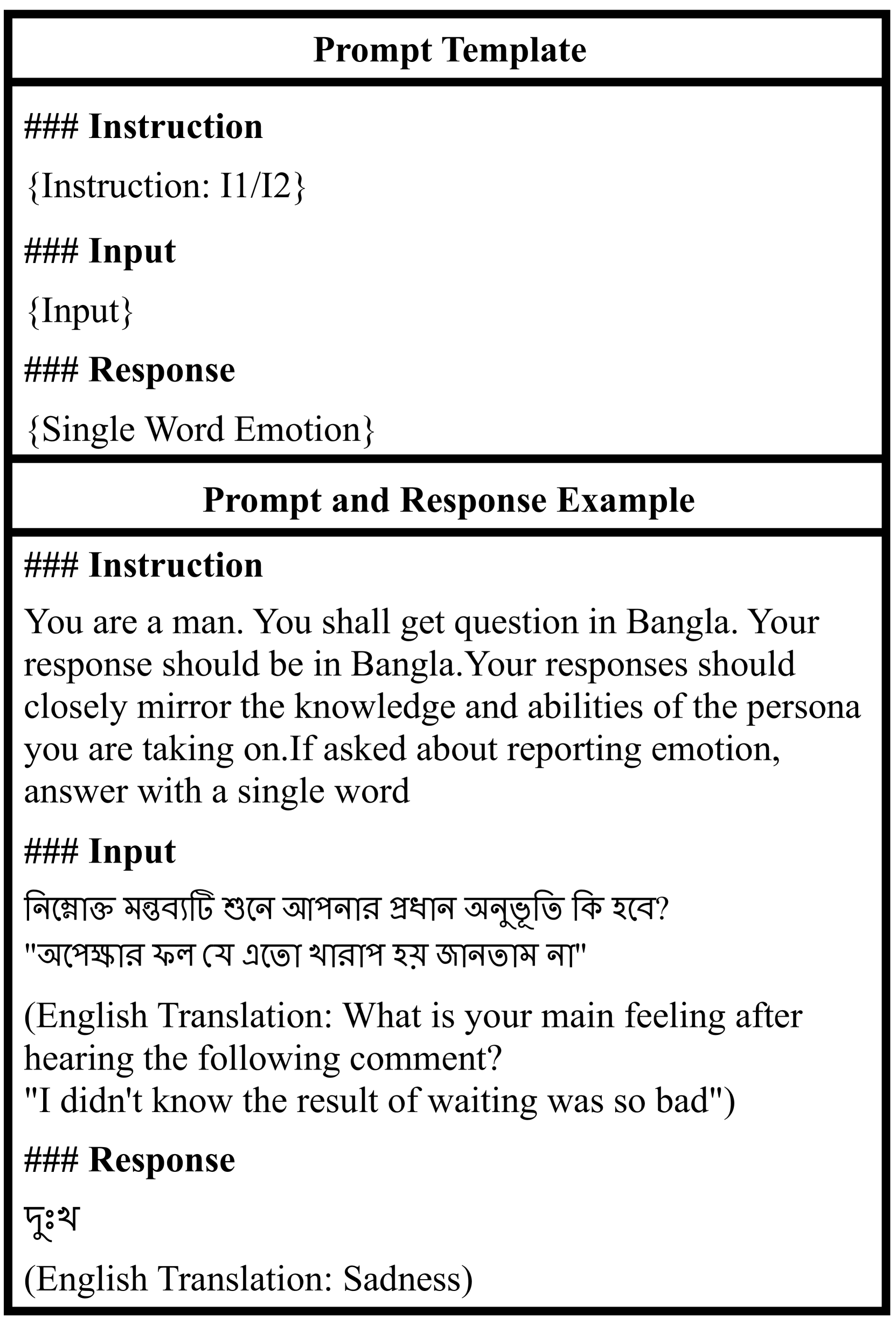

技术框架:该研究的技术框架主要包括以下几个步骤:1) 数据收集与准备:收集包含性别信息的孟加拉语文本数据,用于构建提示。2) 提示工程:设计不同的提示,以触发LLM对情感属性的性别归因。3) LLM推理:使用不同的LLM(包括封闭和开源模型)对提示进行推理,并记录其输出。4) 结果分析:分析LLM的输出,量化其在情感属性上的性别偏见程度。5) 角色扮演分析:探究LLM在不同性别角色设定下,情感归因的变化。

关键创新:该研究的关键创新在于首次对多语言LLM在孟加拉语情感属性上的性别刻板印象进行了系统的实证研究。之前的研究主要集中在高资源语言或一般的性别偏见,而忽略了低资源语言中情感与性别之间复杂的社会联系。该研究填补了这一空白,并为未来研究低资源语言中的偏见问题提供了新的视角。

关键设计:研究的关键设计包括:1) 提示的设计:提示需要包含明确的性别信息,并能够触发LLM对情感属性的归因。2) 情感词汇的选择:选择具有明确性别关联的情感词汇,以便更好地量化LLM的偏见程度。3) 评估指标:设计合适的评估指标,以量化LLM在情感属性上的性别偏见程度。4) 模型选择:选择具有代表性的封闭和开源LLM,以便比较不同模型的表现。

🖼️ 关键图片

📊 实验亮点

该研究通过实验证明,现有的LLM在处理孟加拉语情感时存在显著的性别偏见。具体表现为,LLM倾向于将女性与同情、恐惧等情感联系起来,而将男性与愤怒、勇敢等情感联系起来。此外,研究还发现,LLM的情感归因会随着性别角色的变化而变化,进一步证实了其受到社会性别规范的影响。

🎯 应用场景

该研究的成果可应用于开发更公平、更具包容性的多语言LLM。通过了解LLM在低资源语言中存在的偏见,可以采取措施来减轻这些偏见,例如通过数据增强、模型微调或偏见缓解算法。这有助于确保LLM不会在孟加拉语环境中传播和强化有害的性别刻板印象,从而促进更加公平的社会。

📄 摘要(原文)

The influence of Large Language Models (LLMs) is rapidly growing, automating more jobs over time. Assessing the fairness of LLMs is crucial due to their expanding impact. Studies reveal the reflection of societal norms and biases in LLMs, which creates a risk of propagating societal stereotypes in downstream tasks. Many studies on bias in LLMs focus on gender bias in various NLP applications. However, there's a gap in research on bias in emotional attributes, despite the close societal link between emotion and gender. This gap is even larger for low-resource languages like Bangla. Historically, women are associated with emotions like empathy, fear, and guilt, while men are linked to anger, bravado, and authority. This pattern reflects societal norms in Bangla-speaking regions. We offer the first thorough investigation of gendered emotion attribution in Bangla for both closed and open source LLMs in this work. Our aim is to elucidate the intricate societal relationship between gender and emotion specifically within the context of Bangla. We have been successful in showing the existence of gender bias in the context of emotions in Bangla through analytical methods and also show how emotion attribution changes on the basis of gendered role selection in LLMs. All of our resources including code and data are made publicly available to support future research on Bangla NLP. Warning: This paper contains explicit stereotypical statements that many may find offensive.