LLaMAX: Scaling Linguistic Horizons of LLM by Enhancing Translation Capabilities Beyond 100 Languages

作者: Yinquan Lu, Wenhao Zhu, Lei Li, Yu Qiao, Fei Yuan

分类: cs.CL, cs.AI

发布日期: 2024-07-08 (更新: 2024-10-12)

备注: EMNLP 2024 findings

🔗 代码/项目: GITHUB | HUGGINGFACE

💡 一句话要点

LLaMAX:通过增强百余种语言的翻译能力,扩展LLM的语言边界

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 机器翻译 多语言学习 低资源语言 持续预训练

📋 核心要点

- 现有LLM在低资源语言翻译中表现不足,主要原因是预训练数据中多语言数据匮乏。

- 通过对LLaMA模型进行多语言持续预训练,并结合词汇扩展和数据增强策略,提升翻译能力。

- LLaMAX在翻译性能上显著优于现有开源LLM,并在Flores-101上与专用翻译模型性能相当。

📝 摘要(中文)

大型语言模型(LLM)在高资源语言的翻译任务中表现出卓越的能力,但由于预训练期间多语言数据不足,它们在低资源语言中的性能受到限制。为了解决这个问题,我们对LLaMA系列模型进行了广泛的多语言持续预训练,从而支持超过100种语言的翻译。通过对词汇扩展和数据增强等训练策略的全面分析,我们开发了LLaMAX。值得注意的是,在不牺牲其泛化能力的情况下,LLaMAX实现了比现有开源LLM显著更高的翻译性能(超过10个spBLEU点),并且在Flores-101基准测试中与专门的翻译模型(M2M-100-12B)的性能相当。大量的实验表明,LLaMAX可以作为一个强大的多语言基础模型。代码和模型已公开发布。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在低资源语言翻译任务中表现不佳的问题。现有LLM虽然在高资源语言翻译上表现出色,但由于预训练数据中低资源语言数据不足,导致其在这些语言上的翻译能力受到限制。这阻碍了LLM在更广泛的多语言场景中的应用。

核心思路:论文的核心思路是通过多语言持续预训练来增强LLM的翻译能力,特别是针对低资源语言。通过在LLaMA系列模型上进行持续预训练,并结合词汇扩展和数据增强等策略,使模型能够学习到更多语言的知识,从而提高翻译性能。这种方法旨在弥补现有LLM在多语言数据方面的不足。

技术框架:LLaMAX的整体框架基于LLaMA系列模型,并在此基础上进行多语言持续预训练。主要包含以下几个阶段:1) 选择合适的LLaMA模型作为基础模型。2) 构建包含100多种语言的大规模多语言数据集。3) 进行词汇扩展,将新的语言token添加到模型的词汇表中。4) 应用数据增强技术,增加训练数据的多样性。5) 使用多语言数据对模型进行持续预训练。6) 在翻译基准测试上评估模型性能。

关键创新:论文的关键创新在于通过多语言持续预训练,显著提升了LLM在低资源语言翻译方面的性能,同时保持了模型的泛化能力。此外,论文还对词汇扩展和数据增强等训练策略进行了深入分析,为多语言LLM的训练提供了有价值的经验。与现有方法相比,LLaMAX更侧重于通过持续预训练来增强模型的语言能力,而不是仅仅依赖于微调。

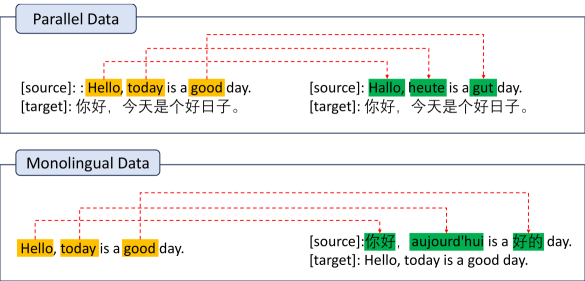

关键设计:论文的关键设计包括:1) 词汇扩展策略,如何有效地将新的语言token添加到模型的词汇表中,并避免对现有token的影响。2) 数据增强策略,如何生成更多样化的多语言训练数据,例如通过回译等方法。3) 损失函数的设计,如何平衡不同语言之间的训练损失,避免高资源语言对低资源语言的影响。4) 训练数据的选择,如何选择具有代表性的多语言数据,以提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

LLaMAX在Flores-101基准测试中取得了显著的成果,翻译性能超越了现有开源LLM超过10个spBLEU点,并与专门的翻译模型M2M-100-12B的性能相当。这些结果表明,通过多语言持续预训练,可以有效地提升LLM在低资源语言翻译方面的性能,使其能够更好地服务于多语言应用。

🎯 应用场景

LLaMAX具有广泛的应用前景,可用于机器翻译、跨语言信息检索、多语言对话系统等领域。它能够帮助人们跨越语言障碍,促进不同文化之间的交流与合作。此外,LLaMAX还可以应用于低资源语言的保护和发展,为这些语言提供更好的技术支持。未来,LLaMAX有望成为一个强大的多语言基础模型,为各种多语言应用提供支持。

📄 摘要(原文)

Large Language Models (LLMs) demonstrate remarkable translation capabilities in high-resource language tasks, yet their performance in low-resource languages is hindered by insufficient multilingual data during pre-training. To address this, we conduct extensive multilingual continual pre-training on the LLaMA series models, enabling translation support across more than 100 languages. Through a comprehensive analysis of training strategies, such as vocabulary expansion and data augmentation, we develop LLaMAX. Remarkably, without sacrificing its generalization ability, LLaMAX achieves significantly higher translation performance compared to existing open-source LLMs (by more than 10 spBLEU points) and performs on-par with specialized translation model (M2M-100-12B) on the Flores-101 benchmark. Extensive experiments indicate that LLaMAX can serve as a robust multilingual foundation model. The code \footnote{\url{https://github.com/CONE-MT/LLaMAX/.}} and the models \footnote{\url{https://huggingface.co/LLaMAX/.}} are publicly available.