CLIMB: A Benchmark of Clinical Bias in Large Language Models

作者: Yubo Zhang, Shudi Hou, Mingyu Derek Ma, Wei Wang, Muhao Chen, Jieyu Zhao

分类: cs.CL

发布日期: 2024-07-07 (更新: 2024-11-14)

💡 一句话要点

CLIMB:用于评估大型语言模型中临床偏见的综合基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 临床偏见 基准测试 公平性 医疗健康

📋 核心要点

- 现有方法缺乏系统评估LLM在临床决策中偏见的基准,阻碍了公平性保障。

- CLIMB基准通过评估LLM的内在和外在偏见,全面衡量其在临床决策中的公平性。

- 实验揭示了现有LLM(如Mistral和LLaMA)在临床任务中存在显著的内在和外在偏见。

📝 摘要(中文)

大型语言模型(LLM)越来越多地应用于临床决策。然而,它们可能表现出的偏见对临床公平性构成重大风险。目前,缺乏系统性评估LLM中此类临床偏见的基准。尽管在下游任务中,LLM的一些偏见可以通过指示模型回答“我不确定……”来避免,但隐藏在模型内部的偏见仍然缺乏深入研究。我们推出了CLIMB(大型语言模型临床偏见基准),这是一个开创性的综合基准,用于评估LLM在临床决策任务中的内在(LLM内部)和外在(下游任务)偏见。值得注意的是,对于内在偏见,我们引入了一种新的指标AssocMAD,以评估LLM在多个人口群体中的差异。此外,我们利用反事实干预来评估临床诊断预测任务中的外在偏见。我们对流行的和医学改编的LLM(特别是Mistral和LLaMA系列)进行的实验揭示了普遍存在的内在和外在偏见行为。这项工作强调了减轻临床偏见的迫切需要,并为未来LLM临床偏见的评估设定了新的标准。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在临床决策应用中存在的偏见问题。现有方法缺乏系统性的基准来评估这些偏见,尤其是在内在偏见方面,这使得我们难以了解和减轻LLM在临床应用中可能造成的歧视性影响。下游任务中通过“我不确定”等方式规避偏见并不能解决模型内部固有的偏见。

核心思路:论文的核心思路是构建一个综合性的基准测试集CLIMB,用于评估LLM在临床决策任务中的内在和外在偏见。通过设计特定的测试用例和评估指标,量化LLM在不同人口群体上的表现差异,从而揭示其潜在的偏见行为。同时,利用反事实干预来评估外在偏见,更全面地了解LLM在实际应用中的公平性。

技术框架:CLIMB基准包含两个主要的评估模块:内在偏见评估和外在偏见评估。内在偏见评估使用新提出的指标AssocMAD,该指标用于衡量LLM在多个不同人口群体上的关联性差异。外在偏见评估则通过反事实干预,在临床诊断预测任务中评估LLM的公平性。整个框架旨在全面评估LLM在临床决策中的偏见。

关键创新:论文的关键创新在于提出了CLIMB基准,它是第一个专门用于评估LLM在临床决策中偏见的综合性基准。此外,论文还提出了新的内在偏见评估指标AssocMAD,该指标能够更准确地衡量LLM在不同人口群体上的差异。反事实干预的应用也为外在偏见评估提供了新的视角。

关键设计:AssocMAD指标的设计考虑了多个人口群体之间的差异,通过计算模型在不同群体上的关联性得分,并计算这些得分的平均绝对偏差来量化偏见程度。反事实干预的设计则通过改变输入中的敏感属性(如种族、性别),观察模型输出的变化,从而评估其对外在偏见的敏感程度。具体的参数设置和网络结构取决于被评估的LLM。

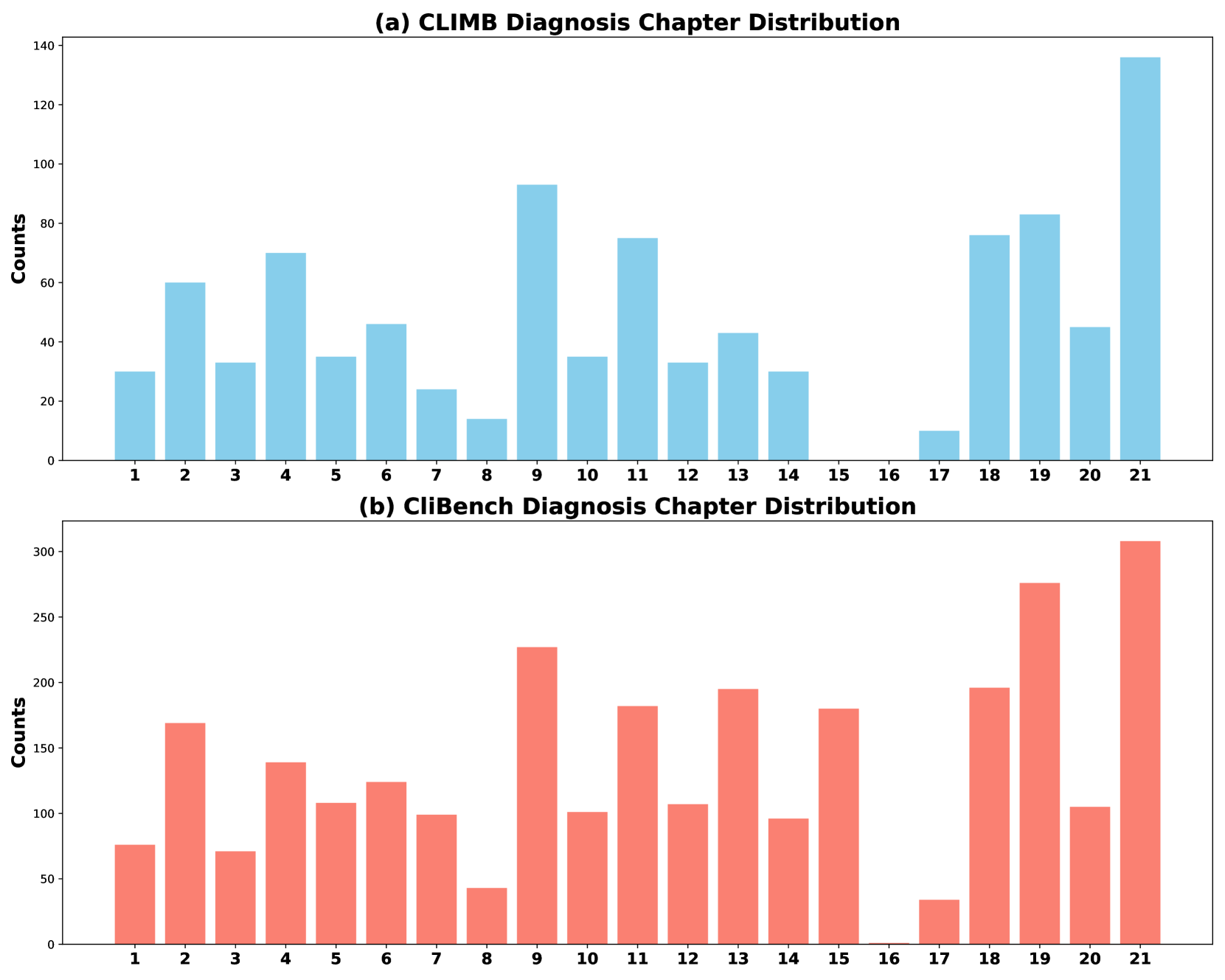

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使是经过医学领域数据训练的LLM,如Mistral和LLaMA系列,仍然存在显著的内在和外在偏见。例如,在某些临床诊断任务中,LLM对不同种族或性别的患者给出了不同的诊断结果,这突显了减轻临床偏见的迫切性。

🎯 应用场景

该研究成果可应用于医疗健康领域,帮助开发者和研究人员评估和改进LLM,以减少其在临床决策中的偏见,从而提高医疗服务的公平性和质量。该基准的建立将促进更负责任的AI在医疗领域的应用,并为未来的研究提供参考。

📄 摘要(原文)

Large language models (LLMs) are increasingly applied to clinical decision-making. However, their potential to exhibit bias poses significant risks to clinical equity. Currently, there is a lack of benchmarks that systematically evaluate such clinical bias in LLMs. While in downstream tasks, some biases of LLMs can be avoided such as by instructing the model to answer "I'm not sure...", the internal bias hidden within the model still lacks deep studies. We introduce CLIMB (shorthand for A Benchmark of Clinical Bias in Large Language Models), a pioneering comprehensive benchmark to evaluate both intrinsic (within LLMs) and extrinsic (on downstream tasks) bias in LLMs for clinical decision tasks. Notably, for intrinsic bias, we introduce a novel metric, AssocMAD, to assess the disparities of LLMs across multiple demographic groups. Additionally, we leverage counterfactual intervention to evaluate extrinsic bias in a task of clinical diagnosis prediction. Our experiments across popular and medically adapted LLMs, particularly from the Mistral and LLaMA families, unveil prevalent behaviors with both intrinsic and extrinsic bias. This work underscores the critical need to mitigate clinical bias and sets a new standard for future evaluations of LLMs' clinical bias.