Question Answering with Texts and Tables through Deep Reinforcement Learning

作者: Marcos M. José, Flávio N. Cação, Maria F. Ribeiro, Rafael M. Cheang, Paulo Pirozelli, Fabio G. Cozman

分类: cs.CL

发布日期: 2024-07-05 (更新: 2025-02-20)

备注: Published at Brazilian Conference on Intelligent Systems (BRACIS 2024)

DOI: 10.1007/978-3-031-79032-4_24

💡 一句话要点

提出基于深度强化学习的文本表格问答系统,解决多跳推理问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 文本表格问答 多跳推理 强化学习 开放域问答 信息检索

📋 核心要点

- 现有开放域问答系统难以有效利用文本和表格中的信息进行多跳推理,导致答案准确率不高。

- 该论文提出利用强化学习,在多步推理过程中动态选择不同的模型,从而优化信息检索和答案生成。

- 实验结果表明,该系统在开放表格和文本问答数据集上取得了与现有迭代系统相当的F1分数。

📝 摘要(中文)

本文提出了一种新的架构,用于生成需要从文本和表格中获取信息的多跳开放域问题的答案。该架构使用开放表格和文本问答数据集进行验证和训练。在这种场景下,一种常见的答案生成方式是顺序检索信息,其中选择的一条数据有助于搜索下一条数据。由于不同的模型在顺序信息搜索中调用时可能具有不同的行为,因此一个挑战是如何在每个步骤选择模型。我们的架构采用强化学习来顺序选择不同的最先进工具,直到最终生成所需的答案。该系统实现了19.03的F1分数,与文献中的迭代系统相当。

🔬 方法详解

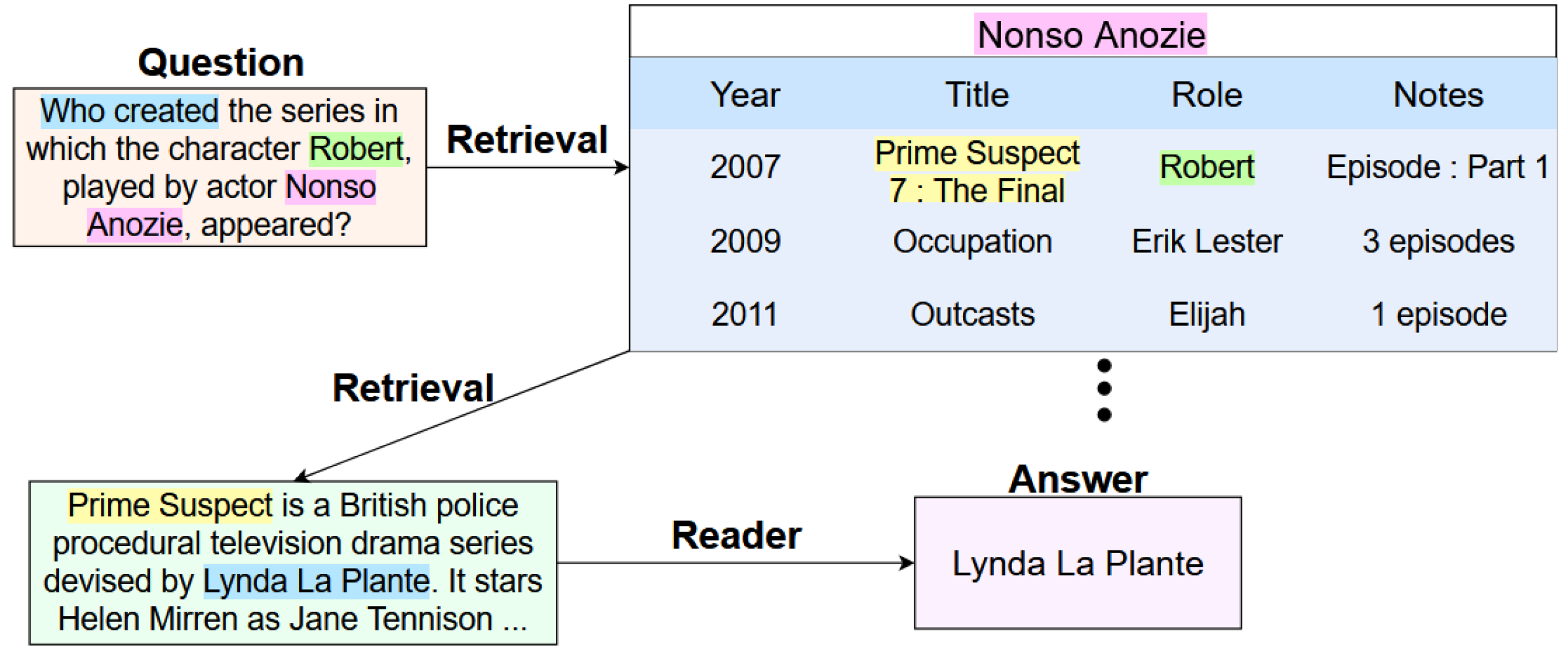

问题定义:论文旨在解决开放域下,需要同时从文本和表格中提取信息进行多跳推理的问答问题。现有方法在处理此类问题时,难以有效地整合不同来源的信息,并且在多步推理过程中容易出现误差累积,导致最终答案的准确性较低。

核心思路:论文的核心思路是利用强化学习来动态地选择不同的模型,以执行多步推理。通过强化学习,系统可以学习到在每个推理步骤中选择哪个模型能够最大化最终答案的准确性。这种方法能够有效地整合不同来源的信息,并且能够减少多步推理过程中的误差累积。

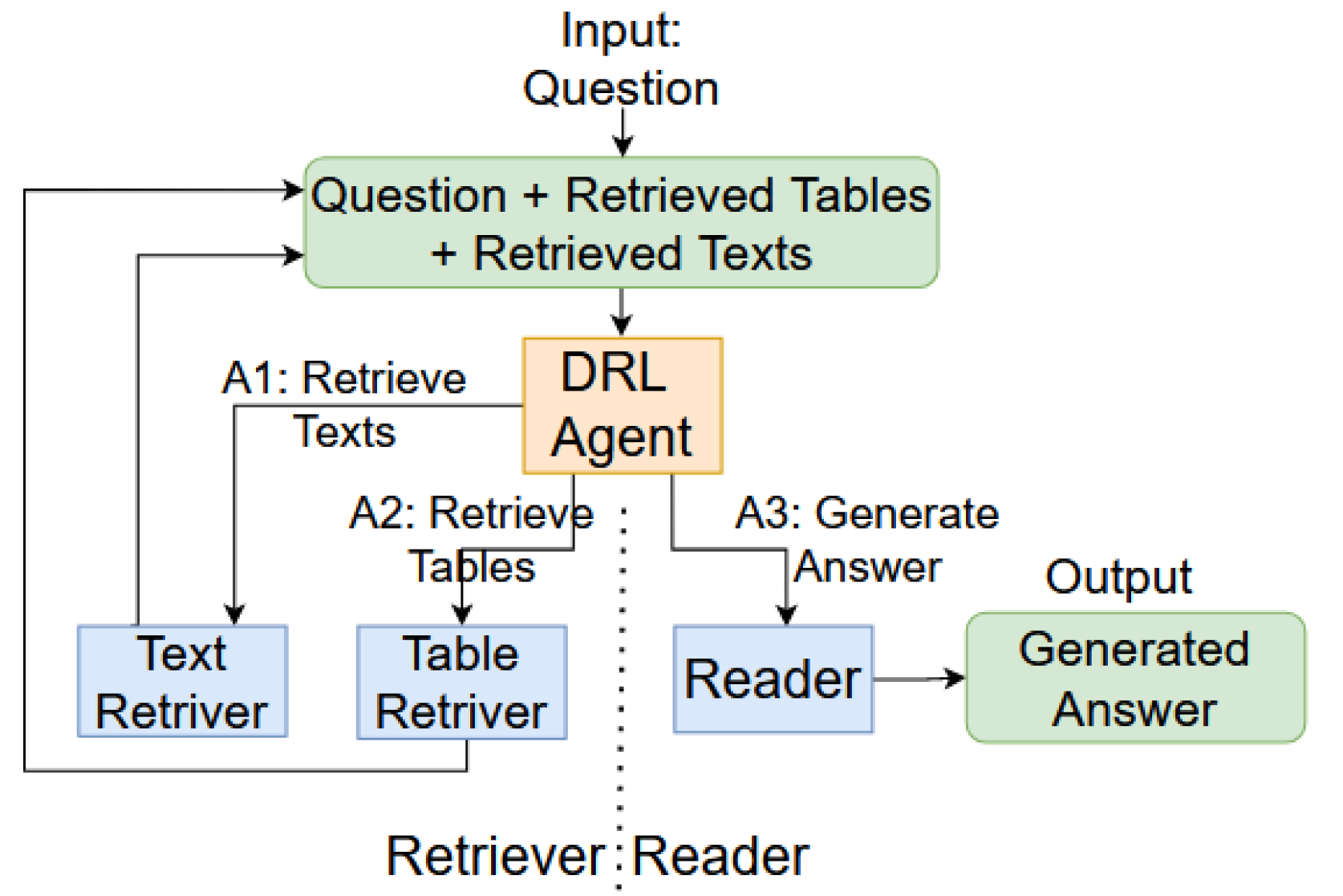

技术框架:整体架构包含一个强化学习智能体,该智能体负责在每个推理步骤中选择一个模型。可选的模型包括文本检索模型、表格检索模型、答案生成模型等。智能体根据当前的状态(包括问题、已检索到的信息等)选择一个模型,然后执行该模型,并将结果作为新的状态输入到智能体中。这个过程重复进行,直到生成最终答案。

关键创新:该论文的关键创新在于使用强化学习来动态地选择不同的模型。与传统的静态模型选择方法相比,这种方法能够更好地适应不同的问题和不同的推理步骤,从而提高答案的准确性。

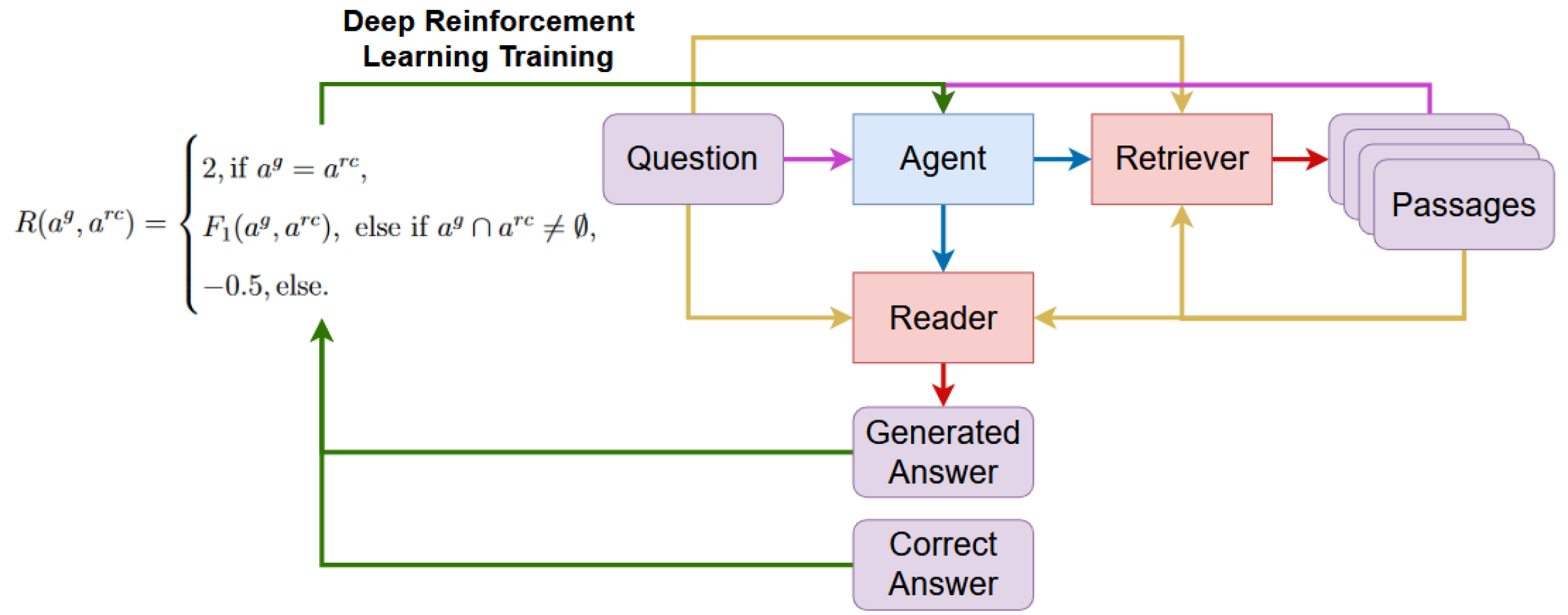

关键设计:强化学习智能体使用Q-learning算法进行训练。状态空间包括问题、已检索到的信息等。动作空间包括可选的模型。奖励函数根据最终答案的准确性进行设计。具体而言,如果生成的答案与正确答案匹配,则奖励为1,否则奖励为0。此外,论文还使用了经验回放和目标网络等技术来提高强化学习的训练效果。

🖼️ 关键图片

📊 实验亮点

该系统在Open Table-and-Text Question Answering数据集上取得了19.03的F1分数,与现有的迭代系统性能相当。这一结果表明,使用强化学习来动态选择模型是一种有效的方法,可以提高多跳问答系统的性能。虽然F1分数不高,但证明了强化学习在该任务上的潜力。

🎯 应用场景

该研究成果可应用于智能客服、知识图谱问答、金融分析等领域。通过整合文本和表格中的信息,可以更准确地回答用户提出的复杂问题,提高用户满意度和工作效率。未来,该技术有望在更多领域得到应用,例如医疗诊断、法律咨询等。

📄 摘要(原文)

This paper proposes a novel architecture to generate multi-hop answers to open domain questions that require information from texts and tables, using the Open Table-and-Text Question Answering dataset for validation and training. One of the most common ways to generate answers in this setting is to retrieve information sequentially, where a selected piece of data helps searching for the next piece. As different models can have distinct behaviors when called in this sequential information search, a challenge is how to select models at each step. Our architecture employs reinforcement learning to choose between different state-of-the-art tools sequentially until, in the end, a desired answer is generated. This system achieved an F1-score of 19.03, comparable to iterative systems in the literature.