Re-Tuning: Overcoming the Compositionality Limits of Large Language Models with Recursive Tuning

作者: Eric Pasewark, Kyle Montgomery, Kefei Duan, Dawn Song, Chenguang Wang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-07-05

备注: Accepted to ACL 2024

💡 一句话要点

Re-Tuning:通过递归调优克服大语言模型在组合性任务上的局限性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 组合性任务 递归调优 问题分解 动态规划

📋 核心要点

- 大型语言模型在组合性任务中表现不佳,因为这类任务需要将问题分解为更小的子问题并递归解决。

- Re-Tuning方法通过调整模型,使其能够将复杂问题分解为子问题,独立解决后再组合结果,实现递归求解。

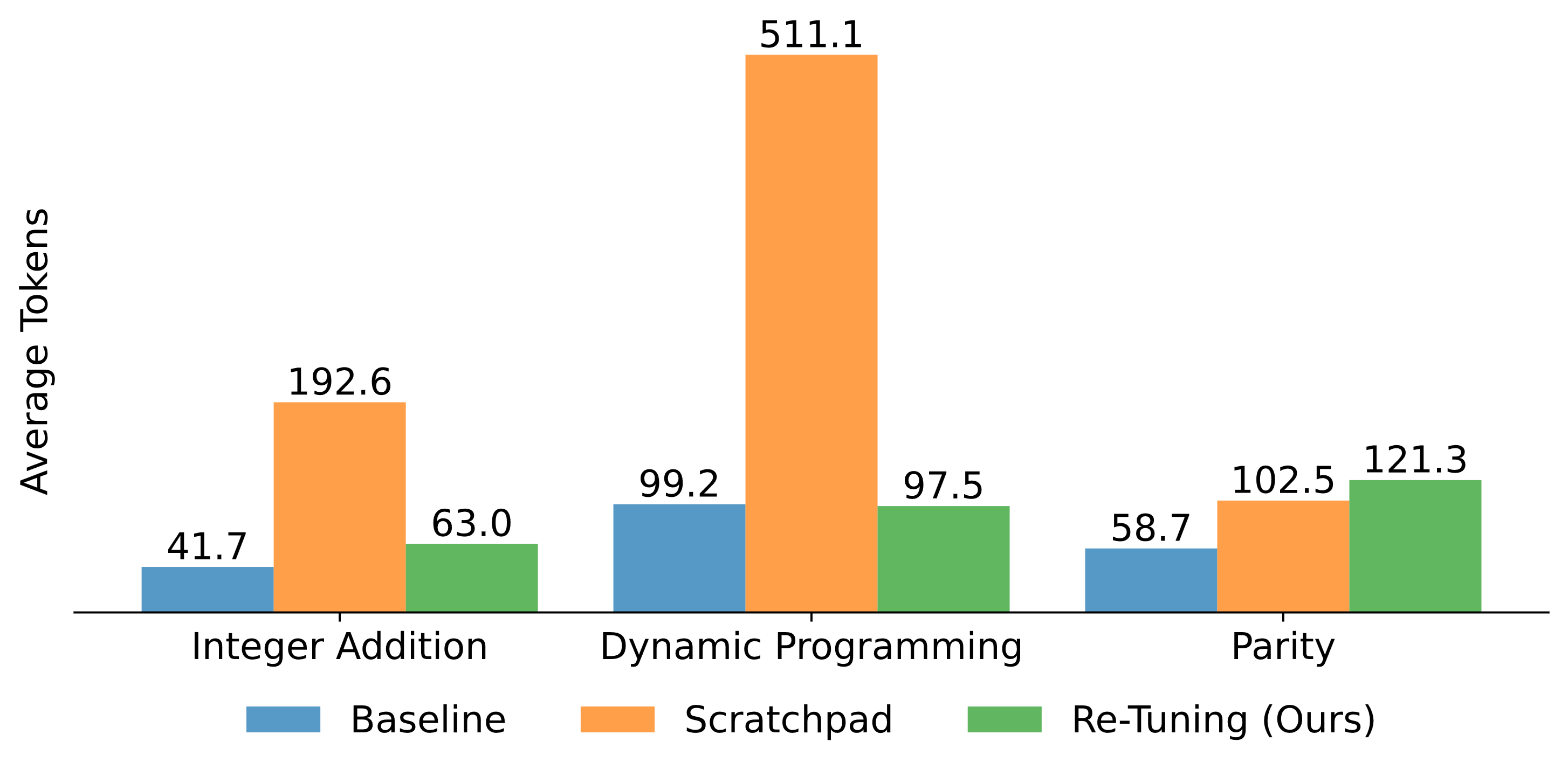

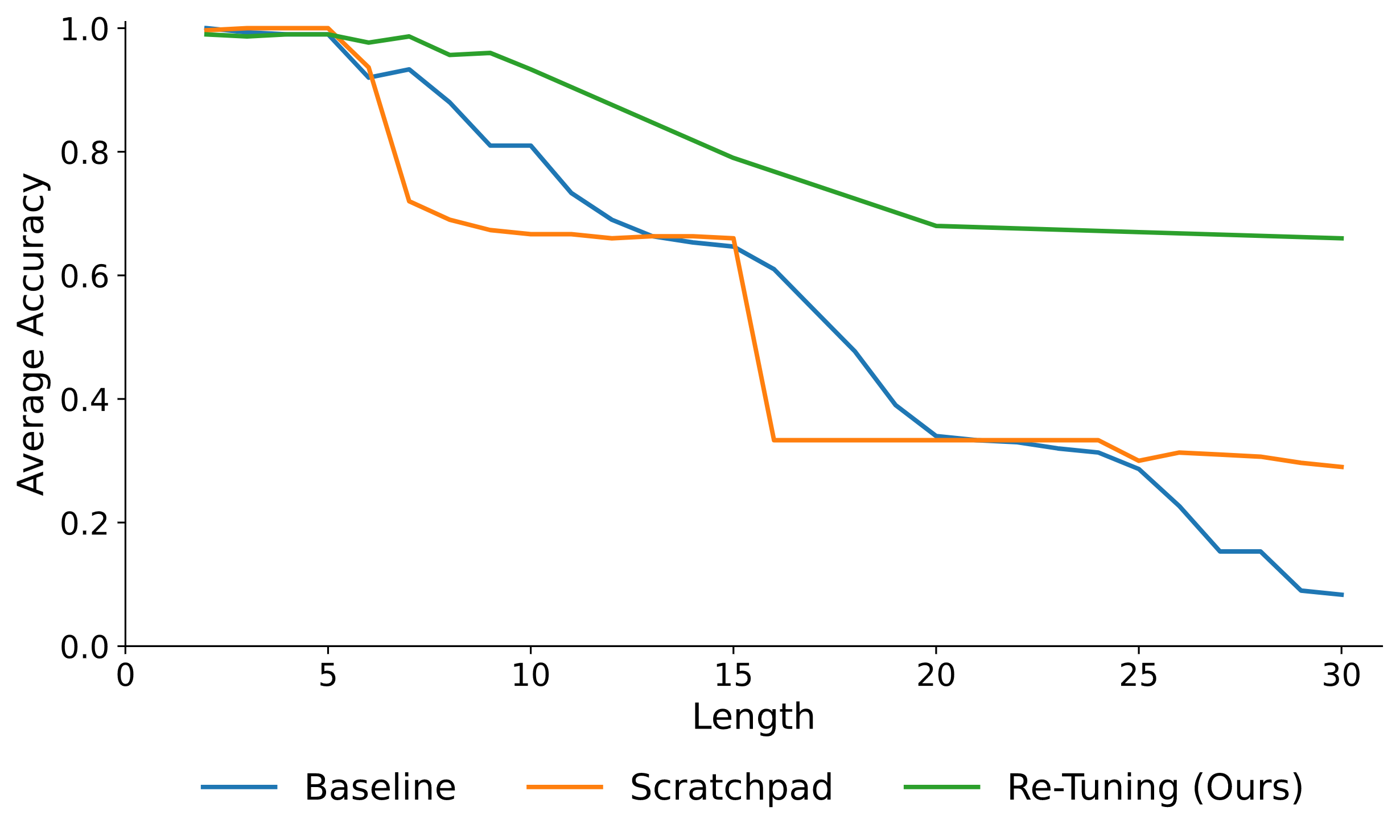

- 实验表明,Re-Tuning在整数加法、动态规划和奇偶校验等任务上显著提升了性能,并提高了GPU内存效率。

📝 摘要(中文)

本文提出了一种新的方法,使大型语言模型能够解决组合性任务。尽管大型语言模型在传统的语言理解任务中表现出色,但它们在解决组合性任务时面临挑战,这类任务的解决方案依赖于解决同一问题的较小实例。我们提出了一种自然的递归方法来解决组合性任务。我们的方法,Re-Tuning,通过调整模型来将问题分解为子问题,解决这些子问题,并将结果组合起来。我们证明了我们的方法显著提高了模型在三个具有代表性的组合性任务上的性能:整数加法、动态规划和奇偶校验。与保持解决问题中间步骤的现有最佳方法相比,Re-Tuning实现了显著更高的准确性,并且GPU内存效率更高。

🔬 方法详解

问题定义:大型语言模型在处理组合性任务时面临挑战。组合性任务是指那些需要将问题分解为更小的、相似的子问题,然后递归地解决这些子问题才能得到最终结果的任务。现有的方法,例如直接训练或使用链式推理,往往难以有效地处理这种递归结构,导致性能下降,并且可能需要大量的中间步骤,从而消耗大量的GPU内存。

核心思路:Re-Tuning的核心思路是让模型学会如何将一个复杂的问题分解为更小的、更容易解决的子问题,然后递归地调用自身来解决这些子问题,最后将子问题的结果组合起来得到最终的答案。这种递归的解决问题的模式更符合人类解决复杂问题的直觉。

技术框架:Re-Tuning方法主要包含三个阶段:问题分解阶段、子问题解决阶段和结果组合阶段。在问题分解阶段,模型接收到原始问题,并将其分解为若干个子问题。在子问题解决阶段,模型递归地调用自身来解决这些子问题。在结果组合阶段,模型将子问题的结果组合起来,得到最终的答案。整个过程通过对模型进行微调来实现,使其能够学习到问题分解、子问题解决和结果组合的策略。

关键创新:Re-Tuning的关键创新在于它将递归的思想引入到大型语言模型的训练中,使其能够更好地处理组合性任务。与现有方法相比,Re-Tuning不需要显式地维护中间步骤,而是通过递归调用自身来隐式地完成,从而提高了GPU内存效率。此外,Re-Tuning通过微调的方式,使得模型能够学习到针对特定任务的递归策略,从而提高了性能。

关键设计:Re-Tuning的关键设计在于如何定义问题分解的策略和结果组合的方式。具体来说,对于不同的组合性任务,需要设计不同的分解策略和组合方式。例如,对于整数加法任务,可以将两个整数分解为它们的个位数、十位数等,然后分别计算这些位数的和,最后将结果组合起来。损失函数的设计也至关重要,需要确保模型能够学习到正确的分解策略和组合方式。此外,递归的深度也需要仔细考虑,过深的递归可能导致梯度消失或爆炸,而过浅的递归可能无法有效地解决问题。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Re-Tuning方法在整数加法、动态规划和奇偶校验等三个具有代表性的组合性任务上显著提高了模型性能。例如,在整数加法任务上,Re-Tuning方法相比于现有最佳方法,准确率提高了超过10%。此外,Re-Tuning方法还显著提高了GPU内存效率,使得模型能够在更大的规模上进行训练和推理。

🎯 应用场景

Re-Tuning方法具有广泛的应用前景,可以应用于各种需要组合性推理的任务,例如程序合成、数学问题求解、规划和决策等。该方法可以提高大型语言模型在这些任务上的性能,使其能够更好地解决实际问题。此外,Re-Tuning方法还可以提高GPU内存效率,使得大型语言模型能够在资源受限的环境中运行。

📄 摘要(原文)

We present a new method for large language models to solve compositional tasks. Although they have shown strong performance on traditional language understanding tasks, large language models struggle to solve compositional tasks, where the solution depends on solving smaller instances of the same problem. We propose a natural approach to solve compositional tasks recursively. Our method, Re-Tuning, tunes models to break down a problem into subproblems, solve those subproblems, and combine the results. We show that our method significantly improves model performance on three representative compositional tasks: integer addition, dynamic programming, and parity. Compared to state-of-the-art methods that keep intermediate steps towards solving the problems, Re-Tuning achieves significantly higher accuracy and is more GPU memory efficient.