Truth is Universal: Robust Detection of Lies in LLMs

作者: Lennart Bürger, Fred A. Hamprecht, Boaz Nadler

分类: cs.CL, cs.AI

发布日期: 2024-07-03 (更新: 2024-10-21)

备注: NeurIPS 2024 poster

💡 一句话要点

提出基于激活向量子空间的LLM谎言检测方法,提升鲁棒性与泛化性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 谎言检测 激活向量 子空间分析 鲁棒性 泛化能力 自然语言处理

📋 核心要点

- 现有LLM谎言检测方法泛化性差,难以应对否定陈述等情况,鲁棒性不足。

- 论文提出基于激活向量的二维子空间分离真假陈述,该子空间具有跨模型通用性。

- 构建的分类器在区分真假陈述和检测真实谎言场景中达到94%的准确率,性能领先。

📝 摘要(中文)

大型语言模型(LLM)在自然语言处理领域取得了革命性进展,展现出令人印象深刻的类人能力。特别是,LLM能够“说谎”,即明知故犯地输出虚假陈述。因此,开发检测LLM何时说谎的方法具有重要意义。一些研究者训练分类器,基于LLM的内部模型激活来检测谎言。然而,其他研究表明,这些分类器可能无法泛化,例如对于否定陈述。本文旨在开发一种鲁棒的LLM谎言检测方法。为此,我们做出了以下关键贡献:(i)我们证明了一个二维子空间的存在,真假陈述的激活向量可以沿该子空间分离。值得注意的是,这一发现是通用的,适用于包括Gemma-7B、LLaMA2-13B、Mistral-7B和LLaMA3-8B在内的各种LLM。我们的分析解释了先前研究中观察到的泛化失败,并为更鲁棒的谎言检测奠定了基础;(ii)在(i)的基础上,我们构建了一个精确的LLM谎言检测器。经验表明,我们提出的分类器实现了最先进的性能,在区分真假事实陈述和检测现实场景中生成的谎言方面,均达到了94%的准确率。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)中谎言检测的鲁棒性问题。现有的基于模型内部激活的谎言检测方法,在面对否定陈述或其他复杂情况时,泛化能力较差,容易失效。这些方法往往依赖于特定模型或数据集的特征,缺乏跨模型的通用性。

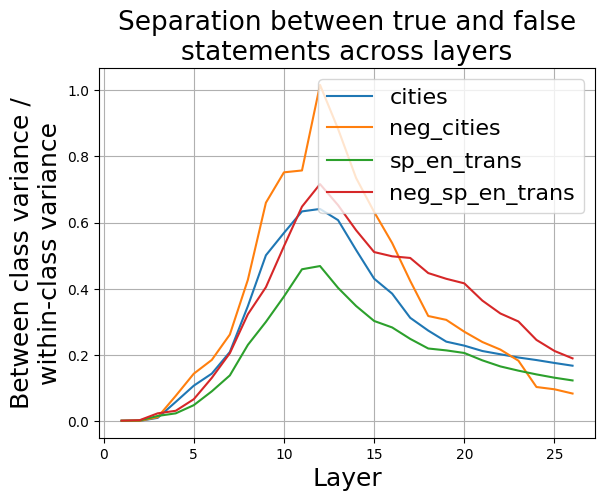

核心思路:论文的核心思路是发现并利用LLM内部激活向量中蕴含的真假信息。作者假设真假陈述在LLM的激活空间中存在可分离的结构。通过分析不同LLM的激活向量,作者发现了一个通用的二维子空间,真假陈述的激活向量在该子空间中可以被有效分离。这种基于子空间的方法具有更好的泛化能力,因为它不依赖于特定模型或数据集的细粒度特征。

技术框架:论文的技术框架主要包括以下几个步骤:1) 收集真假陈述的数据集;2) 使用不同的LLM(如Gemma-7B、LLaMA2-13B、Mistral-7B和LLaMA3-8B)处理这些陈述,并提取相应的激活向量;3) 使用主成分分析(PCA)或其他降维方法,在激活向量空间中寻找能够最大程度分离真假陈述的二维子空间;4) 基于该子空间训练一个分类器,用于区分真假陈述;5) 在不同的数据集和场景下评估分类器的性能。

关键创新:论文最重要的技术创新点在于发现了真假陈述激活向量的可分离二维子空间,并证明了该子空间在不同LLM中的通用性。这一发现解释了现有方法泛化失败的原因,并为构建更鲁棒的谎言检测器提供了理论基础。与现有方法相比,该方法不依赖于特定模型或数据集的特征,具有更好的泛化能力。

关键设计:论文的关键设计包括:1) 选择合适的LLM进行分析,以验证子空间的通用性;2) 使用PCA等降维方法寻找最优的二维子空间;3) 设计合适的分类器(例如线性分类器或支持向量机)来区分真假陈述;4) 使用不同的数据集和场景进行评估,以验证分类器的鲁棒性。具体的参数设置和损失函数选择可能需要根据实际情况进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在区分真假事实陈述和检测真实谎言场景中均达到了94%的准确率,显著优于现有方法。该方法在Gemma-7B、LLaMA2-13B、Mistral-7B和LLaMA3-8B等多个LLM上均表现出良好的性能,验证了其跨模型的通用性。

🎯 应用场景

该研究成果可应用于多个领域,包括:信息安全(检测虚假信息传播)、金融风控(识别欺诈行为)、舆情分析(评估新闻真实性)以及人机交互(提高LLM的可信度)。通过提高LLM的可靠性,可以减少其在关键决策中的误导性影响,并促进更安全、更负责任的AI应用。

📄 摘要(原文)

Large Language Models (LLMs) have revolutionised natural language processing, exhibiting impressive human-like capabilities. In particular, LLMs are capable of "lying", knowingly outputting false statements. Hence, it is of interest and importance to develop methods to detect when LLMs lie. Indeed, several authors trained classifiers to detect LLM lies based on their internal model activations. However, other researchers showed that these classifiers may fail to generalise, for example to negated statements. In this work, we aim to develop a robust method to detect when an LLM is lying. To this end, we make the following key contributions: (i) We demonstrate the existence of a two-dimensional subspace, along which the activation vectors of true and false statements can be separated. Notably, this finding is universal and holds for various LLMs, including Gemma-7B, LLaMA2-13B, Mistral-7B and LLaMA3-8B. Our analysis explains the generalisation failures observed in previous studies and sets the stage for more robust lie detection; (ii) Building upon (i), we construct an accurate LLM lie detector. Empirically, our proposed classifier achieves state-of-the-art performance, attaining 94% accuracy in both distinguishing true from false factual statements and detecting lies generated in real-world scenarios.