CogErgLLM: Exploring Large Language Model Systems Design Perspective Using Cognitive Ergonomics

作者: Azmine Toushik Wasi, Mst Rafia Islam

分类: cs.HC, cs.CL, cs.CY, cs.SI

发布日期: 2024-07-03 (更新: 2024-11-12)

备注: 10 Page, 3 Figures. Accepted in: (i) ICML'24: LLMs & Cognition Workshop (Non-archival; OpenReview: https://openreview.net/forum?id=63C9YSc77p) (ii) EMNLP'24 : NLP for Science Workshop (Archival; ACL Anthology: https://aclanthology.org/2024.nlp4science-1.22/)

期刊: Proceedings of the 1st Workshop on NLP for Science (NLP4Science), EMNLP 2024

DOI: 10.18653/v1/2024.nlp4science-1.22

💡 一句话要点

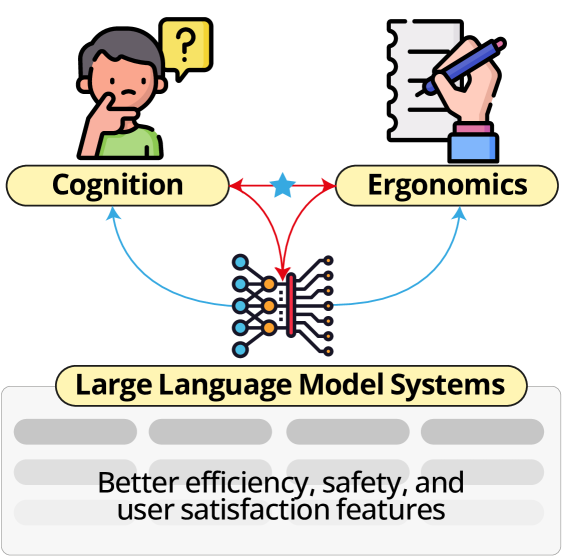

提出将认知工效学融入LLM系统设计,提升人机交互安全性与用户满意度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 认知工效学 大型语言模型 人机交互 用户体验 伦理设计

📋 核心要点

- 现有LLM设计缺乏与人类认知能力和局限性的有效整合,导致输出结果存在偏差,用户体验不佳。

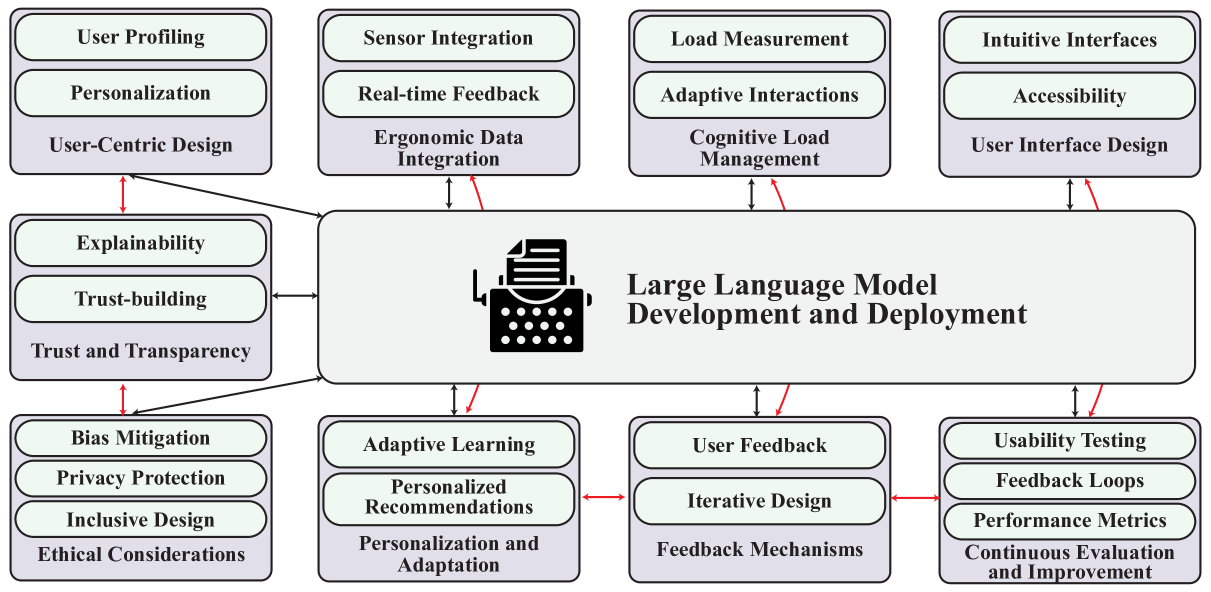

- 论文提出将认知工效学融入LLM设计,构建更安全、可靠且符合伦理道德的人机交互系统。

- 该研究旨在为LLM的伦理开发提供全面的框架和实践指导,促进用户中心的人工智能系统设计。

📝 摘要(中文)

将认知工效学与大型语言模型(LLM)相结合,对于提升人机交互的安全性、可靠性和用户满意度至关重要。当前LLM设计通常缺乏这种整合,导致系统可能无法完全符合人类的认知能力和局限性。这种疏忽加剧了LLM输出中的偏差,并由于用户中心设计原则应用的不一致而导致次优的用户体验。研究人员越来越多地利用自然语言处理(NLP),特别是LLM,来建模和理解社会科学、心理学、精神病学、健康和神经科学领域的人类行为。本立场文件探讨了将认知工效学整合到LLM设计中的必要性,为伦理开发提供了一个全面的框架和实践指南。通过应对这些挑战,我们的目标是推进更安全、更可靠和更符合伦理道德的人工智能交互。

🔬 方法详解

问题定义:当前的大型语言模型(LLM)设计在很大程度上忽略了认知工效学原则,导致人机交互体验不佳。具体表现为:LLM的输出可能存在偏差,无法充分满足用户的认知需求和限制;用户中心设计原则的应用不一致,导致用户体验的可靠性和一致性较差。现有方法缺乏对人类认知过程的深入理解,难以构建真正以人为本的LLM系统。

核心思路:论文的核心思路是将认知工效学融入到LLM的设计过程中,从系统层面考虑人类的认知能力、局限性和偏好。通过整合认知工效学原则,可以更好地理解用户需求,减少LLM输出中的偏差,并提升人机交互的安全性、可靠性和用户满意度。这种方法强调以人为中心的设计理念,旨在构建更符合人类认知习惯和行为模式的LLM系统。

技术框架:论文提出一个将认知工效学融入LLM设计的框架,但具体的技术框架细节未知。根据论文描述,该框架可能包含以下模块:1) 认知建模模块,用于模拟和理解人类的认知过程;2) 偏差检测与缓解模块,用于识别和消除LLM输出中的偏差;3) 用户体验评估模块,用于评估LLM系统的人机交互效果;4) 伦理考量模块,用于确保LLM系统的设计和应用符合伦理道德规范。

关键创新:论文的主要创新在于提出了将认知工效学与LLM设计相结合的理念。与现有方法相比,该方法更加注重以人为中心的设计,强调对人类认知过程的深入理解。通过整合认知工效学原则,可以更好地解决LLM在人机交互中存在的偏差、可靠性和用户体验等问题。

关键设计:论文是立场文件,没有提供具体的参数设置、损失函数、网络结构等技术细节。未来的研究方向可能包括:1) 设计具体的认知建模方法,用于模拟人类的认知过程;2) 开发有效的偏差检测与缓解算法,用于消除LLM输出中的偏差;3) 构建用户体验评估指标,用于评估LLM系统的人机交互效果;4) 制定伦理道德规范,用于指导LLM系统的设计和应用。

🖼️ 关键图片

📊 实验亮点

由于该论文为立场文件,并未提供具体的实验结果。其亮点在于强调了将认知工效学融入LLM设计的重要性,并提出了一个潜在的研究方向,旨在提升人机交互的安全性、可靠性和用户满意度。未来的研究可以通过实验验证该方法的有效性,并量化其在不同应用场景下的性能提升。

🎯 应用场景

该研究成果可应用于各种人机交互场景,例如智能客服、虚拟助手、教育系统、医疗诊断等。通过将认知工效学融入LLM设计,可以提升这些系统的用户体验、可靠性和安全性,并减少潜在的伦理风险。未来的研究可以进一步探索如何将认知工效学原则应用于特定领域的LLM系统,例如医疗领域的诊断辅助系统或教育领域的个性化学习系统。

📄 摘要(原文)

Integrating cognitive ergonomics with LLMs is crucial for improving safety, reliability, and user satisfaction in human-AI interactions. Current LLM designs often lack this integration, resulting in systems that may not fully align with human cognitive capabilities and limitations. This oversight exacerbates biases in LLM outputs and leads to suboptimal user experiences due to inconsistent application of user-centered design principles. Researchers are increasingly leveraging NLP, particularly LLMs, to model and understand human behavior across social sciences, psychology, psychiatry, health, and neuroscience. Our position paper explores the need to integrate cognitive ergonomics into LLM design, providing a comprehensive framework and practical guidelines for ethical development. By addressing these challenges, we aim to advance safer, more reliable, and ethically sound human-AI interactions.