LANE: Logic Alignment of Non-tuning Large Language Models and Online Recommendation Systems for Explainable Reason Generation

作者: Hongke Zhao, Songming Zheng, Likang Wu, Bowen Yu, Jing Wang

分类: cs.IR, cs.CL, cs.LG

发布日期: 2024-07-03

💡 一句话要点

LANE:无需调优,对齐大语言模型与在线推荐系统,实现可解释推理生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推荐系统 可解释性 大型语言模型 零样本学习 思维链 语义对齐 在线推荐

📋 核心要点

- 现有推荐系统缺乏可解释性,而微调大型语言模型成本高昂且难以与现有系统对齐。

- LANE通过语义嵌入、零样本提示和思维链等技术,在不微调LLM的情况下实现与推荐系统的对齐。

- 实验表明,LANE不仅保证了推荐性能,还提供了易于理解且合理的推荐逻辑。

📝 摘要(中文)

推荐系统的可解释性对于提升用户信任度和满意度至关重要。利用大型语言模型(LLM)为全面的推荐逻辑生成提供了新的机会。然而,在现有的相关研究中,为推荐任务微调LLM模型会产生高昂的计算成本,并且存在与现有系统对齐的问题,限制了经过验证的专有/闭源LLM模型(如GPT-4)的应用潜力。本文提出了一种有效的策略LANE,无需额外的LLM调优即可将LLM与在线推荐系统对齐,从而降低成本并提高可解释性。这种创新方法解决了将语言模型与推荐系统集成过程中的关键挑战,同时充分利用了强大的专有模型的能力。具体来说,我们的策略通过几个关键组件运行:语义嵌入、使用零样本提示的用户多偏好提取、语义对齐以及使用思维链(CoT)提示的可解释推荐生成。通过嵌入项目标题而不是ID,并利用多头注意力机制,我们的方法将用户偏好的语义特征与候选项目的语义特征对齐,确保连贯且用户对齐的推荐。包括性能比较、问卷投票和可视化案例在内的充分实验结果证明,我们的方法不仅可以确保推荐性能,还可以提供易于理解且合理的推荐逻辑。

🔬 方法详解

问题定义:现有推荐系统缺乏足够的可解释性,用户难以理解推荐的原因,降低了信任度和满意度。直接微调大型语言模型(LLM)虽然可以提升可解释性,但计算成本高昂,并且难以与已有的在线推荐系统集成,特别是对于那些不开源的专有LLM模型,集成难度更大。

核心思路:LANE的核心思路是在不微调LLM的前提下,通过语义对齐的方式,将LLM的推理能力与在线推荐系统结合起来。具体来说,LANE将用户和物品的语义信息嵌入到同一空间,并利用LLM进行推理,生成可解释的推荐理由。这样既能利用LLM的强大能力,又能避免微调带来的高成本和对现有系统的影响。

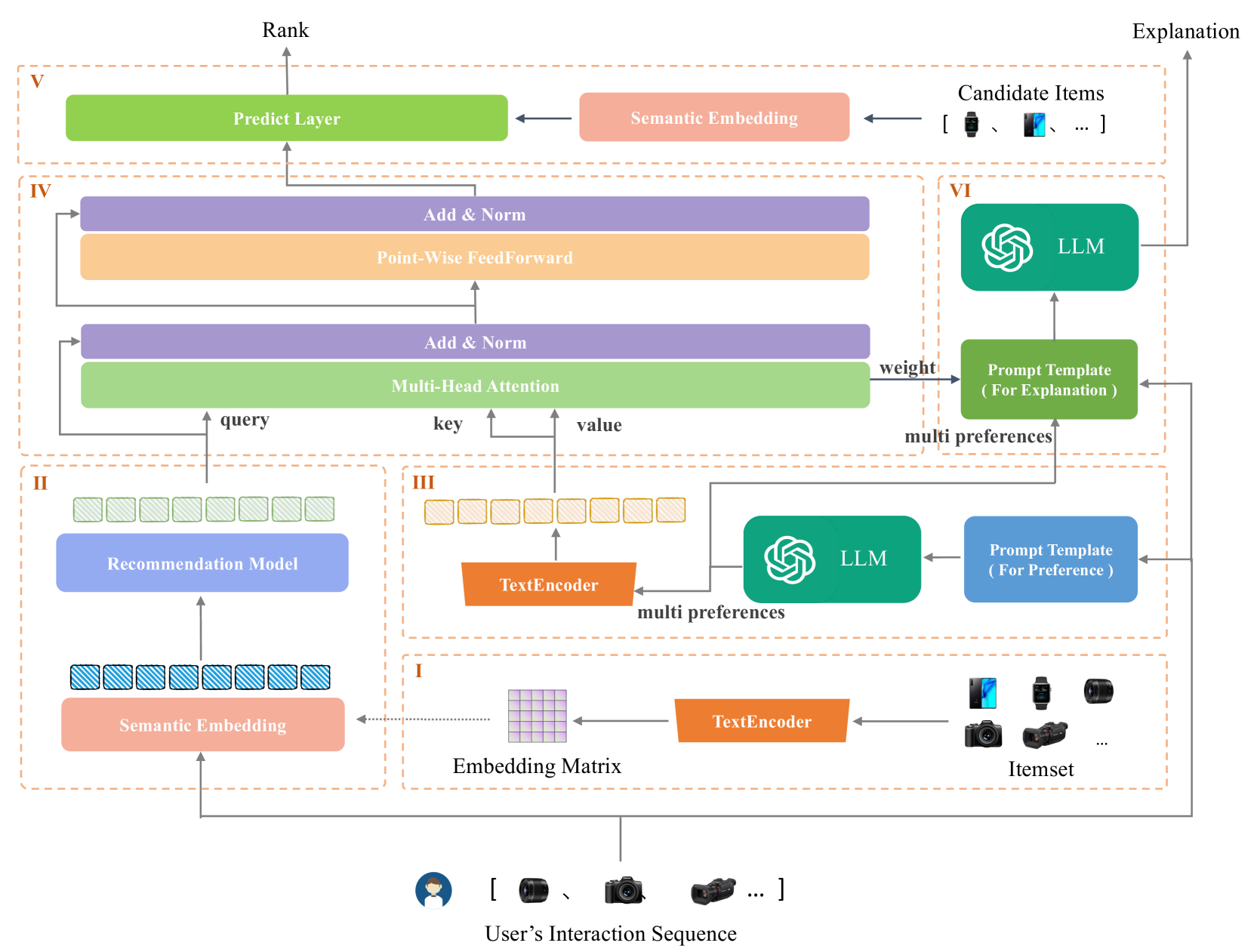

技术框架:LANE的整体框架包含以下几个主要模块:1) 语义嵌入:将用户和物品的标题等文本信息嵌入到语义空间中。2) 用户多偏好提取:利用零样本提示(Zero-shot prompting)从用户历史行为中提取多个偏好。3) 语义对齐:通过多头注意力机制,将用户偏好与候选物品的语义特征进行对齐。4) 可解释推荐生成:利用思维链(Chain of Thought, CoT)提示,引导LLM生成可解释的推荐理由。

关键创新:LANE的关键创新在于无需微调LLM即可实现与在线推荐系统的对齐,并生成可解释的推荐理由。与现有方法相比,LANE避免了高昂的微调成本,并且可以充分利用强大的专有LLM模型。此外,LANE通过语义对齐和思维链提示,实现了更自然、更易于理解的推荐解释。

关键设计:LANE的关键设计包括:1) 使用项目标题的嵌入而非ID,以更好地捕捉语义信息。2) 利用多头注意力机制进行语义对齐,允许模型关注不同的用户偏好。3) 采用思维链提示,引导LLM逐步生成推荐理由,提高可解释性。具体的参数设置和损失函数等细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LANE在保证推荐性能的同时,显著提升了推荐的可解释性。问卷调查显示,用户对LANE生成的推荐理由的满意度明显高于其他基线方法。可视化案例也表明,LANE能够生成更自然、更易于理解的推荐解释。具体的性能数据和提升幅度在摘要中未提及,属于未知信息。

🎯 应用场景

LANE可应用于各种在线推荐系统,例如电商、新闻、视频等平台。它可以提升推荐系统的可解释性,增强用户信任感和满意度,从而提高用户粘性和转化率。此外,LANE还可以帮助用户更好地理解推荐的原因,从而做出更明智的决策。未来,LANE可以进一步扩展到更复杂的推荐场景,例如多模态推荐和个性化推荐。

📄 摘要(原文)

The explainability of recommendation systems is crucial for enhancing user trust and satisfaction. Leveraging large language models (LLMs) offers new opportunities for comprehensive recommendation logic generation. However, in existing related studies, fine-tuning LLM models for recommendation tasks incurs high computational costs and alignment issues with existing systems, limiting the application potential of proven proprietary/closed-source LLM models, such as GPT-4. In this work, our proposed effective strategy LANE aligns LLMs with online recommendation systems without additional LLMs tuning, reducing costs and improving explainability. This innovative approach addresses key challenges in integrating language models with recommendation systems while fully utilizing the capabilities of powerful proprietary models. Specifically, our strategy operates through several key components: semantic embedding, user multi-preference extraction using zero-shot prompting, semantic alignment, and explainable recommendation generation using Chain of Thought (CoT) prompting. By embedding item titles instead of IDs and utilizing multi-head attention mechanisms, our approach aligns the semantic features of user preferences with those of candidate items, ensuring coherent and user-aligned recommendations. Sufficient experimental results including performance comparison, questionnaire voting, and visualization cases prove that our method can not only ensure recommendation performance, but also provide easy-to-understand and reasonable recommendation logic.