Generative Large Language Models in Automated Fact-Checking: A Survey

作者: Ivan Vykopal, Matúš Pikuliak, Simon Ostermann, Marián Šimko

分类: cs.CL

发布日期: 2024-07-02 (更新: 2024-10-30)

💡 一句话要点

综述生成式大语言模型在自动化事实核查中的应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 事实核查 生成式模型 自动化 虚假信息检测

📋 核心要点

- 在线虚假信息泛滥,传统人工核查效率低,难以应对大规模信息传播。

- 利用生成式LLMs的知识和推理能力,辅助事实核查员进行自动化核查。

- 综述分析了现有LLMs在事实核查中的应用方法和局限性,为未来研究提供参考。

📝 摘要(中文)

在线平台上的虚假信息传播构成严重的社会挑战。尽管人工事实核查仍然至关重要,但大型语言模型(LLMs)凭借其广博的知识和先进的推理能力,为支持事实核查员提供了有希望的机会。本综述探讨了生成式LLMs在事实核查中的应用,重点介绍了提示或微调这些模型的各种方法和技术。通过概述现有方法及其局限性,本综述旨在加深对LLMs如何用于事实核查的理解,并促进其进一步融入事实核查过程。

🔬 方法详解

问题定义:论文旨在解决在线平台虚假信息传播的问题,现有的人工事实核查方法效率低下,难以应对大规模信息传播。同时,如何有效利用大型语言模型(LLMs)的知识和推理能力来辅助或自动化事实核查是一个关键挑战。现有方法可能存在对LLM提示工程不足、微调策略不完善等问题,导致核查结果不准确或不可靠。

核心思路:论文的核心思路是系统性地调研和分析当前生成式LLMs在自动化事实核查中的应用。通过梳理不同的提示方法、微调技术以及评估指标,旨在为研究人员和实践者提供一个全面的视角,了解LLMs在事实核查中的优势、局限性以及未来发展方向。论文强调了如何通过有效的提示工程和微调策略来提升LLMs在事实核查任务中的性能。

技术框架:该综述论文本身并没有提出新的技术框架,而是对现有文献进行整理和归纳。其技术框架体现在对现有方法的分类和分析上,包括:1) 基于提示的学习方法,例如零样本提示、少样本提示等;2) 基于微调的方法,例如指令微调、对比学习等;3) 评估指标,例如准确率、召回率、F1值等。论文还讨论了不同方法的优缺点以及适用场景。

关键创新:该论文的创新之处在于其系统性和全面性。它首次对生成式LLMs在自动化事实核查领域的应用进行了全面的综述,并深入分析了各种方法的优缺点。这为研究人员提供了一个清晰的路线图,帮助他们了解该领域的最新进展和未来发展方向。此外,论文还指出了现有方法的局限性,并提出了未来研究的潜在方向。

关键设计:由于是综述论文,没有具体的参数设置、损失函数或网络结构。关键设计体现在论文的组织结构和内容选择上,例如如何对现有方法进行分类、如何选择具有代表性的论文进行分析、如何评估不同方法的性能等。论文的作者需要对该领域有深入的了解,才能做出合理的选择和判断。

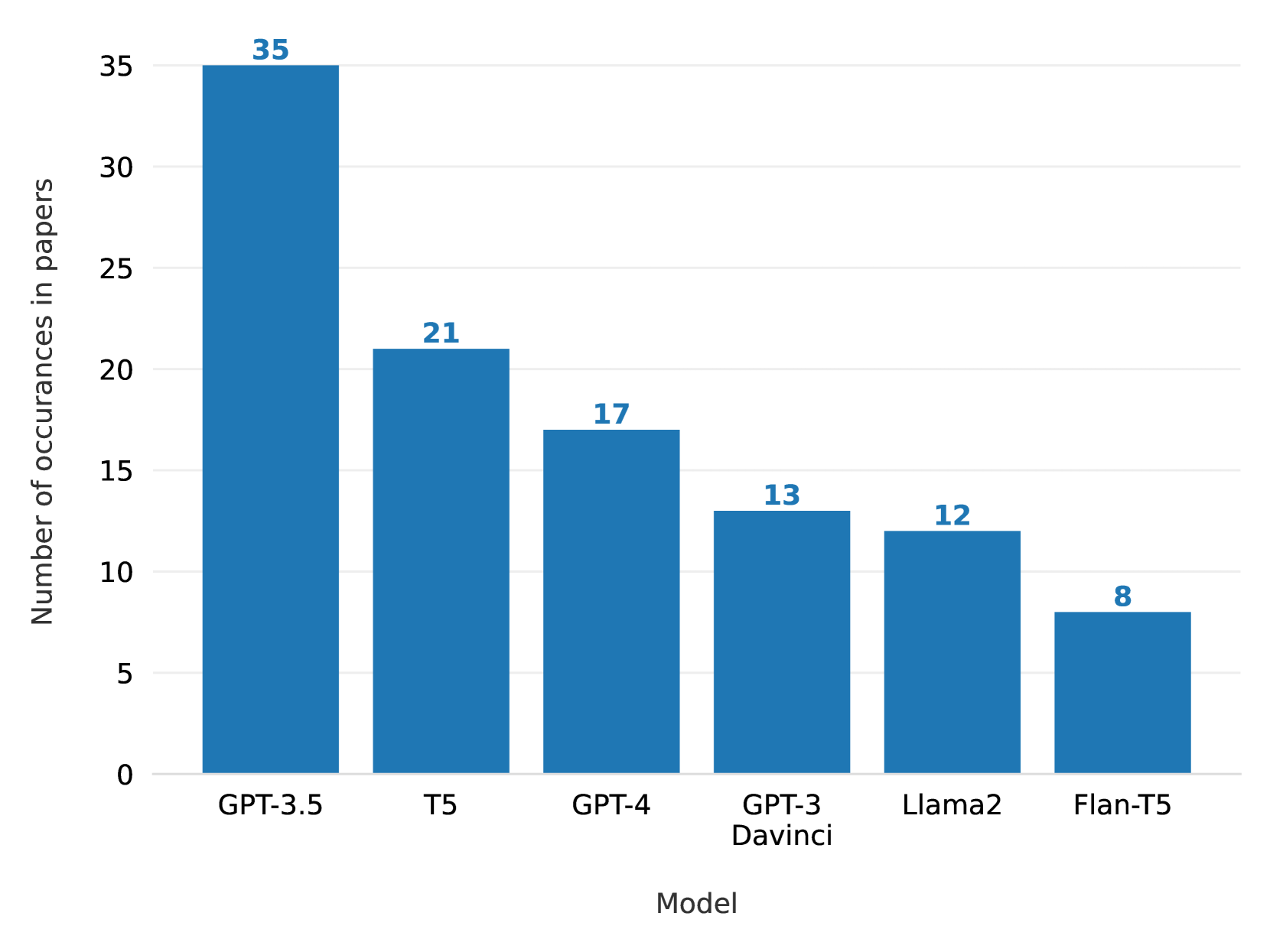

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述,没有具体的实验结果。其亮点在于对现有研究进行了系统性的总结和分析,为研究人员提供了一个全面的视角,了解生成式LLMs在自动化事实核查领域的应用现状和未来发展方向。论文指出了现有方法的局限性,并提出了未来研究的潜在方向,具有重要的参考价值。

🎯 应用场景

该研究成果可应用于新闻媒体、社交平台等领域,辅助事实核查员快速识别和纠正虚假信息,提高信息传播的可靠性。通过自动化事实核查,可以有效减少虚假信息对社会造成的负面影响,维护社会稳定和公众利益。未来,该技术有望应用于更广泛的领域,例如医疗、金融等,提高信息的可信度。

📄 摘要(原文)

The dissemination of false information on online platforms presents a serious societal challenge. While manual fact-checking remains crucial, Large Language Models (LLMs) offer promising opportunities to support fact-checkers with their vast knowledge and advanced reasoning capabilities. This survey explores the application of generative LLMs in fact-checking, highlighting various approaches and techniques for prompting or fine-tuning these models. By providing an overview of existing methods and their limitations, the survey aims to enhance the understanding of how LLMs can be used in fact-checking and to facilitate further progress in their integration into the fact-checking process.