Evaluating the Ability of LLMs to Solve Semantics-Aware Process Mining Tasks

作者: Adrian Rebmann, Fabian David Schmidt, Goran Glavaš, Han van der Aa

分类: cs.CL

发布日期: 2024-07-02

备注: Submitted to ICPM

💡 一句话要点

评估LLM在语义感知的过程挖掘任务中的能力,并提出微调方案。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 过程挖掘 大型语言模型 语义理解 异常检测 下一步活动预测 微调 上下文学习

📋 核心要点

- 现有过程挖掘方法在处理需要理解活动语义的任务时存在不足,例如语义异常检测和下一步活动预测。

- 该论文探索了大型语言模型(LLM)在解决语义感知的过程挖掘任务中的潜力,并研究了微调LLM以获得过程挖掘知识的方法。

- 实验结果表明,LLM在未经过微调的情况下表现不佳,但经过微调后,性能显著提升,超过了较小的编码器模型。

📝 摘要(中文)

过程挖掘社区最近认识到大型语言模型(LLM)在处理各种过程挖掘任务方面的潜力。初步研究表明,LLM能够支持过程分析,甚至在一定程度上能够推理过程如何运作。后一种特性表明,LLM也可用于处理受益于理解过程行为的过程挖掘任务。此类任务的示例包括(语义)异常检测和下一个活动预测,这两者都涉及对活动及其相互关系的含义的考虑。在本文中,我们研究了LLM处理此类语义感知过程挖掘任务的能力。此外,与大多数关于LLM和过程挖掘交叉的工作仅关注于开箱即用地测试这些模型不同,我们对LLM在过程挖掘中的效用进行了更原则性的研究,包括它们通过上下文学习和监督微调获得过程挖掘知识的能力。具体而言,我们定义了三个受益于理解过程语义的过程挖掘任务,并为每个任务提供了广泛的基准数据集。我们的评估实验表明,(1)LLM无法开箱即用地解决具有挑战性的过程挖掘任务,也无法在仅提供少量上下文示例时解决;(2)但是,当针对这些任务进行微调时,它们会产生强大的性能,始终超过较小的、基于编码器的语言模型。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLM)在解决语义感知的过程挖掘任务中的能力。现有的过程挖掘方法在处理需要理解活动语义的任务时,例如语义异常检测和下一步活动预测,存在不足。这些任务需要理解活动及其相互关系,而传统方法往往难以捕捉这些语义信息。

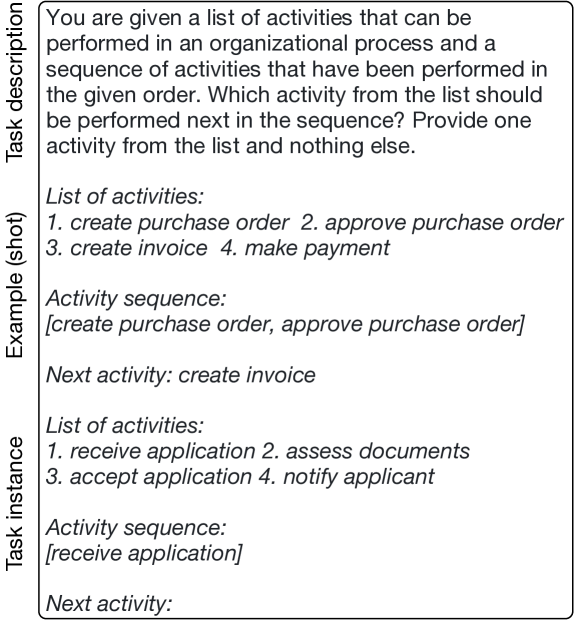

核心思路:论文的核心思路是利用LLM强大的语义理解和推理能力来解决语义感知的过程挖掘任务。通过将过程挖掘任务转化为LLM可以理解的自然语言形式,并利用LLM的预训练知识,可以提高模型在这些任务上的性能。此外,论文还探索了通过上下文学习和监督微调来进一步提升LLM性能的方法。

技术框架:论文的技术框架主要包括以下几个部分:1) 定义三个语义感知的过程挖掘任务:语义异常检测、下一步活动预测和一个未明确提及的任务(从摘要推断)。2) 构建每个任务的基准数据集。3) 使用不同的LLM(包括未微调、上下文学习和微调版本)在这些数据集上进行评估。4) 将LLM的性能与较小的、基于编码器的语言模型进行比较。

关键创新:论文的关键创新在于:1) 系统性地评估了LLM在语义感知的过程挖掘任务中的能力。2) 不仅评估了LLM的开箱即用性能,还研究了通过上下文学习和监督微调来提升LLM性能的方法。3) 构建了用于评估LLM在过程挖掘任务中性能的基准数据集。

关键设计:论文的关键设计包括:1) 针对每个任务设计了合适的提示(prompt),以便将过程挖掘任务转化为LLM可以理解的自然语言形式。2) 使用了监督微调来训练LLM,并选择了合适的损失函数和优化器。3) 选择了合适的评估指标来衡量LLM在每个任务上的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM在未经过微调的情况下,在具有挑战性的过程挖掘任务上表现不佳。然而,经过微调后,LLM的性能显著提升,始终超过了较小的、基于编码器的语言模型。这表明,通过合适的微调策略,LLM可以有效地应用于语义感知的过程挖掘任务。

🎯 应用场景

该研究的潜在应用领域包括:流程优化、异常检测、风险管理、智能决策支持等。通过利用LLM的语义理解能力,可以更准确地识别流程中的异常行为,预测下一步活动,从而提高流程效率和降低风险。未来,该研究可以扩展到更复杂的过程挖掘任务,例如流程发现和流程一致性检查。

📄 摘要(原文)

The process mining community has recently recognized the potential of large language models (LLMs) for tackling various process mining tasks. Initial studies report the capability of LLMs to support process analysis and even, to some extent, that they are able to reason about how processes work. This latter property suggests that LLMs could also be used to tackle process mining tasks that benefit from an understanding of process behavior. Examples of such tasks include (semantic) anomaly detection and next activity prediction, which both involve considerations of the meaning of activities and their inter-relations. In this paper, we investigate the capabilities of LLMs to tackle such semantics-aware process mining tasks. Furthermore, whereas most works on the intersection of LLMs and process mining only focus on testing these models out of the box, we provide a more principled investigation of the utility of LLMs for process mining, including their ability to obtain process mining knowledge post-hoc by means of in-context learning and supervised fine-tuning. Concretely, we define three process mining tasks that benefit from an understanding of process semantics and provide extensive benchmarking datasets for each of them. Our evaluation experiments reveal that (1) LLMs fail to solve challenging process mining tasks out of the box and when provided only a handful of in-context examples, (2) but they yield strong performance when fine-tuned for these tasks, consistently surpassing smaller, encoder-based language models.