CFinBench: A Comprehensive Chinese Financial Benchmark for Large Language Models

作者: Ying Nie, Binwei Yan, Tianyu Guo, Hao Liu, Haoyu Wang, Wei He, Binfan Zheng, Weihao Wang, Qiang Li, Weijian Sun, Yunhe Wang, Dacheng Tao

分类: cs.CL

发布日期: 2024-07-02

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

CFinBench:一个全面的中文金融领域大语言模型评测基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 金融领域 评测基准 中文 金融知识 自然语言处理 人工智能

📋 核心要点

- 现有大语言模型在通用NLP任务上表现出色,但在金融等专业领域的潜力尚未充分挖掘。

- CFinBench通过模拟中国金融从业者职业路径,构建多维度、细粒度的评测体系,评估LLM的金融知识。

- 实验结果表明,即使是GPT4等领先模型在CFinBench上的表现仍有提升空间,证明了该基准的挑战性。

📝 摘要(中文)

本文提出了CFinBench,一个精心构建的、目前最全面的中文金融领域大语言模型(LLM)评测基准,旨在评估LLM在金融知识方面的能力。该基准模拟中国金融从业者的职业发展轨迹,从四个一级类别进行系统评估:(1)金融学科:LLM是否能记忆经济学、统计学和审计等必要的金融学科基础知识;(2)金融资格:LLM是否能获得所需的金融资格认证,如注册会计师、证券从业资格和银行从业资格;(3)金融实践:LLM是否能胜任税务顾问、初级会计师和证券分析师等实际金融工作;(4)金融法律:LLM是否能满足税法、保险法和经济法等金融法律法规的要求。CFinBench包含99,100道题目,涵盖43个二级类别,题型包括单选题、多选题和判断题。对50个具有不同模型规模的代表性LLM进行了广泛实验。结果表明,GPT4和一些面向中文的模型在该基准测试中表现领先,最高平均准确率为60.16%,突显了CFinBench的挑战性。数据集和评估代码可在https://cfinbench.github.io/获取。

🔬 方法详解

问题定义:现有的大语言模型在通用领域表现出色,但在金融等专业领域的知识掌握程度和应用能力仍有待评估。缺乏一个全面、细粒度的中文金融领域评测基准,难以有效衡量和提升LLM在金融领域的应用水平。

核心思路:CFinBench的核心思路是构建一个与中国金融从业者职业发展路径对齐的评测体系,从金融学科、金融资格、金融实践和金融法律四个一级类别,以及更细粒度的二级类别入手,全面评估LLM的金融知识和应用能力。通过模拟实际金融场景,更真实地反映LLM在金融领域的表现。

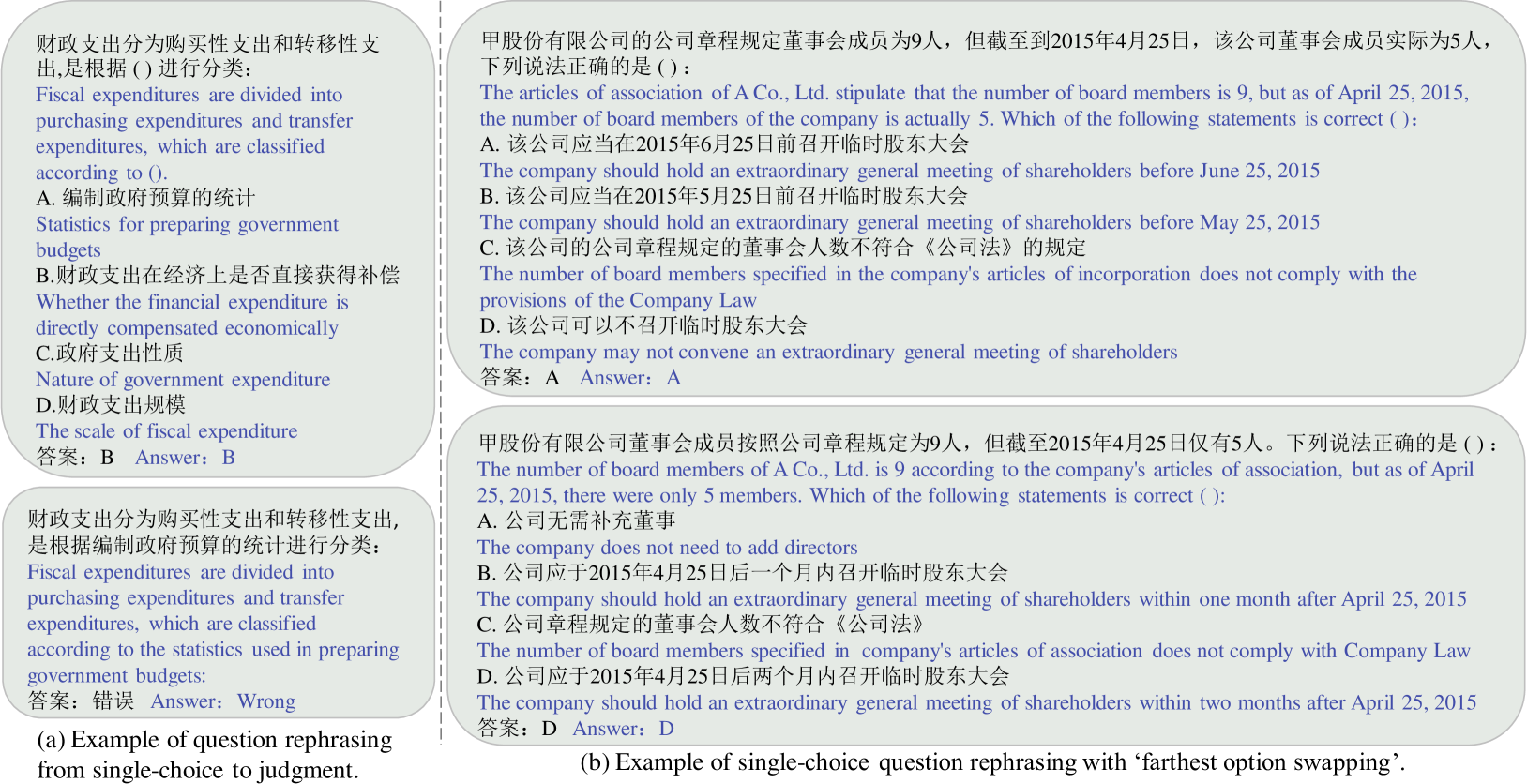

技术框架:CFinBench的整体框架包括以下几个主要部分:1)定义评测维度:确定四个一级类别(金融学科、金融资格、金融实践、金融法律)和43个二级类别,覆盖金融领域的核心知识和技能;2)构建数据集:收集或生成99,100道题目,包括单选题、多选题和判断题,确保题目的质量和多样性;3)模型评测:选择50个具有不同模型规模的代表性LLM进行评测,记录模型的准确率等指标;4)结果分析:分析评测结果,评估不同模型在各个维度上的表现,并找出模型的优势和不足。

关键创新:CFinBench的关键创新在于其评测体系的全面性和细粒度,以及与中国金融从业者职业发展路径的对齐。与现有的金融领域评测基准相比,CFinBench更加注重对LLM在实际金融场景中的应用能力的评估,而非仅仅是知识的记忆和理解。此外,CFinBench是专门针对中文金融领域构建的,更符合中国市场的实际需求。

关键设计:CFinBench的关键设计包括:1)题目类型:采用单选题、多选题和判断题三种题型,以考察LLM的不同能力;2)难度分布:题目难度分布合理,既包含基础知识题,也包含需要深入理解和应用的难题;3)数据质量控制:对收集或生成的题目进行严格的审核和筛选,确保题目的准确性和规范性;4)评测指标:采用准确率作为主要评测指标,同时考虑模型的推理速度和资源消耗。

🖼️ 关键图片

📊 实验亮点

实验结果显示,GPT4和一些面向中文的模型在CFinBench上表现领先,但最高平均准确率仅为60.16%,表明即使是最先进的LLM在金融领域的知识掌握和应用能力仍有提升空间。不同模型在不同维度上的表现差异较大,反映了模型在金融知识方面的偏好和不足。

🎯 应用场景

CFinBench可用于评估和提升大语言模型在金融领域的应用能力,例如智能投顾、风险管理、合规审查等。该基准有助于推动金融领域人工智能技术的发展,提高金融服务的效率和质量,并为金融从业者提供更智能化的工具。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable performance on various NLP tasks, yet their potential in more challenging and domain-specific task, such as finance, has not been fully explored. In this paper, we present CFinBench: a meticulously crafted, the most comprehensive evaluation benchmark to date, for assessing the financial knowledge of LLMs under Chinese context. In practice, to better align with the career trajectory of Chinese financial practitioners, we build a systematic evaluation from 4 first-level categories: (1) Financial Subject: whether LLMs can memorize the necessary basic knowledge of financial subjects, such as economics, statistics and auditing. (2) Financial Qualification: whether LLMs can obtain the needed financial qualified certifications, such as certified public accountant, securities qualification and banking qualification. (3) Financial Practice: whether LLMs can fulfill the practical financial jobs, such as tax consultant, junior accountant and securities analyst. (4) Financial Law: whether LLMs can meet the requirement of financial laws and regulations, such as tax law, insurance law and economic law. CFinBench comprises 99,100 questions spanning 43 second-level categories with 3 question types: single-choice, multiple-choice and judgment. We conduct extensive experiments of 50 representative LLMs with various model size on CFinBench. The results show that GPT4 and some Chinese-oriented models lead the benchmark, with the highest average accuracy being 60.16%, highlighting the challenge presented by CFinBench. The dataset and evaluation code are available at https://cfinbench.github.io/.