MalAlgoQA: Pedagogical Evaluation of Counterfactual Reasoning in Large Language Models and Implications for AI in Education

作者: Naiming Liu, Shashank Sonkar, Myco Le, Richard Baraniuk

分类: cs.CL, cs.CY

发布日期: 2024-07-01 (更新: 2024-10-05)

备注: Accepted at EMNLP 2024 Findings Track

🔗 代码/项目: GITHUB

💡 一句话要点

提出MalAlgoQA数据集,用于评估大语言模型中的反事实推理能力,并应用于AI教育。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 反事实推理 大型语言模型 AI教育 Malgorithm 数据集 推理评估 思维链提示

📋 核心要点

- 现有大语言模型在反事实推理方面存在不足,尤其是在识别和分析错误推理路径时,这限制了其在教育领域的应用。

- MalAlgoQA数据集通过引入“malgorithms”,即错误答案背后的合理但错误的推理,来评估模型识别和分析错误推理的能力。

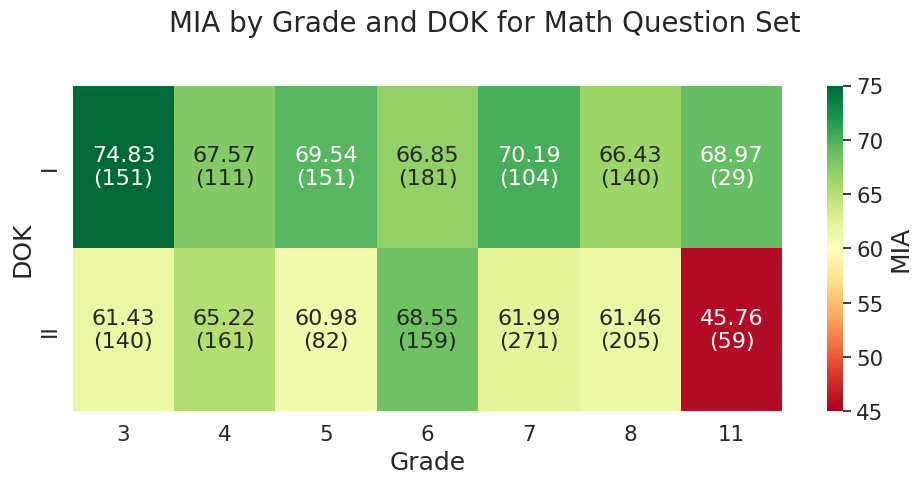

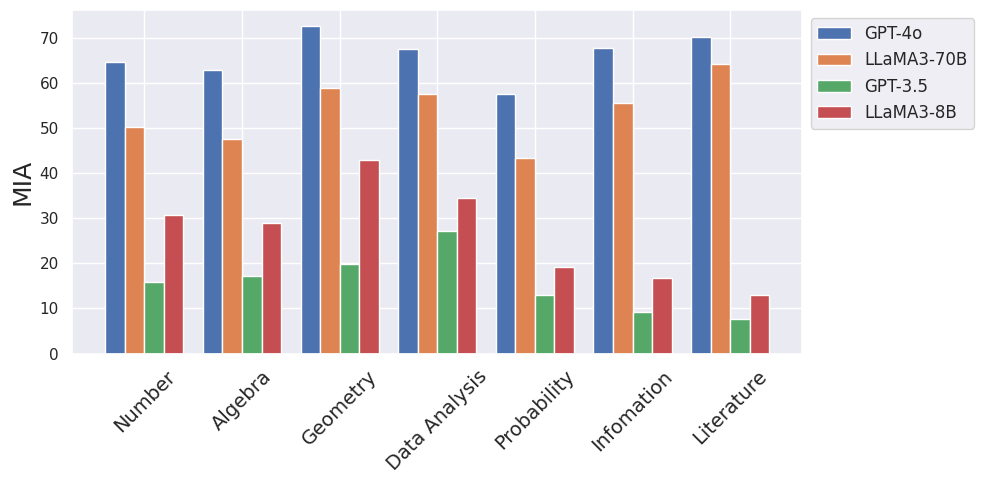

- 实验表明,现有LLM在识别错误答案理由(MIA)方面的表现显著低于识别正确答案理由(AIA),思维链提示有时反而会降低MIA。

📝 摘要(中文)

本文提出了MalAlgoQA,一个新颖的数据集,旨在通过教学方法评估大型语言模型(LLM)的反事实推理能力。该数据集包含数学和阅读理解问题,每个问题都附带四个答案选项及其相应的理由。MalAlgoQA的核心是“malgorithms”——即错误答案选项背后的理由,这些理由代表了有缺陷但逻辑上连贯的推理路径。这些malgorithms充当反事实场景,使我们能够评估LLM识别和分析有缺陷的推理模式的能力。我们提出了Malgorithm识别任务,其中LLM根据其识别给定错误答案选项的相应malgorithm的能力进行评估。为了评估模型性能,我们引入了两个指标:算法识别准确率(AIA)用于正确答案理由识别,以及Malgorithm识别准确率(MIA)用于错误答案理由识别。我们的实验表明,最先进的LLM在MIA方面的表现明显低于AIA,突出了反事实推理的挑战。令人惊讶的是,我们发现思维链提示技术不仅未能持续提高MIA,有时甚至会导致低于简单提示的性能。这些发现对于开发具有改进的反事实推理能力的LLM具有重要意义,尤其与AI驱动的辅导系统相关,在这些系统中,识别和解决学生的误解至关重要。MalAlgoQA数据集可在https://github.com/luffycodes/MalAlgoQA-Dataset 获取。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在反事实推理能力上的不足,特别是在教育场景下,LLM需要识别学生错误的解题思路(即malgorithms)。现有方法难以有效识别这些错误的推理路径,导致AI辅导系统无法精准定位学生的知识盲点。

核心思路:论文的核心思路是构建一个包含错误推理路径(malgorithms)的数据集,并设计相应的评估指标,以衡量LLM识别和分析这些错误推理路径的能力。通过这种方式,可以更有效地评估LLM的反事实推理能力,并为改进模型提供指导。

技术框架:MalAlgoQA数据集包含数学和阅读理解问题,每个问题有四个选项和对应的理由。其中,错误的选项对应着“malgorithms”。论文提出了Malgorithm识别任务,即给定一个错误选项,LLM需要识别出对应的malgorithm。评估指标包括算法识别准确率(AIA)和Malgorithm识别准确率(MIA)。

关键创新:该论文的关键创新在于提出了“malgorithms”的概念,并将其应用于评估LLM的反事实推理能力。与以往主要关注正确答案推理的数据集不同,MalAlgoQA侧重于错误答案背后的逻辑,这更贴近教育场景中识别学生错误思路的需求。

关键设计:数据集的设计考虑了数学和阅读理解两种题型,以覆盖不同的认知能力。在实验中,论文对比了不同prompting策略(包括思维链)对MIA的影响。数据集的规模和难度经过精心设计,以确保能够有效区分不同LLM的反事实推理能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有最先进的LLM在MIA上的表现显著低于AIA,表明其在反事实推理方面存在挑战。令人惊讶的是,思维链提示有时反而会降低MIA。例如,某些模型在简单提示下的MIA高于使用思维链提示时的MIA,这表明思维链提示并不总是能有效提升反事实推理能力。

🎯 应用场景

该研究成果可应用于AI驱动的个性化辅导系统,帮助系统更准确地识别学生的错误解题思路,并提供针对性的指导。通过提升LLM的反事实推理能力,可以开发出更智能、更有效的教育工具,从而改善学生的学习体验和效果。此外,该方法也可用于评估其他AI系统的推理能力。

📄 摘要(原文)

This paper introduces MalAlgoQA, a novel dataset designed to evaluate the counterfactual reasoning capabilities of Large Language Models (LLMs) through a pedagogical approach. The dataset comprises mathematics and reading comprehension questions, each accompanied by four answer choices and their corresponding rationales. At the heart of MalAlgoQA are ``malgorithms'' - rationales behind incorrect answer choices that represent flawed yet logically coherent reasoning paths. These malgorithms serve as counterfactual scenarios, allowing us to assess an LLM's ability to identify and analyze flawed reasoning patterns. We propose the Malgorithm Identification task, where LLMs are assessed based on their ability to identify corresponding malgorithm given an incorrect answer choice. To evaluate the model performance, we introduce two metrics: Algorithm Identification Accuracy (AIA) for correct answer rationale identification, and Malgorithm Identification Accuracy (MIA) for incorrect answer rationale identification. Our experiments reveal that state-of-the-art LLMs exhibit significant performance drops in MIA compared to AIA, highlighting the challenges in counterfactual reasoning. Surprisingly, we find that the chain-of-thought prompting technique not only fails to consistently enhance MIA but can sometimes lead to underperformance compared to simple prompting. These findings have important implications for developing LLMs with improved counterfactual reasoning, particularly relevant for AI-powered tutoring systems, where identifying and addressing student misconceptions is essential. MalAlgoQA dataset is available \href{https://github.com/luffycodes/MalAlgoQA-Dataset}{here}.