How to Train Your Fact Verifier: Knowledge Transfer with Multimodal Open Models

作者: Jaeyoung Lee, Ximing Lu, Jack Hessel, Faeze Brahman, Youngjae Yu, Yonatan Bisk, Yejin Choi, Saadia Gabriel

分类: cs.CL

发布日期: 2024-06-29

💡 一句话要点

利用多模态开放模型进行知识迁移,提升事实核查器性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事实核查 知识迁移 多模态学习 大型语言模型 虚假信息检测

📋 核心要点

- 现有事实核查模型面临基础模型训练数据过时的问题,影响了其准确性和时效性。

- 论文提出利用知识迁移策略,通过领域内和跨领域的基准测试或LLM生成的解释来提升模型性能。

- 实验结果表明,该方法在多模态事实核查基准测试上取得了显著提升,优于现有技术水平。

📝 摘要(中文)

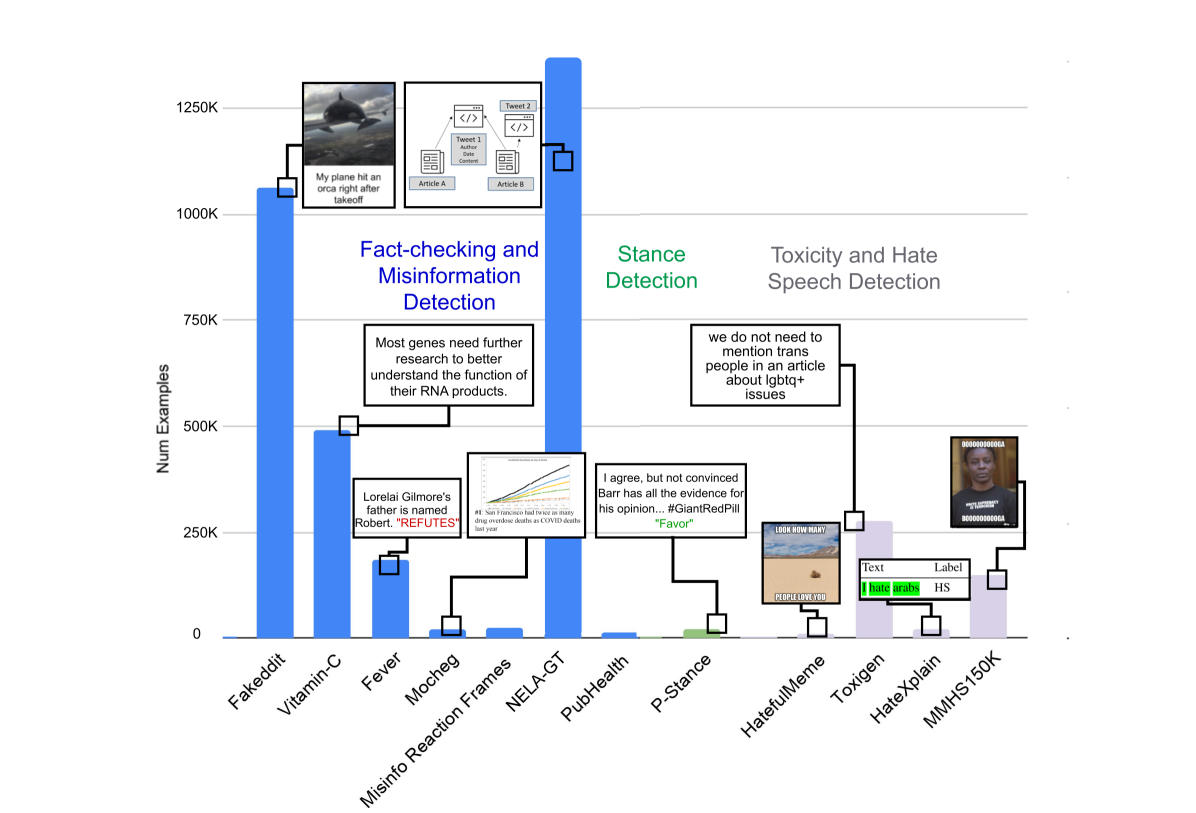

鉴于新闻和社交媒体上虚假信息日益增多,迫切需要能够有效实时验证新闻声明的系统。基于大型语言或多模态模型的验证方法已被提出来扩展在线监管机制,以减轻虚假和有害内容的传播。虽然这些方法可能减轻人工事实核查员的负担,但基础模型训练数据过时可能会阻碍这些努力。本文通过研究知识迁移,利用现有领域内和跨领域的基准测试或大型语言模型(LLM)生成的解释,来测试在不持续更新的情况下提高基础模型性能的极限。我们在12个公开的事实核查和错误信息检测基准测试以及另外两个与内容审核相关的任务(毒性和立场检测)上进行了评估。在两个最新的多模态事实核查基准测试Mocheg和Fakeddit上的结果表明,知识迁移策略可以将Fakeddit的性能提高到超过现有最佳水平1.7%,并将Mocheg的性能提高到2.9%。

🔬 方法详解

问题定义:论文旨在解决事实核查模型因训练数据过时而导致的性能下降问题。现有方法需要不断更新模型,成本高昂且效率低下。

核心思路:论文的核心思路是通过知识迁移,将已有的知识从其他相关任务或领域迁移到事实核查任务中,从而提高模型在新数据上的泛化能力,而无需持续更新基础模型。

技术框架:整体框架包括:1) 利用现有基准数据集或LLM生成解释作为知识来源;2) 设计知识迁移策略,将这些知识融入到事实核查模型中;3) 在多个事实核查和相关任务的基准数据集上评估模型性能。

关键创新:最重要的创新点在于探索了利用知识迁移来提升事实核查模型性能的可能性,特别是在多模态场景下,并验证了该方法在多个数据集上的有效性。与现有方法相比,该方法避免了频繁更新基础模型的需求,降低了成本。

关键设计:论文中涉及的关键设计包括:选择合适的知识迁移策略(例如,微调、多任务学习等),设计有效的损失函数来指导知识迁移过程,以及选择合适的预训练模型作为基础模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该知识迁移策略在Fakeddit数据集上将性能提升了1.7%,在Mocheg数据集上提升了2.9%,超过了现有最佳水平。此外,该方法在其他事实核查和相关任务的基准测试上也取得了良好的效果,验证了其有效性和泛化能力。

🎯 应用场景

该研究成果可应用于在线内容审核、新闻真实性验证、社交媒体虚假信息检测等领域。通过提升事实核查模型的性能,可以有效减少虚假信息的传播,维护网络空间的健康和安全。未来,该方法可以进一步扩展到其他语言和文化背景下,提高全球范围内的信息可信度。

📄 摘要(原文)

Given the growing influx of misinformation across news and social media, there is a critical need for systems that can provide effective real-time verification of news claims. Large language or multimodal model based verification has been proposed to scale up online policing mechanisms for mitigating spread of false and harmful content. While these can potentially reduce burden on human fact-checkers, such efforts may be hampered by foundation model training data becoming outdated. In this work, we test the limits of improving foundation model performance without continual updating through an initial study of knowledge transfer using either existing intra- and inter- domain benchmarks or explanations generated from large language models (LLMs). We evaluate on 12 public benchmarks for fact-checking and misinformation detection as well as two other tasks relevant to content moderation -- toxicity and stance detection. Our results on two recent multi-modal fact-checking benchmarks, Mocheg and Fakeddit, indicate that knowledge transfer strategies can improve Fakeddit performance over the state-of-the-art by up to 1.7% and Mocheg performance by up to 2.9%.