YuLan: An Open-source Large Language Model

作者: Yutao Zhu, Kun Zhou, Kelong Mao, Wentong Chen, Yiding Sun, Zhipeng Chen, Qian Cao, Yihan Wu, Yushuo Chen, Feng Wang, Lei Zhang, Junyi Li, Xiaolei Wang, Lei Wang, Beichen Zhang, Zican Dong, Xiaoxue Cheng, Yuhan Chen, Xinyu Tang, Yupeng Hou, Qiangqiang Ren, Xincheng Pang, Shufang Xie, Wayne Xin Zhao, Zhicheng Dou, Jiaxin Mao, Yankai Lin, Ruihua Song, Jun Xu, Xu Chen, Rui Yan, Zhewei Wei, Di Hu, Wenbing Huang, Ze-Feng Gao, Yueguo Chen, Weizheng Lu, Ji-Rong Wen

分类: cs.CL, cs.AI

发布日期: 2024-06-28

🔗 代码/项目: GITHUB

💡 一句话要点

发布开源120亿参数大语言模型YuLan,提供完整训练细节助力研究。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 开源模型 预训练 指令微调 人类对齐 课程学习 中文LLM

📋 核心要点

- 现有开源LLM缺乏训练细节,阻碍了进一步的研究和开发,YuLan旨在弥补这一不足。

- YuLan采用三阶段预训练方法,并结合指令微调、人类对齐以及课程学习,提升模型性能。

- YuLan在多种中英文基准测试中达到与当前最优LLM相当的性能,证明了其有效性。

📝 摘要(中文)

本文介绍了YuLan,一系列拥有120亿参数的开源大语言模型。YuLan的基础模型在一个包含大量英文、中文和多语言文本的多样化语料库上进行了预训练,数据量约为1.7T tokens。我们设计了一个三阶段预训练方法来增强YuLan的整体能力。随后的训练阶段包括指令微调和人类对齐,使用了大量高质量的合成数据。为了促进复杂和长尾知识的学习,我们在这些阶段设计了一个课程学习框架,帮助LLM以由易到难的方式学习知识。YuLan的训练于2024年1月完成,并在各种英文和中文基准测试中取得了与最先进的LLM相当的性能。本文概述了一个从头开始开发LLM的全面技术路线图。我们的模型和代码可在https://github.com/RUC-GSAI/YuLan-Chat获取。

🔬 方法详解

问题定义:现有开源大语言模型虽然发布了技术报告,但缺乏详细的训练过程信息,使得研究人员难以复现、改进和进一步探索。这限制了社区对LLM技术的深入理解和创新应用。YuLan旨在通过开源模型和详细的训练过程,解决这一问题。

核心思路:YuLan的核心思路是通过一个精心设计的三阶段训练流程,结合大规模数据、指令微调、人类对齐和课程学习,使模型能够有效地学习和掌握知识,并在各种任务中表现出色。课程学习的设计旨在让模型从简单到复杂地学习知识,从而提高学习效率和效果。

技术框架:YuLan的训练分为三个阶段:1) 基础模型预训练:使用包含英文、中文和多语言文本的大规模语料库(1.7T tokens)进行训练。2) 指令微调:使用高质量的合成数据进行指令微调,提升模型对指令的理解和执行能力。3) 人类对齐:通过人类反馈进行对齐,使模型的输出更符合人类的偏好和价值观。整个训练过程中,都采用了课程学习框架。

关键创新:YuLan的关键创新在于其三阶段训练方法和课程学习框架的结合。三阶段训练方法能够有效地提升模型的整体能力,而课程学习框架则能够帮助模型更好地学习复杂和长尾知识。此外,开源模型和详细训练过程的发布本身也是一个重要的创新,促进了社区的共同发展。

关键设计:YuLan使用了120亿参数的模型架构。在预训练阶段,采用了大规模的多语言语料库。在指令微调阶段,使用了高质量的合成数据。课程学习框架的具体实现细节(例如,如何定义学习难度、如何安排学习顺序)在论文中可能包含更详细的描述,但摘要中未明确指出。

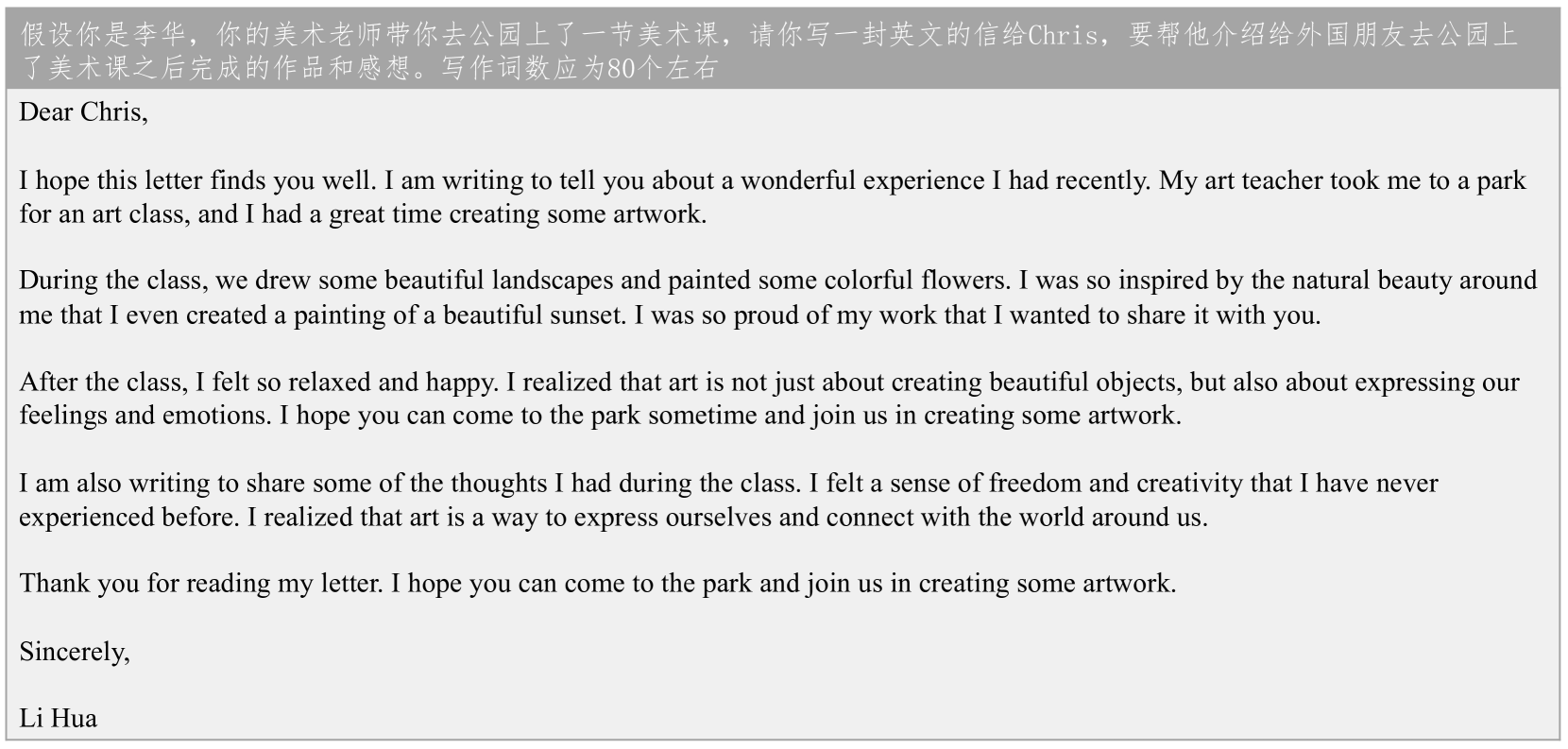

🖼️ 关键图片

📊 实验亮点

YuLan在多种英文和中文基准测试中取得了与当前最先进的LLM相当的性能。虽然摘要中没有给出具体的性能数据和对比基线,但“on par with state-of-the-art LLMs”表明YuLan在性能上具有竞争力,证明了其训练方法的有效性。

🎯 应用场景

YuLan的潜在应用领域包括智能客服、文本生成、机器翻译、教育辅导等。通过开源模型和训练细节,YuLan可以促进LLM技术在各个领域的应用和发展,降低LLM的使用门槛,并推动相关研究的进步。未来,YuLan有望成为一个重要的基础模型,为各种下游任务提供支持。

📄 摘要(原文)

Large language models (LLMs) have become the foundation of many applications, leveraging their extensive capabilities in processing and understanding natural language. While many open-source LLMs have been released with technical reports, the lack of training details hinders further research and development. This paper presents the development of YuLan, a series of open-source LLMs with $12$ billion parameters. The base model of YuLan is pre-trained on approximately $1.7$T tokens derived from a diverse corpus, including massive English, Chinese, and multilingual texts. We design a three-stage pre-training method to enhance YuLan's overall capabilities. Subsequent phases of training incorporate instruction-tuning and human alignment, employing a substantial volume of high-quality synthesized data. To facilitate the learning of complex and long-tail knowledge, we devise a curriculum-learning framework throughout across these stages, which helps LLMs learn knowledge in an easy-to-hard manner. YuLan's training is finished on Jan, 2024 and has achieved performance on par with state-of-the-art LLMs across various English and Chinese benchmarks. This paper outlines a comprehensive technical roadmap for developing LLMs from scratch. Our model and codes are available at https://github.com/RUC-GSAI/YuLan-Chat.