Leveraging Machine-Generated Rationales to Facilitate Social Meaning Detection in Conversations

作者: Ritam Dutt, Zhen Wu, Kelly Shi, Divyanshu Sheth, Prakhar Gupta, Carolyn Penstein Rose

分类: cs.CL, cs.AI

发布日期: 2024-06-27

备注: To appear at The Proceedings of the Association for Computational Linguistics, 2024

💡 一句话要点

利用机器生成的推理增强对话理解,提升社交含义检测性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社交含义检测 大型语言模型 推理生成 对话理解 零样本学习

📋 核心要点

- 现有方法难以有效检测对话中隐式编码的社交含义,限制了对话理解的深度。

- 利用大型语言模型生成推理,将可见线索与潜在社交含义连接,作为对话文本的补充。

- 实验结果表明,该方法在领域内分类、零样本和少样本迁移中均显著提升社交含义检测性能。

📝 摘要(中文)

本文提出了一种通用的分类方法,利用大型语言模型(LLMs)来促进对话中隐式编码的社交含义的检测。我们设计了一个多方面的提示,以提取连接可见线索与潜在社交含义的推理文本解释。这些提取的解释或推理作为对话文本的增强,以促进对话理解和迁移。在2340个实验设置中,我们的实证结果表明,添加这些推理具有显著的积极影响。我们的发现适用于两种不同的社交含义检测任务的领域内分类、零样本和少样本领域迁移,每项任务跨越两个不同的语料库。

🔬 方法详解

问题定义:论文旨在解决对话中隐式社交含义检测的问题。现有方法难以捕捉对话中微妙的社交线索,导致理解偏差。痛点在于缺乏有效的机制来解释和利用这些隐式信息,尤其是在跨领域迁移时性能下降明显。

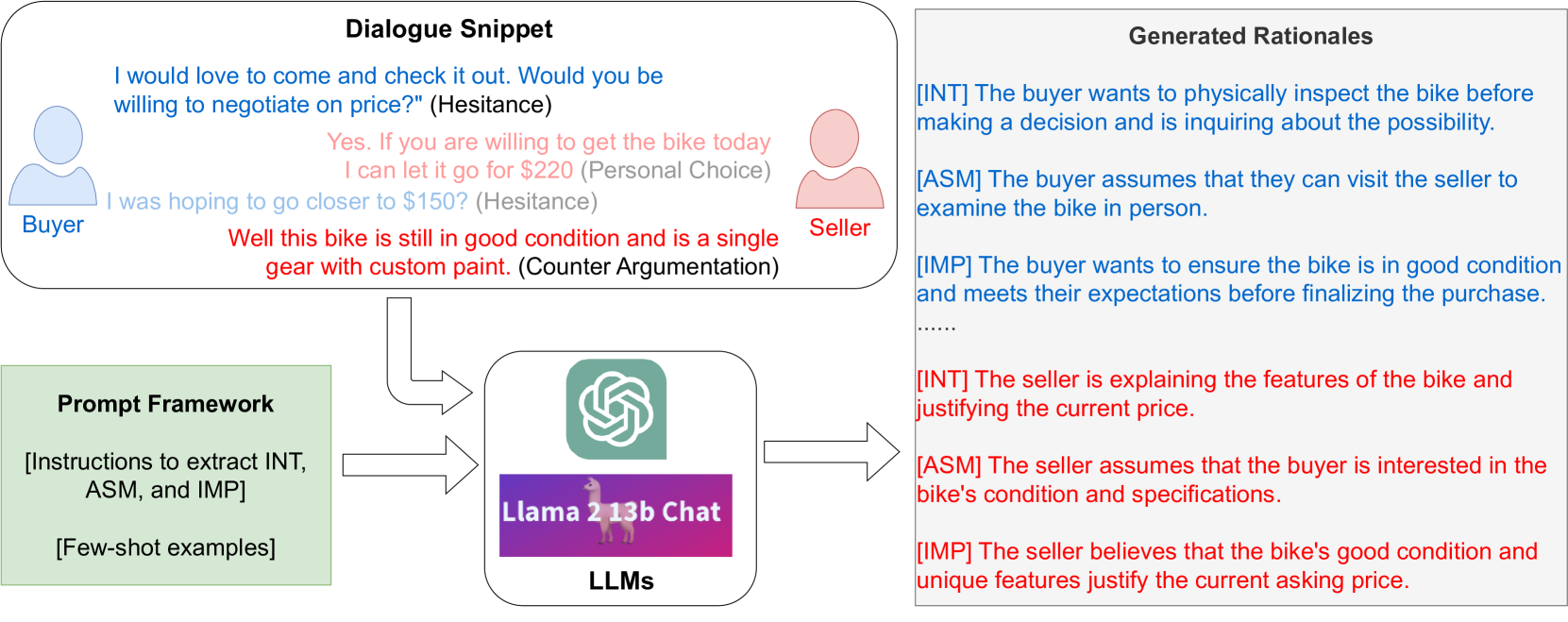

核心思路:核心思路是利用大型语言模型(LLMs)生成对社交含义的推理(rationales),这些推理将对话中的可见线索与潜在的社交含义联系起来。通过将这些推理添加到原始对话文本中,增强模型对社交含义的理解能力。这样设计的目的是显式地提供上下文信息,帮助模型更好地捕捉和利用隐式社交线索。

技术框架:整体框架包括以下几个阶段:1) 使用多方面的提示(prompt)引导LLM生成对话文本的推理;2) 将生成的推理与原始对话文本进行拼接,形成增强后的输入;3) 使用分类模型(例如,基于Transformer的模型)对增强后的输入进行社交含义检测;4) 在不同的实验设置(领域内、零样本、少样本)下评估模型的性能。

关键创新:最重要的技术创新点在于利用LLM自动生成对话的推理,并将其作为一种数据增强方法。与传统的数据增强方法不同,该方法生成的推理是针对特定对话的,能够提供更具针对性的上下文信息。此外,该方法具有通用性,可以应用于不同的社交含义检测任务和语料库。

关键设计:关键设计包括:1) 精心设计的prompt,用于引导LLM生成高质量的推理。Prompt包含多个方面的信息,例如对话的目标、参与者的角色、社交规范等;2) 使用不同的LLM(例如,GPT-3)进行推理生成,并比较不同LLM的性能;3) 采用不同的分类模型(例如,BERT、RoBERTa)进行社交含义检测,并评估推理对不同模型的影响;4) 实验中使用了多种评估指标,例如准确率、F1值等,以全面评估模型的性能。

🖼️ 关键图片

📊 实验亮点

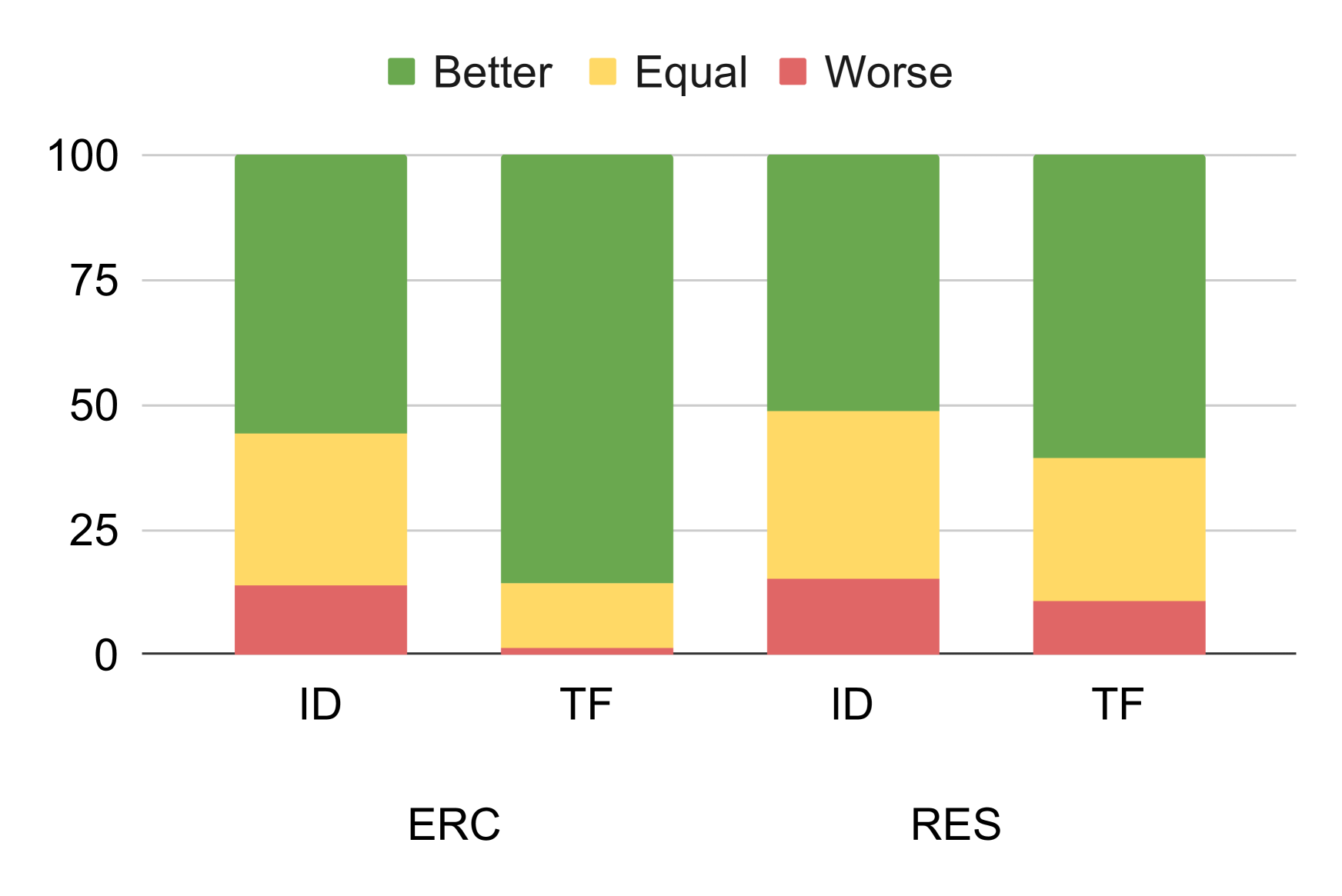

实验结果表明,添加机器生成的推理能够显著提升社交含义检测的性能。在2340个实验设置中,该方法在领域内分类、零样本和少样本迁移中均取得了积极的效果。具体而言,与不使用推理的基线模型相比,该方法在多个社交含义检测任务上取得了显著的性能提升,证明了推理的有效性和通用性。

🎯 应用场景

该研究成果可应用于智能客服、社交媒体分析、心理健康咨询等领域。通过提升机器对对话中社交含义的理解能力,可以改善人机交互体验,更准确地识别用户的情感和意图,并提供更个性化的服务。未来,该技术有望应用于更复杂的社交场景,例如跨文化交流和群体行为分析。

📄 摘要(原文)

We present a generalizable classification approach that leverages Large Language Models (LLMs) to facilitate the detection of implicitly encoded social meaning in conversations. We design a multi-faceted prompt to extract a textual explanation of the reasoning that connects visible cues to underlying social meanings. These extracted explanations or rationales serve as augmentations to the conversational text to facilitate dialogue understanding and transfer. Our empirical results over 2,340 experimental settings demonstrate the significant positive impact of adding these rationales. Our findings hold true for in-domain classification, zero-shot, and few-shot domain transfer for two different social meaning detection tasks, each spanning two different corpora.