Captioning Visualizations with Large Language Models (CVLLM): A Tutorial

作者: Giuseppe Carenini, Jordon Johnson, Ali Salamatian

分类: cs.CL, cs.AI, cs.HC

发布日期: 2024-06-27

备注: 6 pages, 4 figures

💡 一句话要点

利用大型语言模型自动生成可视化图表的标题,探索InfoVis领域的新可能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 可视化标题生成 信息可视化 自然语言生成 图文融合

📋 核心要点

- 现有方法在自动生成可视化图表标题方面存在局限性,难以充分理解图表内容并生成准确、自然的描述。

- 本教程探索利用大型语言模型(LLMs)的强大能力,为可视化图表生成更具信息量和上下文理解的标题。

- 通过回顾InfoVis原则、介绍LLM架构及其在标题生成中的应用,为未来研究方向提供指导。

📝 摘要(中文)

自动生成可视化图表的标题并非全新的研究方向,但大型语言模型(LLMs)的最新进展为此开辟了令人兴奋的新可能性。本教程首先简要回顾信息可视化(InfoVis)的原则和以往在标题生成方面的工作,然后介绍通用LLMs中使用的神经模型和Transformer架构。接着,我们将讨论它们在InfoVis中的最新应用,重点关注标题生成。此外,我们还将探讨该领域有前景的未来方向。

🔬 方法详解

问题定义:论文旨在解决如何利用大型语言模型(LLMs)自动生成高质量的可视化图表标题的问题。现有方法通常依赖于简单的规则或模板,难以捕捉图表的复杂语义和上下文信息,生成的标题缺乏准确性和自然性。此外,现有方法的可扩展性较差,难以适应不同类型的可视化图表。

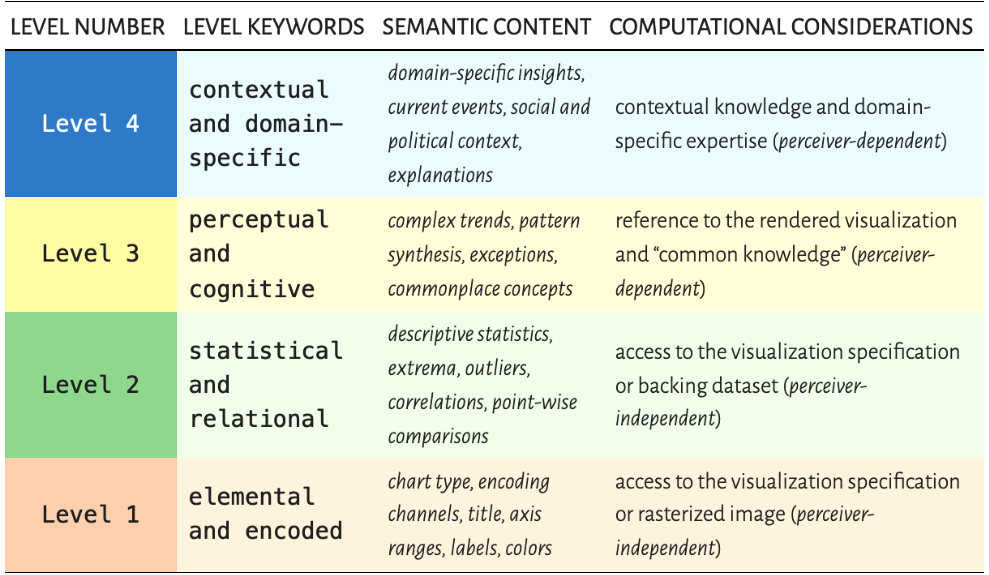

核心思路:论文的核心思路是利用LLMs强大的语言理解和生成能力,将可视化图表作为输入,生成描述图表内容的自然语言标题。通过训练LLMs学习图表和标题之间的映射关系,可以生成更准确、更具信息量的标题。这种方法的关键在于如何有效地将可视化信息融入到LLMs中,并指导LLMs生成符合人类语言习惯的标题。

技术框架:本教程主要介绍LLMs在InfoVis中的应用,特别是标题生成。首先回顾InfoVis的基本原则和相关工作,然后介绍LLMs的架构,包括神经模型和Transformer架构。接着,讨论LLMs在InfoVis中的应用,重点关注标题生成任务。最后,探讨该领域未来的研究方向。整体流程可以概括为:InfoVis基础 -> LLM架构 -> LLM在InfoVis中的应用 -> 未来方向。

关键创新:本教程的关键创新在于强调了LLMs在可视化图表标题生成中的潜力,并为该领域的研究提供了指导。虽然具体的技术创新点未知,但可以推测未来的研究方向可能包括:如何设计更有效的图文融合方法,如何利用LLMs生成更具创造性和个性化的标题,以及如何评估生成标题的质量。

关键设计:由于是教程性质的文章,并没有具体的参数设置、损失函数或网络结构等技术细节。但是,可以推测未来的研究可能需要关注以下关键设计:如何选择合适的LLM模型,如何设计有效的输入表示方法(例如,将图表转换为图像或结构化数据),如何设计合适的损失函数来指导LLM生成高质量的标题,以及如何利用注意力机制来关注图表中的关键区域。

🖼️ 关键图片

📊 实验亮点

由于是教程性质的文章,并没有具体的实验结果。但文章强调了LLMs在可视化图表标题生成中的巨大潜力,并展望了未来的研究方向。未来的研究可以通过实验验证LLMs在不同类型图表上的标题生成效果,并与现有方法进行比较,以评估LLMs的性能提升。

🎯 应用场景

该研究具有广泛的应用前景,例如可以应用于自动生成新闻报道中的图表标题,帮助视力障碍者理解可视化信息,以及提高数据分析和可视化的效率。未来,该技术有望应用于更复杂的场景,例如自动生成数据报告和交互式可视化解释。

📄 摘要(原文)

Automatically captioning visualizations is not new, but recent advances in large language models(LLMs) open exciting new possibilities. In this tutorial, after providing a brief review of Information Visualization (InfoVis) principles and past work in captioning, we introduce neural models and the transformer architecture used in generic LLMs. We then discuss their recent applications in InfoVis, with a focus on captioning. Additionally, we explore promising future directions in this field.