Selective Prompting Tuning for Personalized Conversations with LLMs

作者: Qiushi Huang, Xubo Liu, Tom Ko, Bo Wu, Wenwu Wang, Yu Zhang, Lilian Tang

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-06-26

备注: Accepted to ACL 2024 findings

🔗 代码/项目: GITHUB

💡 一句话要点

提出选择性Prompt调优(SPT)方法,提升LLM在个性化对话中的多样性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 个性化对话 大型语言模型 软提示 选择性Prompt调优 对话生成 上下文理解 对比学习

📋 核心要点

- 现有文本提示方法在个性化对话中难以生成与真实回复相似的回复,而直接微调则容易产生重复或泛化的回复。

- 提出选择性Prompt调优(SPT)方法,通过可训练的密集检索器,根据上下文自适应选择合适的软提示,实现个性化对话。

- 实验结果表明,SPT显著提高了回复多样性,最高提升90%,同时改进了其他关键性能指标,验证了SPT的有效性。

📝 摘要(中文)

在对话式人工智能中,利用人物角色信息和上下文理解进行个性化对话至关重要。尽管大型语言模型(LLM)在生成连贯回复方面有所改进,但有效整合人物角色仍然是一个挑战。本文首先研究了两种常见的LLM个性化方法:文本提示和直接微调。观察发现,文本提示通常难以产生与数据集中真实回复相似的回复,而直接微调则容易产生重复或过于通用的回复。为了缓解这些问题,我们提出了选择性Prompt调优(SPT),以选择性的方式对LLM进行软提示,从而实现个性化对话。具体而言,SPT初始化一组软提示,并使用可训练的密集检索器,根据不同的输入上下文自适应地选择合适的软提示,其中提示检索器通过来自LLM的反馈进行动态更新。此外,我们提出了上下文-提示对比学习和提示融合学习,以鼓励SPT增强个性化对话的多样性。在CONVAI2数据集上的实验表明,SPT显著提高了回复多样性,高达90%,同时改进了其他关键性能指标。这些结果突出了SPT在促进引人入胜的个性化对话生成方面的有效性。SPT模型代码已公开提供,供进一步探索。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在个性化对话中,如何有效整合人物角色信息并生成多样化回复的问题。现有方法,如文本提示,难以生成与真实回复相似的回复;直接微调则容易产生重复或过于通用的回复,缺乏个性化和多样性。

核心思路:论文的核心思路是利用软提示(soft prompt)技术,并引入一个可训练的密集检索器,根据不同的输入上下文,自适应地选择合适的软提示。通过这种选择性的prompt方式,可以更好地捕捉输入上下文的个性化信息,并生成更具多样性的回复。

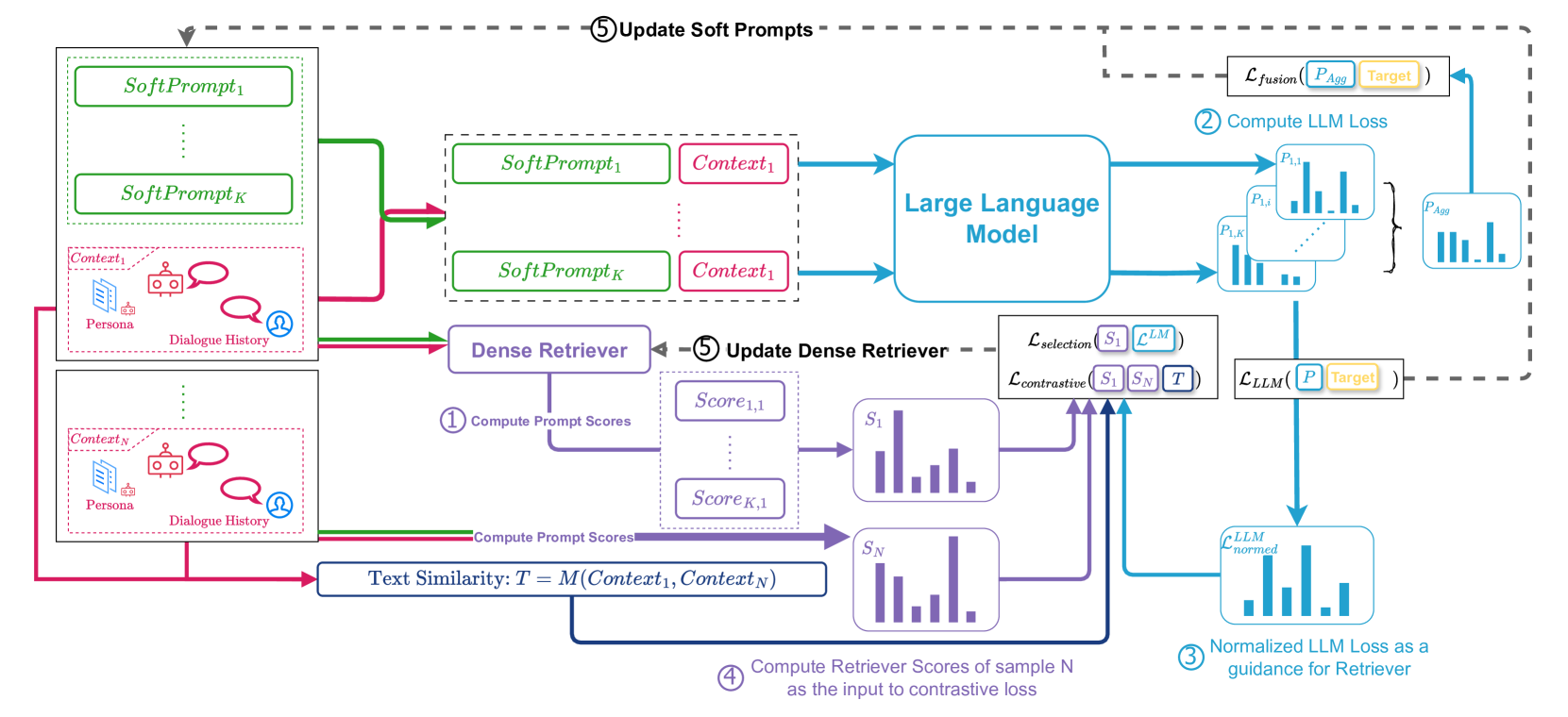

技术框架:SPT的整体框架包含以下几个主要模块:1) 软提示初始化:初始化一组软提示向量。2) 密集检索器:一个可训练的密集检索器,用于根据输入上下文检索合适的软提示。3) LLM:使用检索到的软提示作为输入,生成回复。4) 反馈机制:LLM的输出作为反馈,用于动态更新密集检索器。5) 上下文-提示对比学习和提示融合学习:用于增强个性化对话的多样性。

关键创新:SPT的关键创新在于选择性地使用软提示。与传统的文本提示或直接微调相比,SPT能够根据不同的输入上下文,动态地选择最合适的软提示,从而更好地捕捉个性化信息,并生成更具多样性的回复。此外,上下文-提示对比学习和提示融合学习进一步增强了回复的多样性。

关键设计:SPT的关键设计包括:1) 密集检索器的训练:使用对比学习方法训练密集检索器,使其能够根据输入上下文检索到最相关的软提示。2) 上下文-提示对比学习:通过对比学习,鼓励模型学习到上下文和提示之间的关联性,从而提高提示选择的准确性。3) 提示融合学习:通过融合不同的软提示,生成更具多样性的回复。4) 损失函数:使用了交叉熵损失函数、对比损失函数等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SPT在CONVAI2数据集上显著提高了回复多样性,最高提升90%。同时,SPT在其他关键性能指标,如流畅度、相关性等方面也取得了显著提升。这些结果表明,SPT能够有效地提升LLM在个性化对话中的性能,并生成更具吸引力的对话。

🎯 应用场景

该研究成果可应用于各种需要个性化对话的场景,例如智能客服、虚拟助手、社交聊天机器人等。通过提升LLM在个性化对话中的多样性和准确性,可以提高用户满意度,增强用户粘性,并为用户提供更优质的对话体验。未来,该技术有望在教育、医疗等领域发挥重要作用。

📄 摘要(原文)

In conversational AI, personalizing dialogues with persona profiles and contextual understanding is essential. Despite large language models' (LLMs) improved response coherence, effective persona integration remains a challenge. In this work, we first study two common approaches for personalizing LLMs: textual prompting and direct fine-tuning. We observed that textual prompting often struggles to yield responses that are similar to the ground truths in datasets, while direct fine-tuning tends to produce repetitive or overly generic replies. To alleviate those issues, we propose \textbf{S}elective \textbf{P}rompt \textbf{T}uning (SPT), which softly prompts LLMs for personalized conversations in a selective way. Concretely, SPT initializes a set of soft prompts and uses a trainable dense retriever to adaptively select suitable soft prompts for LLMs according to different input contexts, where the prompt retriever is dynamically updated through feedback from the LLMs. Additionally, we propose context-prompt contrastive learning and prompt fusion learning to encourage the SPT to enhance the diversity of personalized conversations. Experiments on the CONVAI2 dataset demonstrate that SPT significantly enhances response diversity by up to 90\%, along with improvements in other critical performance indicators. Those results highlight the efficacy of SPT in fostering engaging and personalized dialogue generation. The SPT model code (https://github.com/hqsiswiliam/SPT) is publicly available for further exploration.