Octo-planner: On-device Language Model for Planner-Action Agents

作者: Wei Chen, Zhiyuan Li, Zhen Guo, Yikang Shen

分类: cs.CL, cs.HC

发布日期: 2024-06-26

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出Octo-planner,一种基于端侧语言模型的规划-行动智能体框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 端侧智能体 语言模型 规划-行动框架 Phi-3 Mini 多LoRA训练

📋 核心要点

- 现有AI智能体在资源受限设备上进行复杂规划时,面临计算成本高、能耗大和响应时间长等挑战。

- Octo-planner通过分离规划和行动执行,并利用轻量级语言模型Phi-3 Mini进行微调,实现了高效的端侧规划。

- 实验表明,Octo-planner在领域内测试环境中实现了97%的成功率,并通过多LoRA训练方法有效处理多领域规划任务。

📝 摘要(中文)

本文提出了一种高效的端侧规划-行动框架Octo-planner,将规划和行动执行分离为两个独立组件:一个基于Phi-3 Mini(38亿参数,针对边缘设备优化)的规划智能体,以及一个使用Octopus模型执行功能的行动智能体。规划智能体首先响应用户查询,将任务分解为一系列子步骤,然后由行动智能体执行。为了优化资源受限设备上的性能,我们采用模型微调而非上下文学习,从而降低计算成本和能耗,同时缩短响应时间。我们使用GPT-4生成基于可用功能的各种规划查询和响应,并进行验证以确保数据质量。我们在此数据集上微调Phi-3 Mini模型,在领域内测试环境中实现了97%的成功率。为了应对多领域规划挑战,我们开发了一种多LoRA训练方法,该方法合并了从不同功能子集训练的LoRA权重。这种方法能够灵活处理复杂的多领域查询,同时保持资源受限设备上的计算效率。我们已开源模型权重,并提供在线演示。

🔬 方法详解

问题定义:论文旨在解决AI智能体在资源受限设备上进行复杂规划时面临的挑战。现有方法,如上下文学习,计算成本高昂,能耗大,且响应时间长,难以在边缘设备上有效部署。因此,需要一种更高效的端侧规划解决方案。

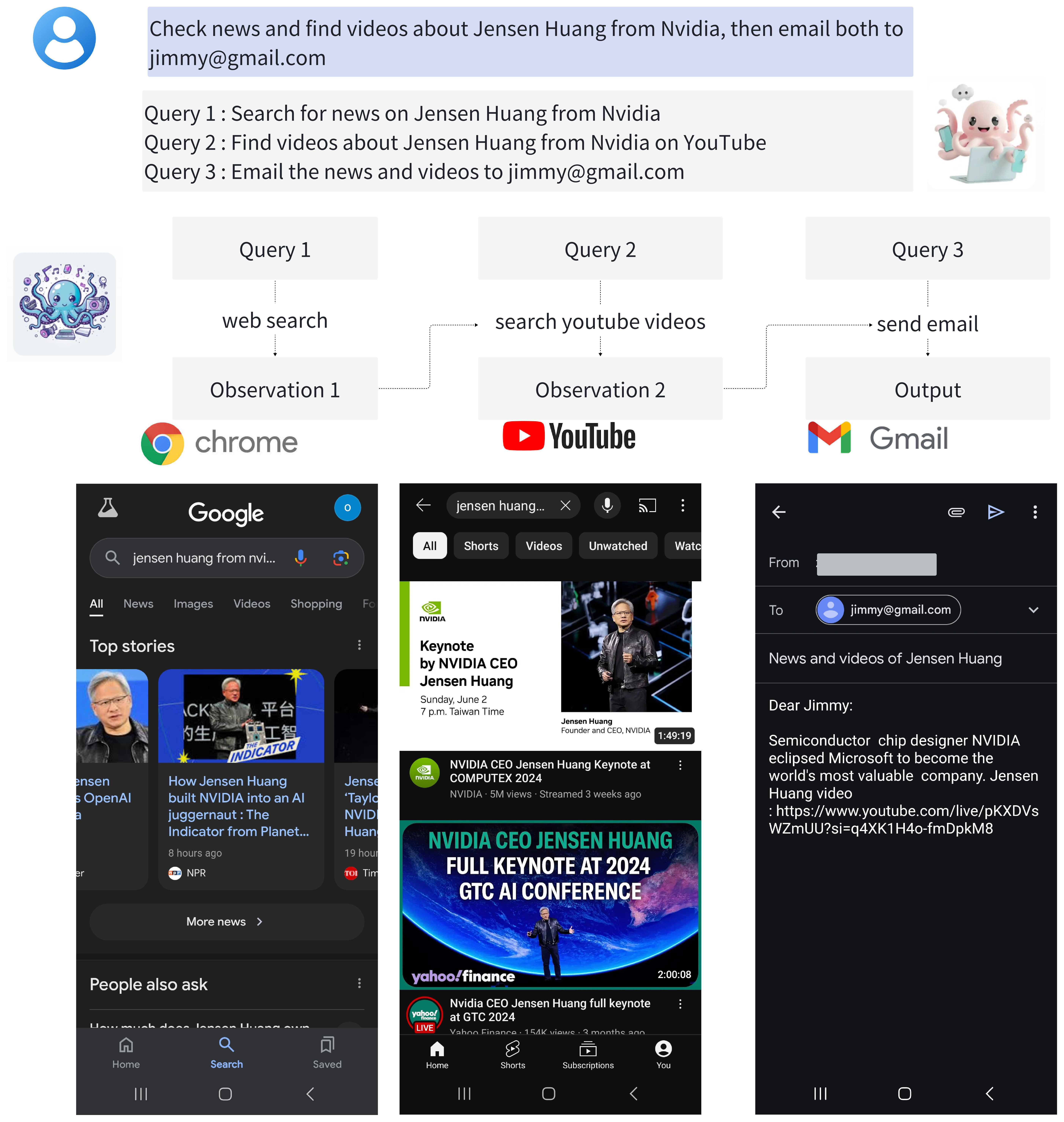

核心思路:论文的核心思路是将规划和行动执行分离为两个独立的模块。规划模块负责将用户查询分解为一系列子步骤,行动模块负责执行这些子步骤。通过这种分离,可以将复杂的规划任务分解为更小的、更易于管理的子任务,从而降低计算复杂度。同时,利用轻量级语言模型Phi-3 Mini进行微调,进一步提升效率。

技术框架:Octo-planner框架包含两个主要模块:规划智能体和行动智能体。规划智能体基于Phi-3 Mini,负责接收用户查询并将其分解为一系列子步骤。行动智能体基于Octopus模型,负责执行规划智能体生成的子步骤。为了训练规划智能体,首先使用GPT-4生成大量规划查询和响应数据,然后对Phi-3 Mini模型进行微调。为了处理多领域规划任务,采用多LoRA训练方法,将不同功能子集训练的LoRA权重进行合并。

关键创新:论文的关键创新在于以下几点:1) 提出了一种分离规划和行动执行的框架,降低了计算复杂度;2) 利用轻量级语言模型Phi-3 Mini进行微调,提升了端侧部署的效率;3) 采用多LoRA训练方法,有效处理多领域规划任务。与现有方法相比,Octo-planner更加高效、节能,且能够更好地适应资源受限的边缘设备。

关键设计:论文的关键设计包括:1) 使用GPT-4生成高质量的训练数据,保证了微调效果;2) 针对Phi-3 Mini模型进行微调,而非采用上下文学习,降低了计算成本;3) 采用多LoRA训练方法,通过合并不同功能子集的LoRA权重,实现了多领域规划能力。具体参数设置和损失函数等细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Octo-planner在领域内测试环境中实现了97%的成功率。通过多LoRA训练方法,该框架能够有效处理多领域规划任务,并在资源受限的设备上保持高效的计算性能。这些结果验证了Octo-planner在端侧规划任务中的有效性和实用性。

🎯 应用场景

Octo-planner具有广泛的应用前景,例如智能家居、移动机器人、自动驾驶等领域。它可以使这些设备在本地进行复杂的规划和决策,而无需依赖云端服务器,从而提高响应速度、保护用户隐私,并降低网络延迟。未来,该技术有望进一步推动边缘计算和人工智能的发展。

📄 摘要(原文)

AI agents have become increasingly significant in various domains, enabling autonomous decision-making and problem-solving. To function effectively, these agents require a planning process that determines the best course of action and then executes the planned actions. In this paper, we present an efficient on-device Planner-Action framework that separates planning and action execution into two distinct components: a planner agent based on Phi-3 Mini, a 3.8 billion parameter LLM optimized for edge devices, and an action agent using the Octopus model for function execution. The planner agent first responds to user queries by decomposing tasks into a sequence of sub-steps, which are then executed by the action agent. To optimize performance on resource-constrained devices, we employ model fine-tuning instead of in-context learning, reducing computational costs and energy consumption while improving response times. Our approach involves using GPT-4 to generate diverse planning queries and responses based on available functions, with subsequent validations to ensure data quality. We fine-tune the Phi-3 Mini model on this curated dataset, achieving a 97\% success rate in our in-domain test environment. To address multi-domain planning challenges, we developed a multi-LoRA training method that merges weights from LoRAs trained on distinct function subsets. This approach enables flexible handling of complex, multi-domain queries while maintaining computational efficiency on resource-constrained devices. To support further research, we have open-sourced our model weights at \url{https://huggingface.co/NexaAIDev/octopus-planning}. For the demo, please refer to \url{https://www.nexa4ai.com/octo-planner}.