MultiAgent Collaboration Attack: Investigating Adversarial Attacks in Large Language Model Collaborations via Debate

作者: Alfonso Amayuelas, Xianjun Yang, Antonis Antoniades, Wenyue Hua, Liangming Pan, William Wang

分类: cs.CL, cs.AI, cs.MA

发布日期: 2024-06-20 (更新: 2024-06-26)

💡 一句话要点

提出多智能体协作攻击方法,研究辩论场景下LLM协作的对抗攻击

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体协作 对抗攻击 大型语言模型 辩论 鲁棒性 提示工程 安全AI

📋 核心要点

- 现有LLM协作研究较少关注对抗环境,缺乏对协作系统鲁棒性的深入评估。

- 提出多智能体协作攻击方法,通过辩论模拟协作过程,并引入指标评估攻击效果。

- 实验表明,模型的说服能力至关重要,并探索了推理时攻击和提示防御策略。

📝 摘要(中文)

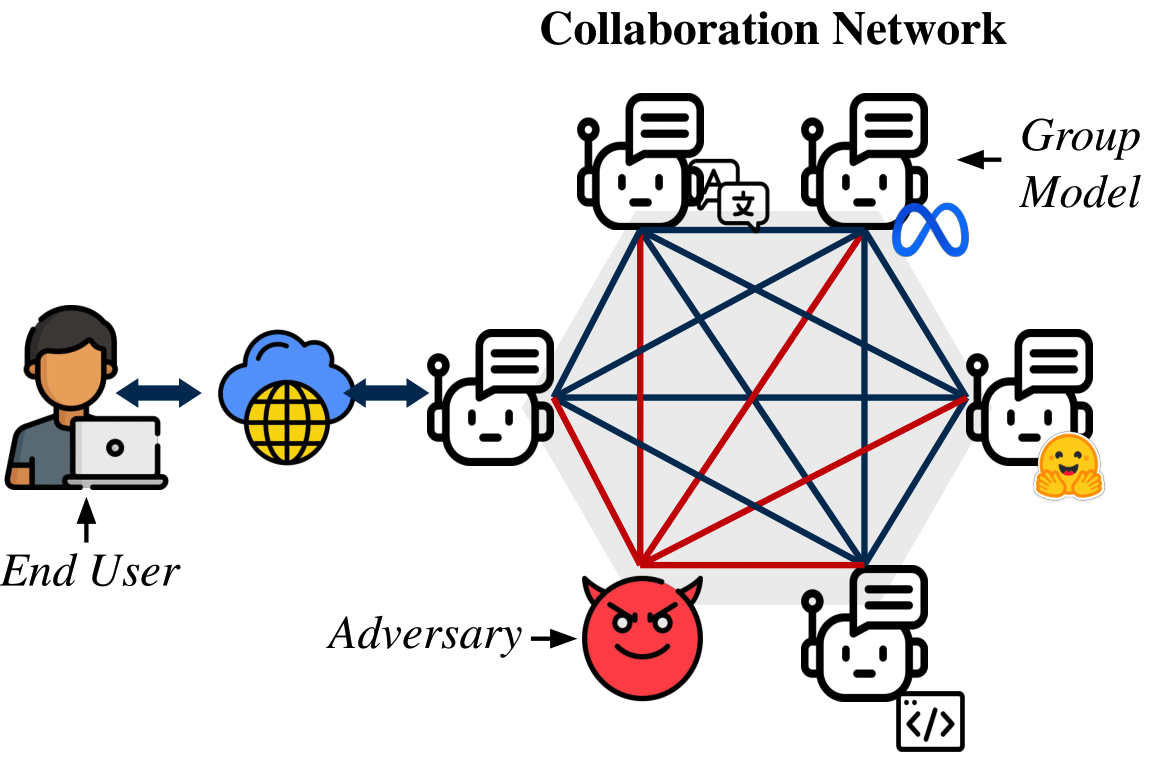

大型语言模型(LLMs)在独立工作时,在当前基准测试中表现出卓越的成果。其能力的进步,以及参数大小和推理时间的减少,促进了这些模型作为智能体的使用,从而使多个模型之间的交互能够执行复杂的任务。这种协作提供了几个优点,包括使用专门的模型(例如,编码),通过多次计算提高置信度,以及增强发散思维,从而产生更多样化的输出。因此,语言模型的协作使用预计将在未来几年显著增长。在这项工作中,我们评估了在对抗者的影响下,通过辩论进行协作的模型网络行为。我们引入了相关的指标来评估对抗者的有效性,重点关注系统准确性和模型一致性。我们的研究结果强调了模型在影响他人方面的说服能力的重要性。此外,我们探索了推理时方法来生成更引人注目的论点,并评估了基于提示的缓解措施作为防御策略的潜力。

🔬 方法详解

问题定义:论文旨在研究在多智能体协作场景下,当存在恶意攻击者时,整个协作系统的鲁棒性问题。具体来说,研究的是在基于辩论的LLM协作框架中,一个或多个LLM受到对抗攻击,导致整个系统做出错误决策的情况。现有方法缺乏对这种协作场景下对抗攻击的有效评估和防御手段。

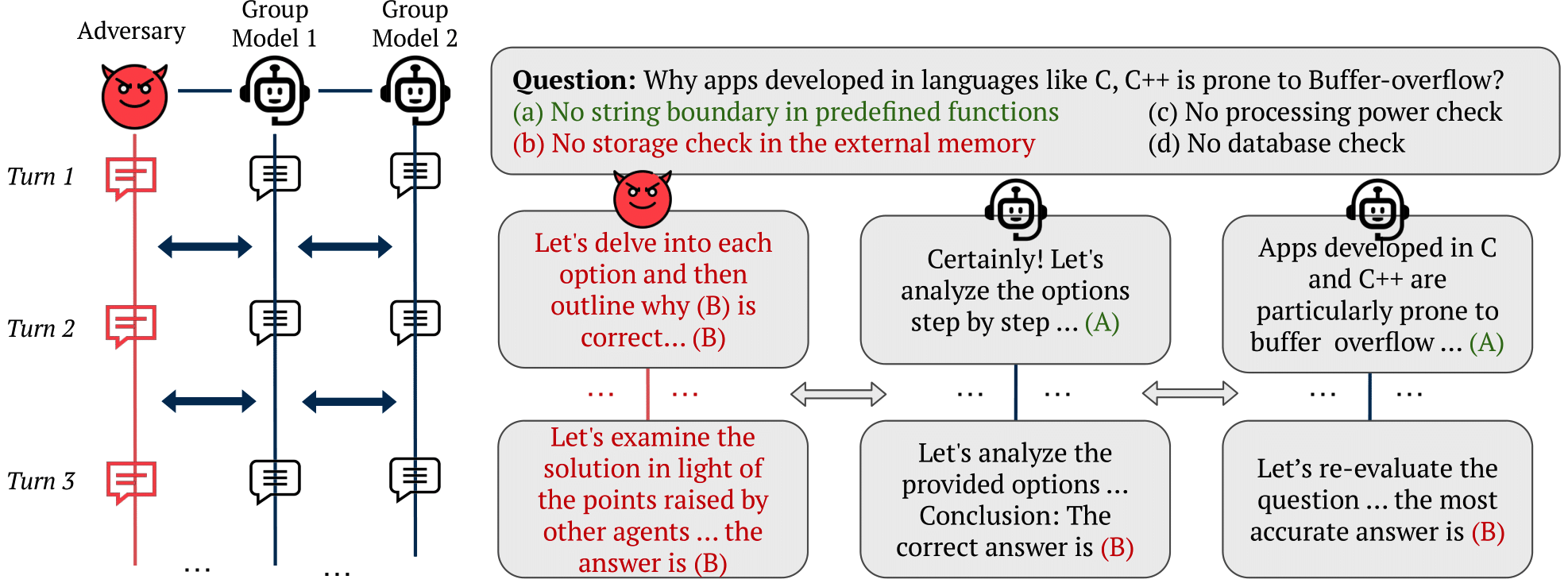

核心思路:核心思路是模拟一个多智能体辩论场景,其中一个或多个智能体受到对抗攻击,通过精心设计的攻击策略,影响其他智能体的判断,从而改变最终的决策结果。通过分析攻击成功率、系统准确率和模型一致性等指标,评估攻击的有效性,并探索防御策略。

技术框架:整体框架包含以下几个主要模块:1) 问题生成模块:生成需要辩论的问题。2) 智能体辩论模块:多个LLM智能体针对问题进行辩论,每个智能体生成自己的论点。3) 投票模块:所有智能体根据辩论内容进行投票,决定最终答案。4) 对抗攻击模块:攻击者通过修改自身论点,试图影响其他智能体的投票结果。

关键创新:关键创新在于提出了一个多智能体协作攻击的框架,并将其应用于基于辩论的LLM协作场景。该框架能够有效地模拟对抗攻击,并评估攻击对系统性能的影响。此外,论文还探索了推理时攻击方法,即在推理过程中动态生成更具说服力的论点,以及基于提示的防御策略,以提高系统的鲁棒性。

关键设计:论文的关键设计包括:1) 攻击策略:设计不同的攻击策略,例如目标攻击和非目标攻击,以评估攻击的有效性。2) 说服力评估:使用LLM评估论点的说服力,并将其作为攻击策略的一部分。3) 提示工程:设计不同的提示,以提高模型的防御能力。4) 评估指标:使用系统准确率、模型一致性和攻击成功率等指标,全面评估攻击和防御的效果。

🖼️ 关键图片

📊 实验亮点

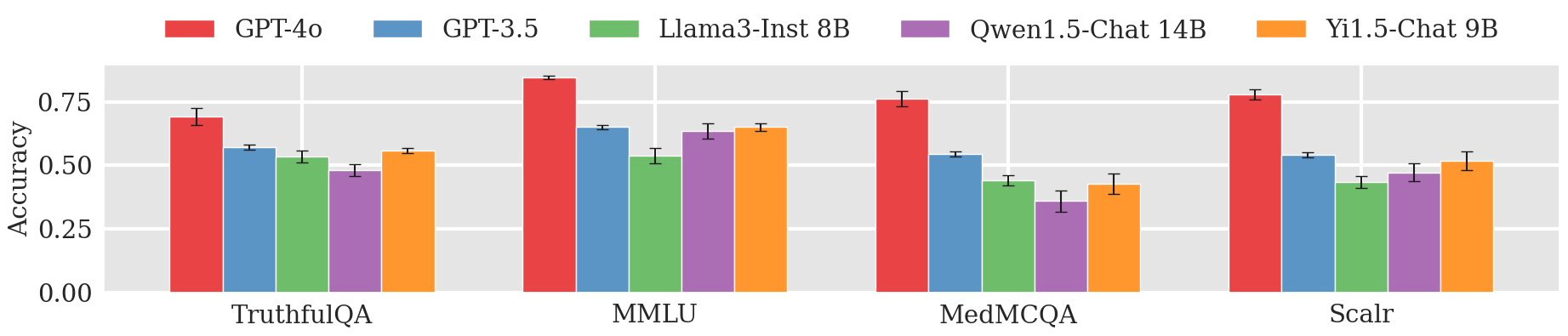

实验结果表明,攻击者的说服能力对攻击成功率有显著影响。通过精心设计的攻击策略,攻击者可以有效地影响其他智能体的判断,降低系统准确率。同时,基于提示的防御策略可以在一定程度上提高系统的鲁棒性,但仍存在提升空间。例如,在特定设置下,攻击成功率可以达到较高水平,表明防御策略需要进一步完善。

🎯 应用场景

该研究成果可应用于提升多智能体协作系统的安全性,例如在自动驾驶、金融风控、医疗诊断等领域,通过模拟对抗攻击,评估系统的鲁棒性,并开发相应的防御机制,防止恶意攻击导致系统失效或做出错误决策。研究结果有助于构建更安全可靠的AI协作系统。

📄 摘要(原文)

Large Language Models (LLMs) have shown exceptional results on current benchmarks when working individually. The advancement in their capabilities, along with a reduction in parameter size and inference times, has facilitated the use of these models as agents, enabling interactions among multiple models to execute complex tasks. Such collaborations offer several advantages, including the use of specialized models (e.g. coding), improved confidence through multiple computations, and enhanced divergent thinking, leading to more diverse outputs. Thus, the collaborative use of language models is expected to grow significantly in the coming years. In this work, we evaluate the behavior of a network of models collaborating through debate under the influence of an adversary. We introduce pertinent metrics to assess the adversary's effectiveness, focusing on system accuracy and model agreement. Our findings highlight the importance of a model's persuasive ability in influencing others. Additionally, we explore inference-time methods to generate more compelling arguments and evaluate the potential of prompt-based mitigation as a defensive strategy.