Knowledge Graph-Enhanced Large Language Models via Path Selection

作者: Haochen Liu, Song Wang, Yaochen Zhu, Yushun Dong, Jundong Li

分类: cs.CL, cs.AI

发布日期: 2024-06-19

💡 一句话要点

提出KELP框架,通过路径选择增强知识图谱赋能的大语言模型,提升事实准确性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 大型语言模型 事实准确性 路径选择 语义匹配

📋 核心要点

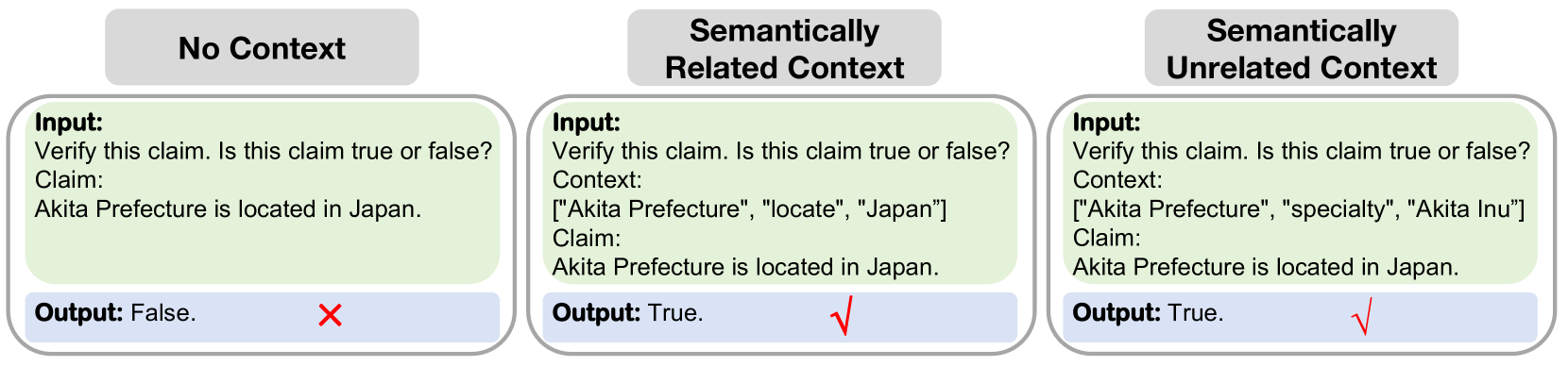

- 现有方法依赖LLM自身进行知识图谱知识提取,缺乏灵活性,只能进行二元判断,且易忽略间接语义知识。

- KELP框架通过潜在语义匹配为知识路径评分,实现细粒度的知识提取,并考虑间接语义关系。

- 实验结果表明,KELP在真实数据集上有效,验证了其在提升LLM事实准确性方面的潜力。

📝 摘要(中文)

大型语言模型(LLM)在各种实际应用中表现出前所未有的性能。然而,它们也存在生成不准确事实的问题,即幻觉问题。近年来,结合从知识图谱(KG)中提取的外部知识已成为提高LLM生成输出的事实准确性的有希望的策略。然而,大多数现有探索依赖于LLM本身来执行KG知识提取,这是非常不灵活的,因为LLM只能对某个知识(例如,KG中的知识路径)是否应该使用提供二元判断。此外,LLM倾向于仅选择与输入文本具有直接语义关系的知识,而可能忽略具有间接语义关系的潜在有用知识。在这项工作中,我们提出了一个原则性的框架KELP,它包含三个阶段来处理上述问题。具体来说,KELP能够通过潜在语义匹配为具有输入文本的知识路径生成分数,从而实现更细粒度的灵活知识提取。同时,还可以通过KG中选定路径与输入文本之间的训练编码来考虑与输入文本具有间接语义关系的知识路径。在真实世界数据集上的实验验证了KELP的有效性。

🔬 方法详解

问题定义:现有方法在利用知识图谱增强大语言模型时,主要依赖LLM自身进行知识提取,这导致两个主要问题:一是提取粒度粗糙,LLM只能进行二元判断,无法区分知识路径的重要性;二是容易忽略与输入文本具有间接语义关系的知识,导致信息不完整,影响生成结果的准确性。这些痛点限制了知识图谱对LLM的有效赋能。

核心思路:KELP的核心思路是通过引入路径选择机制,更精细地评估知识图谱中知识路径与输入文本的相关性。它不再依赖LLM进行简单的二元判断,而是通过潜在语义匹配为每个知识路径打分,从而实现更灵活、更细粒度的知识提取。同时,KELP还考虑了间接语义关系,避免遗漏潜在有用的知识。

技术框架:KELP框架包含三个主要阶段:1) 知识路径生成:从知识图谱中提取与输入文本相关的候选知识路径。2) 路径评分:利用潜在语义匹配模型,为每个知识路径生成一个分数,该分数反映了路径与输入文本的相关性。3) 知识融合:根据路径分数,选择合适的知识路径,并将其融入到LLM的输入中,从而指导LLM生成更准确的事实。

关键创新:KELP的关键创新在于其细粒度的知识路径选择机制。与现有方法相比,KELP不再依赖LLM进行二元判断,而是通过潜在语义匹配模型为每个知识路径打分,从而实现更灵活、更准确的知识提取。此外,KELP还考虑了间接语义关系,避免遗漏潜在有用的知识,这使得KELP能够更有效地利用知识图谱来增强LLM。

关键设计:KELP的关键设计包括:1) 潜在语义匹配模型:该模型用于计算知识路径与输入文本之间的相关性分数。具体实现方式未知,但推测可能采用Transformer或其他深度学习模型。2) 路径选择策略:根据路径分数选择合适的知识路径。具体策略未知,可能采用Top-K选择或基于阈值的选择。3) 知识融合方法:将选定的知识路径融入到LLM的输入中。具体方法未知,可能采用拼接、注意力机制或其他融合策略。

🖼️ 关键图片

📊 实验亮点

论文通过在真实世界数据集上进行实验,验证了KELP框架的有效性。具体性能数据和对比基线未知,但摘要表明KELP能够提高LLM生成输出的事实准确性。实验结果表明,KELP在知识图谱增强LLM方面具有显著优势。

🎯 应用场景

KELP框架可应用于各种需要事实准确性的LLM应用场景,例如问答系统、知识图谱补全、文本摘要和对话生成。通过提升LLM生成内容的准确性和可靠性,KELP可以提高用户满意度,并减少错误信息的传播。未来,KELP可以进一步扩展到处理更复杂的知识图谱结构和更广泛的知识类型。

📄 摘要(原文)

Large Language Models (LLMs) have shown unprecedented performance in various real-world applications. However, they are known to generate factually inaccurate outputs, a.k.a. the hallucination problem. In recent years, incorporating external knowledge extracted from Knowledge Graphs (KGs) has become a promising strategy to improve the factual accuracy of LLM-generated outputs. Nevertheless, most existing explorations rely on LLMs themselves to perform KG knowledge extraction, which is highly inflexible as LLMs can only provide binary judgment on whether a certain knowledge (e.g., a knowledge path in KG) should be used. In addition, LLMs tend to pick only knowledge with direct semantic relationship with the input text, while potentially useful knowledge with indirect semantics can be ignored. In this work, we propose a principled framework KELP with three stages to handle the above problems. Specifically, KELP is able to achieve finer granularity of flexible knowledge extraction by generating scores for knowledge paths with input texts via latent semantic matching. Meanwhile, knowledge paths with indirect semantic relationships with the input text can also be considered via trained encoding between the selected paths in KG and the input text. Experiments on real-world datasets validate the effectiveness of KELP.