Test of Time: A Benchmark for Evaluating LLMs on Temporal Reasoning

作者: Bahare Fatemi, Mehran Kazemi, Anton Tsitsulin, Karishma Malkan, Jinyeong Yim, John Palowitch, Sungyong Seo, Jonathan Halcrow, Bryan Perozzi

分类: cs.CL

发布日期: 2024-06-13

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

提出Test of Time基准,评估LLM在时间推理上的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 时间推理 合成数据集 基准测试 LLM评估

📋 核心要点

- 现有时间推理数据集存在LLM预训练数据泄露或匿名化引入不一致的问题,影响评估的准确性。

- 论文构建了新的合成数据集,通过控制问题结构、大小等因素,系统评估LLM的时间推理能力。

- 实验结果揭示了现有LLM在时间推理方面的优缺点,为后续研究提供了有价值的参考。

📝 摘要(中文)

大型语言模型(LLM)展现了卓越的推理能力,但在涉及复杂时间逻辑的时间推理任务中仍然容易出错。现有研究已经使用各种数据集和基准探索了LLM在时间推理方面的性能。然而,这些研究通常依赖于LLM在预训练期间可能已经遇到的真实世界数据,或者采用匿名化技术,这些技术可能会无意中引入事实不一致性。为了解决这些限制,本文引入了专门设计的合成数据集,用于评估LLM在各种场景下的时间推理能力。这些数据集的多样性使得能够系统地研究问题结构、大小、问题类型、事实顺序和其他因素对LLM性能的影响。研究结果为当前LLM在时间推理任务中的优势和劣势提供了有价值的见解。为了促进该领域的进一步研究,我们将开源实验中使用的数据集和评估框架。

🔬 方法详解

问题定义:现有LLM在时间推理任务中表现出不足,而现有的评估数据集存在两个主要问题:一是使用了LLM可能在预训练阶段已经接触过的真实世界数据,导致评估结果不准确;二是采用匿名化技术可能会引入事实上的不一致,影响评估的可靠性。因此,需要一个专门设计、可控且避免数据泄露的基准来评估LLM的时间推理能力。

核心思路:论文的核心思路是构建合成数据集,通过控制数据集的各种属性(如问题结构、大小、问题类型、事实顺序等),来系统地评估LLM在不同场景下的时间推理能力。这种方法避免了使用真实世界数据可能导致的数据泄露问题,并且能够更精确地分析不同因素对LLM性能的影响。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 设计合成数据集的生成规则,确保数据集的多样性和可控性;2) 构建不同类型的测试问题,涵盖各种时间推理场景;3) 使用构建的数据集对多个LLM进行评估;4) 分析实验结果,揭示LLM在时间推理方面的优势和劣势。整个框架围绕着合成数据集的构建和LLM的评估展开。

关键创新:该论文的关键创新在于提出了一个用于评估LLM时间推理能力的合成数据集基准。与以往使用真实世界数据或匿名化数据的研究不同,该基准通过合成数据的方式避免了数据泄露和事实不一致的问题,从而能够更准确地评估LLM的时间推理能力。此外,该基准还允许研究人员系统地研究不同因素对LLM性能的影响。

关键设计:数据集生成过程中,关键设计包括:问题类型的多样性(例如,时间顺序判断、时间间隔计算等),事实陈述的顺序(正序、逆序、乱序),以及数据集的大小。评估指标的选择也至关重要,需要能够准确反映LLM在不同时间推理场景下的性能。

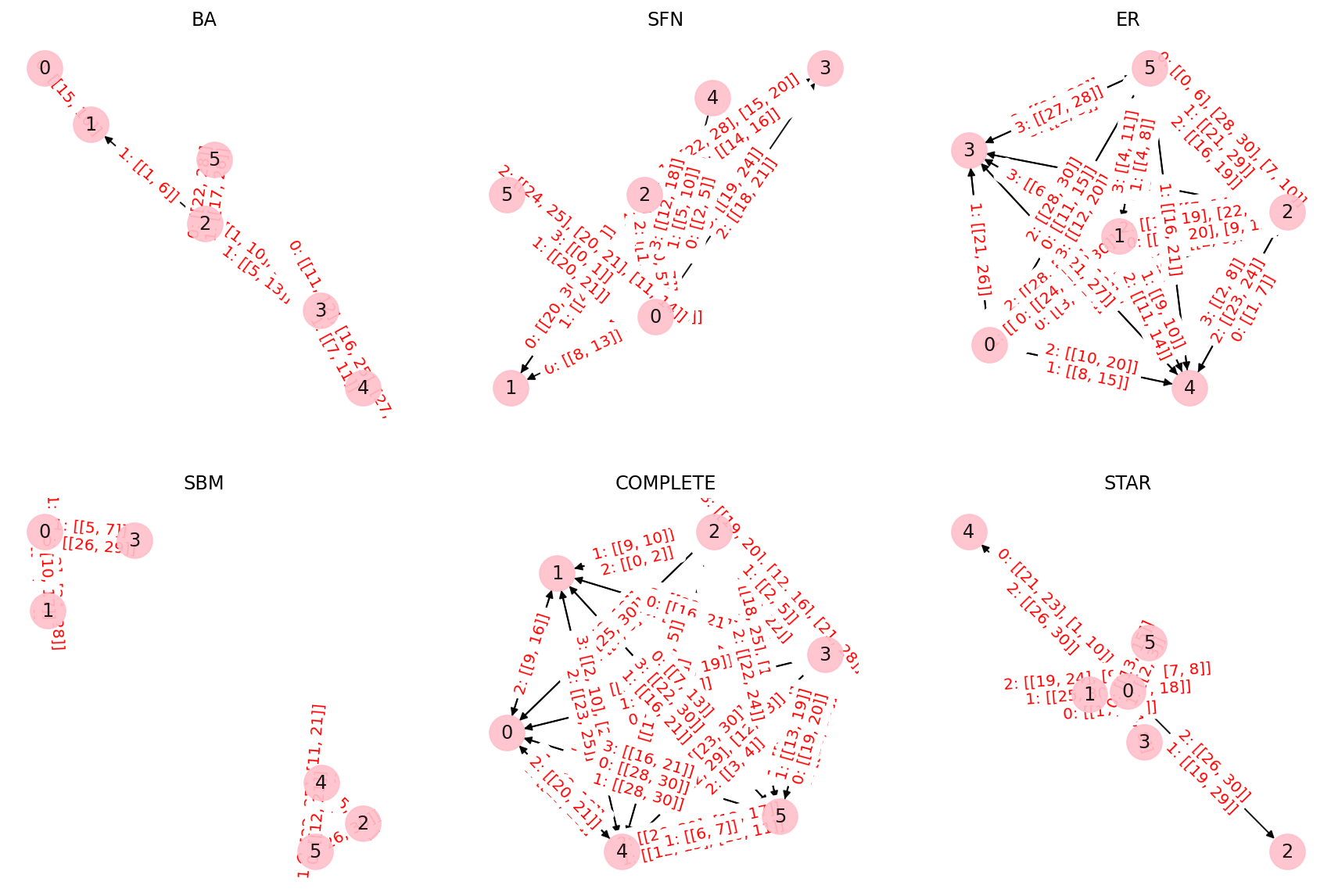

🖼️ 关键图片

📊 实验亮点

该研究通过构建合成数据集,系统地评估了多个LLM在时间推理任务中的性能。实验结果表明,LLM在处理不同类型的时间推理问题时表现出不同的优缺点。例如,某些LLM在处理时间顺序判断问题时表现良好,但在处理时间间隔计算问题时则表现较差。此外,事实陈述的顺序也会显著影响LLM的性能。这些发现为改进LLM的时间推理能力提供了重要的指导。

🎯 应用场景

该研究成果可应用于评估和改进LLM在需要时间推理的各种应用场景中的性能,例如:历史事件分析、医疗诊断、金融预测等。通过使用该基准,可以更好地了解LLM在处理时间相关信息方面的能力,并针对性地进行优化,提高LLM在实际应用中的可靠性和准确性。

📄 摘要(原文)

Large language models (LLMs) have showcased remarkable reasoning capabilities, yet they remain susceptible to errors, particularly in temporal reasoning tasks involving complex temporal logic. Existing research has explored LLM performance on temporal reasoning using diverse datasets and benchmarks. However, these studies often rely on real-world data that LLMs may have encountered during pre-training or employ anonymization techniques that can inadvertently introduce factual inconsistencies. In this work, we address these limitations by introducing novel synthetic datasets specifically designed to assess LLM temporal reasoning abilities in various scenarios. The diversity of question types across these datasets enables systematic investigation into the impact of the problem structure, size, question type, fact order, and other factors on LLM performance. Our findings provide valuable insights into the strengths and weaknesses of current LLMs in temporal reasoning tasks. To foster further research in this area, we are open-sourcing the datasets and evaluation framework used in our experiments: https://huggingface.co/datasets/baharef/ToT.