Delta-CoMe: Training-Free Delta-Compression with Mixed-Precision for Large Language Models

作者: Bowen Ping, Shuo Wang, Hanqing Wang, Xu Han, Yuzhuang Xu, Yukun Yan, Yun Chen, Baobao Chang, Zhiyuan Liu, Maosong Sun

分类: cs.CL

发布日期: 2024-06-13 (更新: 2024-11-26)

备注: NeurIPS 2024

💡 一句话要点

Delta-CoMe:面向大语言模型的混合精度无训练Delta压缩

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 模型压缩 Delta压缩 混合精度量化 奇异值分解

📋 核心要点

- 现有低秩和低比特压缩方法在压缩特定任务微调LLM的delta权重时,会显著降低模型性能。

- Delta-CoMe利用delta权重奇异值的长尾分布特性,对不同奇异值采用混合精度量化,提升压缩性能。

- 实验表明,Delta-CoMe在多种LLM和任务上优于低秩和低比特基线,且与多种骨干LLM兼容。

📝 摘要(中文)

微调是将大型语言模型(LLM)适配到各种应用的关键过程。在多租户服务等场景中,部署多个LLM以满足复杂需求变得必要。最近的研究表明,可以将微调后的LLM分解为基础模型和相应的delta权重,然后使用低秩或低比特方法压缩这些权重以降低成本。然而,我们观察到现有的低秩和低比特压缩方法可能会严重损害特定任务微调的LLM(例如,用于数学问题的WizardMath)的性能。受delta权重中奇异值长尾分布的启发,我们提出了一种使用混合精度的delta量化方法。该方法对对应于较大奇异值的奇异向量采用更高比特的表示。我们在各种微调后的LLM上评估了我们的方法,包括数学LLM、代码LLM、聊天LLM,甚至VLMs。实验结果表明,我们的方法与完全微调的LLM相比具有可比的性能,并且大大超过了低秩和低比特基线。此外,我们表明我们的方法与各种骨干LLM(如Llama-2、Llama-3和Mistral)兼容,突出了其通用性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型微调后部署成本高的问题。现有低秩和低比特压缩方法在压缩delta权重时,会造成显著的性能损失,尤其是在特定任务上微调的模型上,无法在压缩率和模型性能之间取得平衡。

核心思路:论文的核心思路是利用delta权重奇异值的长尾分布特性,即少数奇异值占据了绝大部分能量。因此,对较大的奇异值对应的奇异向量使用更高的精度,而对较小的奇异值对应的奇异向量使用较低的精度,从而在保证模型性能的同时实现高效压缩。

技术框架:Delta-CoMe方法主要包含以下步骤:1) 对微调后的LLM进行分解,得到基础模型和delta权重。2) 对delta权重进行奇异值分解(SVD)。3) 根据奇异值的大小,将奇异向量分组,并对不同组的奇异向量采用不同的量化精度。4) 将量化后的奇异向量和奇异值存储起来,用于模型推理。在推理时,将量化后的奇异向量和奇异值恢复成delta权重,并与基础模型进行合并。

关键创新:Delta-CoMe的关键创新在于提出了混合精度量化方法,该方法能够根据奇异值的重要性自适应地调整量化精度,从而在保证模型性能的同时实现高效压缩。与传统的低秩和低比特压缩方法相比,Delta-CoMe能够更好地保留delta权重中的重要信息,从而避免了性能损失。

关键设计:Delta-CoMe的关键设计包括:1) 如何确定不同奇异向量组的量化精度。论文采用了一种基于奇异值大小的阈值方法,将奇异向量分为多个组,并为每个组分配不同的量化精度。2) 如何选择合适的量化方法。论文采用了均匀量化方法,该方法简单易用,且能够有效地降低存储空间。

🖼️ 关键图片

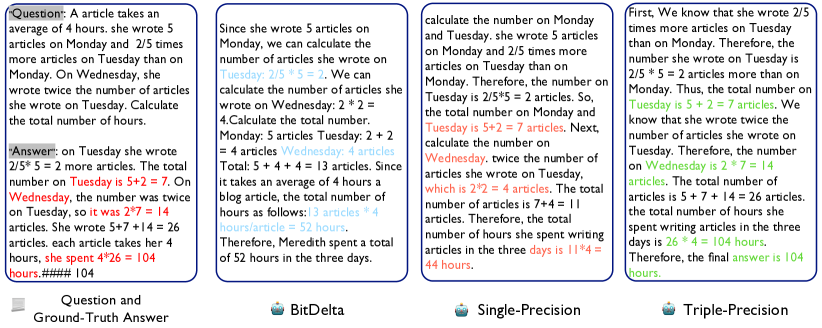

📊 实验亮点

实验结果表明,Delta-CoMe在各种微调后的LLM上表现出色,包括数学LLM、代码LLM、聊天LLM和VLMs。与完全微调的LLM相比,Delta-CoMe实现了可比的性能,并且大大超过了低秩和低比特基线。例如,在某些任务上,Delta-CoMe的性能提升超过了10%。此外,Delta-CoMe与Llama-2、Llama-3和Mistral等多种骨干LLM兼容,展示了其良好的通用性。

🎯 应用场景

Delta-CoMe适用于需要部署多个微调LLM的场景,如多租户服务、个性化推荐、智能客服等。通过高效压缩delta权重,Delta-CoMe可以显著降低模型存储和传输成本,提高部署效率,并支持在资源受限的设备上运行大型语言模型。该方法还有助于推动LLM在边缘计算和移动设备上的应用。

📄 摘要(原文)

Fine-tuning is a crucial process for adapting large language models (LLMs) to diverse applications. In certain scenarios, such as multi-tenant serving, deploying multiple LLMs becomes necessary to meet complex demands. Recent studies suggest decomposing a fine-tuned LLM into a base model and corresponding delta weights, which are then compressed using low-rank or low-bit approaches to reduce costs. In this work, we observe that existing low-rank and low-bit compression methods can significantly harm the model performance for task-specific fine-tuned LLMs (e.g., WizardMath for math problems). Motivated by the long-tail distribution of singular values in the delta weights, we propose a delta quantization approach using mixed-precision. This method employs higher-bit representation for singular vectors corresponding to larger singular values. We evaluate our approach on various fine-tuned LLMs, including math LLMs, code LLMs, chat LLMs, and even VLMs. Experimental results demonstrate that our approach performs comparably to full fine-tuned LLMs, surpassing both low-rank and low-bit baselines by a considerable margin. Additionally, we show that our method is compatible with various backbone LLMs, such as Llama-2, Llama-3, and Mistral, highlighting its generalizability.