AustroTox: A Dataset for Target-Based Austrian German Offensive Language Detection

作者: Pia Pachinger, Janis Goldzycher, Anna Maria Planitzer, Wojciech Kusa, Allan Hanbury, Julia Neidhardt

分类: cs.CL, cs.AI, cs.CY

发布日期: 2024-06-12

备注: Accepted to Findings of the Association for Computational Linguistics: ACL 2024

💡 一句话要点

提出AustroTox数据集,用于奥地利德语攻击性语言检测,并提供目标级别的标注。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 攻击性语言检测 奥地利德语 数据集 token级别标注 语言模型

📋 核心要点

- 现有毒性检测模型缺乏token级别的标注,限制了模型的可解释性,尤其是在非英语语境下。

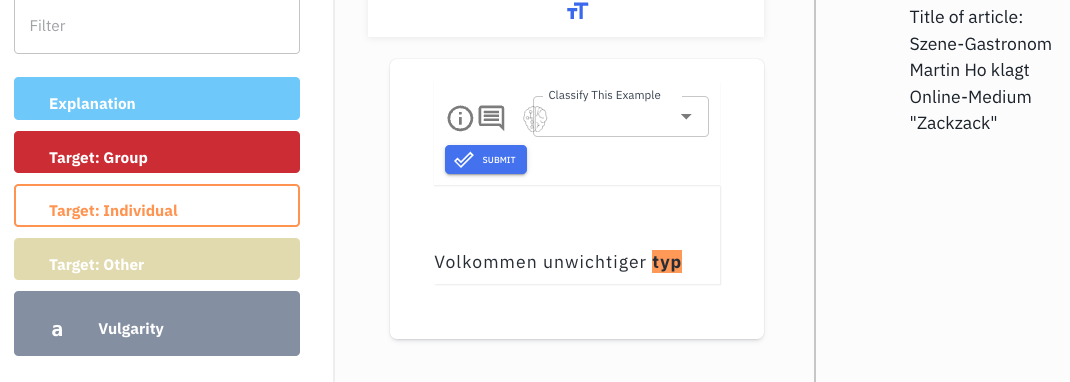

- 构建AustroTox数据集,包含奥地利德语方言的评论,并标注了粗俗语言和攻击目标。

- 实验表明,微调模型擅长检测方言特征,而大型语言模型在攻击性检测方面表现更佳。

📝 摘要(中文)

模型在毒性检测中的可解释性极大地受益于token级别的标注。然而,目前这种标注仅在英语中可用。我们引入了一个用于攻击性语言检测的数据集,该数据集来源于一个新闻论坛,特别之处在于它包含了奥地利德语方言,包含4,562条用户评论。除了二元攻击性分类之外,我们还识别了每个评论中构成粗俗语言或代表攻击性陈述目标的片段。我们评估了微调的语言模型以及大型语言模型在零样本和少样本环境下的表现。结果表明,虽然微调模型擅长检测诸如粗俗方言之类的语言特性,但大型语言模型在检测AustroTox中的攻击性方面表现出更优越的性能。我们发布了数据和代码。

🔬 方法详解

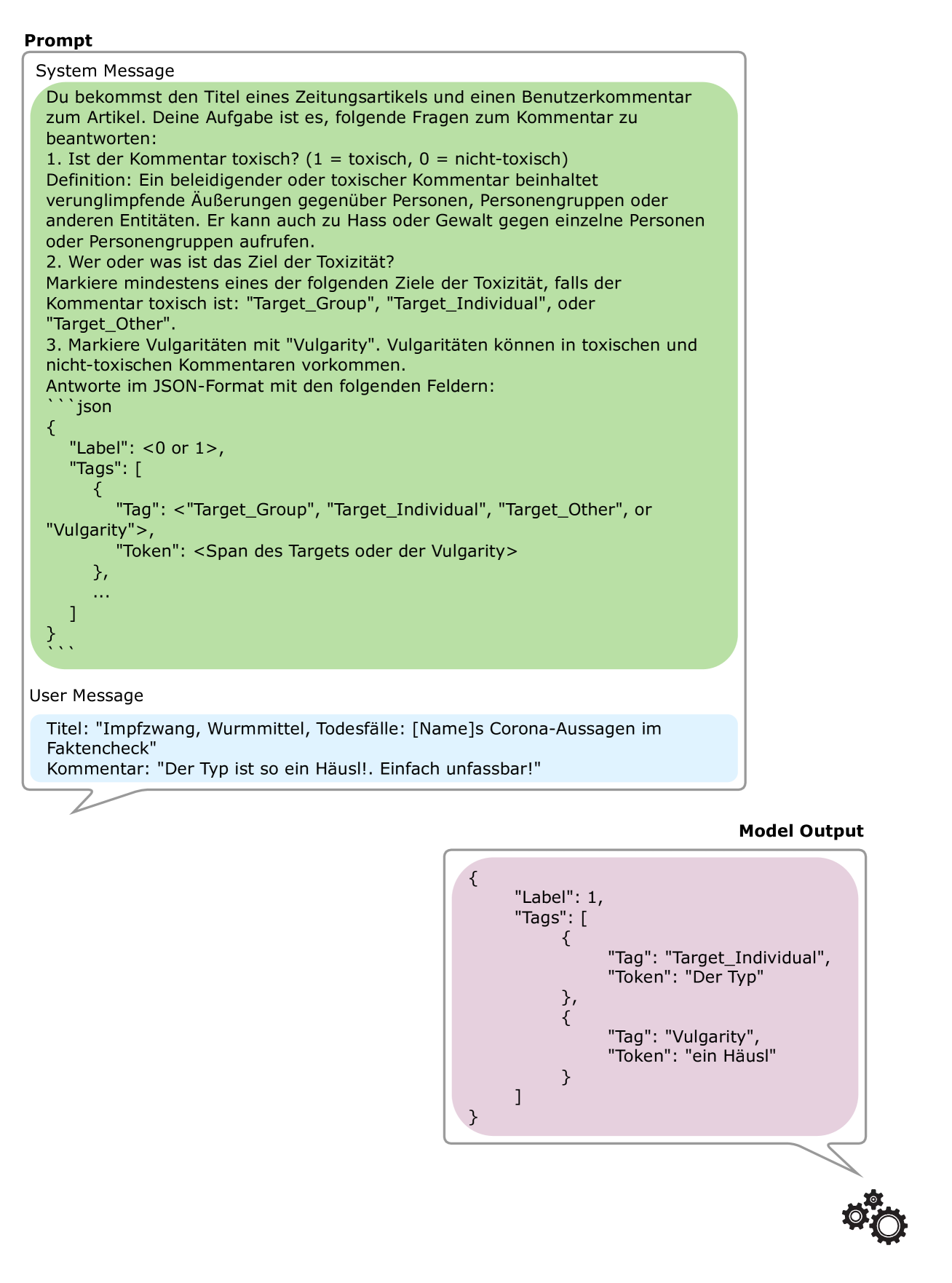

问题定义:论文旨在解决奥地利德语环境下的攻击性语言检测问题。现有的攻击性语言检测数据集主要集中在英语上,缺乏对其他语言,尤其是方言的支持。此外,现有数据集通常只提供句子级别的标注,缺乏token级别的标注,不利于模型的可解释性。因此,该论文旨在构建一个包含奥地利德语方言,并提供token级别标注的攻击性语言检测数据集,以促进该领域的研究。

核心思路:论文的核心思路是构建一个高质量的奥地利德语攻击性语言检测数据集,并提供token级别的标注,包括粗俗语言和攻击目标。通过在该数据集上训练和评估不同的模型,可以更好地理解奥地利德语环境下的攻击性语言特征,并提高攻击性语言检测的准确性和可解释性。

技术框架:该研究主要包含以下几个阶段: 1. 数据收集:从新闻论坛收集包含奥地利德语的评论数据。 2. 数据标注:对收集到的评论进行标注,包括二元攻击性分类,以及token级别的粗俗语言和攻击目标标注。 3. 模型训练与评估:使用微调的语言模型和大型语言模型在AustroTox数据集上进行训练和评估,比较不同模型的性能。 4. 结果分析:分析实验结果,探讨不同模型在检测奥地利德语攻击性语言方面的优缺点。

关键创新:该论文的关键创新在于构建了首个包含奥地利德语方言,并提供token级别标注的攻击性语言检测数据集AustroTox。该数据集的发布将促进奥地利德语环境下的攻击性语言检测研究,并为模型的可解释性提供支持。与现有数据集相比,AustroTox数据集更具针对性和细粒度。

关键设计:在模型训练方面,论文采用了微调的语言模型和大型语言模型。具体来说,使用了预训练的语言模型,并在AustroTox数据集上进行微调,以适应奥地利德语的语言特征。同时,也评估了大型语言模型在零样本和少样本环境下的表现,以考察其泛化能力。损失函数方面,使用了交叉熵损失函数进行二元分类任务的训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,微调的语言模型在检测奥地利德语方言特征方面表现出色,而大型语言模型在检测攻击性方面表现更优。这表明不同类型的模型在处理不同类型的语言特征时具有不同的优势。该研究为选择合适的模型来检测特定语言环境下的攻击性语言提供了有益的参考。

🎯 应用场景

该研究成果可应用于社交媒体平台、在线论坛等场景,用于自动检测和过滤奥地利德语环境下的攻击性言论,维护健康的在线交流环境。此外,该数据集和研究方法也可推广到其他方言或小语种的攻击性语言检测任务中,具有重要的实际价值和推广潜力。

📄 摘要(原文)

Model interpretability in toxicity detection greatly profits from token-level annotations. However, currently such annotations are only available in English. We introduce a dataset annotated for offensive language detection sourced from a news forum, notable for its incorporation of the Austrian German dialect, comprising 4,562 user comments. In addition to binary offensiveness classification, we identify spans within each comment constituting vulgar language or representing targets of offensive statements. We evaluate fine-tuned language models as well as large language models in a zero- and few-shot fashion. The results indicate that while fine-tuned models excel in detecting linguistic peculiarities such as vulgar dialect, large language models demonstrate superior performance in detecting offensiveness in AustroTox. We publish the data and code.