Exploring Speech Foundation Models for Speaker Diarization in Child-Adult Dyadic Interactions

作者: Anfeng Xu, Kevin Huang, Tiantian Feng, Lue Shen, Helen Tager-Flusberg, Shrikanth Narayanan

分类: eess.AS, cs.CL, cs.LG

发布日期: 2024-06-12

备注: Interspeech 2024

💡 一句话要点

利用语音基础模型提升儿童-成人交互场景下的说话人分离性能

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语音基础模型 说话人分离 儿童语音 人机交互 语音识别

📋 核心要点

- 儿童语音理解是低资源语音处理的难点,传统方法效果有限,需要新的解决方案。

- 本研究探索了语音基础模型在儿童-成人交互场景下说话人分离任务中的应用,利用其强大的表征能力。

- 实验表明,语音基础模型显著降低了分离错误率和说话人混淆率,验证了其有效性。

📝 摘要(中文)

本研究探索了语音基础模型在儿童-成人交互场景下说话人分离任务中的应用潜力。语音基础模型在大规模数据集上训练,为解决诸如儿童语音等低资源语音理解问题提供了独特的机会。实验结果表明,与先前的说话人分离方法相比,所选的语音基础模型在分离错误率和说话人混淆率方面分别实现了39.5%和62.3%的相对降低。此外,本文还评估了不同输入音频窗口大小、说话人人口统计信息和训练数据比例对语音基础模型说话人分离结果的影响。研究结果突出了采用语音基础模型促进儿童语音理解的潜在途径。

🔬 方法详解

问题定义:本研究旨在解决儿童-成人交互场景下的说话人分离问题。现有方法在处理儿童语音时,由于儿童语音的特殊性(例如发音不清晰、语速变化大等),往往表现不佳,导致分离错误率较高。因此,需要一种更有效的方法来提高儿童语音场景下的说话人分离性能。

核心思路:本研究的核心思路是利用在大规模数据集上预训练的语音基础模型,将其强大的语音表征能力迁移到儿童-成人交互场景下的说话人分离任务中。通过利用预训练模型的知识,可以克服儿童语音数据量不足的问题,提高模型的泛化能力和鲁棒性。

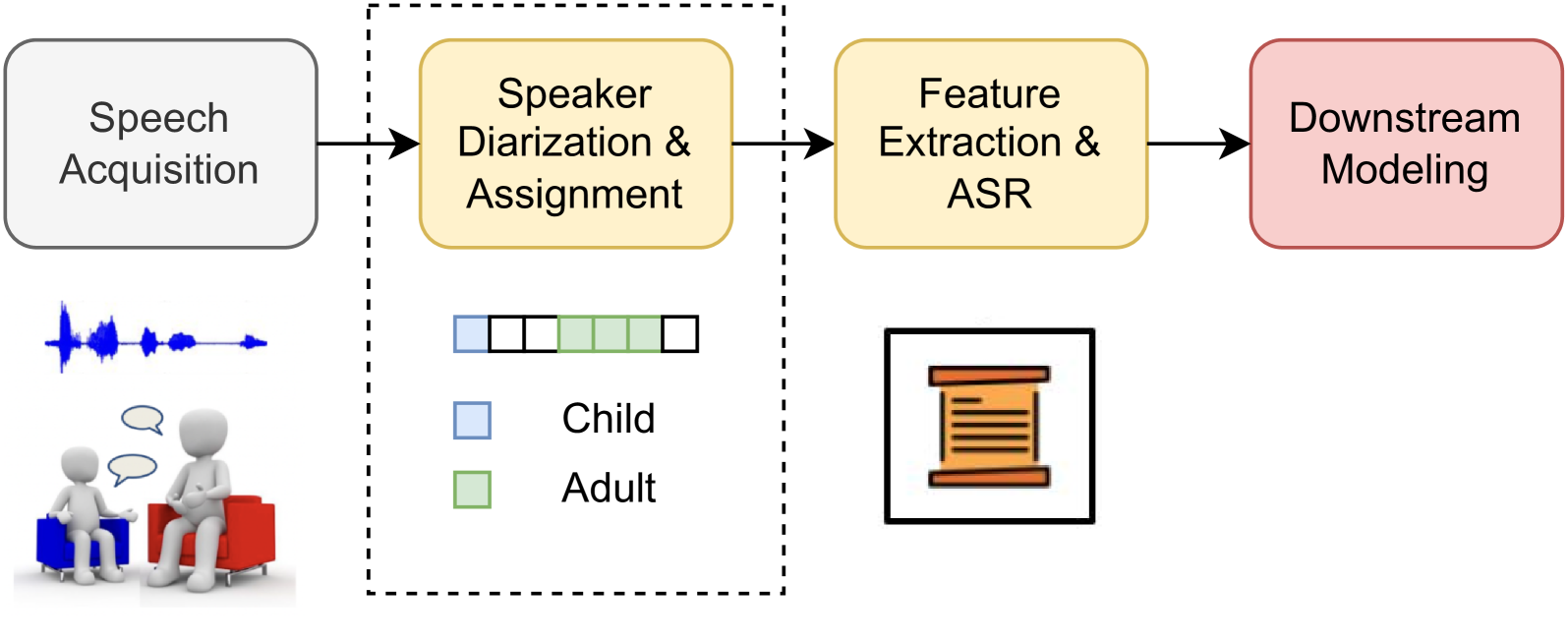

技术框架:整体框架包括以下几个主要步骤:1) 使用语音基础模型提取输入音频的特征表示;2) 利用提取的特征进行说话人嵌入(speaker embedding)学习;3) 使用聚类算法(如谱聚类)或神经网络对说话人嵌入进行聚类,从而实现说话人分离。具体来说,输入一段包含儿童和成人语音的音频,首先通过语音基础模型提取音频的特征向量,然后将这些特征向量输入到说话人嵌入模型中,得到每个说话人的嵌入向量。最后,使用聚类算法将这些嵌入向量聚类成不同的簇,每个簇代表一个说话人。

关键创新:本研究的关键创新在于将语音基础模型应用于儿童-成人交互场景下的说话人分离任务。与传统的说话人分离方法相比,语音基础模型具有更强的语音表征能力,能够更好地捕捉儿童语音的特征,从而提高分离性能。此外,本研究还探索了不同输入音频窗口大小、说话人人口统计信息和训练数据比例对模型性能的影响,为实际应用提供了指导。

关键设计:在实验中,研究人员使用了多种语音基础模型,例如Wav2Vec 2.0、HuBERT等。针对不同的基础模型,研究人员可能需要调整一些参数,例如学习率、批大小等。此外,研究人员还使用了不同的聚类算法,例如谱聚类、k-means等。在损失函数方面,研究人员可能使用了对比损失(contrastive loss)或三元组损失(triplet loss)来优化说话人嵌入模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与之前的说话人分离方法相比,语音基础模型在分离错误率(Diarization Error Rate)和说话人混淆率(Speaker Confusion Rate)方面分别实现了39.5%和62.3%的相对降低。这表明语音基础模型在儿童-成人交互场景下的说话人分离任务中具有显著的优势。

🎯 应用场景

该研究成果可应用于儿童教育、心理咨询、亲子互动分析等领域。例如,在儿童教育中,可以自动识别课堂上不同学生的发言,从而更好地评估学生的参与度和理解程度。在心理咨询中,可以分析儿童与咨询师的对话,从而更好地了解儿童的心理状态。此外,该技术还可以用于开发智能玩具和家庭机器人,从而实现更自然的人机交互。

📄 摘要(原文)

Speech foundation models, trained on vast datasets, have opened unique opportunities in addressing challenging low-resource speech understanding, such as child speech. In this work, we explore the capabilities of speech foundation models on child-adult speaker diarization. We show that exemplary foundation models can achieve 39.5% and 62.3% relative reductions in Diarization Error Rate and Speaker Confusion Rate, respectively, compared to previous speaker diarization methods. In addition, we benchmark and evaluate the speaker diarization results of the speech foundation models with varying the input audio window size, speaker demographics, and training data ratio. Our results highlight promising pathways for understanding and adopting speech foundation models to facilitate child speech understanding.