Making Task-Oriented Dialogue Datasets More Natural by Synthetically Generating Indirect User Requests

作者: Amogh Mannekote, Jinseok Nam, Ziming Li, Jian Gao, Kristy Elizabeth Boyer, Bonnie J. Dorr

分类: cs.CL, cs.AI

发布日期: 2024-06-12 (更新: 2024-06-16)

💡 一句话要点

提出基于LLM的IUR生成流程,并构建IndirectRequests数据集,提升小模型在任务型对话中处理间接用户请求的能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 任务型对话 间接用户请求 数据增强 大型语言模型 自然语言理解

📋 核心要点

- 现有任务型对话数据集缺乏间接用户请求(IURs)的充分示例,导致小型模型难以有效处理。

- 论文提出基于LLM的IUR生成流程,并结合语言学标准,旨在生成更真实、更具挑战性的IURs。

- 构建了IndirectRequests数据集,用于评估和提升小型模型在处理IURs方面的NLU和DST性能。

📝 摘要(中文)

间接用户请求(IURs),例如“这里有点冷”,而不是“请你调高温度好吗?”,在人与人之间的任务型对话中很常见,需要倾听者具备世界知识和语用推理能力。虽然大型语言模型(LLMs)可以有效地处理这些请求,但部署在虚拟助手上的较小模型由于资源限制,通常难以应对。此外,现有的任务型对话基准测试缺乏足够复杂的语篇现象(如间接性)的例子。为了解决这个问题,我们提出了一组语言学标准以及一个基于LLM的流程,用于生成真实的IURs,以便在新领域部署之前测试自然语言理解(NLU)和对话状态跟踪(DST)模型。我们还发布了IndirectRequests,这是一个基于Schema Guided Dialog (SGD)语料库的IURs数据集,作为评估较小模型在处理间接请求方面的性能的比较测试平台。

🔬 方法详解

问题定义:论文旨在解决任务型对话系统中,小型模型难以理解和处理间接用户请求(IURs)的问题。现有数据集缺乏足够的IURs样本,导致模型在实际应用中表现不佳。现有方法难以生成高质量、符合人类语言习惯的IURs。

核心思路:论文的核心思路是利用大型语言模型(LLMs)的强大生成能力,结合预定义的语言学标准,自动生成高质量的IURs。通过增加训练数据中IURs的比例,提升小型模型对IURs的理解和处理能力。

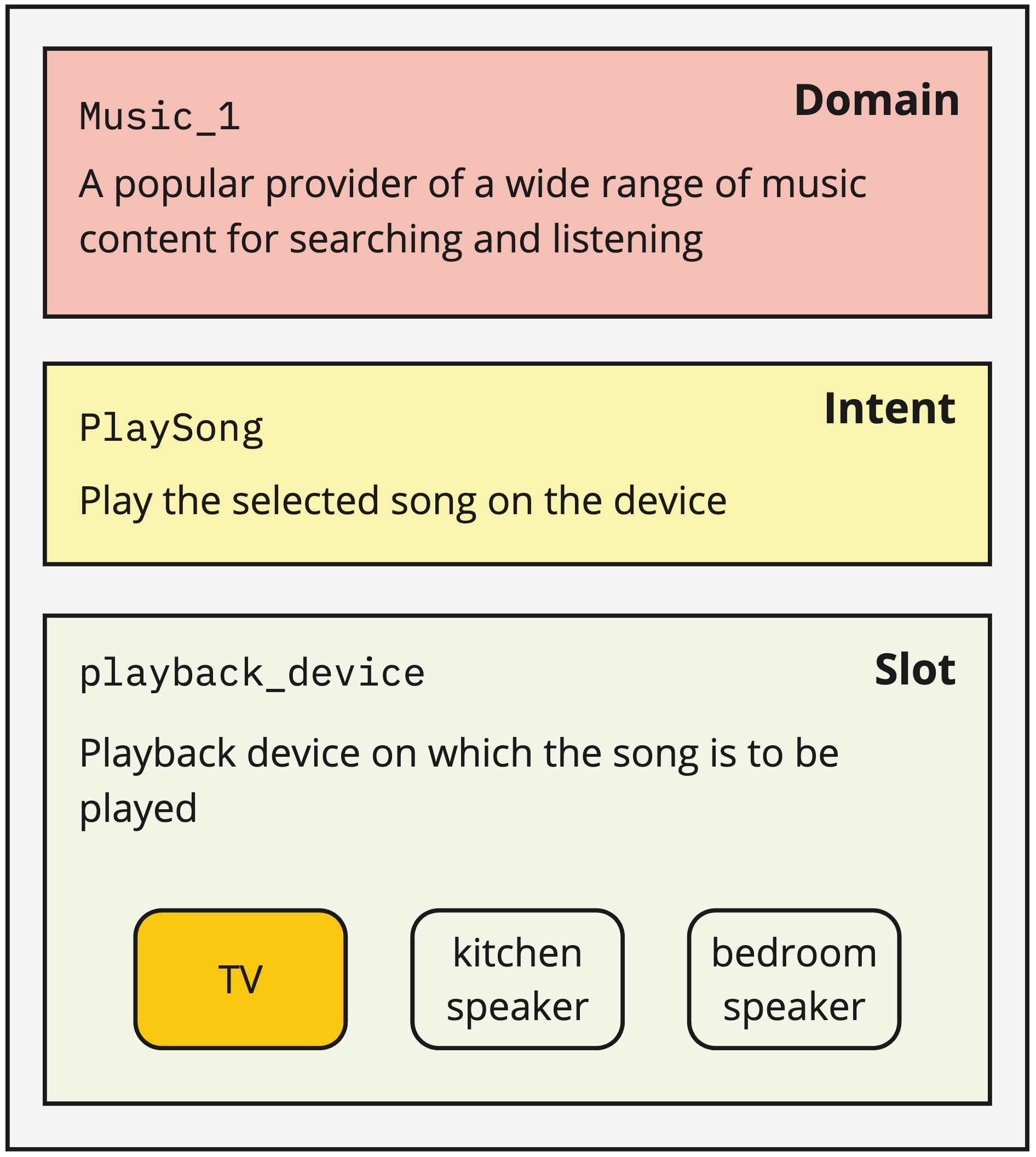

技术框架:该方法包含一个基于LLM的IUR生成流程。首先,定义了一组语言学标准,用于指导IUR的生成。然后,使用LLM根据这些标准生成候选IURs。最后,对生成的IURs进行过滤和筛选,得到最终的IURs数据集。同时,构建了IndirectRequests数据集,用于评估NLU和DST模型在处理IURs方面的性能。

关键创新:该方法的关键创新在于结合了语言学标准和LLM的生成能力,能够生成更真实、更具挑战性的IURs。与传统的数据增强方法相比,该方法能够更有效地扩充IURs样本,提升模型的泛化能力。

关键设计:论文中定义了具体的语言学标准,例如使用反问句、陈述句表达请求等。LLM采用的是预训练的语言模型,并使用prompt engineering来引导其生成IURs。数据集构建过程中,对生成的IURs进行了人工审核,确保其质量和合理性。具体的参数设置和损失函数信息未知。

🖼️ 关键图片

📊 实验亮点

论文构建了IndirectRequests数据集,该数据集包含大量的IURs样本,可以作为评估NLU和DST模型在处理IURs方面性能的基准。实验结果表明,使用该数据集训练的模型在处理IURs方面取得了显著的提升,具体性能数据和提升幅度未知。

🎯 应用场景

该研究成果可应用于各种任务型对话系统,例如虚拟助手、智能客服等。通过提升模型对间接用户请求的理解能力,可以提高用户体验,使对话更加自然流畅。该方法还可以推广到其他自然语言处理任务中,例如情感分析、文本摘要等。

📄 摘要(原文)

Indirect User Requests (IURs), such as "It's cold in here" instead of "Could you please increase the temperature?" are common in human-human task-oriented dialogue and require world knowledge and pragmatic reasoning from the listener. While large language models (LLMs) can handle these requests effectively, smaller models deployed on virtual assistants often struggle due to resource constraints. Moreover, existing task-oriented dialogue benchmarks lack sufficient examples of complex discourse phenomena such as indirectness. To address this, we propose a set of linguistic criteria along with an LLM-based pipeline for generating realistic IURs to test natural language understanding (NLU) and dialogue state tracking (DST) models before deployment in a new domain. We also release IndirectRequests, a dataset of IURs based on the Schema Guided Dialog (SGD) corpus, as a comparative testbed for evaluating the performance of smaller models in handling indirect requests.