Advancing Annotation of Stance in Social Media Posts: A Comparative Analysis of Large Language Models and Crowd Sourcing

作者: Mao Li, Frederick Conrad

分类: cs.CL

发布日期: 2024-06-11

💡 一句话要点

对比分析大型语言模型与众包在社交媒体立场标注中的表现,揭示LLM的局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 立场检测 社交媒体分析 众包标注 自然语言处理

📋 核心要点

- 现有大型语言模型在社交媒体立场标注中的有效性和准确性尚不明确,需要深入研究。

- 通过对比LLM与人工标注,分析文本明确性对LLM立场判断一致性的影响,揭示LLM的局限。

- 研究表明LLM在文本立场明确时表现良好,并提出结合人类专业知识和LLM预测的综合方法。

📝 摘要(中文)

本文分析了八个开源和专有大型语言模型(LLM)在社交媒体帖子立场标注方面的性能,并将它们与人工标注(即众包)的判断进行比较。研究重点关注LLM作为标注工具的有效性和准确性。研究发现,文本表达立场的明确性在LLM的立场判断与人类判断的一致性方面起着关键作用。LLM在人类标注者表现良好时也表现良好,而LLM失效的情况通常对应于人类标注者难以达成一致的情况。最后,提出了结合人类专业知识的精确性和LLM预测的可扩展性的综合方法建议。本研究强调了提高自动立场检测的准确性和全面性的重要性,旨在推进这些技术,以实现更高效和公正的社交媒体分析。

🔬 方法详解

问题定义:论文旨在评估大型语言模型(LLM)在社交媒体文本立场标注任务中的表现,并将其与人工标注(众包)的结果进行对比。现有方法,即直接使用LLM进行立场标注,其准确性和可靠性尚未得到充分验证,尤其是在处理复杂或模糊的社交媒体文本时。

核心思路:论文的核心思路是通过对比实验,分析LLM在不同文本明确程度下的立场标注表现,从而揭示LLM的优势和局限性。通过分析LLM与人工标注不一致的情况,找出LLM容易出错的场景,并提出改进建议。

技术框架:论文的技术框架主要包括以下几个步骤:1) 选择多个开源和专有的LLM;2) 收集社交媒体文本数据集,并进行人工立场标注(众包);3) 使用LLM对相同数据集进行立场标注;4) 对比LLM和人工标注的结果,计算准确率、一致性等指标;5) 分析LLM与人工标注不一致的案例,找出影响LLM表现的因素。

关键创新:论文的关键创新在于:1) 系统性地对比了多个LLM在社交媒体立场标注任务中的表现;2) 揭示了文本明确性对LLM立场判断准确性的重要影响;3) 提出了结合人类专业知识和LLM预测的综合方法,为提高自动立场检测的准确性和可靠性提供了新的思路。

关键设计:论文的关键设计包括:1) 选择了具有代表性的开源和专有LLM,以保证研究的广泛性和代表性;2) 采用了众包方式进行人工标注,以保证标注的质量和可靠性;3) 设计了多种评估指标,包括准确率、一致性等,以全面评估LLM的表现;4) 对LLM与人工标注不一致的案例进行了深入分析,以找出影响LLM表现的因素。

🖼️ 关键图片

📊 实验亮点

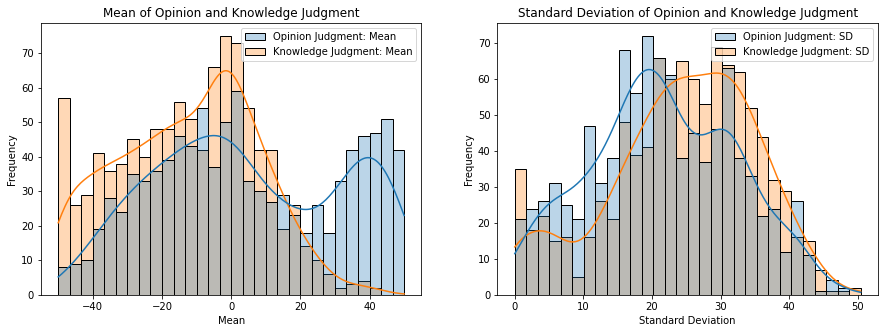

研究发现,LLM在文本立场明确时表现良好,与人类标注者达成较高一致性。然而,在文本立场模糊或存在歧义时,LLM的准确率显著下降,且与人类标注者的一致性较低。实验结果表明,文本明确性是影响LLM立场判断的关键因素,为后续研究提供了重要启示。

🎯 应用场景

该研究成果可应用于舆情分析、虚假信息检测、网络安全监控等领域。通过结合LLM和人工标注,可以更高效、更准确地分析社交媒体上的立场信息,从而为决策提供支持,并有助于构建更健康的网络环境。未来,该研究可以扩展到其他自然语言处理任务,如情感分析、观点挖掘等。

📄 摘要(原文)

In the rapidly evolving landscape of Natural Language Processing (NLP), the use of Large Language Models (LLMs) for automated text annotation in social media posts has garnered significant interest. Despite the impressive innovations in developing LLMs like ChatGPT, their efficacy, and accuracy as annotation tools are not well understood. In this paper, we analyze the performance of eight open-source and proprietary LLMs for annotating the stance expressed in social media posts, benchmarking their performance against human annotators' (i.e., crowd-sourced) judgments. Additionally, we investigate the conditions under which LLMs are likely to disagree with human judgment. A significant finding of our study is that the explicitness of text expressing a stance plays a critical role in how faithfully LLMs' stance judgments match humans'. We argue that LLMs perform well when human annotators do, and when LLMs fail, it often corresponds to situations in which human annotators struggle to reach an agreement. We conclude with recommendations for a comprehensive approach that combines the precision of human expertise with the scalability of LLM predictions. This study highlights the importance of improving the accuracy and comprehensiveness of automated stance detection, aiming to advance these technologies for more efficient and unbiased analysis of social media.