Language Guided Skill Discovery

作者: Seungeun Rho, Laura Smith, Tianyu Li, Sergey Levine, Xue Bin Peng, Sehoon Ha

分类: cs.CL, cs.AI, cs.LG, cs.RO

发布日期: 2024-06-07 (更新: 2025-03-01)

💡 一句话要点

提出语言引导的技能发现框架LGSD,提升机器人技能的语义多样性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 技能发现 强化学习 大型语言模型 语义多样性 机器人学习

📋 核心要点

- 现有技能发现方法缺乏对技能语义多样性的直接优化,限制了技能的泛化能力和下游任务的应用。

- LGSD利用大型语言模型的语义知识,通过用户提示引导智能体探索语义上不同的状态,从而提升技能的语义多样性。

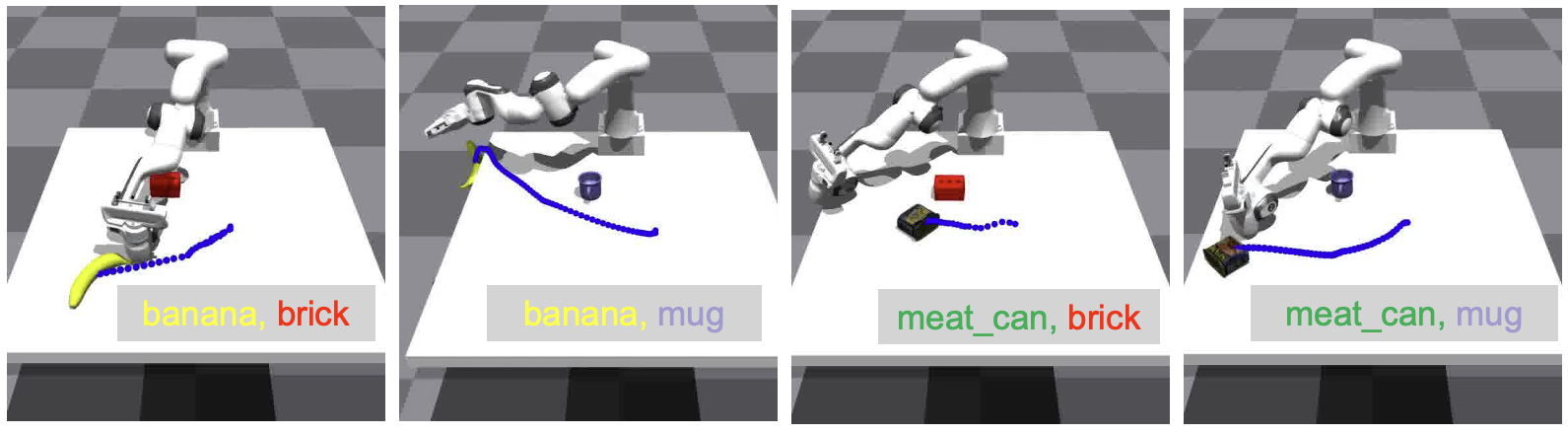

- 实验表明,LGSD在四足机器人导航和机器人手臂操作任务中,均能发现比现有方法更多样化的技能。

📝 摘要(中文)

技能发现方法旨在使智能体在没有显式奖励的情况下学习到多样化的行为。为了使学习到的技能对未知的下游任务有用,获得语义上多样化的技能库至关重要。虽然一些方法引入判别器来区分技能,另一些方法旨在增加状态覆盖率,但目前还没有工作直接解决技能的“语义多样性”问题。我们假设利用大型语言模型(LLM)的语义知识可以提高生成行为的语义多样性。因此,我们提出了语言引导的技能发现(LGSD),这是一种旨在直接最大化技能之间语义多样性的技能发现框架。LGSD以用户提示作为输入,并输出一组语义上不同的技能。这些提示作为将搜索空间约束到语义上期望的子空间的一种手段,并且生成的LLM输出引导智能体访问子空间内语义上不同的状态。我们证明了LGSD使四足机器人能够通过简单地改变提示来访问平面上不同的用户意图区域。此外,我们表明,在机器人手臂操作环境中,与五种现有的技能发现方法相比,语言指导有助于发现更多样化的技能。最后,LGSD提供了一种通过自然语言利用学习到的技能的简单方法。

🔬 方法详解

问题定义:现有技能发现方法主要关注技能的可区分性或状态覆盖率,忽略了技能的语义多样性。这意味着学习到的技能可能在行为上差异不大,难以适应各种下游任务。因此,需要一种方法能够引导智能体学习语义上不同的技能,从而提高技能的泛化能力和实用性。

核心思路:论文的核心思路是利用大型语言模型(LLM)的语义理解能力,通过用户提供的自然语言提示,引导智能体探索语义上不同的状态空间。LLM可以根据提示生成相应的文本描述,这些描述可以作为智能体探索方向的指导,从而学习到与提示相关的技能。通过改变提示,可以引导智能体学习到各种语义不同的技能。

技术框架:LGSD框架主要包含以下几个模块:1) 用户提示模块:接收用户输入的自然语言提示。2) LLM模块:根据用户提示生成相应的文本描述。3) 技能学习模块:利用强化学习算法,以LLM生成的文本描述作为指导,学习与提示相关的技能。4) 技能评估模块:评估学习到的技能的语义多样性,并根据评估结果调整技能学习过程。整体流程是:用户提供提示 -> LLM生成文本描述 -> 技能学习模块学习技能 -> 技能评估模块评估技能多样性 -> 反馈到技能学习模块进行调整。

关键创新:LGSD的关键创新在于将大型语言模型的语义知识引入到技能发现过程中,从而实现了对技能语义多样性的直接优化。与现有方法相比,LGSD不再仅仅关注技能的可区分性或状态覆盖率,而是更加关注技能的语义含义,从而学习到更加实用和泛化的技能。

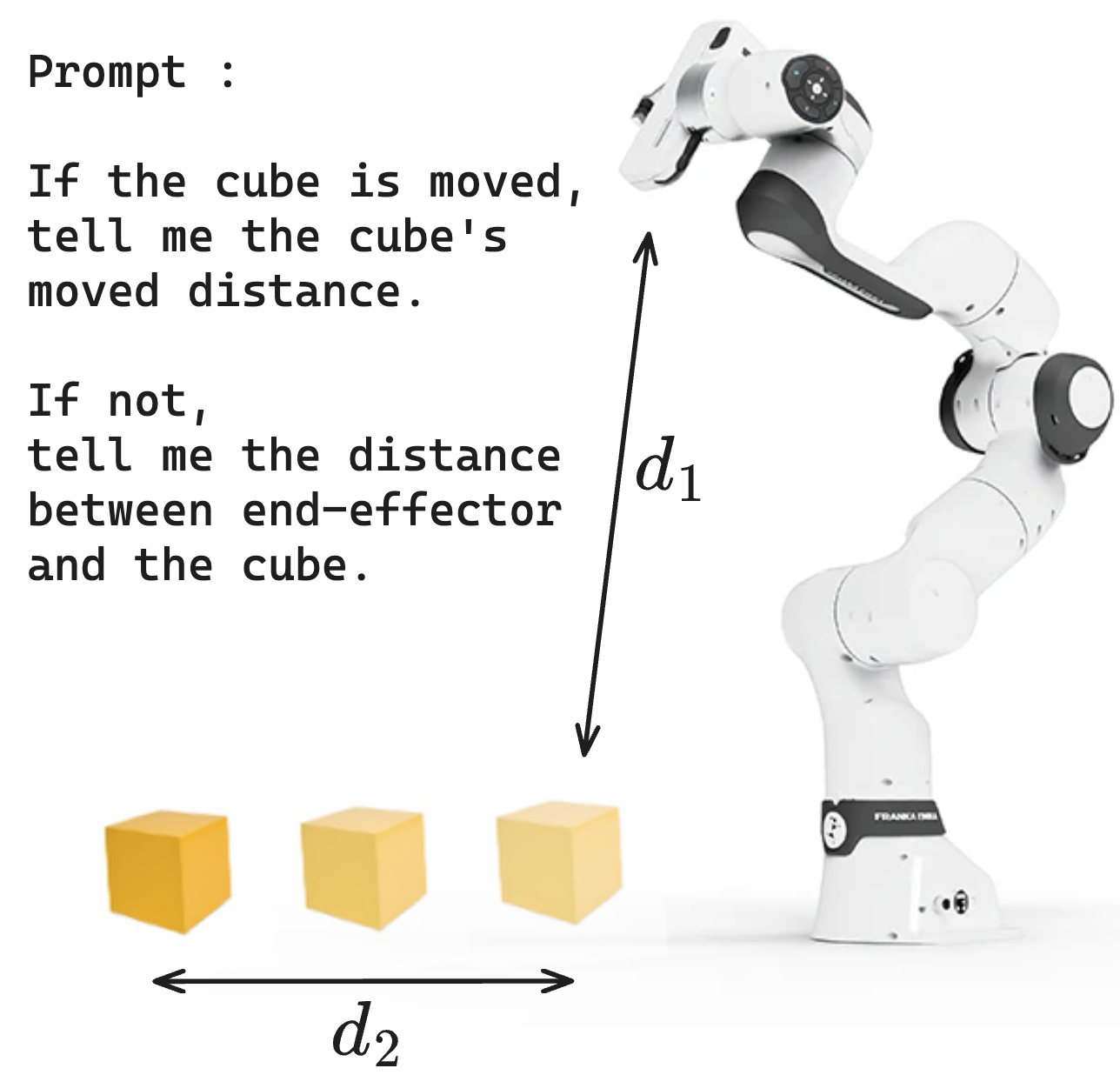

关键设计:LGSD的关键设计包括:1) 如何将LLM生成的文本描述转化为智能体可以理解的奖励信号。2) 如何设计技能评估指标,以衡量技能的语义多样性。3) 如何将技能评估结果反馈到技能学习过程中,以引导智能体学习更加多样化的技能。具体而言,可以使用文本相似度度量(如CLIP)来衡量状态和LLM生成文本描述之间的语义相似性,并将其作为奖励信号。技能多样性可以使用技能嵌入向量的距离来衡量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LGSD在四足机器人导航任务中,能够通过改变提示引导机器人访问不同的用户意图区域。在机器人手臂操作任务中,LGSD能够发现比五种现有技能发现方法更多样化的技能。例如,在reach任务中,LGSD能够覆盖更大的目标空间,在push任务中,LGSD能够推动物体到更远的位置。

🎯 应用场景

LGSD可应用于各种机器人任务,例如机器人导航、操作和人机协作。通过自然语言提示,用户可以轻松地引导机器人学习各种技能,从而实现更加灵活和智能的机器人应用。例如,在家庭服务机器人中,用户可以通过语音指令引导机器人完成不同的家务任务。在工业机器人中,可以通过自然语言描述引导机器人执行复杂的装配任务。

📄 摘要(原文)

Skill discovery methods enable agents to learn diverse emergent behaviors without explicit rewards. To make learned skills useful for unknown downstream tasks, obtaining a semantically diverse repertoire of skills is essential. While some approaches introduce a discriminator to distinguish skills and others aim to increase state coverage, no existing work directly addresses the "semantic diversity" of skills. We hypothesize that leveraging the semantic knowledge of large language models (LLMs) can lead us to improve semantic diversity of resulting behaviors. In this sense, we introduce Language Guided Skill Discovery (LGSD), a skill discovery framework that aims to directly maximize the semantic diversity between skills. LGSD takes user prompts as input and outputs a set of semantically distinctive skills. The prompts serve as a means to constrain the search space into a semantically desired subspace, and the generated LLM outputs guide the agent to visit semantically diverse states within the subspace. We demonstrate that LGSD enables legged robots to visit different user-intended areas on a plane by simply changing the prompt. Furthermore, we show that language guidance aids in discovering more diverse skills compared to five existing skill discovery methods in robot-arm manipulation environments. Lastly, LGSD provides a simple way of utilizing learned skills via natural language.