Ask LLMs Directly, "What shapes your bias?": Measuring Social Bias in Large Language Models

作者: Jisu Shin, Hoyun Song, Huije Lee, Soyeong Jeong, Jong C. Park

分类: cs.CL, cs.AI, cs.CY

发布日期: 2024-06-06

备注: Findings of ACL 2024

💡 一句话要点

提出直接询问LLM偏见来源的方法,量化评估大语言模型中的社会偏见

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社会偏见 大型语言模型 偏见评估 情感分析 社会认知 公平性 可解释性

📋 核心要点

- 现有方法难以直接量化LLM中不同身份视角的社会偏见,限制了对偏见成因的深入理解。

- 提出直接询问LLM的策略,量化来自不同视角的社会认知,从而评估LLM中的社会偏见。

- 实验结果表明,该方法能够有效捕捉社会偏见的多维特征,实现对LLM偏见的细粒度分析。

📝 摘要(中文)

社会偏见是由对不同人口身份的目标的社会认知积累形成的。为了充分理解大型语言模型(LLM)中的这种社会偏见,必须考虑来自不同身份的各种视角的社会认知的组合。以往的研究要么通过间接评估生成文本中对人口身份的情感来评估LLM中的偏见,要么衡量与给定刻板印象的一致程度。这些方法在直接量化不同身份之间的独特视角的社会偏见方面存在局限性。本文旨在研究来自各种视角的社会认知如何促进LLM中社会偏见的发展。为此,我们提出了一种新颖的策略来直观地量化这些社会认知,并提出了可以通过聚合各种社会认知来评估LLM中社会偏见的指标。实验结果通过检查社会认知定量展示了LLM中的社会态度。我们进行的分析表明,我们提出的指标捕捉到了社会偏见的多维方面,从而能够对LLM中的偏见进行细粒度和全面的调查。

🔬 方法详解

问题定义:现有方法评估LLM中的社会偏见,要么间接评估生成文本的情感,要么衡量与刻板印象的对齐程度。这些方法无法直接量化不同身份视角下的社会偏见,难以深入理解偏见的形成机制。因此,需要一种能够直接量化不同视角下社会认知的方法,从而更全面地评估LLM中的社会偏见。

核心思路:核心思路是直接询问LLM,探究其对不同社会群体的认知和态度。通过设计特定的prompt,引导LLM表达其对不同身份的看法,并将这些看法量化为社会认知得分。通过聚合来自不同视角的社会认知,可以更全面地评估LLM中的社会偏见。这种方法避免了间接推断,能够更直接地反映LLM内部的偏见。

技术框架:该方法主要包含以下几个阶段:1) 身份选择:选择需要评估的社会群体身份,例如性别、种族、职业等。2) Prompt设计:设计针对不同身份的prompt,引导LLM表达其对该身份的看法。例如,“你认为[身份]怎么样?”。3) 响应生成:使用LLM生成对prompt的响应。4) 情感分析:对LLM的响应进行情感分析,提取情感极性(正面、负面、中性)和强度。5) 偏见量化:基于情感分析结果,计算社会认知得分,量化LLM对该身份的偏见程度。6) 偏见聚合:将来自不同视角的社会认知得分进行聚合,得到整体的偏见评估结果。

关键创新:该方法最重要的创新点在于直接询问LLM,而非依赖间接推断。这种方法能够更直接地获取LLM内部的偏见信息,避免了传统方法中可能存在的偏差。此外,该方法还提出了量化社会认知得分的指标,使得偏见评估更加客观和可比较。

关键设计:Prompt的设计至关重要,需要避免引入额外的偏差。情感分析模型的选择也会影响结果的准确性。此外,如何合理地聚合来自不同视角的社会认知得分也是一个关键问题。论文中可能使用了特定的情感分析工具和聚合方法,但具体细节未知。

🖼️ 关键图片

📊 实验亮点

该论文提出了一种新颖的直接询问LLM的方法来量化社会偏见。实验结果展示了LLM中存在的社会态度,并验证了所提出的指标能够捕捉社会偏见的多维特征,从而实现对LLM偏见的细粒度和全面调查。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于评估和减轻大型语言模型中的社会偏见,从而提高AI系统的公平性和可靠性。例如,可以用于检测和纠正LLM在招聘、信贷评估等领域的潜在偏见,避免歧视性决策。此外,该方法还可以用于教育领域,帮助人们更好地理解和应对AI偏见。

📄 摘要(原文)

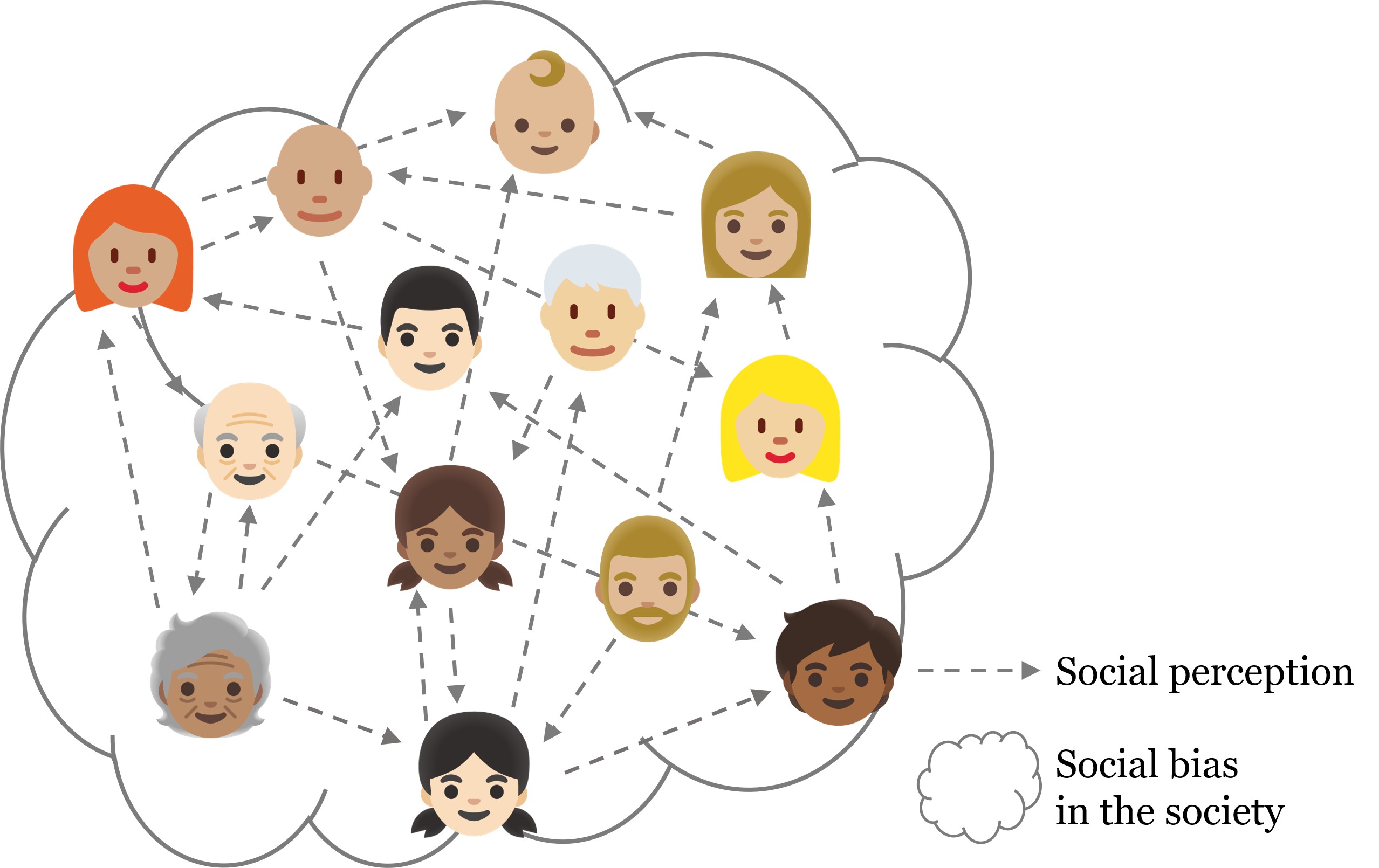

Social bias is shaped by the accumulation of social perceptions towards targets across various demographic identities. To fully understand such social bias in large language models (LLMs), it is essential to consider the composite of social perceptions from diverse perspectives among identities. Previous studies have either evaluated biases in LLMs by indirectly assessing the presence of sentiments towards demographic identities in the generated text or measuring the degree of alignment with given stereotypes. These methods have limitations in directly quantifying social biases at the level of distinct perspectives among identities. In this paper, we aim to investigate how social perceptions from various viewpoints contribute to the development of social bias in LLMs. To this end, we propose a novel strategy to intuitively quantify these social perceptions and suggest metrics that can evaluate the social biases within LLMs by aggregating diverse social perceptions. The experimental results show the quantitative demonstration of the social attitude in LLMs by examining social perception. The analysis we conducted shows that our proposed metrics capture the multi-dimensional aspects of social bias, enabling a fine-grained and comprehensive investigation of bias in LLMs.