Cycles of Thought: Measuring LLM Confidence through Stable Explanations

作者: Evan Becker, Stefano Soatto

分类: cs.CL, cs.LG

发布日期: 2024-06-05

💡 一句话要点

提出基于解释稳定性的LLM置信度评估框架,提升不确定性量化效果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 不确定性量化 解释性AI 置信度评估 自然语言推理

📋 核心要点

- LLM在错误回答时表现出的过度自信是高风险应用中的主要问题,现有不确定性量化方法难以有效应用。

- 该论文提出一种新框架,通过分析LLM生成解释的分布来衡量其不确定性,将模型和解释视为测试时分类器。

- 实验结果表明,该框架在多个数据集上提升了置信度评分指标,证明了其有效性和合理性。

📝 摘要(中文)

在大语言模型(LLM)的高风险应用中,模型能够指示其预测的不确定性至关重要。尽管LLM在各种基准测试中可以达到甚至超过人类水平的准确性,但其在错误响应中的过度自信仍然是一个公认的缺陷。传统的机器学习不确定性量化方法难以直接应用于LLM,因为实现成本高昂且许多模型是闭源的。最近提出了一些黑盒方法,但这些方法通常依赖于诸如自我口头信心的启发式方法。本文提出了一种框架,用于衡量LLM关于答案生成解释分布的不确定性。虽然利用解释本身并不是一个新想法,但通过将每个可能的模型+解释对解释为测试时分类器,我们可以计算这些分类器中最可能的后验答案分布。我们展示了该框架的一个具体实例,使用解释蕴含作为我们的分类器可能性,在五个不同的数据集上改进了置信度评分指标(特别是AURC和AUROC),优于基线。我们认为这些结果表明,我们的框架是一种良好且有效的量化LLM不确定性的方法。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在预测时过度自信的问题,尤其是在给出错误答案时。现有的不确定性量化方法,例如直接应用传统机器学习的不确定性估计技术,由于LLM的计算成本高昂和闭源特性而难以实施。此外,现有的黑盒方法,如依赖自我口头信心的启发式方法,缺乏理论基础,效果不稳定。

核心思路:论文的核心思路是利用LLM为答案生成的解释的分布来衡量其不确定性。如果LLM对一个答案的解释非常稳定和一致,那么它对这个答案的置信度就应该较高;反之,如果LLM生成的解释差异很大,甚至互相矛盾,那么它对这个答案的置信度就应该较低。这种方法将解释视为模型预测的辅助信息,通过分析解释的分布来推断模型的不确定性。

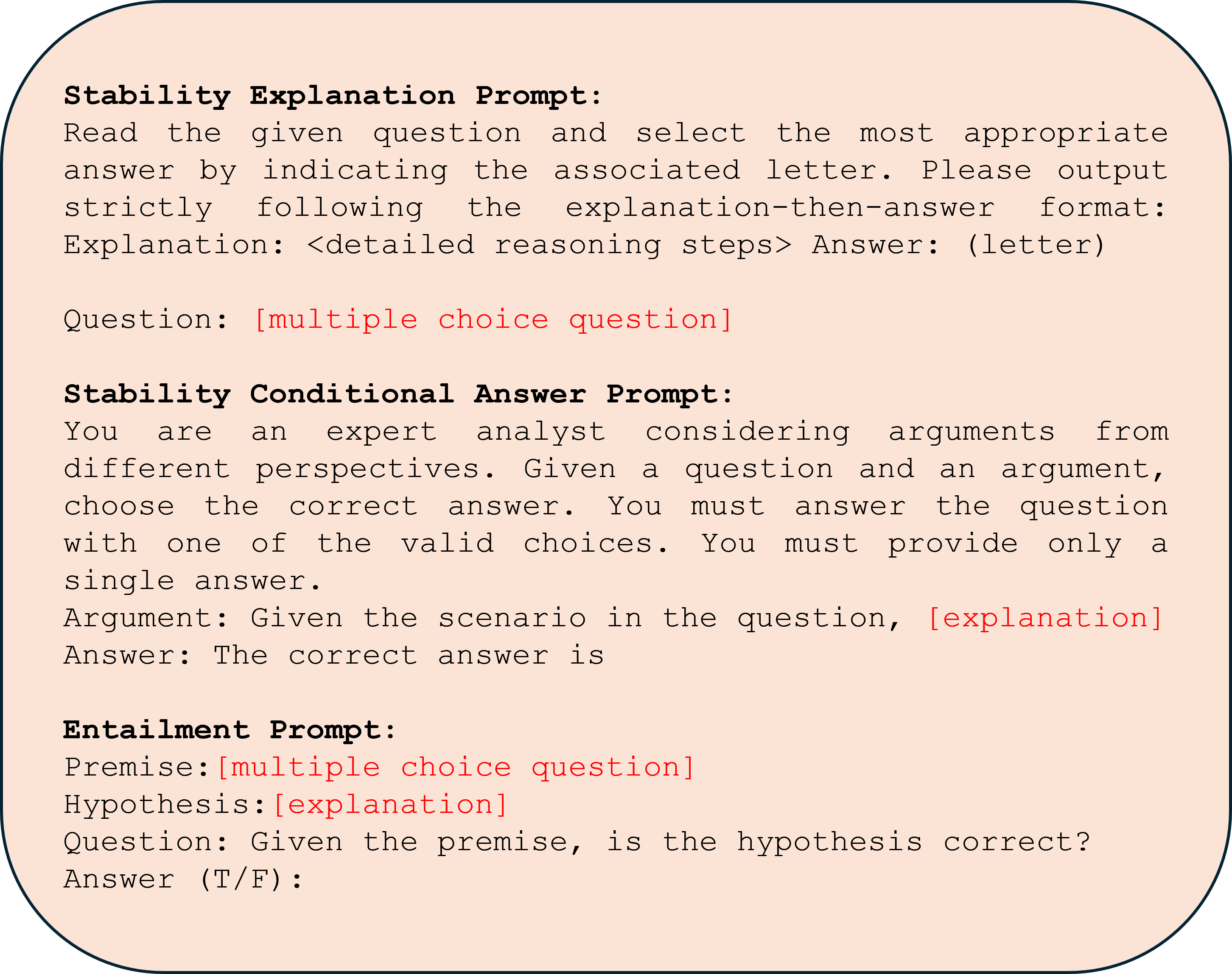

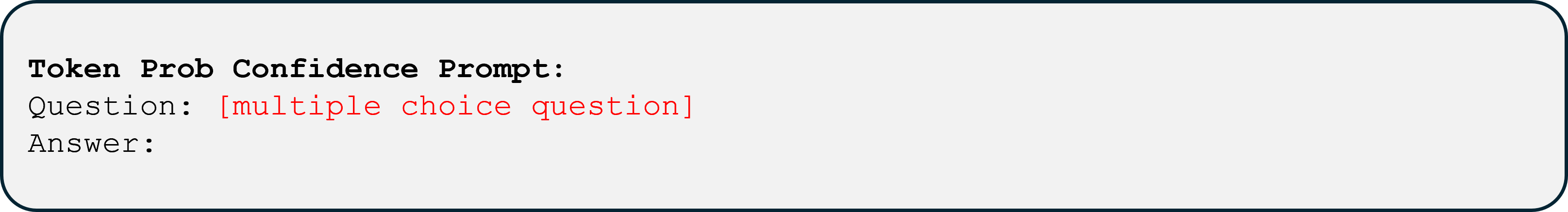

技术框架:该框架的核心是将每个“模型+解释”对视为一个测试时分类器。具体流程如下:1) 给定一个问题,LLM生成一个答案和多个解释。2) 对于每个答案和解释的组合,将其视为一个独立的分类器。3) 使用解释蕴含(explanation entailment)来评估每个分类器的可能性,即判断解释是否支持答案。4) 基于所有分类器的可能性,计算一个后验答案分布,该分布反映了LLM对不同答案的置信度。

关键创新:该论文的关键创新在于将解释纳入不确定性量化框架,并将其形式化为后验概率计算问题。与以往依赖启发式方法或直接估计置信度的方法不同,该方法基于对解释分布的分析,提供了一种更具理论基础和可解释性的不确定性量化方法。此外,将“模型+解释”对视为测试时分类器的视角也为不确定性量化提供了一种新的思路。

关键设计:该框架的关键设计在于使用解释蕴含作为分类器可能性的度量。具体而言,可以使用自然语言推理(NLI)模型来判断解释是否蕴含答案。此外,后验答案分布的计算方式也至关重要,可以使用贝叶斯公式或其他概率模型来估计。论文中可能还涉及一些超参数的设置,例如生成解释的数量、NLI模型的选择等,这些都会影响最终的不确定性量化效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架在五个不同的数据集上,使用解释蕴含作为分类器可能性,显著改进了置信度评分指标,特别是AURC和AUROC,优于基线方法。这表明该框架能够更准确地量化LLM的不确定性,并提高模型在实际应用中的可靠性。具体的性能提升数据需要在论文中查找。

🎯 应用场景

该研究成果可应用于各种需要高可靠性和可信度的大语言模型应用场景,例如医疗诊断、金融风险评估、法律咨询等。通过量化模型的不确定性,可以帮助用户更好地理解模型的预测,并在模型给出错误答案时及时发现并纠正,从而提高决策的准确性和安全性。此外,该方法还可以用于提高LLM的鲁棒性,使其在面对对抗性攻击或噪声数据时更加稳定。

📄 摘要(原文)

In many high-risk machine learning applications it is essential for a model to indicate when it is uncertain about a prediction. While large language models (LLMs) can reach and even surpass human-level accuracy on a variety of benchmarks, their overconfidence in incorrect responses is still a well-documented failure mode. Traditional methods for ML uncertainty quantification can be difficult to directly adapt to LLMs due to the computational cost of implementation and closed-source nature of many models. A variety of black-box methods have recently been proposed, but these often rely on heuristics such as self-verbalized confidence. We instead propose a framework for measuring an LLM's uncertainty with respect to the distribution of generated explanations for an answer. While utilizing explanations is not a new idea in and of itself, by interpreting each possible model+explanation pair as a test-time classifier we can calculate a posterior answer distribution over the most likely of these classifiers. We demonstrate how a specific instance of this framework using explanation entailment as our classifier likelihood improves confidence score metrics (in particular AURC and AUROC) over baselines across five different datasets. We believe these results indicate that our framework is both a well-principled and effective way of quantifying uncertainty in LLMs.