Large Language Models as Evaluators for Recommendation Explanations

作者: Xiaoyu Zhang, Yishan Li, Jiayin Wang, Bowen Sun, Weizhi Ma, Peijie Sun, Min Zhang

分类: cs.IR, cs.CL

发布日期: 2024-06-05 (更新: 2024-06-06)

🔗 代码/项目: GITHUB

💡 一句话要点

探索大语言模型作为推荐解释评估器的可行性,提升评估效率与一致性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推荐系统 可解释性 大型语言模型 评估器 自然语言处理

📋 核心要点

- 现有推荐解释评估方法主观且成本高昂,缺乏效率和一致性,难以大规模应用。

- 利用LLM的指令遵循和常识推理能力,将其作为推荐解释的自动评估器,降低成本并提高效率。

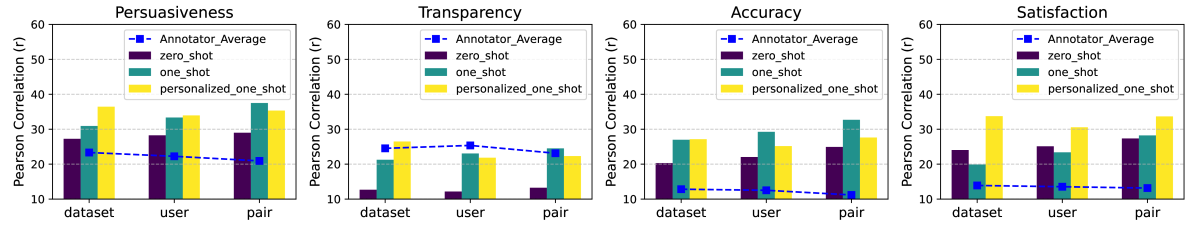

- 实验表明,GPT4等LLM在适当提示下,能提供与人工评估相当的结果,且集成多个LLM可进一步提升评估效果。

📝 摘要(中文)

推荐系统的可解释性日益受到学术界和工业界的关注。虽然在可解释推荐方面已经做了很多努力,但如何评估解释的质量仍然是一个具有挑战性且尚未解决的问题。近年来,利用大型语言模型(LLM)作为评估器在自然语言处理任务(例如,情感分类、信息抽取)中展现出了一条有希望的途径,因为它们在指令遵循和常识推理方面表现出强大的能力。然而,评估推荐解释文本与这些自然语言生成任务不同,因为它的标准与人类感知相关,并且通常是主观的。在本文中,我们研究了LLM是否可以作为推荐解释的评估器。为了回答这个问题,我们利用了先前工作中给出的关于解释的真实用户反馈,并额外收集了第三方注释和LLM评估。我们设计并应用了一个三级元评估策略来衡量评估器标签与用户提供的真实标签之间的相关性。我们的实验表明,诸如GPT4之类的LLM可以通过适当的提示和设置提供可比较的评估。我们还进一步深入了解了将人类标签与LLM评估过程相结合,以及利用多个异构LLM评估器的集成来提高评估的准确性和稳定性。我们的研究验证了利用LLM作为评估器可以成为评估推荐解释文本的准确、可重复且经济高效的解决方案。我们的代码可在https://github.com/Xiaoyu-SZ/LLMasEvaluator获取。

🔬 方法详解

问题定义:论文旨在解决推荐解释质量评估的问题。现有方法依赖人工评估,耗时耗力,且评估标准主观,难以保证一致性和可重复性。这阻碍了可解释推荐系统的发展和优化。

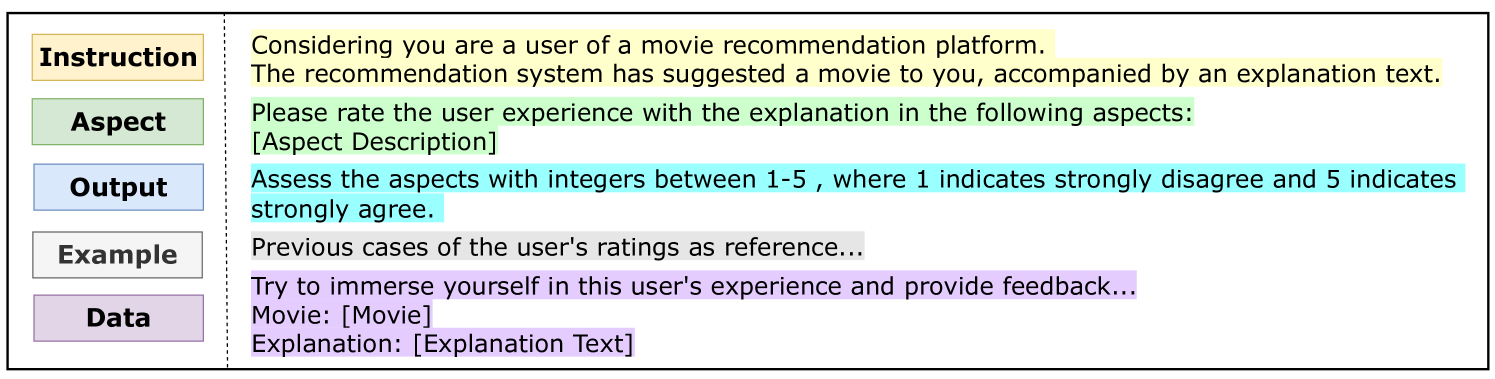

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大自然语言理解和生成能力,将其作为自动评估器来评估推荐解释的质量。通过设计合适的提示(prompt),引导LLM模拟人类评估者的思维过程,从而实现高效、客观的评估。

技术框架:论文采用三级元评估策略。第一级是收集真实用户对推荐解释的反馈。第二级是引入第三方人工标注,作为中间层。第三级是利用LLM进行评估。然后,通过计算LLM评估结果与用户反馈和人工标注之间的相关性,来评估LLM作为评估器的有效性。同时,研究了不同提示策略、LLM模型以及集成多个LLM评估器的效果。

关键创新:论文的关键创新在于将LLM应用于推荐解释的自动评估,并验证了其可行性和有效性。与传统的人工评估相比,LLM评估具有成本低、效率高、可重复性强等优点。此外,论文还探索了如何通过合适的提示和集成策略来提高LLM评估的准确性和稳定性。

关键设计:论文的关键设计包括:1) 精心设计的提示,引导LLM关注解释的相关性、准确性、可理解性等方面;2) 三级元评估策略,确保评估结果的可靠性;3) 探索不同LLM模型(如GPT4)和集成策略,以提高评估性能;4) 考虑了人类标签与LLM评估的结合,以进一步提升评估效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,GPT4等LLM在适当提示下,能够提供与人工评估相当的推荐解释质量评估结果。通过集成多个异构LLM评估器,可以进一步提高评估的准确性和稳定性。该方法为推荐解释的自动评估提供了一种经济高效的解决方案。

🎯 应用场景

该研究成果可广泛应用于推荐系统的开发和评估中。开发者可以利用LLM自动评估推荐解释的质量,从而快速迭代和优化模型。此外,该方法还可以用于评估不同推荐算法的可解释性,为用户提供更透明、更值得信赖的推荐服务。未来,该技术有望扩展到其他需要解释性的AI应用领域,如医疗诊断、金融风控等。

📄 摘要(原文)

The explainability of recommender systems has attracted significant attention in academia and industry. Many efforts have been made for explainable recommendations, yet evaluating the quality of the explanations remains a challenging and unresolved issue. In recent years, leveraging LLMs as evaluators presents a promising avenue in Natural Language Processing tasks (e.g., sentiment classification, information extraction), as they perform strong capabilities in instruction following and common-sense reasoning. However, evaluating recommendation explanatory texts is different from these NLG tasks, as its criteria are related to human perceptions and are usually subjective. In this paper, we investigate whether LLMs can serve as evaluators of recommendation explanations. To answer the question, we utilize real user feedback on explanations given from previous work and additionally collect third-party annotations and LLM evaluations. We design and apply a 3-level meta evaluation strategy to measure the correlation between evaluator labels and the ground truth provided by users. Our experiments reveal that LLMs, such as GPT4, can provide comparable evaluations with appropriate prompts and settings. We also provide further insights into combining human labels with the LLM evaluation process and utilizing ensembles of multiple heterogeneous LLM evaluators to enhance the accuracy and stability of evaluations. Our study verifies that utilizing LLMs as evaluators can be an accurate, reproducible and cost-effective solution for evaluating recommendation explanation texts. Our code is available at https://github.com/Xiaoyu-SZ/LLMasEvaluator.