Towards Detecting LLMs Hallucination via Markov Chain-based Multi-agent Debate Framework

作者: Xiaoxi Sun, Jinpeng Li, Yan Zhong, Dongyan Zhao, Rui Yan

分类: cs.CL

发布日期: 2024-06-05

备注: 18 pages, 3 figures

💡 一句话要点

提出基于马尔可夫链的多智能体辩论框架,用于检测LLM的幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 幻觉检测 多智能体系统 马尔可夫链 事实核查

📋 核心要点

- 现有LLM幻觉检测方法存在训练成本高、验证不足等问题,导致性能受限。

- 提出基于马尔可夫链的多智能体辩论框架,通过多轮辩论验证声明的真实性。

- 实验结果表明,该方法在多个生成任务上显著提升了幻觉检测的准确性。

📝 摘要(中文)

大型语言模型(LLM)的出现促进了自然语言文本生成的发展,同时也带来了前所未有的挑战,其中内容幻觉是一个重要的关注点。现有的解决方案通常涉及训练过程中昂贵且复杂的干预。此外,一些方法侧重于问题分解,而忽略了关键的验证过程,导致性能下降或应用受限。为了克服这些限制,我们提出了一种基于马尔可夫链的多智能体辩论验证框架,以提高简洁声明中幻觉检测的准确性。我们的方法集成了事实核查过程,包括声明检测、证据检索和多智能体验证。在验证阶段,我们通过灵活的基于马尔可夫链的辩论部署多个智能体来验证单个声明,确保细致的验证结果。在三个生成任务上的实验结果表明,我们的方法比基线方法取得了显著的改进。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)生成文本时出现的幻觉问题,即生成不真实或与事实相悖的内容。现有方法的痛点在于,要么需要在训练阶段进行复杂的干预,成本高昂;要么侧重于将问题分解,而忽略了对分解后各个部分的有效验证,导致最终结果的准确性不高。

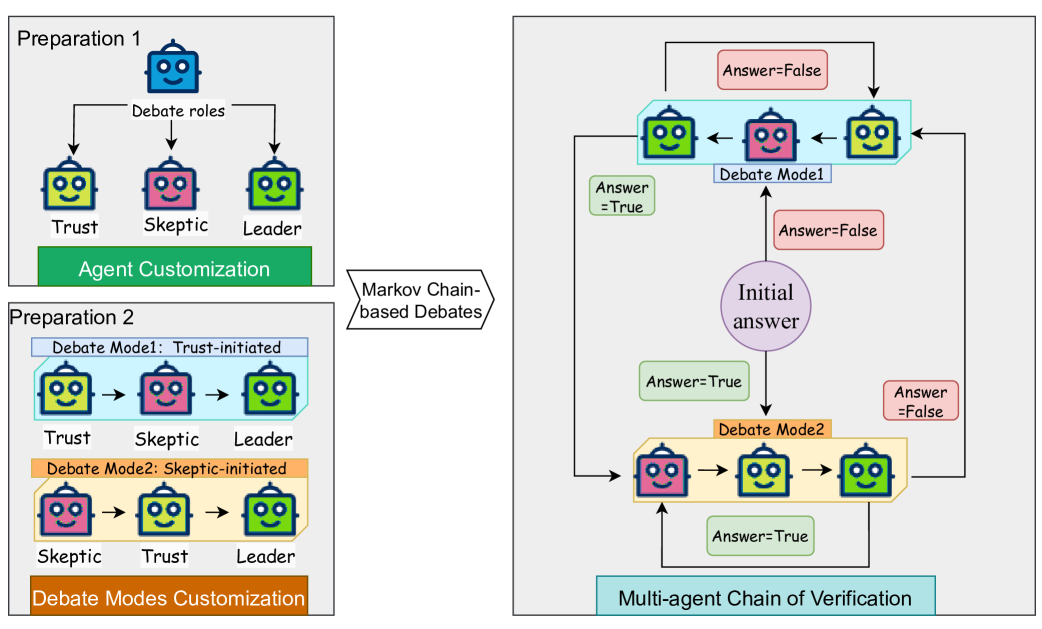

核心思路:论文的核心思路是模拟人类辩论的过程,通过多个智能体针对一个声明进行多轮辩论,从而验证该声明的真实性。这种方法借鉴了人类在验证信息时的严谨性和全面性,能够更有效地识别LLM生成的幻觉内容。通过马尔可夫链控制辩论流程,使得辩论过程更加灵活和可控。

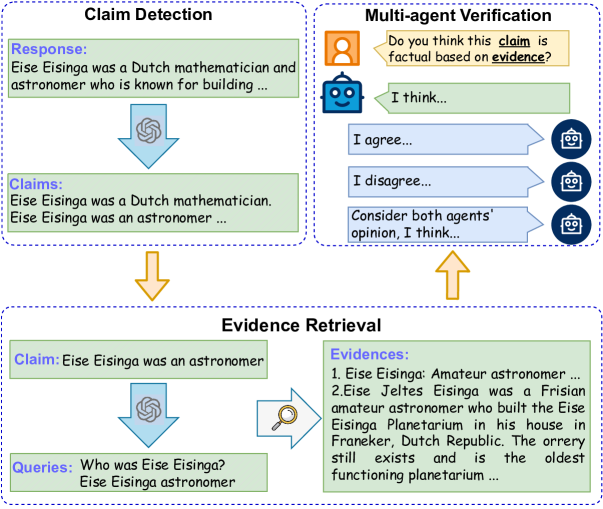

技术框架:该框架主要包含三个阶段:声明检测、证据检索和多智能体验证。首先,从LLM生成的文本中提取需要验证的声明。然后,针对每个声明,从外部知识库中检索相关的证据。最后,多个智能体基于检索到的证据,通过基于马尔科夫链的辩论过程,对声明进行验证。每个智能体代表一个不同的观点,通过多轮辩论,最终达成对声明真实性的共识。

关键创新:该方法最重要的技术创新点在于引入了基于马尔可夫链的多智能体辩论机制。与传统的单智能体验证方法相比,多智能体辩论能够更全面地考虑各种证据和观点,从而提高验证的准确性。马尔可夫链的应用使得辩论过程更加灵活和可控,可以根据声明的复杂程度动态调整辩论的轮数和智能体的参与程度。

关键设计:马尔可夫链用于控制辩论流程,每个状态代表辩论的一个阶段,状态转移概率决定了辩论的走向。智能体的设计包括其角色(例如,支持者、反对者)、知识库访问权限和辩论策略。损失函数的设计旨在鼓励智能体提供更准确、更相关的证据,并惩罚提供虚假或误导性证据的行为。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在三个生成任务上均取得了显著的改进,相较于基线方法,幻觉检测的准确率提升了显著幅度(具体数值未知)。这表明基于马尔可夫链的多智能体辩论框架能够有效地提高LLM生成内容的真实性和可靠性。

🎯 应用场景

该研究成果可应用于各种需要高质量文本生成的场景,例如新闻报道、内容创作、智能客服等。通过减少LLM的幻觉问题,可以提高生成内容的可靠性和实用性,避免因虚假信息带来的负面影响。未来,该方法可以进一步扩展到更复杂的文本生成任务中,例如对话生成、代码生成等。

📄 摘要(原文)

The advent of large language models (LLMs) has facilitated the development of natural language text generation. It also poses unprecedented challenges, with content hallucination emerging as a significant concern. Existing solutions often involve expensive and complex interventions during the training process. Moreover, some approaches emphasize problem disassembly while neglecting the crucial validation process, leading to performance degradation or limited applications. To overcome these limitations, we propose a Markov Chain-based multi-agent debate verification framework to enhance hallucination detection accuracy in concise claims. Our method integrates the fact-checking process, including claim detection, evidence retrieval, and multi-agent verification. In the verification stage, we deploy multiple agents through flexible Markov Chain-based debates to validate individual claims, ensuring meticulous verification outcomes. Experimental results across three generative tasks demonstrate that our approach achieves significant improvements over baselines.