Break the Chain: Large Language Models Can be Shortcut Reasoners

作者: Mengru Ding, Hanmeng Liu, Zhizhang Fu, Jian Song, Wenbo Xie, Yue Zhang

分类: cs.CL, cs.AI

发布日期: 2024-06-04

💡 一句话要点

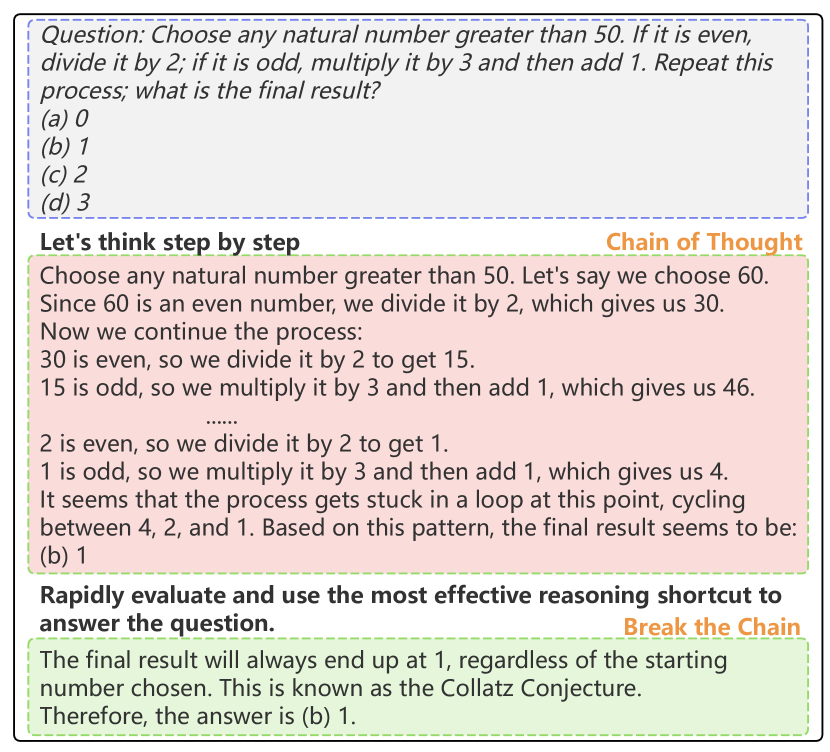

提出“打破链条”策略,提升大语言模型在复杂推理任务中的效率与泛化性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 思维链推理 启发式推理 捷径学习 零样本学习

📋 核心要点

- 现有CoT推理方法token消耗高、适用性有限,且难以复现,在复杂推理任务中表现不佳。

- 论文提出“打破链条”策略,通过引入类人启发式和捷径,提升语言模型的推理效率。

- 实验表明,该策略在多种语言模型上保持有效性能,并提出了ShortcutQA数据集作为评估基准。

📝 摘要(中文)

近年来,思维链(CoT)推理的进步依赖于复杂的模块,但受到高token消耗、有限的适用性和可重复性挑战的阻碍。本文对CoT提示进行了严格评估,将其扩展到包括复杂的逻辑和常识推理任务,这些任务是标准CoT方法难以处理的领域。我们提出通过“打破链条”策略将类人启发式方法和捷径融入语言模型(LM)。这些策略使用受控变量来评估其有效性,从而打破传统的CoT过程。此外,我们开发了创新的零样本提示策略,鼓励使用捷径,使LM能够快速利用推理线索并绕过详细的程序步骤。我们对各种商业和开源LM的全面实验表明,LM在使用“打破链条”策略时保持了有效的性能。我们还引入了ShortcutQA,这是一个专门用于评估通过捷径进行推理的数据集,该数据集由针对启发式推理任务(如正向/反向推理和简化)优化的竞争性测试编译而成。我们的分析证实,ShortcutQA不仅对LM提出了强大的挑战,而且是提高AI推理效率的重要基准。

🔬 方法详解

问题定义:现有Chain-of-Thought (CoT) 推理方法在处理复杂逻辑和常识推理任务时面临挑战,主要痛点在于token消耗过高,推理过程冗长,且在特定任务上的泛化能力不足。此外,CoT方法依赖于详细的逐步推理,这限制了模型利用捷径和启发式知识的能力,导致效率低下。

核心思路:论文的核心思路是打破传统的CoT推理链条,通过引入人类常用的启发式方法和捷径,使语言模型能够更快速、更有效地解决推理问题。这种“打破链条”的策略旨在让模型能够直接利用问题中的关键线索,绕过冗长的推理步骤,从而提高推理效率和泛化能力。

技术框架:该研究主要包含以下几个部分:首先,对现有CoT方法进行评估,分析其在复杂推理任务中的不足。其次,提出“打破链条”的策略,设计相应的提示方法,引导语言模型使用捷径进行推理。第三,构建ShortcutQA数据集,用于评估模型在捷径推理方面的能力。最后,在多个语言模型上进行实验,验证“打破链条”策略的有效性。

关键创新:论文的关键创新在于提出了“打破链条”的推理策略,这与传统的CoT方法形成对比。传统的CoT方法强调逐步推理,而“打破链条”策略则鼓励模型直接利用问题中的关键信息,绕过不必要的推理步骤。此外,ShortcutQA数据集的构建也为评估模型的捷径推理能力提供了一个新的基准。

关键设计:论文的关键设计包括:1) 设计了多种“打破链条”的提示方法,例如通过控制变量来评估CoT过程中不同步骤的重要性;2) 开发了零样本提示策略,鼓励模型利用捷径;3) 构建了ShortcutQA数据集,该数据集包含多种需要启发式推理的任务,例如正向/反向推理和简化。具体的参数设置、损失函数和网络结构等技术细节未在摘要中明确提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,“打破链条”策略在多种语言模型上保持了有效的性能。此外,ShortcutQA数据集的引入为评估模型的捷径推理能力提供了一个新的基准,并对现有语言模型提出了挑战。具体的性能数据和提升幅度在摘要中未明确提及,属于未知信息。

🎯 应用场景

该研究成果可应用于各种需要高效推理的场景,例如智能问答系统、对话机器人和决策支持系统。通过提升语言模型的推理效率,可以降低计算成本,提高响应速度,并增强模型在实际应用中的泛化能力。未来,该方法有望应用于更复杂的推理任务,例如科学发现和法律推理。

📄 摘要(原文)

Recent advancements in Chain-of-Thought (CoT) reasoning utilize complex modules but are hampered by high token consumption, limited applicability, and challenges in reproducibility. This paper conducts a critical evaluation of CoT prompting, extending beyond arithmetic to include complex logical and commonsense reasoning tasks, areas where standard CoT methods fall short. We propose the integration of human-like heuristics and shortcuts into language models (LMs) through "break the chain" strategies. These strategies disrupt traditional CoT processes using controlled variables to assess their efficacy. Additionally, we develop innovative zero-shot prompting strategies that encourage the use of shortcuts, enabling LMs to quickly exploit reasoning clues and bypass detailed procedural steps. Our comprehensive experiments across various LMs, both commercial and open-source, reveal that LMs maintain effective performance with "break the chain" strategies. We also introduce ShortcutQA, a dataset specifically designed to evaluate reasoning through shortcuts, compiled from competitive tests optimized for heuristic reasoning tasks such as forward/backward reasoning and simplification. Our analysis confirms that ShortcutQA not only poses a robust challenge to LMs but also serves as an essential benchmark for enhancing reasoning efficiency in AI.