Aligning Large Language Models via Fine-grained Supervision

作者: Dehong Xu, Liang Qiu, Minseok Kim, Faisal Ladhak, Jaeyoung Do

分类: cs.CL, cs.AI, cs.LG

发布日期: 2024-06-04

💡 一句话要点

提出基于细粒度监督的LLM对齐方法,提升模型与用户期望的一致性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大规模语言模型 对齐 强化学习 人类反馈 细粒度监督 奖励模型 近端策略优化

📋 核心要点

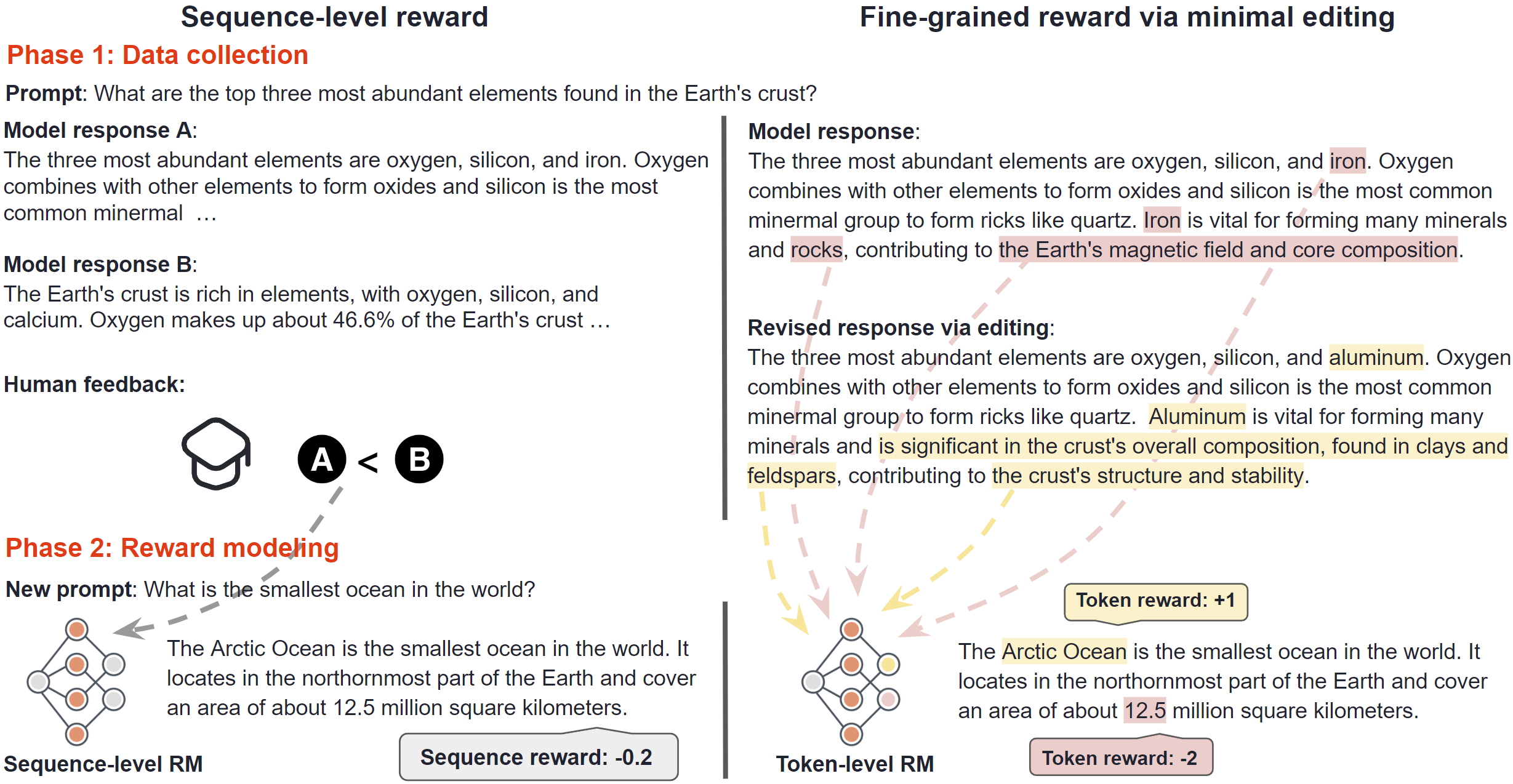

- 现有RLHF方法在序列级别进行反馈,无法精确定位影响用户偏好的具体token。

- 通过token级别的细粒度监督,最小化编辑不受欢迎的响应,训练token级奖励模型。

- 实验表明,该方法相较于传统PPO模型,在LLM性能上取得了显著提升,胜率提升达5.1%。

📝 摘要(中文)

预训练的大规模语言模型(LLMs)擅长生成连贯的文章,但其输出可能不真实、有害或未能与用户期望对齐。目前的方法主要集中在使用强化学习与人类反馈(RLHF)来改进模型对齐,这种方法通过将LLM输出的粗略人类偏好转化为反馈信号来指导模型学习过程。然而,由于这种方法是在序列级别上进行反馈,因此缺乏精确识别影响用户偏好的输出部分的能力。为了解决这个问题,我们提出了一种通过细粒度的token级别监督来增强LLM对齐的方法。具体来说,我们要求注释者对标准奖励建模数据集中的不太受欢迎的响应进行最小程度的编辑,使其更受欢迎,确保只在必要时进行更改,同时保留大部分原始内容。改进后的数据集用于训练token级别的奖励模型,然后用于训练我们的细粒度近端策略优化(PPO)模型。我们的实验结果表明,与传统的PPO模型相比,这种方法在LLM性能方面可以实现高达5.1%的绝对提升(以相对于参考模型的胜率衡量)。

🔬 方法详解

问题定义:论文旨在解决大规模语言模型(LLM)与用户期望对齐的问题。现有基于强化学习与人类反馈(RLHF)的方法,由于其反馈信号是序列级别的,无法精确定位并纠正LLM生成文本中导致用户不满意的具体token,导致对齐效果不佳。

核心思路:论文的核心思路是通过引入细粒度的token级别监督,让模型能够学习到哪些token的修改能够显著提升用户满意度。具体而言,通过人工对LLM生成的不受欢迎的文本进行最小化编辑,使其更符合用户偏好,从而获得token级别的修改信息。

技术框架:整体框架包含以下几个主要步骤:1) 数据收集:收集LLM生成的文本以及用户对这些文本的偏好信息。2) 数据标注:人工对不太受欢迎的文本进行最小化编辑,使其更受欢迎,记录token级别的修改。3) 奖励模型训练:使用标注后的数据训练一个token级别的奖励模型,该模型能够预测每个token对用户偏好的影响。4) PPO模型训练:使用token级别的奖励模型作为反馈信号,训练一个细粒度的近端策略优化(PPO)模型,优化LLM的生成策略。

关键创新:最重要的技术创新点在于引入了token级别的细粒度监督信号。与传统的序列级别反馈相比,这种细粒度的监督能够更精确地指导模型学习,从而提升模型与用户期望的对齐程度。这种方法避免了对整个序列进行评估,而是关注于关键token的修改,提高了学习效率和效果。

关键设计:关键设计包括:1) 最小化编辑策略:在人工编辑过程中,要求标注者尽可能少地修改原始文本,只修改那些直接导致用户不满意的token,以保留原始文本的大部分信息。2) Token级别奖励模型:奖励模型的设计需要能够准确评估每个token对用户偏好的影响,可以使用Transformer等模型结构,并采用合适的损失函数进行训练。3) 细粒度PPO训练:PPO训练过程中,需要将token级别的奖励信号有效地融入到策略优化过程中,可以使用masking等技术,只对需要修改的token进行策略更新。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在LLM性能方面取得了显著提升,相对于传统的PPO模型,胜率提升了5.1%。这一结果表明,细粒度的token级别监督能够有效地提升LLM与用户期望的对齐程度,并显著改善LLM的生成质量。该提升是在标准数据集上取得的,具有一定的通用性。

🎯 应用场景

该研究成果可应用于各种需要LLM与用户意图精准对齐的场景,例如智能客服、内容创作、代码生成等。通过提升LLM的对齐能力,可以提高用户满意度,减少有害或不准确信息的生成,并最终提升LLM的实际应用价值。未来,该方法可以进一步扩展到多模态场景,例如图像、语音等,实现更全面的对齐。

📄 摘要(原文)

Pre-trained large-scale language models (LLMs) excel at producing coherent articles, yet their outputs may be untruthful, toxic, or fail to align with user expectations. Current approaches focus on using reinforcement learning with human feedback (RLHF) to improve model alignment, which works by transforming coarse human preferences of LLM outputs into a feedback signal that guides the model learning process. However, because this approach operates on sequence-level feedback, it lacks the precision to identify the exact parts of the output affecting user preferences. To address this gap, we propose a method to enhance LLM alignment through fine-grained token-level supervision. Specifically, we ask annotators to minimally edit less preferred responses within the standard reward modeling dataset to make them more favorable, ensuring changes are made only where necessary while retaining most of the original content. The refined dataset is used to train a token-level reward model, which is then used for training our fine-grained Proximal Policy Optimization (PPO) model. Our experiment results demonstrate that this approach can achieve up to an absolute improvement of $5.1\%$ in LLM performance, in terms of win rate against the reference model, compared with the traditional PPO model.