Controlling Large Language Model Agents with Entropic Activation Steering

作者: Nate Rahn, Pierluca D'Oro, Marc G. Bellemare

分类: cs.CL

发布日期: 2024-06-01 (更新: 2024-10-10)

💡 一句话要点

提出Entropic Activation Steering (EAST)方法,用于控制大语言模型Agent的探索行为。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 Agent 探索 激活Steering 上下文学习

📋 核心要点

- 现有LLM Agent缺乏对探索行为的有效控制手段,难以主动适应环境变化。

- EAST方法通过激活steering直接操纵LLM Agent的高级动作,从而控制其探索行为。

- 实验证明EAST能有效引导Agent进行探索,且steering向量具有跨任务泛化能力。

📝 摘要(中文)

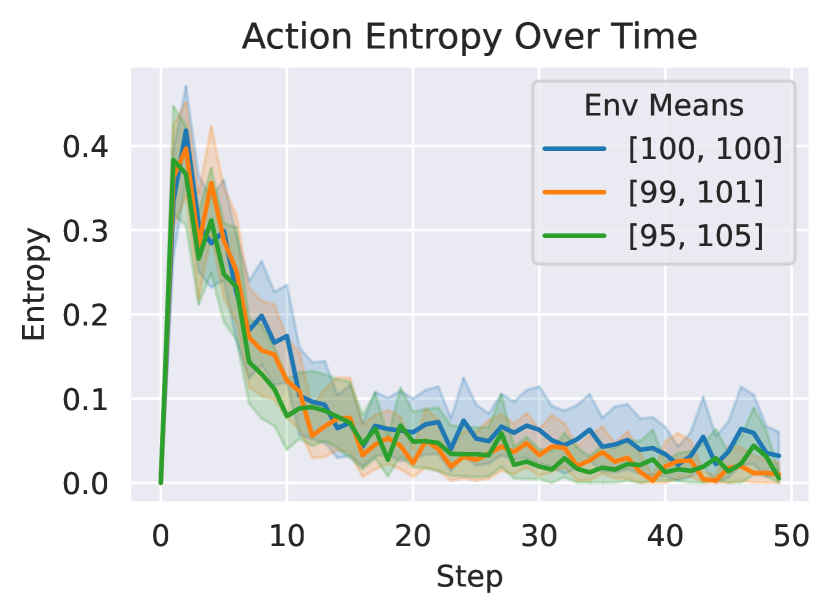

大型语言模型(LLM)作为上下文学习Agent的应用日益受到关注。Agent行为的核心在于探索能力,即主动收集环境信息的能力。本文从表征层面出发,提出了Entropic Activation Steering (EAST),一种用于上下文LLM Agent的激活steering方法。实验表明,EAST可以通过直接影响从LLM输出中解析的高级动作来有效地操纵LLM Agent的探索,这与token级别的温度采样不同。此外,EAST能够调节LLM思考过程中的不确定性,引导Agent采取更具探索性的行动。最后,EAST获得的steering向量可以泛化到不同的任务变体。总而言之,这些结果表明LLM Agent在其表征空间中明确地编码了对其动作的不确定性。这项工作为理解LLM Agent的运作方式和有效控制其决策行为开辟了新途径。

🔬 方法详解

问题定义:现有的大语言模型Agent在探索环境时,缺乏有效的控制机制。传统的token级别的温度采样方法无法直接控制Agent的高级行为,难以引导Agent进行有效的探索。因此,需要一种方法能够直接操纵Agent的探索行为,使其能够主动适应环境变化,更好地完成任务。

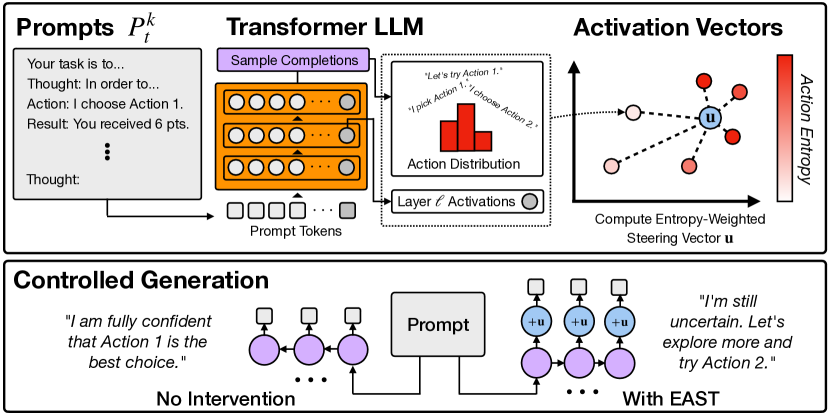

核心思路:本文的核心思路是通过激活steering来控制LLM Agent的探索行为。具体来说,通过在LLM的激活空间中添加steering向量,可以改变LLM的输出分布,从而影响Agent选择的动作。这种方法能够直接操纵Agent的高级行为,使其能够更加有效地探索环境。

技术框架:EAST方法的技术框架主要包括以下几个步骤:1) 使用LLM Agent与环境进行交互,收集Agent的激活数据和对应的动作数据。2) 使用收集到的数据训练steering向量,steering向量的目标是使Agent选择更具探索性的动作。3) 在Agent与环境交互时,将训练好的steering向量添加到LLM的激活空间中,从而引导Agent进行探索。

关键创新:EAST方法的关键创新在于它是一种表征层面的控制方法,可以直接操纵LLM Agent的高级行为。与传统的token级别的温度采样方法不同,EAST方法能够更加精确地控制Agent的探索行为,使其能够更加有效地探索环境。此外,EAST方法获得的steering向量具有跨任务泛化能力,可以在不同的任务变体中使用。

关键设计:EAST方法的关键设计包括:1) 如何选择合适的激活层进行steering。2) 如何设计损失函数来训练steering向量,损失函数的目标是使Agent选择更具探索性的动作。3) 如何将steering向量添加到LLM的激活空间中,以避免对LLM的原始行为产生过大的干扰。

🖼️ 关键图片

📊 实验亮点

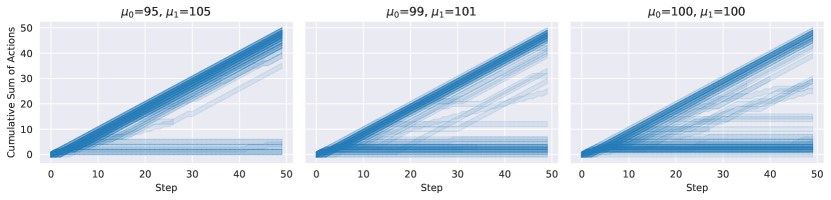

实验结果表明,EAST方法能够有效地操纵LLM Agent的探索行为,引导Agent采取更具探索性的行动。与基线方法相比,EAST方法能够显著提高Agent在复杂环境中的探索效率。此外,EAST方法获得的steering向量可以泛化到不同的任务变体,表明该方法具有良好的泛化能力。

🎯 应用场景

EAST方法可应用于机器人导航、游戏AI、自动驾驶等领域,提升Agent在复杂环境中的探索和决策能力。通过控制Agent的探索行为,可以使其更快地学习到最优策略,提高任务完成效率和鲁棒性。未来,该方法有望应用于更广泛的智能Agent系统,实现更智能、更自主的决策。

📄 摘要(原文)

The rise of large language models (LLMs) has prompted increasing interest in their use as in-context learning agents. At the core of agentic behavior is the capacity for exploration, or the ability to actively gather information about the environment. But how do LLM agents explore, and how can we control their exploratory behaviors? To answer these questions, we take a representation-level perspective, and introduce Entropic Activation Steering (EAST), an activation steering method for in-context LLM agents. Firstly, we demonstrate that EAST can effectively manipulate an LLM agent's exploration by directly affecting the high-level actions parsed from the outputs of the LLM, in contrast to token-level temperature sampling. Secondly, we reveal how applying this control modulates the uncertainty exhibited in the LLM's thoughts, guiding the agent towards more exploratory actions. Finally, we demonstrate that the steering vectors obtained by EAST generalize across task variants. In total, these results show that LLM agents explicitly encode uncertainty over their actions in their representation space. Our work paves the way for a new understanding of the functioning of LLM agents and to effective control of their decision-making behaviors.