Large Language Models: A New Approach for Privacy Policy Analysis at Scale

作者: David Rodriguez, Ian Yang, Jose M. Del Alamo, Norman Sadeh

分类: cs.CL, cs.CY

发布日期: 2024-05-31

期刊: Computing, vol. 106, no. 12, pp. 3879-3903, 2024

DOI: 10.1007/s00607-024-01331-9

💡 一句话要点

利用大型语言模型高效分析大规模隐私政策,降低成本并提升准确率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 隐私政策分析 自然语言处理 自动化合规 Few-shot Learning

📋 核心要点

- 现有隐私政策分析方法依赖人工标注数据,成本高昂且易出错,难以应对Web和移动应用快速增长的挑战。

- 本研究探索利用大型语言模型(LLMs)直接从隐私政策文本中提取隐私实践,无需大量标注数据,降低成本。

- 实验结果表明,基于LLM的方法在多个数据集上取得了超过93%的F1分数,显著优于传统NLP方法,且降低了成本。

📝 摘要(中文)

Web和移动应用的数量及其动态特性给评估其数据保护法律合规性带来了重大挑战。传统的符号和统计自然语言处理(NLP)技术被用于自动化分析这些系统的隐私政策,但通常需要耗费大量人力且容易出错的手动标注数据集进行训练和验证。本研究提出应用大型语言模型(LLMs)作为一种替代方案,以有效且高效地从大规模隐私政策中提取隐私实践。特别地,我们利用了ChatGPT和Llama 2等知名LLMs,并提供了关于提示、参数和模型的最佳设计的指导,结合了诸如few-shot learning等高级策略。我们进一步展示了其准确检测详细和多样的隐私实践的能力。通过使用该领域几个著名的数据集作为基准,我们的评估验证了其卓越的性能,实现了超过93%的F1分数。此外,它还降低了成本,缩短了处理时间,并减少了技术知识要求。因此,我们提倡基于LLM的解决方案作为传统NLP技术的一种可靠替代方案,用于大规模自动化分析隐私政策。

🔬 方法详解

问题定义:当前隐私政策分析面临的挑战在于,Web和移动应用的快速增长导致需要分析的隐私政策数量巨大且不断变化。传统的NLP方法依赖于人工标注的数据集进行训练,这既耗时又昂贵,并且容易引入人为错误。因此,如何高效、准确地分析大规模的隐私政策,成为一个亟待解决的问题。

核心思路:本研究的核心思路是利用大型语言模型(LLMs)强大的文本理解和生成能力,直接从隐私政策文本中提取隐私实践。通过精心设计的提示(prompts)和参数设置,引导LLMs理解隐私政策的内容,并准确地识别出相关的隐私实践信息。这种方法避免了对大量标注数据的依赖,从而降低了成本和时间。

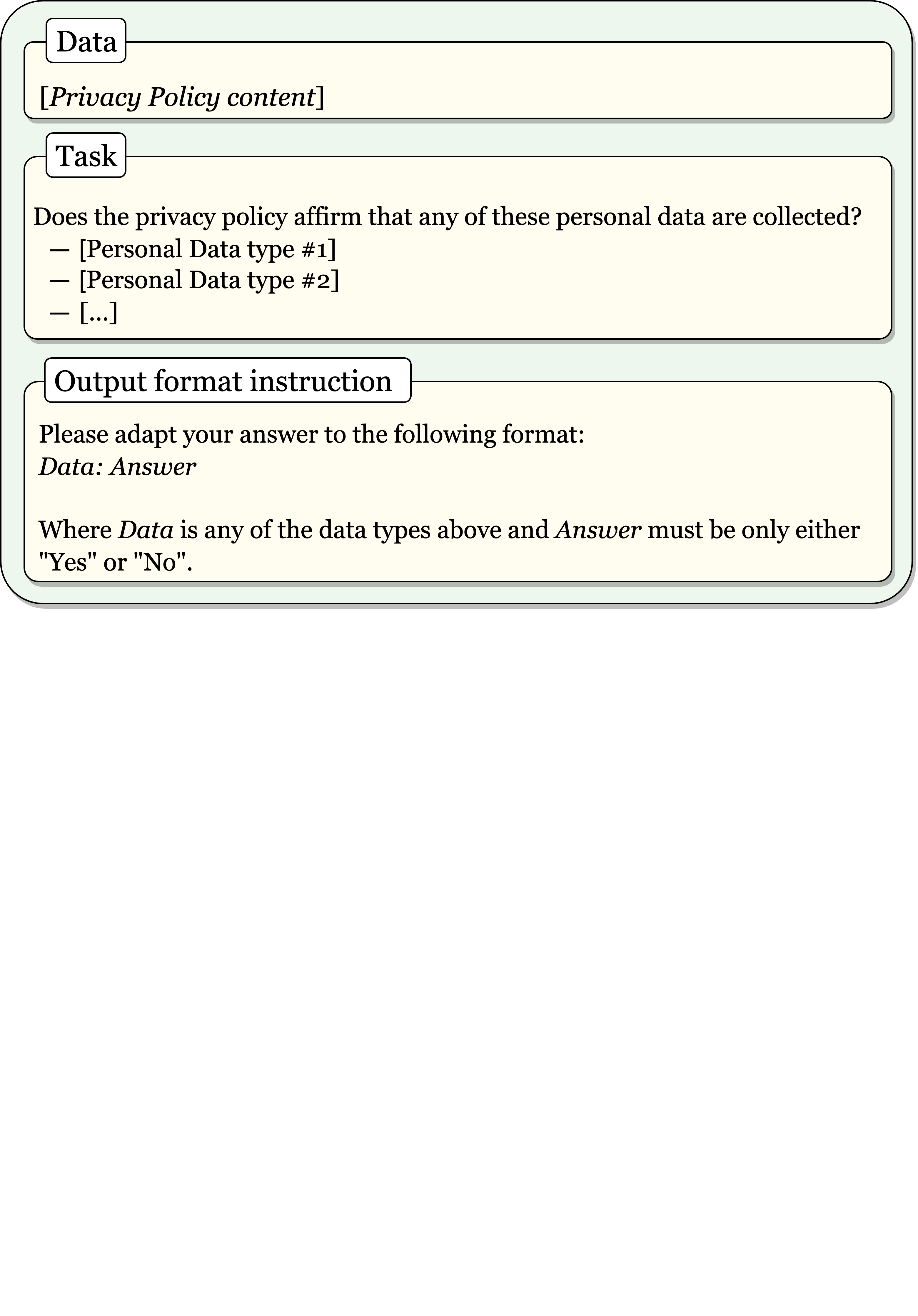

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择合适的LLMs,如ChatGPT和Llama 2;2) 设计有效的提示(prompts),引导LLMs理解隐私政策并提取相关信息;3) 调整LLMs的参数,以优化性能;4) 采用few-shot learning等策略,提高LLMs的泛化能力;5) 使用标准数据集对模型进行评估,验证其性能。

关键创新:本研究的关键创新在于将大型语言模型应用于隐私政策分析领域,并探索了如何有效地利用LLMs来解决这一问题。与传统的NLP方法相比,基于LLM的方法无需大量人工标注数据,降低了成本和时间,并且能够更准确地识别出复杂的隐私实践信息。

关键设计:在提示设计方面,研究人员探索了不同的提示模板和策略,以引导LLMs更好地理解隐私政策的内容。在参数设置方面,研究人员调整了LLMs的温度(temperature)等参数,以控制生成文本的多样性和准确性。此外,研究人员还采用了few-shot learning等技术,以提高LLMs在少量样本上的泛化能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于LLM的方法在多个隐私政策数据集上取得了显著的性能提升,F1分数超过93%。与传统的NLP方法相比,该方法不仅提高了准确率,还降低了成本和处理时间。例如,使用ChatGPT和Llama 2等LLMs,可以在无需大量标注数据的情况下,快速准确地分析大规模的隐私政策。

🎯 应用场景

该研究成果可应用于自动化隐私合规性评估、隐私风险识别、隐私政策生成与改进等领域。有助于企业降低合规成本,提升数据安全水平,并为用户提供更透明的隐私保护信息。未来,该技术可进一步扩展到其他法律文本分析领域,例如合同审查、法规解读等。

📄 摘要(原文)

The number and dynamic nature of web and mobile applications presents significant challenges for assessing their compliance with data protection laws. In this context, symbolic and statistical Natural Language Processing (NLP) techniques have been employed for the automated analysis of these systems' privacy policies. However, these techniques typically require labor-intensive and potentially error-prone manually annotated datasets for training and validation. This research proposes the application of Large Language Models (LLMs) as an alternative for effectively and efficiently extracting privacy practices from privacy policies at scale. Particularly, we leverage well-known LLMs such as ChatGPT and Llama 2, and offer guidance on the optimal design of prompts, parameters, and models, incorporating advanced strategies such as few-shot learning. We further illustrate its capability to detect detailed and varied privacy practices accurately. Using several renowned datasets in the domain as a benchmark, our evaluation validates its exceptional performance, achieving an F1 score exceeding 93%. Besides, it does so with reduced costs, faster processing times, and fewer technical knowledge requirements. Consequently, we advocate for LLM-based solutions as a sound alternative to traditional NLP techniques for the automated analysis of privacy policies at scale.