Towards Spoken Language Understanding via Multi-level Multi-grained Contrastive Learning

作者: Xuxin Cheng, Wanshi Xu, Zhihong Zhu, Hongxiang Li, Yuexian Zou

分类: cs.CL

发布日期: 2024-05-31

💡 一句话要点

提出多层次多粒度对比学习框架MMCL,提升口语理解任务性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 口语理解 对比学习 意图检测 槽填充 多粒度学习 自蒸馏 任务型对话系统

📋 核心要点

- 现有SLU模型忽略了意图和槽之间的内在联系,缺乏子任务间的相互指导。

- MMCL框架在多个粒度级别上进行对比学习,实现意图和槽之间的相互指导。

- 实验表明,MMCL在多意图SLU数据集上取得了显著的性能提升,达到新的SOTA。

📝 摘要(中文)

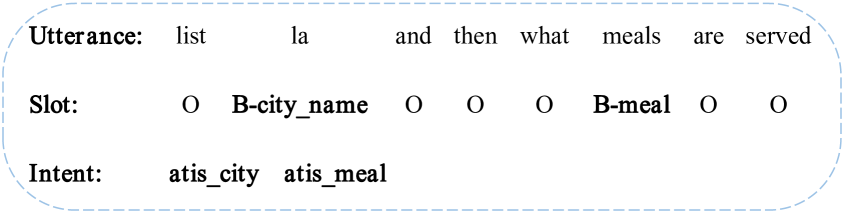

本文提出了一种用于口语理解(SLU)的多层次多粒度对比学习框架MMCL,旨在通过构建语义框架来理解用户的当前目标。SLU通常包含意图检测和槽填充两个子任务。尽管现有的一些SLU框架联合建模这两个子任务并取得了良好的性能,但它们大多忽略了意图和槽之间的内在关系,未能实现两个子任务之间的相互指导。为了解决这个问题,MMCL框架在 utterance 级别、slot 级别和 word 级别应用对比学习,使意图和槽能够相互指导。在 utterance 级别,该框架同时实现了粗粒度和细粒度的对比学习。此外,还应用了自蒸馏方法来提高模型的鲁棒性。实验结果和进一步分析表明,所提出的模型在两个公共的多意图SLU数据集上取得了新的state-of-the-art结果,在MixATIS数据集上获得了2.6%的整体准确率提升。

🔬 方法详解

问题定义:论文旨在解决口语理解(SLU)任务中,意图检测和槽填充两个子任务之间缺乏有效相互指导的问题。现有方法通常独立或简单联合建模这两个任务,忽略了它们之间的内在关联,导致性能瓶颈。这些方法未能充分利用意图信息来辅助槽填充,反之亦然。

核心思路:论文的核心思路是利用对比学习,在多个粒度级别上显式地建模意图和槽之间的关系,从而实现二者之间的相互指导。通过对比学习,模型能够学习到更具区分性的意图和槽表示,从而提高SLU的整体性能。这种多粒度对比学习能够捕捉不同层次的语义关联。

技术框架:MMCL框架包含三个主要的对比学习模块,分别在 utterance 级别、slot 级别和 word 级别进行。在 utterance 级别,同时进行粗粒度和细粒度的对比学习。粗粒度对比学习旨在区分不同的意图,而细粒度对比学习则关注具有相似意图的 utterance 之间的差异。Slot 级别的对比学习旨在区分不同的槽值。Word 级别的对比学习则关注 utterance 中不同词语对意图和槽填充的贡献。此外,框架还采用了自蒸馏方法,以提高模型的鲁棒性。

关键创新:该论文的关键创新在于提出了多层次多粒度的对比学习框架,将对比学习应用到 utterance、slot 和 word 三个不同的粒度级别,从而更全面地建模意图和槽之间的关系。同时,结合粗粒度和细粒度的对比学习,以及自蒸馏方法,进一步提升了模型的性能和鲁棒性。与现有方法相比,MMCL 能够更有效地利用意图和槽之间的相互信息,从而提高 SLU 的整体性能。

关键设计:在 utterance 级别,采用了 InfoNCE 损失函数进行对比学习。粗粒度对比学习使用不同的意图作为正负样本,而细粒度对比学习则使用具有相似意图的 utterance 作为正负样本。在 slot 级别,同样使用 InfoNCE 损失函数,以区分不同的槽值。自蒸馏方法通过让模型学习自身的预测结果,来提高模型的鲁棒性。具体的网络结构细节(如 embedding 维度、transformer 层数等)在论文中有详细描述,但此处未给出具体数值。

🖼️ 关键图片

📊 实验亮点

MMCL模型在MixATIS数据集上取得了2.6%的整体准确率提升,超过了之前的SOTA模型。实验结果表明,多层次多粒度的对比学习能够有效地提升SLU的性能。此外,自蒸馏方法的应用也显著提高了模型的鲁棒性。这些结果验证了MMCL框架的有效性和优越性。

🎯 应用场景

该研究成果可应用于各种任务型对话系统,例如智能客服、语音助手和智能家居控制等。通过提升口语理解的准确性和鲁棒性,可以改善用户体验,提高对话系统的实用性。未来,该方法可以扩展到其他自然语言理解任务,例如文本分类和情感分析。

📄 摘要(原文)

Spoken language understanding (SLU) is a core task in task-oriented dialogue systems, which aims at understanding the user's current goal through constructing semantic frames. SLU usually consists of two subtasks, including intent detection and slot filling. Although there are some SLU frameworks joint modeling the two subtasks and achieving high performance, most of them still overlook the inherent relationships between intents and slots and fail to achieve mutual guidance between the two subtasks. To solve the problem, we propose a multi-level multi-grained SLU framework MMCL to apply contrastive learning at three levels, including utterance level, slot level, and word level to enable intent and slot to mutually guide each other. For the utterance level, our framework implements coarse granularity contrastive learning and fine granularity contrastive learning simultaneously. Besides, we also apply the self-distillation method to improve the robustness of the model. Experimental results and further analysis demonstrate that our proposed model achieves new state-of-the-art results on two public multi-intent SLU datasets, obtaining a 2.6 overall accuracy improvement on the MixATIS dataset compared to previous best models.