Joint Embeddings for Graph Instruction Tuning

作者: Aaron Haag, Vlad Argatu, Oliver Lohse

分类: cs.SE, cs.CL

发布日期: 2024-05-31 (更新: 2024-09-10)

备注: This work has been submitted to the IEEE for possible publication

💡 一句话要点

提出基于图嵌入的指令调优方法,增强LLM的图理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图神经网络 大型语言模型 指令调优 图嵌入 知识图谱

📋 核心要点

- 现有方法难以有效利用LLM处理图结构数据,因为图的复杂性和置换不变性使得简单文本表示效果不佳。

- 该论文提出一种基于图嵌入的指令调优方法,旨在增强LLM对图结构的理解和推理能力。

- 实验结果表明,该方法显著优于图到文本的方法,并且在大图上的表现依然稳定。

📝 摘要(中文)

大型语言模型(LLMs)在文本理解方面表现出色,已成为构建智能助手的重要工具。最近的研究通过多模态能力增强了LLMs,成功构建了视觉指令跟随助手。然而,在图模态方面,尚未开发出此类助手。图结构复杂,因为它表示不同特征之间的关系,并且具有置换不变性。此外,即使对于微调模型,以纯文本形式表示图结构并不总能带来良好的LLM性能。因此,需要开发一种新方法将图集成到LLM中,以实现通用图理解。本文探讨了将图模态集成到LLM中,用于通用图指令跟随任务。旨在生成一个深度学习模型,该模型使用图嵌入增强底层LLM,并训练它理解这些嵌入,并在给定指令的情况下,生成一个基于图表示的答案。该方法明显优于图到文本的方法,并且即使对于更大的图也保持一致性。

🔬 方法详解

问题定义:现有的大型语言模型在文本和视觉理解方面取得了显著进展,但对于图结构数据的理解能力仍然有限。直接将图转换为文本输入LLM效果不佳,无法充分利用图的结构信息。因此,需要一种有效的方法将图信息融入LLM,使其能够理解和推理图数据。

核心思路:该论文的核心思路是将图结构信息编码为图嵌入,然后将这些嵌入与LLM结合,通过指令调优的方式训练LLM理解和利用这些嵌入。这种方法避免了直接将图转换为文本带来的信息损失,并允许LLM直接在图的嵌入空间中进行推理。

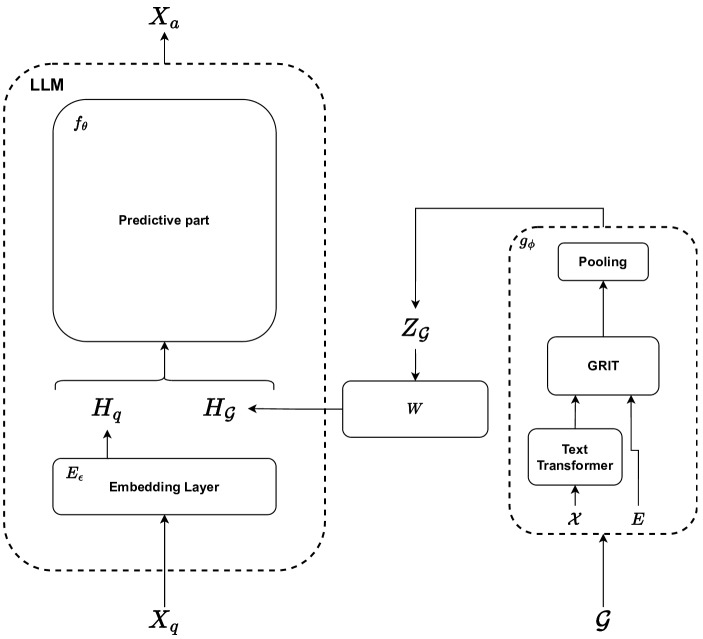

技术框架:整体框架包含三个主要部分:图嵌入模块、LLM和指令调优模块。首先,使用图神经网络(GNN)或其他图嵌入方法将图结构编码为节点和图级别的嵌入。然后,将这些嵌入与文本指令一起输入LLM。最后,通过指令调优,训练LLM根据指令和图嵌入生成相应的答案。

关键创新:该论文的关键创新在于将图嵌入与指令调优相结合,使得LLM能够直接理解和利用图结构信息。与传统的图到文本方法相比,该方法能够更好地保留图的结构信息,并提高LLM在图理解任务上的性能。

关键设计:具体的图嵌入方法可以采用现有的GNN模型,例如GCN、GAT等。LLM可以选择预训练的语言模型,例如BERT、GPT等。指令调优的目标是训练LLM根据指令和图嵌入生成正确的答案。损失函数可以使用交叉熵损失或序列生成损失。关键参数包括图嵌入的维度、LLM的层数和隐藏层大小、以及指令调优的学习率等。

🖼️ 关键图片

📊 实验亮点

论文提出的方法在图指令跟随任务上取得了显著的性能提升,优于传统的图到文本方法。实验结果表明,即使对于较大的图,该方法依然能够保持一致性,表明其具有良好的可扩展性。具体的性能数据和对比基线在论文中详细给出,证明了该方法的有效性。

🎯 应用场景

该研究成果可应用于多种图相关的任务,例如知识图谱问答、药物发现、社交网络分析、推荐系统等。通过增强LLM对图结构的理解能力,可以构建更智能的图数据分析和应用系统,例如智能客服、个性化推荐、欺诈检测等。未来,该方法还可以扩展到其他类型的图数据,例如动态图、异构图等。

📄 摘要(原文)

Large Language Models (LLMs) have achieved impressive performance in text understanding and have become an essential tool for building smart assistants. Originally focusing on text, they have been enhanced with multimodal capabilities in recent works that successfully built visual instruction following assistants. As far as the graph modality goes, however, no such assistants have yet been developed. Graph structures are complex in that they represent relation between different features and are permutation invariant. Moreover, representing them in purely textual form does not always lead to good LLM performance even for finetuned models. As a result, there is a need to develop a new method to integrate graphs in LLMs for general graph understanding. This work explores the integration of the graph modality in LLM for general graph instruction following tasks. It aims at producing a deep learning model that enhances an underlying LLM with graph embeddings and trains it to understand them and to produce, given an instruction, an answer grounded in the graph representation. The approach performs significantly better than a graph to text approach and remains consistent even for larger graphs.