Cutting Through the Noise: Boosting LLM Performance on Math Word Problems

作者: Ujjwala Anantheswaran, Himanshu Gupta, Kevin Scaria, Shreyas Verma, Chitta Baral, Swaroop Mishra

分类: cs.CL

发布日期: 2024-05-30 (更新: 2025-09-15)

备注: Published at ICLR 2025 Workshop on Reasoning and Planning for LLMs

💡 一句话要点

提出PROBLEMATHIC数据集并微调LLM,提升其在含噪声数学应用题上的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 数学应用题 对抗训练 鲁棒性 噪声 微调 prompting 数据集

📋 核心要点

- 现有LLM在解决数学应用题时,容易受到题目中无关信息(数值噪声)的干扰,导致性能显著下降。

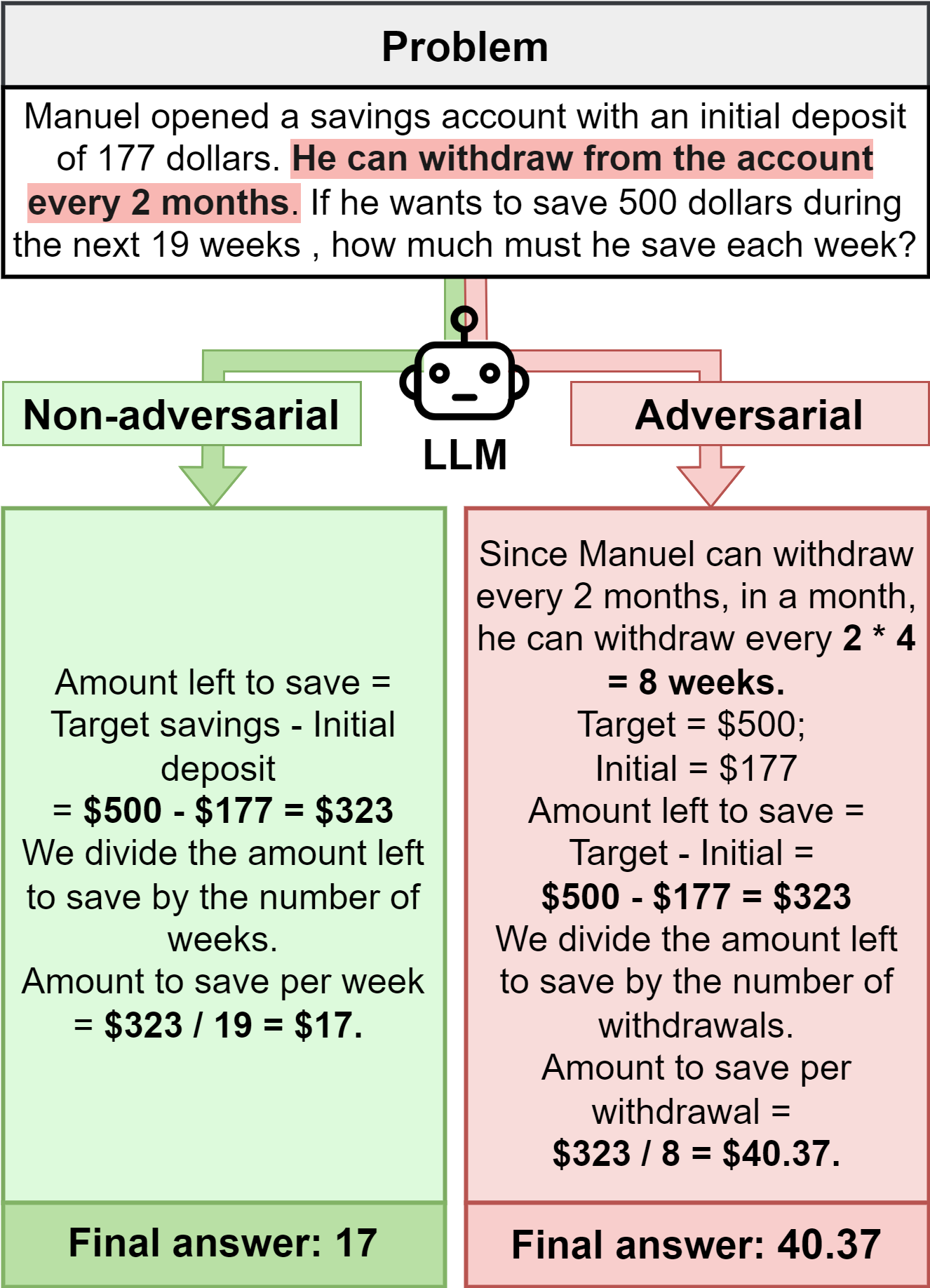

- 论文提出一种prompting框架,自动生成包含无关变量的对抗性数学应用题,并构建了PROBLEMATHIC数据集。

- 通过在对抗样本上微调LLM(Llama-2, Mistral),显著提升了模型在含噪声应用题上的鲁棒性和性能。

📝 摘要(中文)

大型语言模型(LLMs)在解决数学应用题(MWPs)等任务中表现出色,但难以处理包含无关信息的实际问题。为了解决这个问题,我们提出了一个prompting框架,通过添加无关变量来生成MWPs的对抗变体。我们引入了一个数据集PROBLEMATHIC,其中包含对抗性和非对抗性的MWPs。我们的实验表明,LLMs容易受到数值噪声的干扰,导致对抗性MWPs的平均相对性能下降约26%。为了缓解这个问题,我们使用来自我们数据集的对抗性样本对LLMs (Llama-2, Mistral)进行了微调。在对抗性训练实例上进行微调,使对抗性MWPs的性能提高了约8%,表明对噪声的鲁棒性增强,并且提高了识别相关数据进行推理的能力。最后,为了评估我们的prompting框架的泛化能力,我们引入了GSM-8K-Adv,这是GSM-8K基准的对抗变体。LLMs在面对对抗性信息时仍然表现不佳,性能降低高达6%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在处理包含无关信息的数学应用题(MWPs)时性能下降的问题。现有方法在处理真实场景下的MWPs时,由于题目中可能包含大量无关信息(例如数值噪声),LLMs容易被干扰,无法准确识别和利用关键信息进行推理和计算,导致解题准确率降低。

核心思路:论文的核心思路是通过对抗训练来增强LLMs对噪声的鲁棒性。具体来说,通过设计一种prompting框架,自动生成包含无关变量的MWPs的对抗变体,从而构建一个包含大量噪声样本的数据集。然后,利用这些对抗样本对LLMs进行微调,使模型学会忽略无关信息,关注关键信息,从而提高在真实场景下的解题能力。

技术框架:整体框架包括以下几个主要步骤:1) 设计prompting框架,用于生成对抗性MWPs;2) 构建包含对抗性和非对抗性MWPs的数据集PROBLEMATHIC;3) 使用PROBLEMATHIC数据集对LLMs(Llama-2, Mistral)进行微调;4) 在对抗性和非对抗性MWPs上评估微调后的LLMs的性能;5) 构建GSM-8K的对抗变体GSM-8K-Adv,评估prompting框架的泛化能力。

关键创新:论文最重要的技术创新点在于提出了一种自动生成对抗性MWPs的prompting框架。该框架能够有效地在原始MWPs中添加无关变量,从而生成具有挑战性的对抗样本。此外,论文还构建了一个包含对抗性和非对抗性MWPs的大规模数据集PROBLEMATHIC,为研究LLMs在含噪声环境下的性能提供了一个有价值的资源。

关键设计:prompting框架的关键设计在于如何有效地添加无关变量,同时保证生成的对抗样本仍然是有效的数学应用题。微调过程中的关键参数包括学习率、batch size、训练epoch等。损失函数采用标准的交叉熵损失函数。网络结构采用预训练的Llama-2和Mistral模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLMs在对抗性MWPs上的性能平均下降约26%。通过在PROBLEMATHIC数据集上进行微调,LLMs在对抗性MWPs上的性能提升了约8%,表明模型对噪声的鲁棒性得到了显著增强。在GSM-8K-Adv数据集上的实验表明,LLMs在面对对抗性信息时性能降低高达6%,突显了该研究的价值和意义。

🎯 应用场景

该研究成果可应用于提升LLM在实际问题解决中的可靠性和准确性,尤其是在金融分析、医疗诊断等对数据质量要求高的领域。通过增强模型对噪声的鲁棒性,可以减少因数据干扰导致的错误决策,提高AI系统的实用价值。未来,该方法可以推广到其他自然语言处理任务中,例如文本摘要、机器翻译等。

📄 摘要(原文)

Large Language Models (LLMs) excel at various tasks, including solving math word problems (MWPs), but struggle with real-world problems containing irrelevant information. To address this, we propose a prompting framework that generates adversarial variants of MWPs by adding irrelevant variables. We introduce a dataset, PROBLEMATHIC, containing both adversarial and non-adversarial MWPs. Our experiments reveal that LLMs are susceptible to distraction by numerical noise, resulting in an average relative performance drop of ~26% on adversarial MWPs. To mitigate this, we fine-tune LLMs (Llama-2, Mistral) on the adversarial samples from our dataset. Fine-tuning on adversarial training instances improves performance on adversarial MWPs by ~8%, indicating increased robustness to noise and improved ability to identify relevant data for reasoning. Finally, to assess the generalizability of our prompting framework, we introduce GSM-8K-Adv, an adversarial variant of the GSM-8K benchmark. LLMs continue to struggle when faced with adversarial information, reducing performance by up to 6%.