Automated Focused Feedback Generation for Scientific Writing Assistance

作者: Eric Chamoun, Michael Schlichktrull, Andreas Vlachos

分类: cs.CL

发布日期: 2024-05-30 (更新: 2024-06-04)

备注: Accepted to ACL 2024 (Findings)

💡 一句话要点

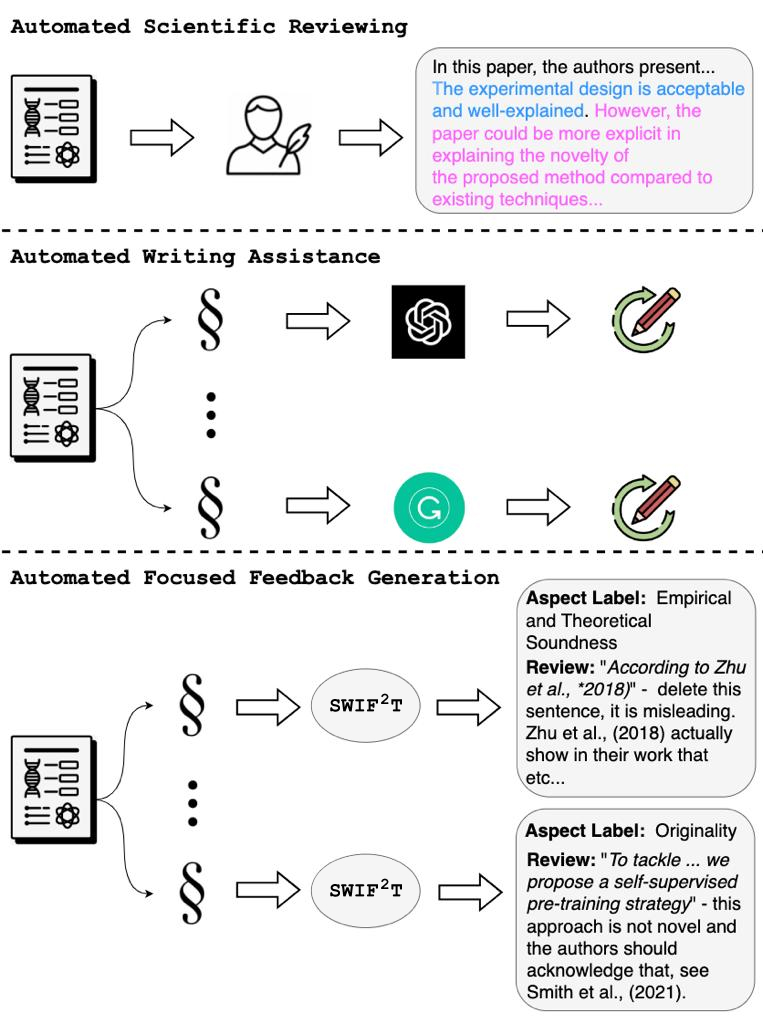

提出SWIF$^{2}$T,用于自动生成针对科学写作的聚焦反馈,辅助科研新手改进论文。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 科学写作辅助 自动反馈生成 大型语言模型 同行评审 自然语言处理

📋 核心要点

- 科研写作对新手研究者是挑战,他们依赖资深同行的反馈,但现有方法侧重于表面形式而非内容。

- 论文提出SWIF$^{2}$T工具,利用大型语言模型生成具体、可操作的反馈,识别论文弱点并提出修改建议。

- 实验结果表明,SWIF$^{2}$T生成的反馈在特异性、阅读理解和帮助性上优于其他方法,甚至优于人工反馈。

📝 摘要(中文)

本文提出了一项新任务:自动生成针对科学写作的聚焦反馈,以辅助科研写作。针对新手研究人员通常依赖有经验的同行的反馈这一现象,现有工作主要集中在改进表面形式和风格,而非稿件内容。我们提出了SWIF$^{2}$T:一个科学写作聚焦反馈工具。它旨在生成具体、可操作和连贯的评论,识别科学论文中的弱点和/或提出修改建议。我们的方法包含四个组件——规划器、调查器、审查器和控制器——利用多个大型语言模型(LLM)来实现它们。我们整理了一个包含300篇同行评审的数据集,这些评审引用了科学论文中的弱点,并进行了人工评估。结果表明,与其他方法相比,SWIF$^{2}$T的反馈在特异性、阅读理解和整体帮助性方面具有优越性。在我们的分析中,我们还发现自动生成的评论被认为优于人工评论的情况,这表明可以将AI生成的反馈整合到科学写作中。

🔬 方法详解

问题定义:论文旨在解决科学写作中,新手研究者难以获得高质量、聚焦的内容反馈的问题。现有方法主要关注语法、拼写等表面错误,忽略了对论文核心内容、逻辑结构、论证有效性等方面的深入评估和改进建议。人工反馈耗时且质量参差不齐,难以满足大量科研人员的需求。

核心思路:论文的核心思路是利用大型语言模型(LLMs)的强大能力,模拟资深研究者的评审过程,自动识别论文中的弱点,并生成具体的、可操作的修改建议。通过将评审过程分解为多个模块,并针对每个模块进行优化,从而提高反馈的质量和效率。

技术框架:SWIF$^{2}$T包含四个主要组件:规划器(Planner)、调查器(Investigator)、审查器(Reviewer)和控制器(Controller)。规划器负责确定评审的重点和策略;调查器深入分析论文内容,寻找潜在的弱点;审查器根据调查结果生成具体的反馈意见;控制器协调各个组件的工作,确保反馈的连贯性和一致性。整个流程利用多个LLMs,每个LLM负责不同的任务,协同完成自动反馈生成。

关键创新:该方法的主要创新在于将科学论文的评审过程分解为多个可控的模块,并针对每个模块设计了专门的LLM应用。这种模块化的设计使得系统能够更有效地利用LLMs的优势,生成更具针对性和可操作性的反馈。此外,该方法还探索了如何将多个LLMs协同工作,以实现更复杂的任务。

关键设计:论文中没有详细描述具体的参数设置、损失函数、网络结构等技术细节。但是,可以推断,每个LLM都经过了针对特定任务的微调,例如,调查器可能使用了专门用于信息检索和文本分析的LLM,审查器可能使用了专门用于生成自然语言文本的LLM。数据集包含300篇同行评审,用于训练和评估模型。具体的prompt工程和模型选择策略未知。

🖼️ 关键图片

📊 实验亮点

人工评估结果表明,SWIF$^{2}$T生成的反馈在特异性、阅读理解和整体帮助性方面优于其他方法。更重要的是,在某些情况下,SWIF$^{2}$T生成的反馈甚至被认为优于人工反馈,这表明AI在科学写作辅助方面具有巨大的潜力。具体的性能数据和提升幅度未知。

🎯 应用场景

该研究成果可应用于在线科研写作平台,为研究人员提供即时、个性化的反馈,提高论文质量和写作效率。此外,该技术还可用于辅助同行评审过程,减轻评审专家的负担,提高评审效率。未来,该技术有望推广到其他类型的写作辅助领域,例如新闻写作、法律文书写作等。

📄 摘要(原文)

Scientific writing is a challenging task, particularly for novice researchers who often rely on feedback from experienced peers. Recent work has primarily focused on improving surface form and style rather than manuscript content. In this paper, we propose a novel task: automated focused feedback generation for scientific writing assistance. We present SWIF$^{2}$T: a Scientific WrIting Focused Feedback Tool. It is designed to generate specific, actionable and coherent comments, which identify weaknesses in a scientific paper and/or propose revisions to it. Our approach consists of four components - planner, investigator, reviewer and controller - leveraging multiple Large Language Models (LLMs) to implement them. We compile a dataset of 300 peer reviews citing weaknesses in scientific papers and conduct human evaluation. The results demonstrate the superiority in specificity, reading comprehension, and overall helpfulness of SWIF$^{2}$T's feedback compared to other approaches. In our analysis, we also identified cases where automatically generated reviews were judged better than human ones, suggesting opportunities for integration of AI-generated feedback in scientific writing.