Reasoning about concepts with LLMs: Inconsistencies abound

作者: Rosario Uceda-Sosa, Karthikeyan Natesan Ramamurthy, Maria Chang, Moninder Singh

分类: cs.CL, cs.AI

发布日期: 2024-05-30

备注: 15 pages, 5 figures, 3 tables

💡 一句话要点

揭示LLM概念理解不一致性,提出基于知识图谱的prompt策略提升模型性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 概念理解 知识图谱 推理一致性 Prompt工程

📋 核心要点

- 现有LLM在概念理解上存在不一致性,这对于依赖概念一致性的工业应用构成挑战。

- 论文提出利用知识图谱(KG)构建prompt,引导LLM进行更一致的概念推理。

- 实验表明,基于KG的prompt策略能够显著提升各种规模LLM在概念理解任务上的性能。

📝 摘要(中文)

本文旨在研究大型语言模型(LLMs)在概念理解方面的一致性问题。概念的总结和组织是学习和推理的关键,许多工业应用依赖于概念的系统性使用。然而,通过系统性的提问,本文发现LLMs在知识方面存在显著的不一致性。从计算角度来看,领域概念化的基本方面可以表示为知识图谱(KG)或本体中的Is-A层级结构,以及一些属性或公理,从而实现直接推理。本文表明,即使是简单的本体也可以揭示多个LLM中的概念不一致性。此外,本文还提出了领域专家可以用来评估和提高各种规模LLM中关键领域概念覆盖率的策略,并通过基于知识图谱的prompt策略显著提升了具有公开权重LLM的性能。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在概念理解和推理方面表现出的不一致性问题。现有的LLMs虽然在许多自然语言处理任务中表现出色,但在处理需要系统性概念知识的任务时,往往会产生矛盾的答案。这种不一致性源于LLMs对概念之间关系的理解不足,例如“Is-A”关系,这限制了它们在需要可靠推理的实际应用中的使用。

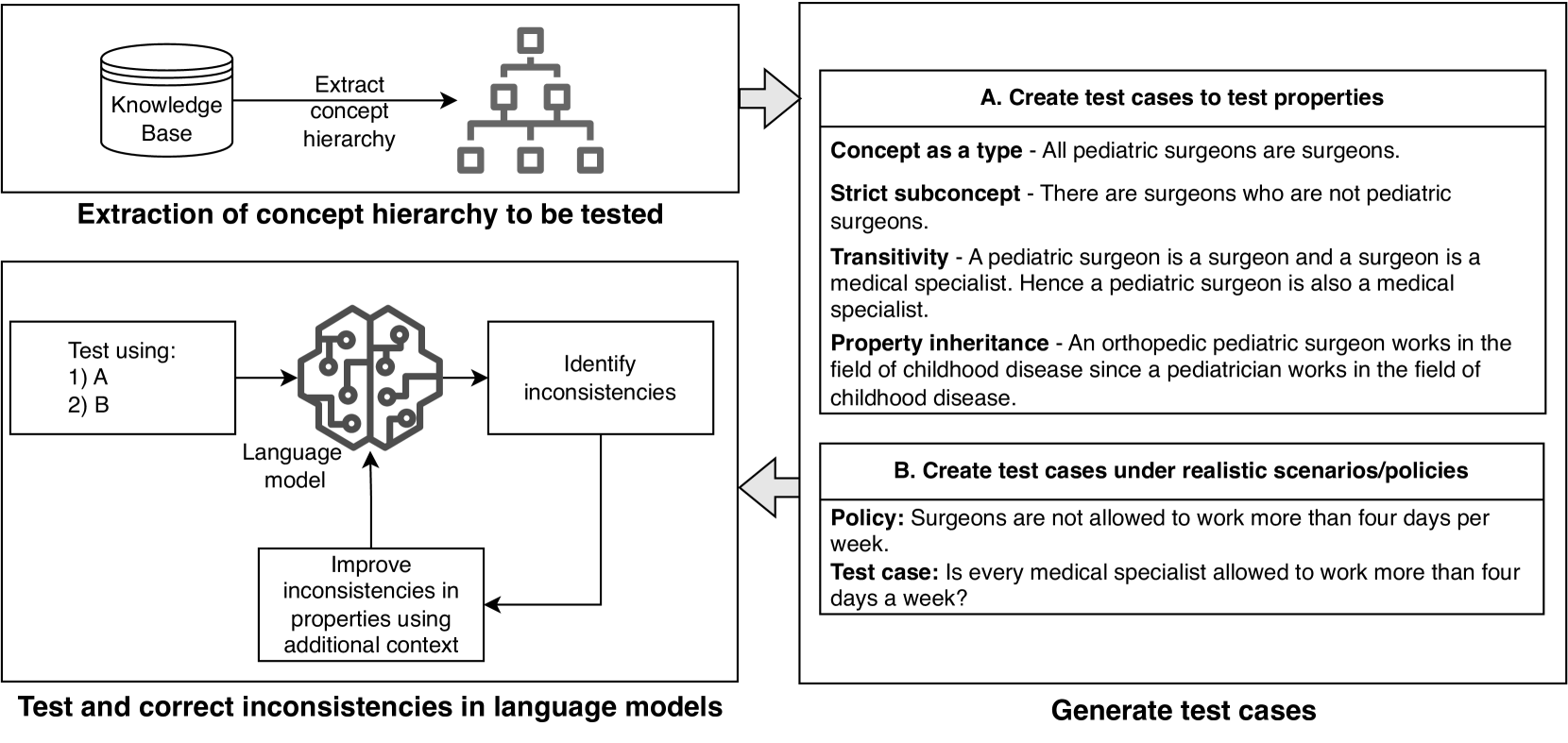

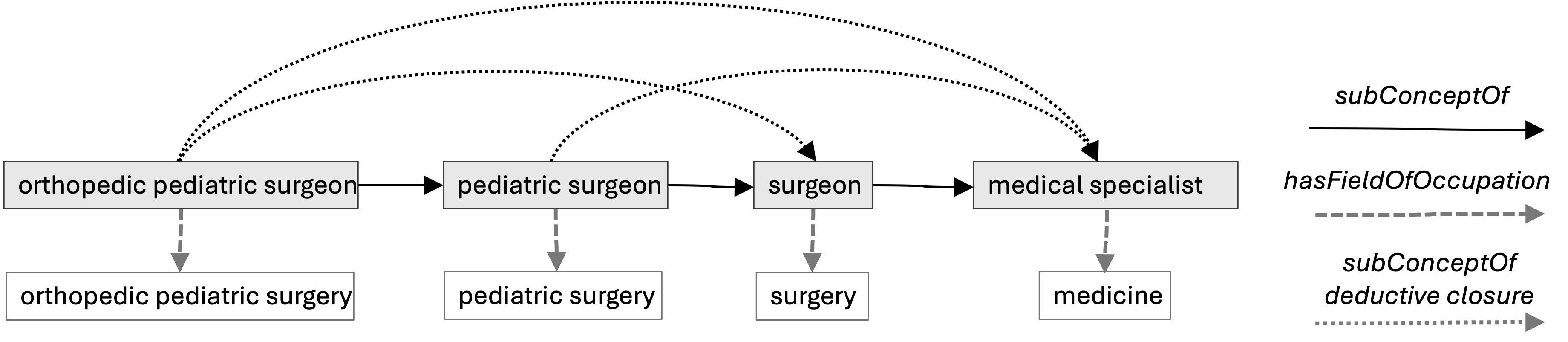

核心思路:论文的核心思路是利用知识图谱(KG)来弥补LLMs在概念理解方面的不足。通过将领域知识表示为KG,并利用KG中的关系信息来引导LLMs进行推理,可以提高LLMs在概念理解任务中的一致性和准确性。具体来说,论文使用KG中的Is-A层级结构和属性信息来构建prompt,从而向LLMs提供更明确的概念关系和约束。

技术框架:论文的技术框架主要包括以下几个步骤:1) 构建领域知识图谱:根据特定领域的知识,构建包含概念及其关系的知识图谱。2) 设计基于KG的Prompt:利用KG中的信息,设计用于引导LLMs进行推理的prompt。这些prompt通常包含概念的定义、属性以及与其他概念的关系。3) 使用LLM进行推理:将设计的prompt输入LLM,让LLM根据prompt中的信息进行推理,并生成答案。4) 评估LLM的推理结果:评估LLM生成的答案是否一致、准确,并根据评估结果调整prompt或KG。

关键创新:论文的关键创新在于将知识图谱与LLM相结合,利用KG来增强LLM的概念理解能力。与传统的prompting方法相比,基于KG的prompting方法能够提供更结构化、更明确的概念信息,从而提高LLM的推理一致性。此外,论文还提出了一种评估LLM概念理解一致性的方法,可以帮助领域专家识别LLM在特定领域中的知识缺陷。

关键设计:论文的关键设计包括:1) KG的构建方式:KG需要包含足够丰富的概念和关系信息,以覆盖LLM可能遇到的问题。2) Prompt的设计:Prompt需要清晰、简洁,能够有效地引导LLM进行推理。3) 评估指标的选择:需要选择合适的评估指标来衡量LLM的推理一致性和准确性。论文中具体使用的参数设置、损失函数和网络结构取决于所使用的LLM和KG,但核心思想是利用KG来增强LLM的概念理解能力。

🖼️ 关键图片

📊 实验亮点

论文通过实验证明,基于知识图谱的prompt策略能够显著提升LLM在概念理解任务上的性能。具体来说,使用该策略后,LLM在概念一致性方面的表现得到了明显改善,能够更准确地回答涉及概念关系的问题。此外,该方法还能够提高LLM在处理复杂推理任务时的准确率,使其能够更好地理解和应用领域知识。

🎯 应用场景

该研究成果可应用于多个领域,例如智能客服、医疗诊断、金融风控等。在这些领域中,对概念的准确理解和一致推理至关重要。通过利用知识图谱增强LLM的概念理解能力,可以提高这些应用系统的可靠性和准确性,从而提升用户体验和决策质量。未来,该方法有望扩展到更复杂的知识推理任务中。

📄 摘要(原文)

The ability to summarize and organize knowledge into abstract concepts is key to learning and reasoning. Many industrial applications rely on the consistent and systematic use of concepts, especially when dealing with decision-critical knowledge. However, we demonstrate that, when methodically questioned, large language models (LLMs) often display and demonstrate significant inconsistencies in their knowledge. Computationally, the basic aspects of the conceptualization of a given domain can be represented as Is-A hierarchies in a knowledge graph (KG) or ontology, together with a few properties or axioms that enable straightforward reasoning. We show that even simple ontologies can be used to reveal conceptual inconsistencies across several LLMs. We also propose strategies that domain experts can use to evaluate and improve the coverage of key domain concepts in LLMs of various sizes. In particular, we have been able to significantly enhance the performance of LLMs of various sizes with openly available weights using simple knowledge-graph (KG) based prompting strategies.