Improve Student's Reasoning Generalizability through Cascading Decomposed CoTs Distillation

作者: Chengwei Dai, Kun Li, Wei Zhou, Songlin Hu

分类: cs.CL, cs.AI

发布日期: 2024-05-30

🔗 代码/项目: GITHUB

💡 一句话要点

提出CasCoD,通过级联分解CoT蒸馏提升学生模型推理泛化性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 思维链 知识蒸馏 推理泛化 领域泛化 级联学习

📋 核心要点

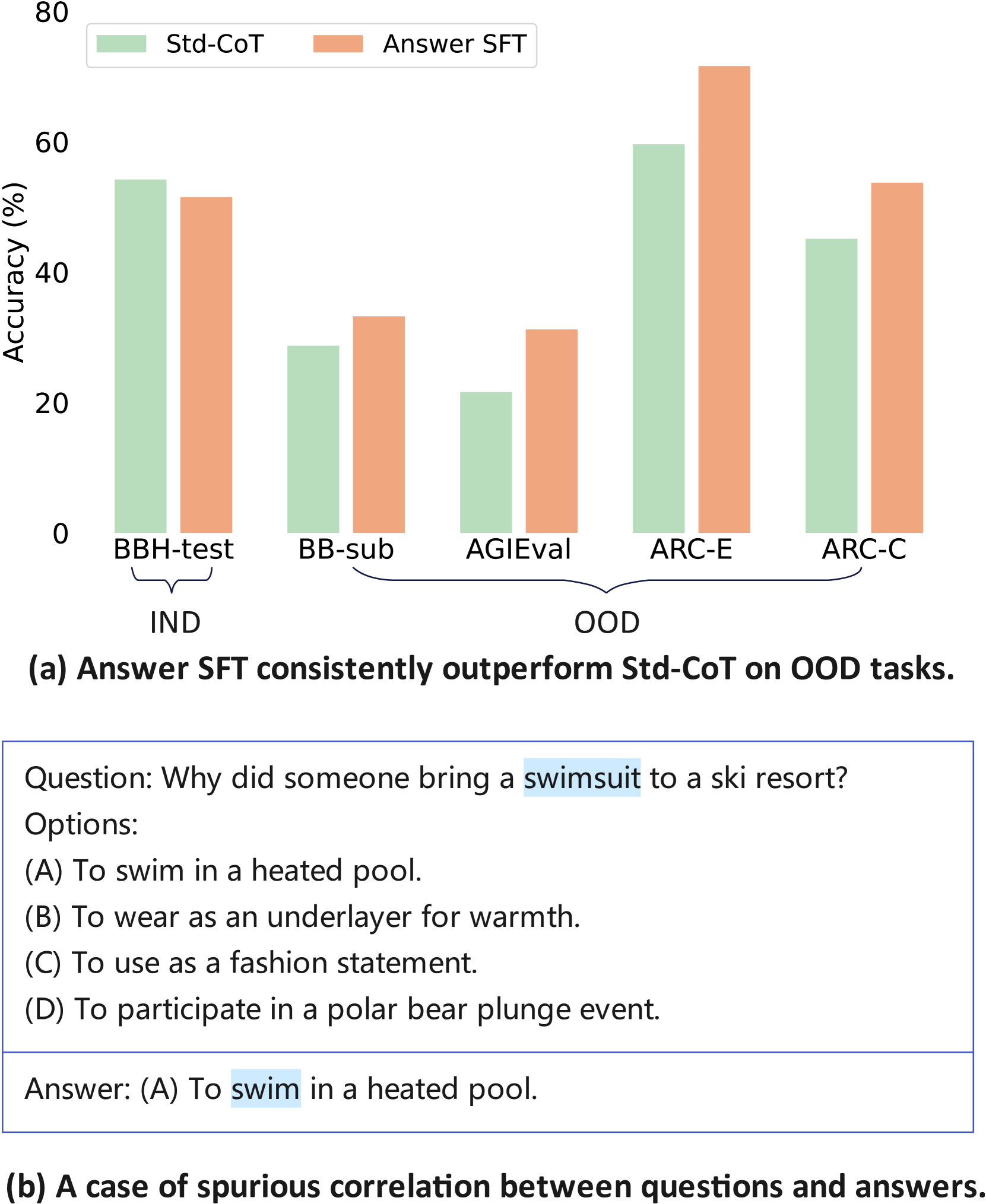

- 现有CoT蒸馏方法在领域内表现良好,但在领域外泛化性不足,原因是问题与答案间存在虚假相关性。

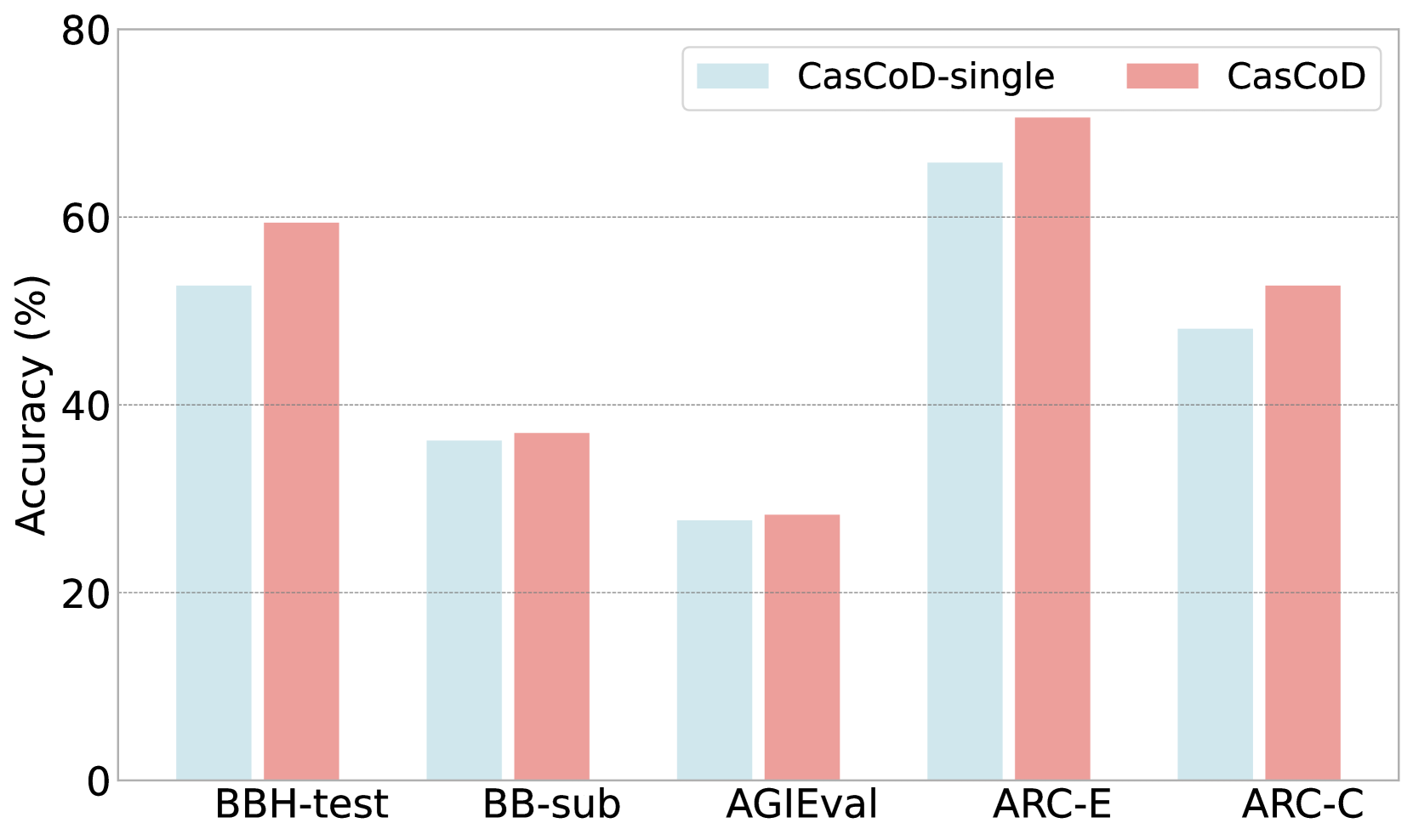

- CasCoD通过级联分解CoT蒸馏,将学习过程分解为关注理由生成的两步,避免预设答案的干扰。

- 实验结果表明,CasCoD在领域内和领域外推理数据集上均表现出优异的性能。

📝 摘要(中文)

大型语言模型(LLMs)在更大规模上表现出更强的推理能力,这推动了将这些能力通过师生学习提炼到更小模型中的努力。以往的工作仅仅在教师生成的思维链(CoTs)数据上微调学生模型。虽然这些方法提高了领域内(IND)的推理性能,但它们难以泛化到领域外(OOD)任务。我们认为,问题和答案之间广泛存在的虚假相关性可能导致模型预设一个特定的答案,从而限制其推理过程的多样性和泛化性。在本文中,我们提出了级联分解CoTs蒸馏(CasCoD)来解决这些问题,通过将传统的单步学习过程分解为两个级联的学习步骤。具体来说,通过重构训练目标——从输出中移除答案并将问题与理由连接作为输入——CasCoD的两步学习过程确保学生专注于学习理由,而不受预设答案的干扰,从而提高推理泛化性。大量的实验证明了CasCoD在IND和OOD基准推理数据集上的有效性。

🔬 方法详解

问题定义:现有CoT蒸馏方法在将大型语言模型的推理能力迁移到小型模型时,存在领域泛化性问题。具体来说,学生模型容易受到训练数据中问题与答案之间虚假相关性的影响,导致模型在推理时过分依赖预设答案,而忽略了真正的推理过程,从而在面对领域外数据时表现不佳。

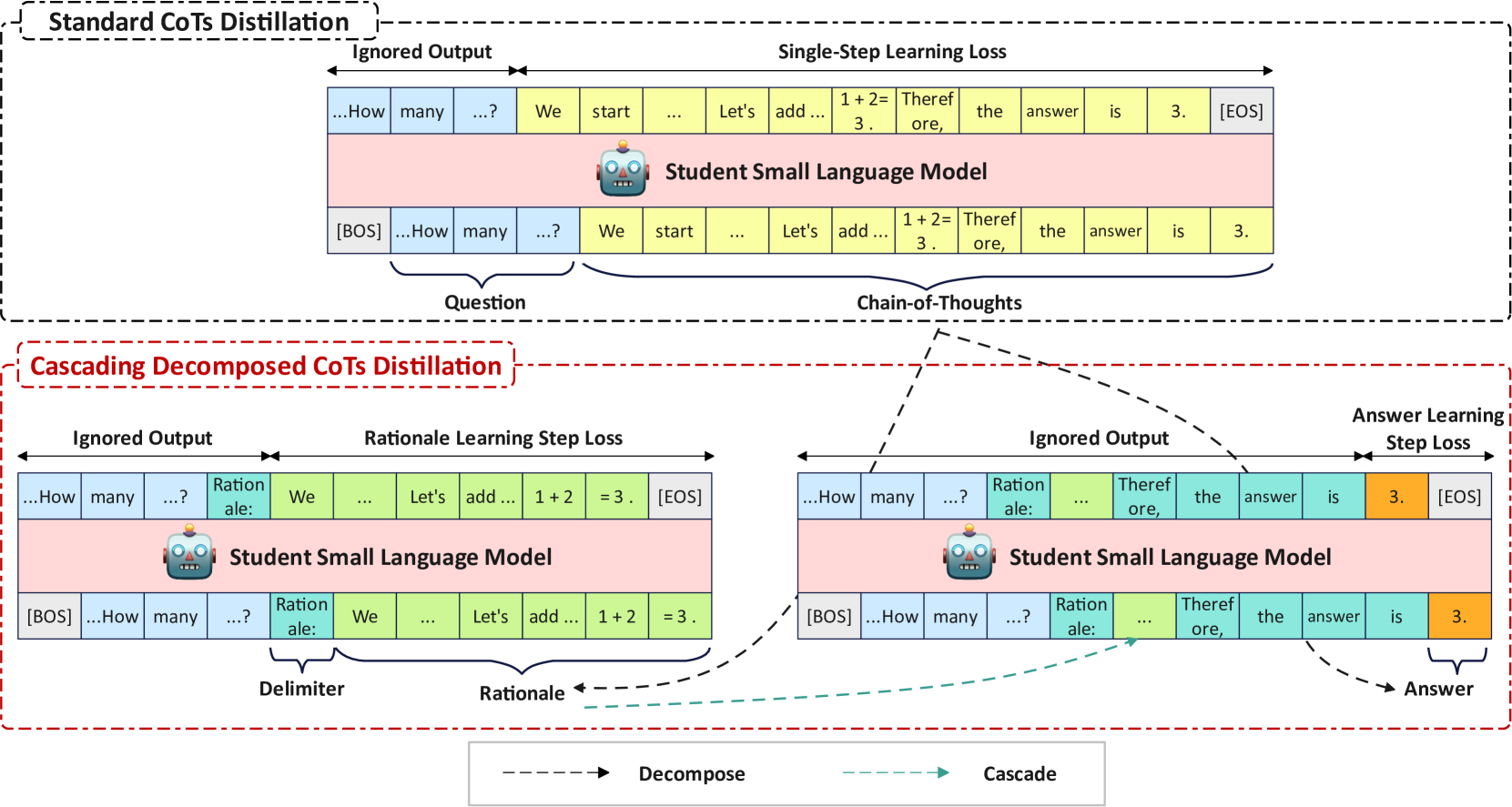

核心思路:CasCoD的核心思路是将传统的单步CoT蒸馏过程分解为两个级联的学习步骤,从而解耦答案和推理过程。通过这种方式,学生模型可以更加专注于学习如何生成正确的推理链,而不会受到预设答案的干扰,从而提高模型的泛化能力。

技术框架:CasCoD包含两个主要的学习阶段:第一阶段,模型学习生成推理链,目标是仅根据问题生成合理的解释,而不预测最终答案。这一阶段的训练数据由问题和对应的推理链组成,答案被移除。第二阶段,模型将问题和生成的推理链作为输入,学习预测最终答案。通过这种级联的方式,模型首先学习推理,然后再学习如何利用推理结果得出答案。

关键创新:CasCoD的关键创新在于将CoT蒸馏过程分解为两个级联的步骤,并重构了训练目标。通过移除答案并改变输入形式,CasCoD有效地避免了学生模型受到问题与答案之间虚假相关性的影响,从而提高了模型的推理泛化能力。这种分解和重构训练目标的方法是与现有CoT蒸馏方法最本质的区别。

关键设计:CasCoD的关键设计包括:1) 将CoT蒸馏分解为两个级联步骤;2) 在第一步中,从训练数据中移除答案,只保留问题和推理链;3) 在第二步中,将问题和第一步生成的推理链连接起来作为输入,预测最终答案。损失函数方面,可以使用标准的交叉熵损失函数来训练模型生成推理链和预测答案。具体的网络结构可以根据实际情况选择,例如可以使用Transformer模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CasCoD在多个IND和OOD基准推理数据集上均取得了显著的性能提升。例如,在某些OOD数据集上,CasCoD相比于传统的CoT蒸馏方法,性能提升超过10%。这些结果表明,CasCoD能够有效地提高学生模型的推理泛化能力,使其在面对未知领域的数据时也能表现出色。

🎯 应用场景

CasCoD方法可以应用于各种需要推理能力的自然语言处理任务,例如问答系统、阅读理解、数学问题求解等。通过提高模型在领域外的泛化能力,CasCoD可以使这些应用在更广泛的场景中发挥作用,并减少对特定领域数据的依赖。此外,该方法还可以用于知识蒸馏,将大型语言模型的推理能力迁移到资源受限的设备上。

📄 摘要(原文)

Large language models (LLMs) exhibit enhanced reasoning at larger scales, driving efforts to distill these capabilities into smaller models via teacher-student learning. Previous works simply fine-tune student models on teachers' generated Chain-of-Thoughts (CoTs) data. Although these methods enhance in-domain (IND) reasoning performance, they struggle to generalize to out-of-domain (OOD) tasks. We believe that the widespread spurious correlations between questions and answers may lead the model to preset a specific answer which restricts the diversity and generalizability of its reasoning process. In this paper, we propose Cascading Decomposed CoTs Distillation (CasCoD) to address these issues by decomposing the traditional single-step learning process into two cascaded learning steps. Specifically, by restructuring the training objectives -- removing the answer from outputs and concatenating the question with the rationale as input -- CasCoD's two-step learning process ensures that students focus on learning rationales without interference from the preset answers, thus improving reasoning generalizability. Extensive experiments demonstrate the effectiveness of CasCoD on both IND and OOD benchmark reasoning datasets. Code can be found at https://github.com/C-W-D/CasCoD.