Enhancing Reinforcement Learning with Label-Sensitive Reward for Natural Language Understanding

作者: Kuo Liao, Shuang Li, Meng Zhao, Liqun Liu, Mengge Xue, Zhenyu Hu, Honglin Han, Chengguo Yin

分类: cs.CL

发布日期: 2024-05-30

备注: Accept at ACL2024 Main

🔗 代码/项目: GITHUB

💡 一句话要点

提出RLLR框架,利用标签敏感奖励增强强化学习在自然语言理解任务中的性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 自然语言理解 标签敏感奖励 大型语言模型 RLHF

📋 核心要点

- RLHF在NLU任务中存在目标不匹配问题,导致性能未达到最优。

- 提出RLLR框架,通过引入标签敏感奖励,使模型能够捕捉细微的语义特征。

- 实验结果表明,RLLR在多个NLU任务上优于SFT和RLHF模型,平均提升显著。

📝 摘要(中文)

大型语言模型(LLMs)的最新进展,利用人类反馈的强化学习(RLHF)显著增强了生成和对齐能力。然而,RLHF面临许多挑战,包括目标不匹配问题,导致自然语言理解(NLU)任务的性能欠佳。为了解决这个限制,我们提出了一种新颖的强化学习框架,该框架通过标签敏感奖励(RLLR)增强,以提高LLMs在NLU任务中的性能。通过将标签敏感对纳入强化学习,我们的方法旨在巧妙地捕捉RL期间细微的标签敏感语义特征,从而增强自然语言理解。在八个任务中对五个不同的基础模型进行的实验显示出有希望的结果。与监督微调模型(SFT)相比,RLLR的平均性能提高了1.54%。与RLHF模型相比,平均提高了0.69%。这些结果揭示了我们的方法对于LLMs在NLU任务中的有效性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在自然语言理解任务中使用RLHF时,由于目标不匹配而导致的性能瓶颈问题。现有的RLHF方法在NLU任务中无法充分利用标签信息,导致模型无法准确理解和区分细微的语义差异。

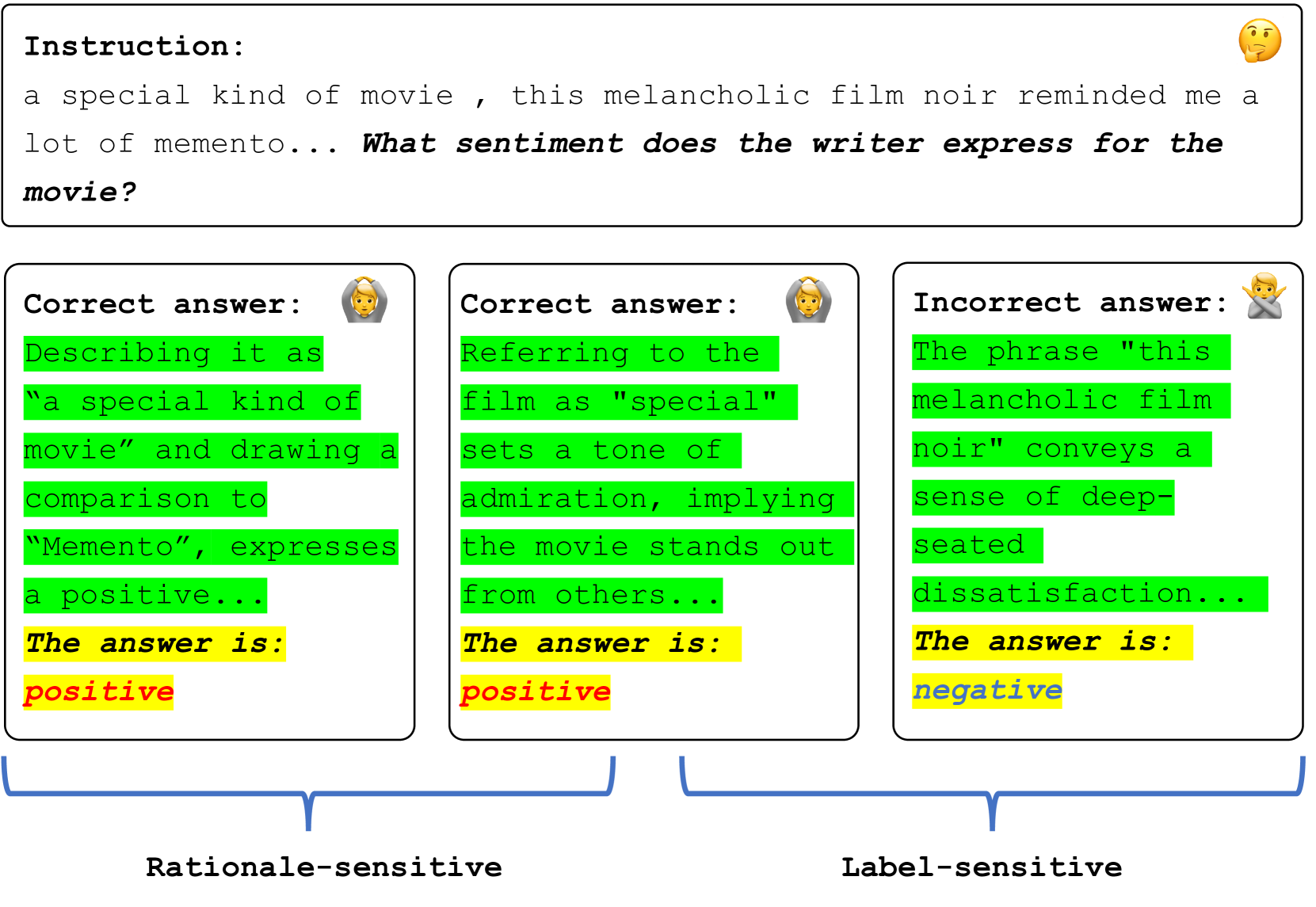

核心思路:论文的核心思路是引入标签敏感奖励机制,使强化学习过程能够感知标签信息,从而更好地学习标签相关的语义特征。通过设计合适的标签敏感奖励函数,引导模型学习区分具有相似语义但标签不同的样本,从而提高NLU任务的准确性。

技术框架:RLLR框架在标准的强化学习流程中加入了标签敏感奖励模块。整体流程包括:1) 使用LLM生成文本;2) 根据生成的文本和标签,计算标签敏感奖励;3) 使用奖励信号更新LLM的策略。关键在于标签敏感奖励的计算,它依赖于预定义的标签敏感对,用于衡量模型对相似但标签不同的样本的区分能力。

关键创新:RLLR的关键创新在于标签敏感奖励的设计。与传统的奖励函数不同,RLLR的奖励函数不仅考虑了模型的预测结果,还考虑了模型对标签敏感对的区分能力。这种设计使得模型能够学习到更加细粒度的语义特征,从而提高NLU任务的性能。

关键设计:标签敏感奖励函数的设计是关键。具体而言,论文定义了标签敏感对,即具有相似语义但标签不同的样本对。奖励函数的设计目标是使模型能够区分这些样本对。具体的奖励计算方式可能涉及计算模型对标签敏感对的预测概率差异,并将其作为奖励信号的一部分。此外,损失函数也需要进行调整,以更好地利用标签敏感奖励信号。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RLLR框架在五个不同的基础模型和八个NLU任务上均取得了显著的性能提升。与监督微调模型(SFT)相比,RLLR的平均性能提高了1.54%。与RLHF模型相比,平均提高了0.69%。这些结果验证了RLLR框架在增强LLMs在NLU任务中的有效性。

🎯 应用场景

该研究成果可应用于各种自然语言理解任务,例如文本分类、情感分析、意图识别等。通过提高LLMs在NLU任务中的性能,可以提升智能客服、智能助手等应用的智能化水平,并为更复杂的人工智能系统提供更准确的语义理解能力。未来,该方法可以扩展到其他需要细粒度语义理解的任务中,例如机器翻译、文本摘要等。

📄 摘要(原文)

Recent strides in large language models (LLMs) have yielded remarkable performance, leveraging reinforcement learning from human feedback (RLHF) to significantly enhance generation and alignment capabilities. However, RLHF encounters numerous challenges, including the objective mismatch issue, leading to suboptimal performance in Natural Language Understanding (NLU) tasks. To address this limitation, we propose a novel Reinforcement Learning framework enhanced with Label-sensitive Reward (RLLR) to amplify the performance of LLMs in NLU tasks. By incorporating label-sensitive pairs into reinforcement learning, our method aims to adeptly capture nuanced label-sensitive semantic features during RL, thereby enhancing natural language understanding. Experiments conducted on five diverse foundation models across eight tasks showcase promising results. In comparison to Supervised Fine-tuning models (SFT), RLLR demonstrates an average performance improvement of 1.54%. Compared with RLHF models, the improvement averages at 0.69%. These results reveal the effectiveness of our method for LLMs in NLU tasks. Code and data available at: https://github.com/MagiaSN/ACL2024_RLLR.